欢迎点击上方卡片,关注“源迈AI”公众号

本报告是由中国信息通信研究院(CAICT)人工智能研究所与中国人工智能产业发展联盟(AIIA)联合发布的专业研究报告。报告系统性地梳理和分析了大模型推理优化在2026年的关键技术、应用实践与产业发展趋势。

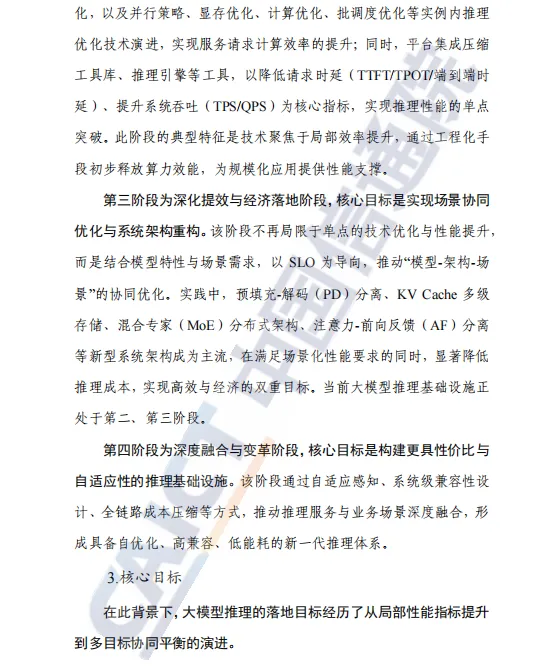

报告首先从宏观背景出发,指出大模型推理已成为人工智能技术从实验室走向规模化产业应用的“最后一公里”,其计算量、服务调用量及成本投入正呈现爆发式增长,同时也面临着多样化场景适配、高算力需求与成本控制平衡,以及模型架构快速演进带来的适配挑战。

报告的核心技术部分构建了一个三层优化体系:

模型层面:聚焦从源头优化,涵盖模型压缩(量化、剪枝、蒸馏等)、MoE(混合专家)稀疏化架构的创新应用(如DeepSeek MoE),以及算法创新(如MHA, MQA, GQA, MLA注意力机制),旨在使模型本身更轻、更快、更易部署。

引擎层面:作为执行枢纽,专注于提升单实例或轻量集群内的计算效率,关键技术包括显存优化(如PagedAttention、Prefix Caching)、计算优化(如算子融合、FlashAttention)、并行加速(数据并行、张量并行、专家并行等)以及批调度优化(如连续批处理、Chunked-Prefill)。

系统层面:关注跨节点、跨资源的全局协同与服务化交付,重点介绍了PD(预填充-解码)分离架构、针对MoE模型的AF(注意力-前馈网络)分离架构、智能化的系统调度策略以及面向长上下文的高性能多级存储体系(HBM-DRAM-SSD)。

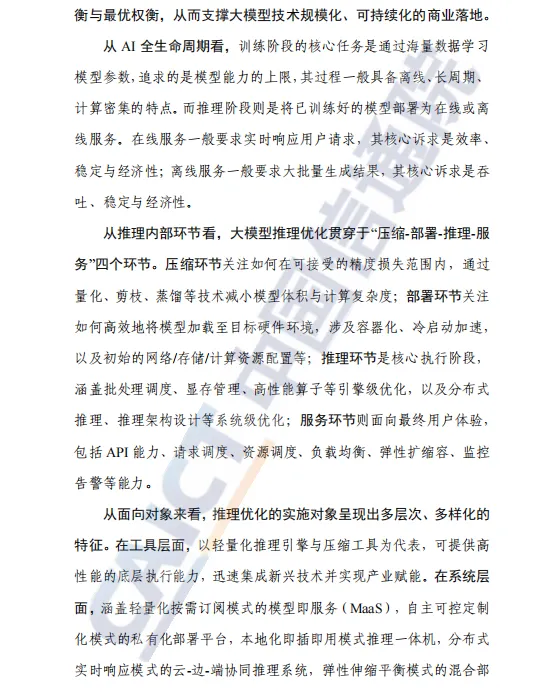

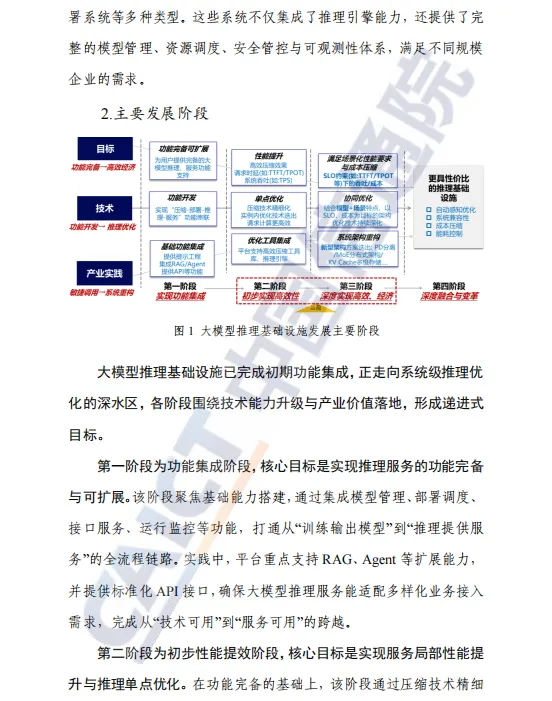

在应用实践方面,报告指出产业发展已从早期聚焦平台功能完备,演进到当前以单点优化(压缩工具、推理引擎)为基础,并快速迈向“模型-架构-场景”协同优化的新阶段。报告重点剖析了以KV Cache优化为核心的工业级方案(如Mooncake、Dynamo、UCM)和结合MoE模型特性的架构方案(如DeepSeek、MegaScale-Infer、Step-3),展现了从理论到落地的技术演进路径。

最后,报告通过金融、运营商、电力、司法检察、农畜等领域的多个具体案例,详细展示了上述关键技术如何在实际业务场景中解决“推不动”、“推得慢”、成本高等问题,并带来显著的性能提升与业务价值。

大模型推理优化正朝着协同化、智能化、场景化方向深度演进,未来将通过异构算力与解耦架构的精细化协同、自适应调度、以及多模态与长序列处理的突破,持续推动AI服务向“好用、省用”跨越,成为赋能千行百业数字化转型的核心引擎。

提示:实际操作时一定要详读原文。

关注源迈AI微信公众号

后台回复“资料”获取报告全文

https://t.zsxq.com/4ZaGP

适合人群:对AI人工智能感兴趣的读者!

星球简介:公众号源迈AI同步资源社群,帮助更多人快速迈入AI学习之门,提供大模型最新资讯、AI技术分享干货、业界典型实践案例,助你全面领跑同行,养成AI思维,跟上时代的超级个体。目前已有几百份文件。未来持续更新。

星球起步价198元,每满200人涨价一次,实际价值不会低于799元,一顿饭价格,早入就是有优势!

▲ 文章来源 :中国信通院

转载请注明来源。

▼ 本文仅代表作者本人观点

除标明来源外,图片、字体来源自网络

如有侵权请联系删除,谢谢

★ 欢 迎 分 享 到 朋 友 圈 哦 ★

?点赞、在看、分享,麻烦给个3连击哦!?