AI科普馆部分垂类内容转移至?

【长三角人工智能联盟】公众号,快点进去瞧瞧!

大模型已全面进入规模化落地新阶段,产业发展重心由模型训练转向推理服务,正式开启推理主导时代。在多模态普及、长上下文需求激增、Agentic AI快速爆发的共同驱动下,推理需求持续高速增长,成本与性能的平衡成为行业核心命题。仅靠硬件升级已无法满足高效、经济、稳定、绿色的规模化应用要求,推理优化正从单点技术改进,加速走向全链路系统级协同优化,并向各行业深度渗透、赋能产业升级。

为清晰梳理技术演进方向、总结产业实践经验、为行业提供技术指引与可落地解决方案,中国信息通信研究院人工智能研究所联合中国人工智能产业发展联盟正式发布《大模型推理优化关键技术及应用实践研究报告(2026年)》。

报告以《大模型推理平台技术能力成熟度》《MoE开发平台技术要求》等系列标准为参考,系统梳理大模型推理面临的核心挑战、关键优化技术、产业落地成果、典型行业应用案例及未来发展趋势,助力行业实现精准、高效、经济、绿色的推理规模化应用,推动大模型产业从技术创新迈向高质量普惠发展新阶段。

报告核心观点

1. 大模型迎来推理拐点,成本压力倒逼推理优化。需求侧,推理服务需求呈指数级增长:我国日均Token调用量两年增长超1400倍,2026年初突破140万亿;受Agentic AI等应用驱动,推理计算量两年增长达1万倍;服务平均序列长度两年提升至2.7倍。供给侧,算力资源持续向推理倾斜:全球计算负载中推理占比快速提升,2026年我国推理算力市场规模将翻倍至876.5亿元。成本侧,企业落地负担加重,降本趋势明确:2024年OpenAI推理预算为GPT-4训练预算的15倍,持续攀升的算力与存储成本,推动行业加快构建全链路优化体系;Gartner预测,2030年大模型推理成本较2025年将下降90%以上。

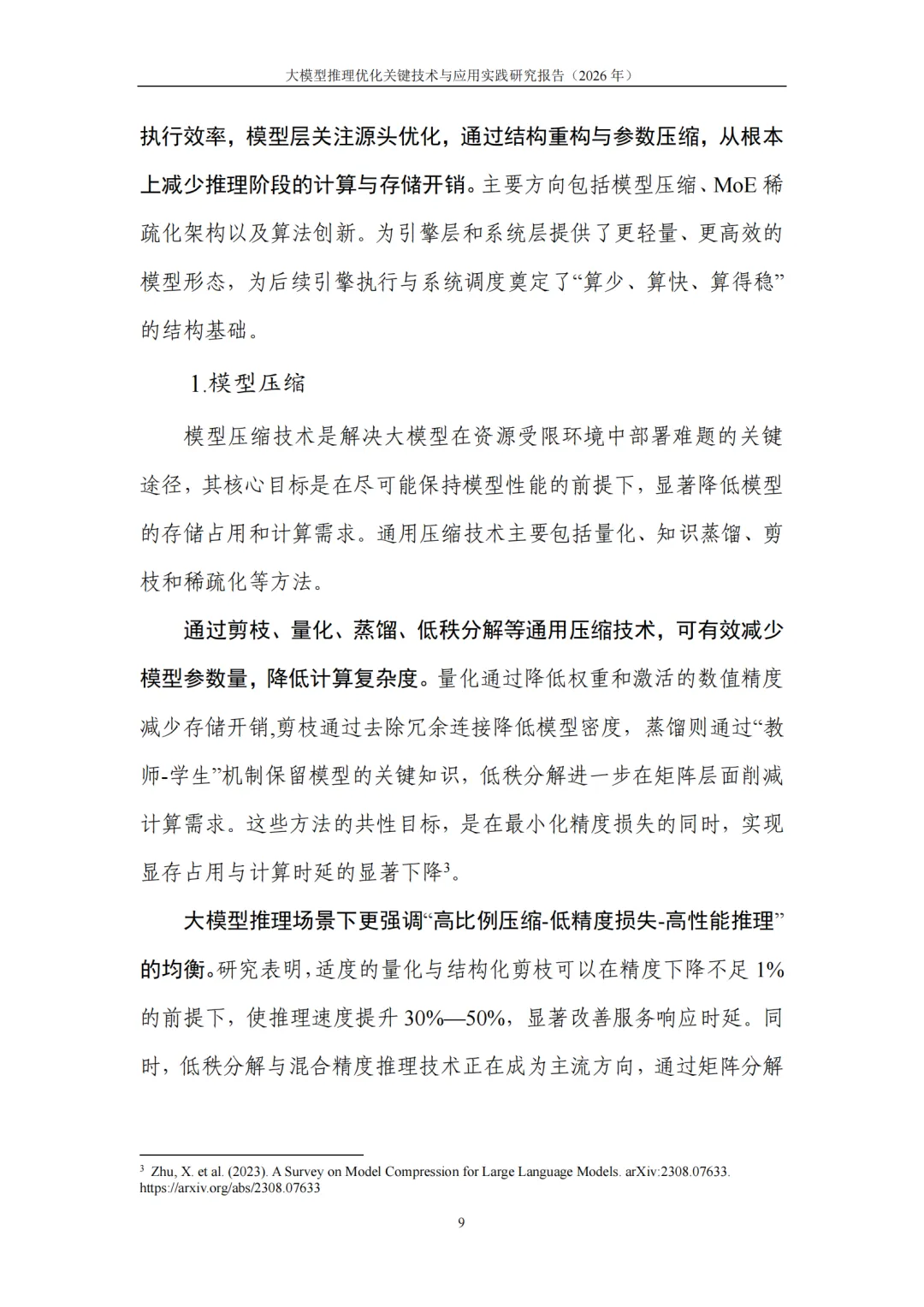

2. 模型、场景适配与算力成本平衡成三大核心难题。一是模型演进适配不足,大模型向MoE架构、原生多模态、百万级长上下文快速升级,对推理基础设施的前瞻性、灵活性提出更高要求;二是场景差异化适配难度大,低时延场景要求毫秒级TTFT、高并发场景追求高吞吐、长上下文场景受KV Cache显存占用限制,流量波动考验系统弹性,静态推理系统难以适配多元需求;三是算力需求与成本控制矛盾突出,存量算力软硬件兼容不足难以复用,异构算力调度面临多重困境,长记忆需求推高存储成本,DRAM/SSD/HDD价格指数大幅上涨,进一步加剧成本压力。

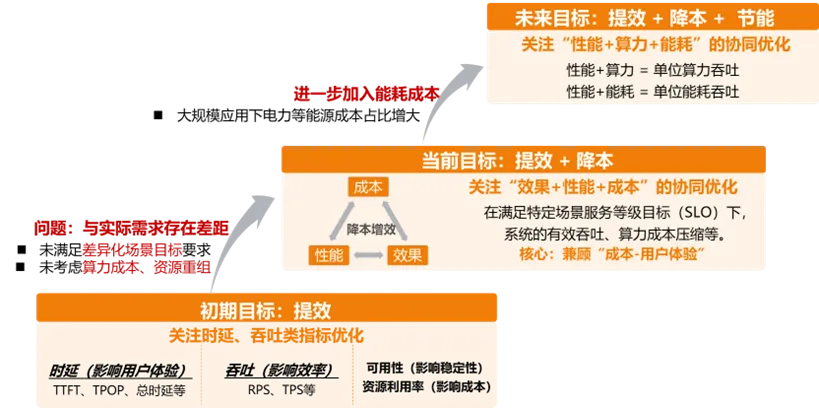

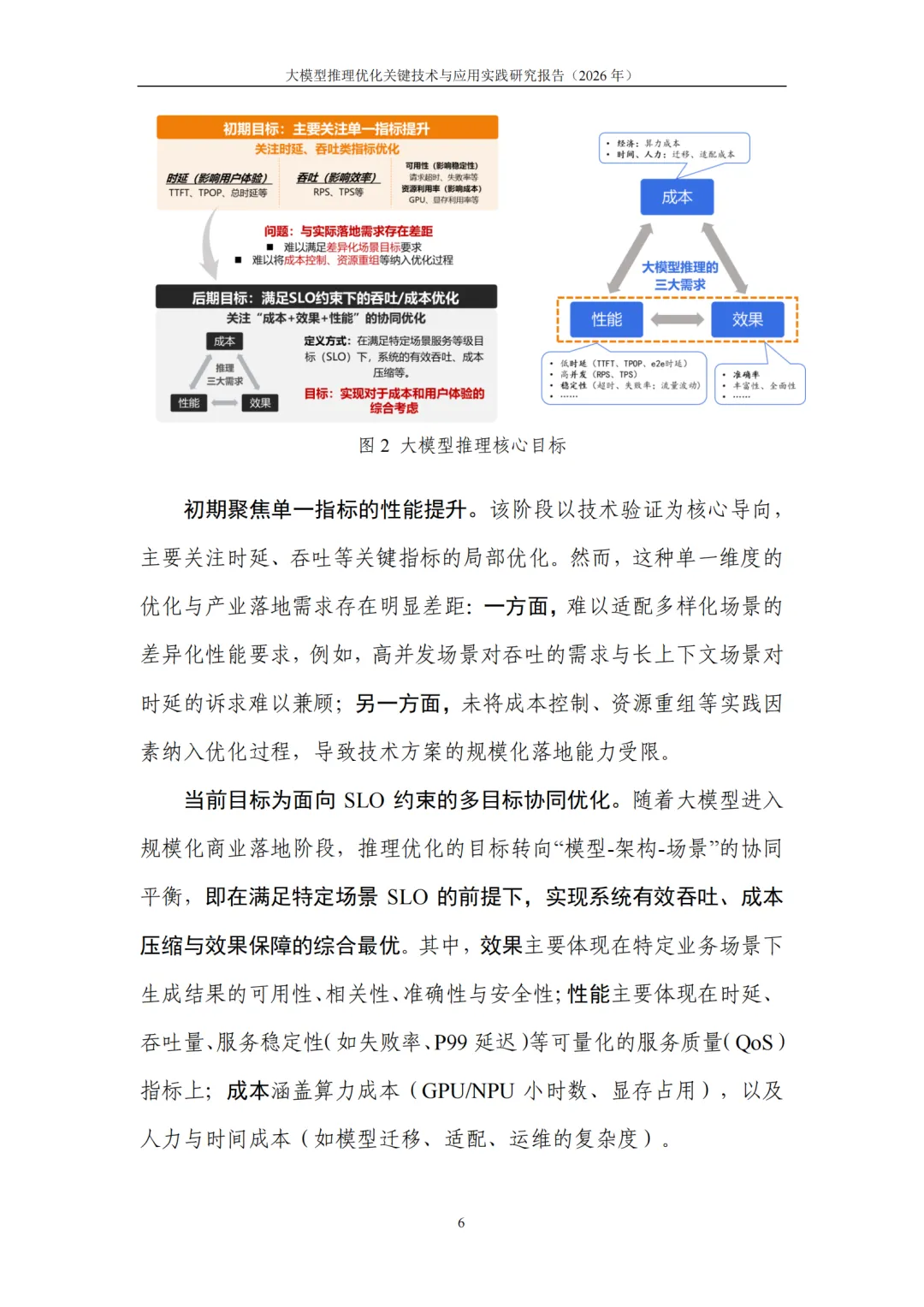

3. 推理优化目标从性能提升到降本增效走向绿色高效。初期推理优化聚焦时延(TTFT/TPOT)、吞吐(TPS/RPS)等单一性能指标,既难以适配场景差异,也未考虑算力、存储成本,与规模化落地需求脱节。当前大模型进入商业落地阶段,优化目标升级为精度 - 性能 - 成本协同,即在满足服务等级目标(SLO)约束下,平衡用户体验与算力成本,更符合企业级落地需求。未来将进一步纳入能耗指标,聚焦性能+算力成本+能耗成本协同,以单位算力吞吐、单位能耗吞吐为核心指标,推动推理服务向精准、高效、经济、绿色方向升级,支撑大模型产业可持续规模化落地。

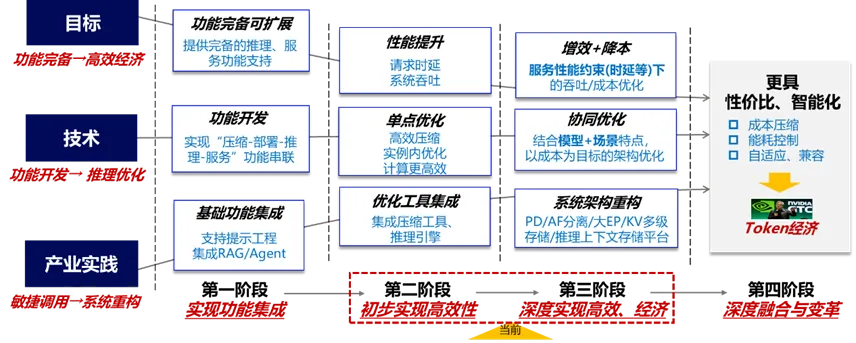

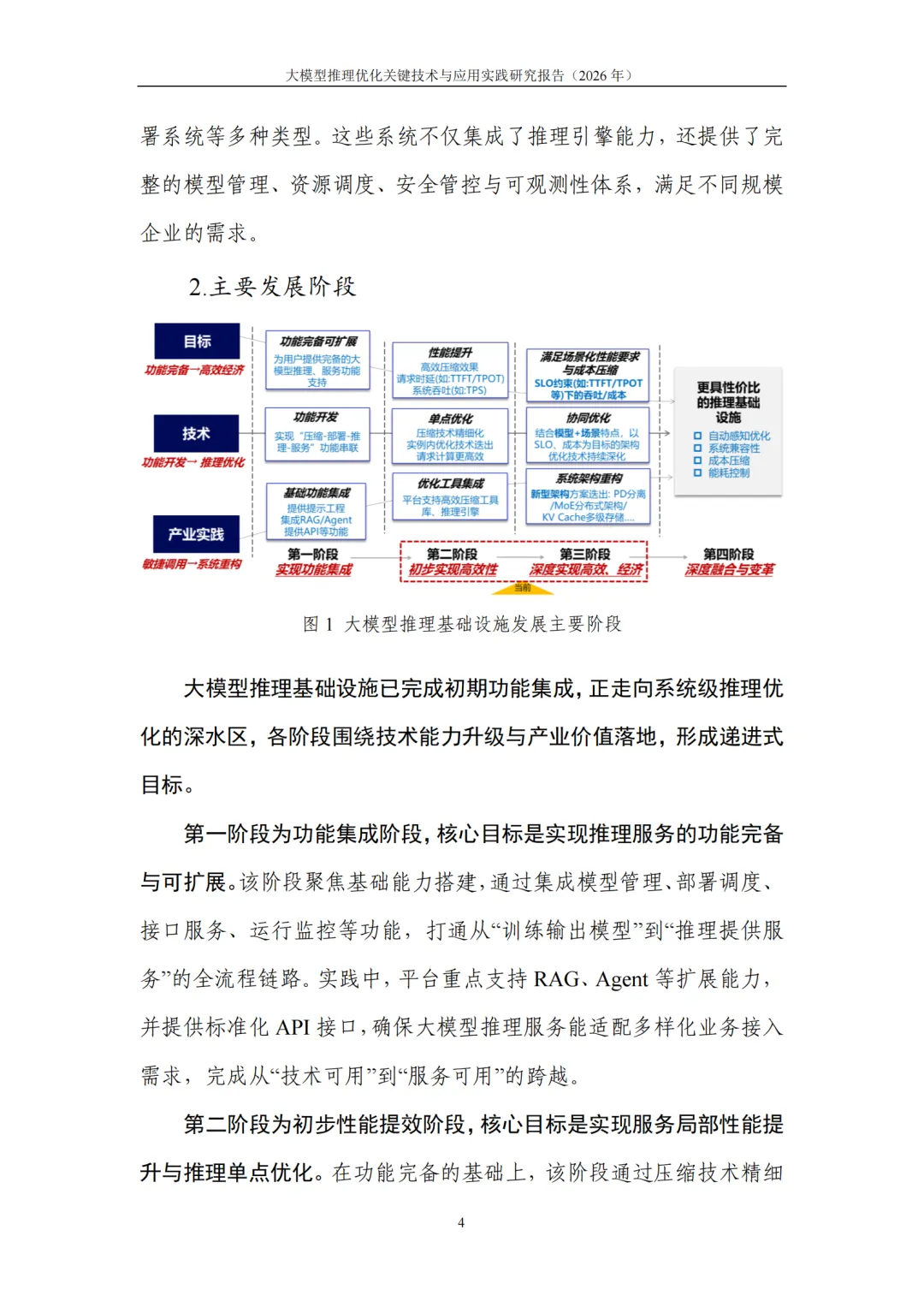

4. 推理工程从单点优化迈向系统级协同优化。第一阶段为功能集成,完成压缩-部署-推理-服务流程贯通,搭建RAG、Agent等基础能力;第二阶段为单点优化,以模型压缩、推理引擎为核心,开展显存、计算、并行加速等优化;第三阶段为系统级协同优化,围绕 “模型-架构-场景” 深度整合,实现高性能与经济化落地;未来将进入Token经济时代,进一步压缩成本、控制能耗,支撑大模型产业普惠化发展。

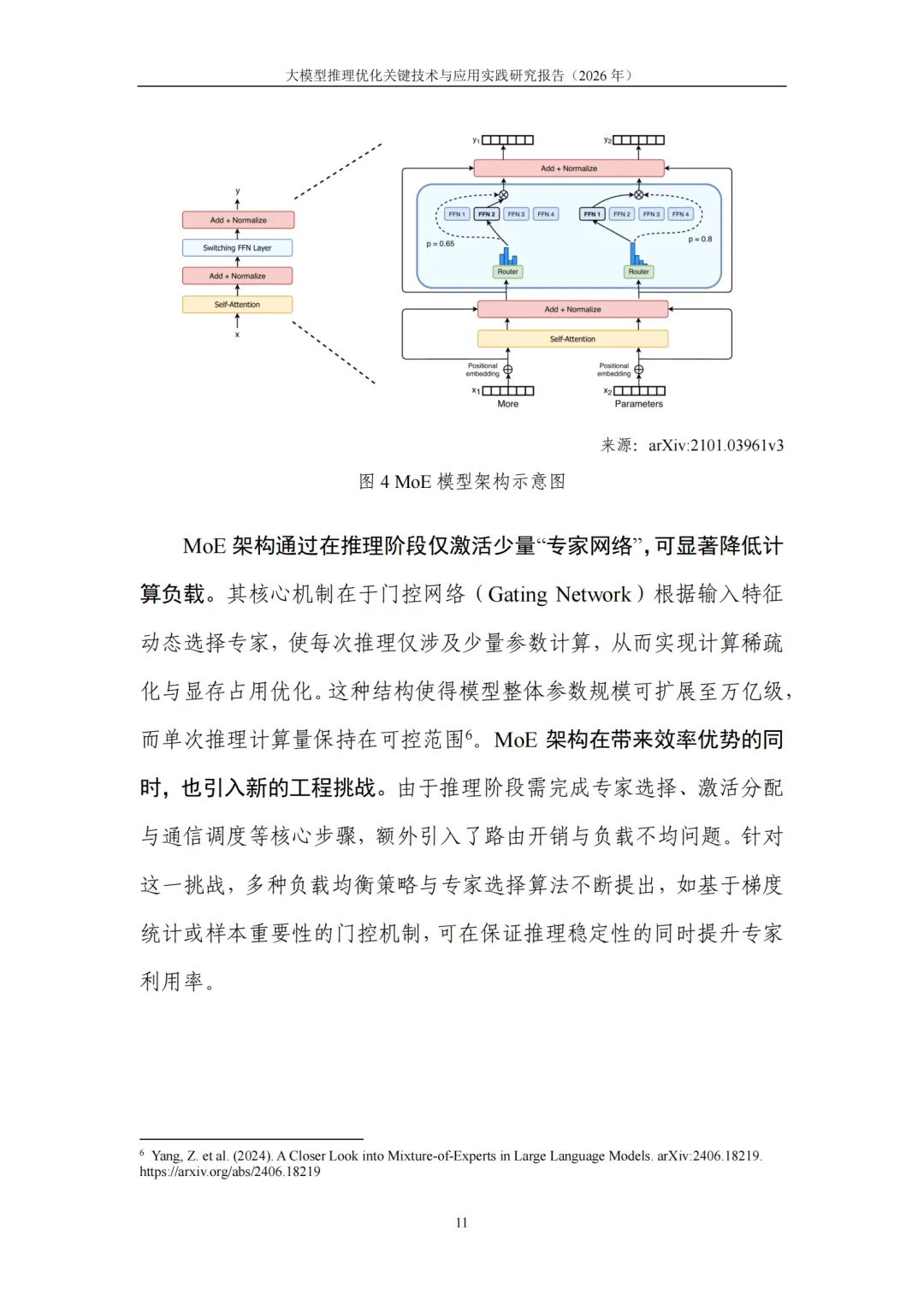

5. PD分离与MoE相关系统优化(大EP、AF分离)成为热点。一方面,PD分离架构以KV Cache为核心,2024年完成技术迭代,2025年进入产业落地,Mooncake、Dynamo、UCM等方案通过以存换算、分级存储、分布式内存池等技术,实现更快响应、更大吞吐、更长文本处理与SLO自适应。另一方面,MoE模型成为主流后,头部企业在PD分离基础上深化MoE优化:一是MoE大集群成为重点布局,DeepSeek推理系统为典型,跨节点 EP、PD+EP热度持续提升;二是AF分离快速兴起,MegaScale-Infer、Step-3等通过AF分离+定制通信库,实现专家负载均衡与智能路由优化。技术整体沿 “PD分离—MoE 优化进阶” 方向演进。

6. AI存储驱动推理系统实现原生智能升级。当前已实现基于分层缓存、数据卸载的外置存储推理加速方案,有效突破显存资源和记忆数据瓶颈,显著降低推理时延、提升吞吐效率、优化算力成本,成为大模型规模化部署的标配支撑能力。未来正走向面向智能体(Agentic AI)的原生架构升级,由数据存储向知识存储、记忆存储演进,一是将碎片化资源转化为细粒度知识,结合多维检索与重排序技术,提升知识生成和检索能力,二是提供精准的记忆萃取与召回能力,实现上下文状态的长期保持,优化大模型“易遗忘”的通病。通过AI存储的持续创新将构建统一记忆管理、多模态检索、多智能体协同的新型支撑体系。

以下是内容节选↓↓↓ 文末点击链接免费下载pdf,扫二维码加入交流群

以下是内容节选↓↓↓ 文末点击链接免费下载pdf,扫二维码加入交流群

AI科普馆:打开AI世界之窗