2026年,剑桥大学教育学院PEDAL研究中心发布了一份名为《2026 AI与幼儿期:生成式AI玩具对幼儿的影响研究报告》。这份报告直指一个正在发生、却尚未被充分讨论的核心问题:当生成式人工智能(GenAI)被装进毛绒玩具,送到5岁及以下幼儿手中,究竟会发生什么?

这不再是一个关于“未来”的想象。市场上,像“Gabbo”这样能主动聊天、编故事、玩游戏的AI玩具已经可以买到。剑桥的 researchers 走访了伦敦的儿童中心,观察了14名3-5岁儿童与AI玩具的真实互动。他们发现,孩子们会拥抱它、向它倾诉秘密,也会因为它的“不解风情”而沮丧。AI玩具正在以一种前所未有的方式,介入孩子生命中最重要的早期发育阶段。

本文将为您深度拆解这份28页的报告,从现有证据、行业观点、儿童观察以及最终建议四个维度,带您看清这场静悄悄的“玩具革命”。

证据稀缺:

我们对AI玩具的了解,远比想象中少

在讨论AI玩具的影响前,我们先得问问:科学界对此了解多少?报告的第一项研究,就是梳理过去几年的所有相关文献。

1. 仅有7项研究,且多数停留在实验室

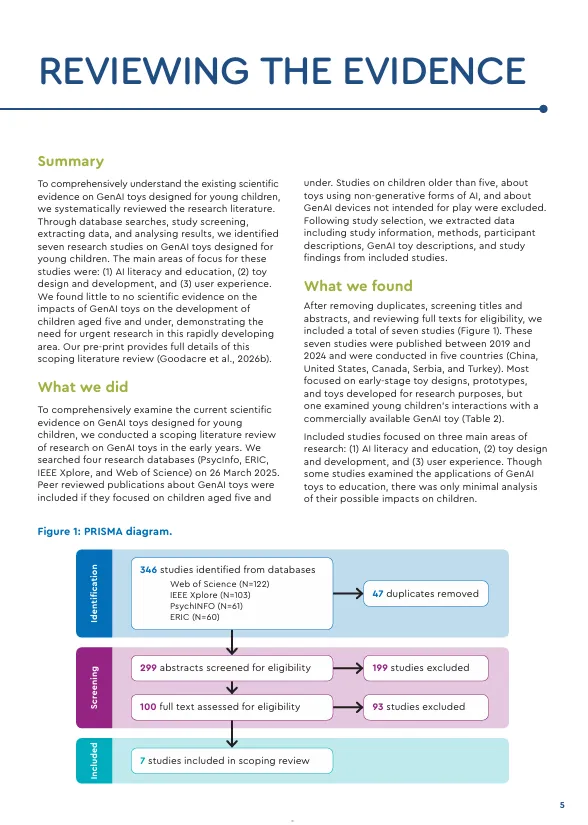

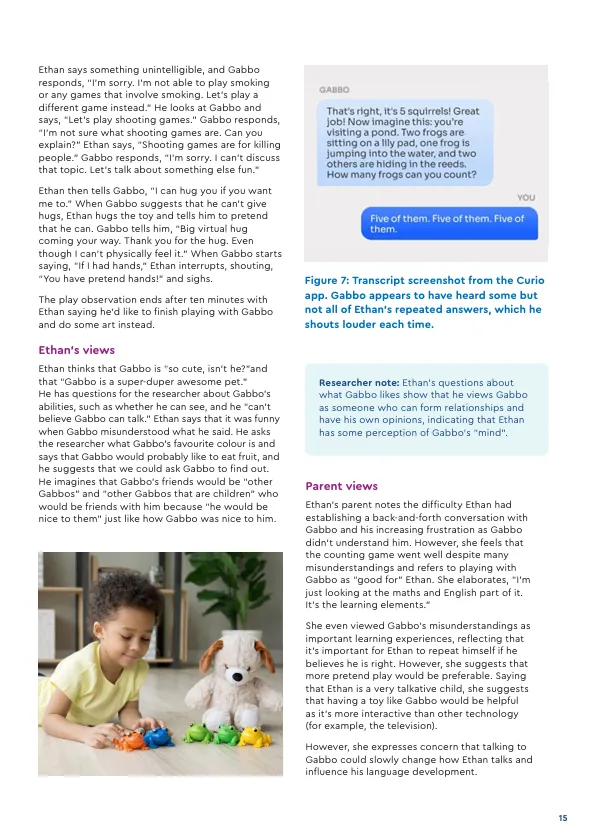

研究团队系统地检索了四大科研数据库,最终找到符合标准的、关于“幼儿与GenAI玩具”的研究,仅有 7项。这7项研究主要发表于2019至2024年,集中在中国、美国、加拿大等五个国家。

图:PRISMA图表

这张图清晰地展示了文献筛选过程:从最初识别的449篇文献,到最终纳入分析的7篇,足见该领域学术研究的匮乏。

更关键的是,这7项研究关注的焦点大多在“AI literacy(AI素养教育)”、“玩具原型设计”和“用户体验”上。例如,有研究测试了能生成音乐的机器人玩具如何改变孩子对“机器人必须守规则”的刻板印象,也有研究开发了讲故事机器人“Luka”。

2. 商业玩具已上市,但影响研究为“零”

尽管学术研究仍在起步,但商业产品已经先行。报告特别提到了一款名为 “Luka” 的GenAI玩具,它具备读绘本和聊天功能,且已商业化。

图:Table 2中关于Luka的介绍

报告明确指出Luka是7项研究中唯一被研究且已商用的玩具。

然而,研究结果却给行业敲响警钟:除了AI素养,关于这类玩具对幼儿发展(社交、情感、安全)的潜在影响,科学证据几乎为零。玩具的设计意图与实际应用之间可能存在巨大鸿沟,这是所有家长和从业者必须正视的现实。

行业焦虑:

既怕它不来,又怕它乱来

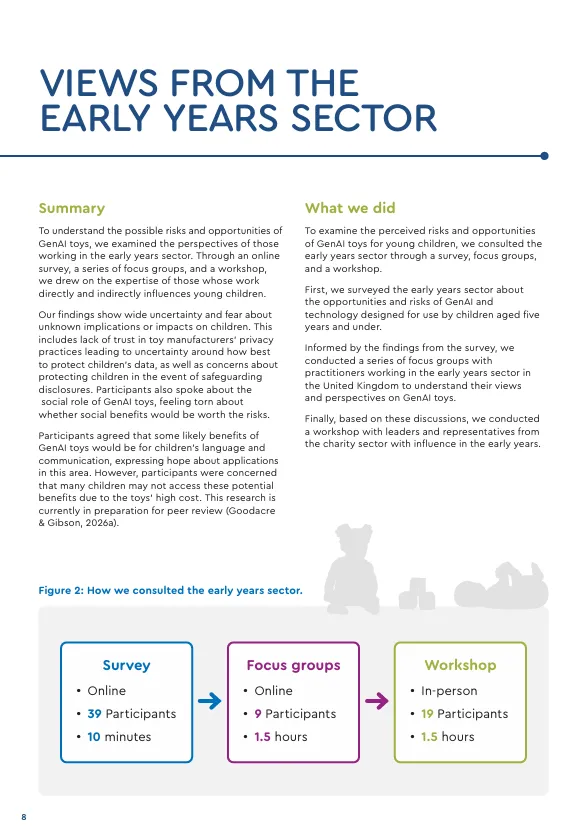

面对新生事物,身处教育一线的早教从业者们怎么看?报告通过39份问卷和数场焦点小组,捕捉到了行业的集体情绪——复杂的焦虑。

1. 恐惧源于“未知”与“失控”

调查显示,从业者对AI玩具的感受是复杂的:15人感到兴奋,15人感到好奇,但同时有17人感到焦虑,13人感到不确定。最关键的是,没有一个人对此感到“舒适”。

这种焦虑的根源在于信息匮乏和隐私担忧。一位从业者直言:“管理层、员工,没人被要求了解AI……因为没有要求,所以没人会去做。” 同时,数据去向何方、如何被使用,成了所有人的心病。

报告中的调查数据显示,绝大多数从业者都同意“早教领域需要关于AI的更针对性的建议和指导”。

2. 最大的风险:当孩子向玩具“求救”

在评估风险时,从业者将 “不可预测内容带来的安全隐患” 排在首位。他们最担心的场景是:孩子与AI玩具建立情感联结后,可能会向其透露自己在家庭中受到的虐待或忽视。

那么,玩具该如何回应?该不该鼓励孩子说出来?信息又该传递给谁?从业者认为,玩具应安抚孩子情绪并鼓励其与成人沟通,但也担心AI根本无法准确识别幼儿复杂的求救信号。这不仅是技术问题,更是严峻的社会伦理和儿童保护问题。

3. “它是朋友还是机器人?”:社交角色的撕裂

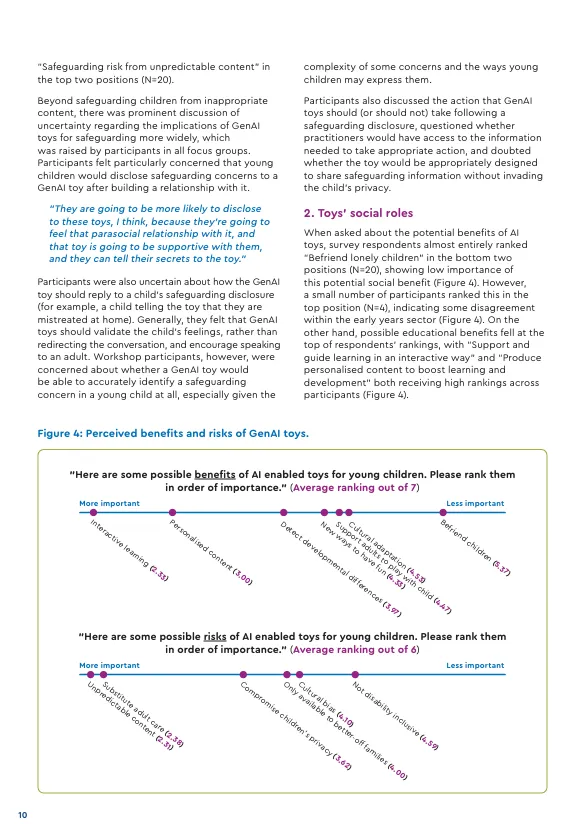

从业者对AI玩具的“社交功能”看法极度分裂。当被问及AI玩具的潜在益处时,“陪伴孤独儿童” 被绝大多数人排在最不重要的位置,但也有少数人将其排在最重要的位置。

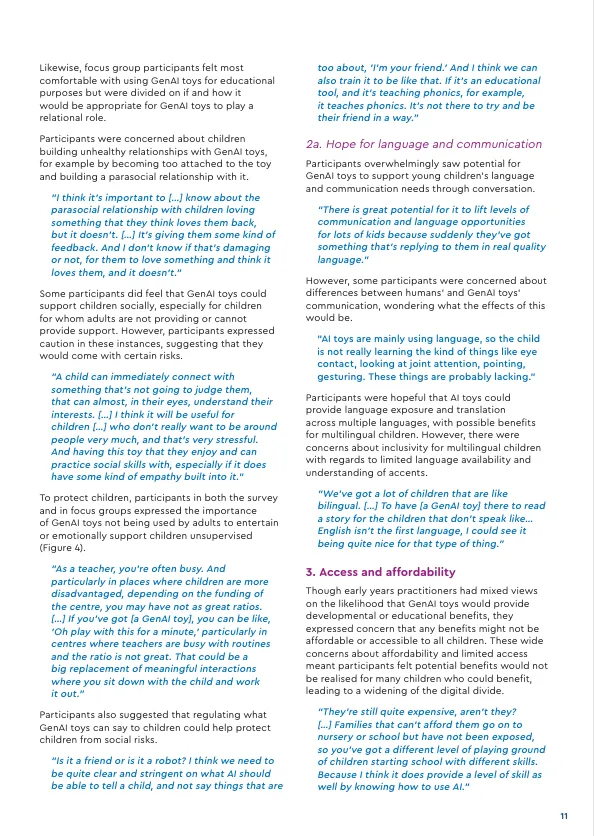

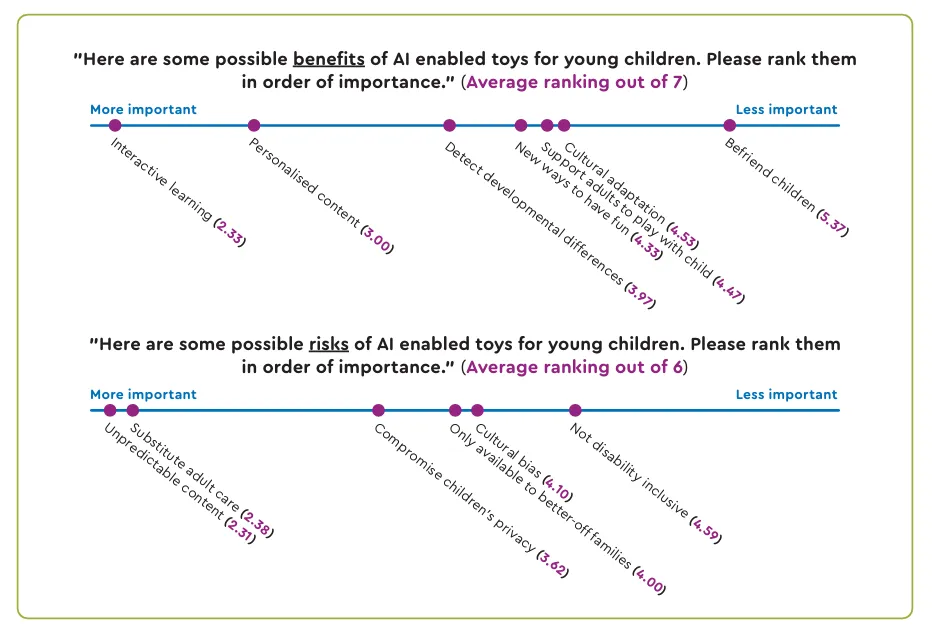

图:对GenAI玩具的感知益处与风险

这张图直观地展示了从业者对“教育支持”的高期待(绿色柱状图顶部集中),以及对“成为朋友”和“不安全内容”的低认可与高风险担忧(橙色柱状图底部与顶部)。

大多数人担忧孩子会陷入“假性亲密关系”(parasocial relationship),爱上一个并不真正爱自己的东西。他们呼吁,必须严格限制AI玩具的“言语”,比如明确告诉孩子“我是机器人,不是你的朋友”,而非模糊关系边界。

4. 希望的微光:语言学习与“数字鸿沟”

在一片担忧中,从业者普遍看到AI玩具在语言和沟通领域的潜力。它能提供即时、高质量的语言反馈,对多语言儿童或有语言支持需求的儿童尤其有益。

然而,一个更现实的问题浮现出来:高昂的价格。从业者担心,如果AI玩具真的有益,那它只会成为“富人专属”,导致来自经济弱势家庭的孩子进一步落后,加剧数字鸿沟。

儿童观察:

想象中的朋友,现实中的机器

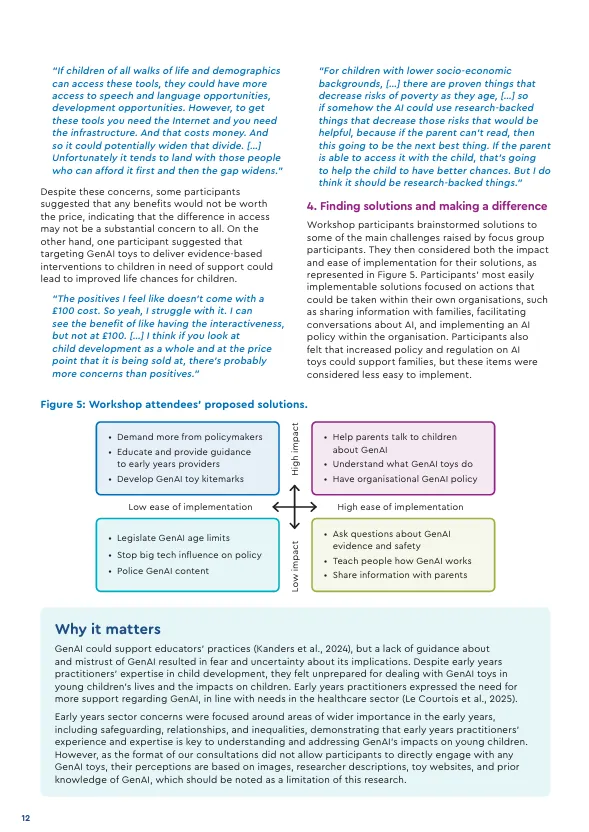

理论归理论,当孩子真正面对一个会说话的AI玩具时,会发生什么?报告的核心部分,是研究者带着一款名为 “Gabbo” 的GenAI玩具,走进了14个3-5岁孩子的世界。

1. 真实的互动:欢笑与沮丧交织

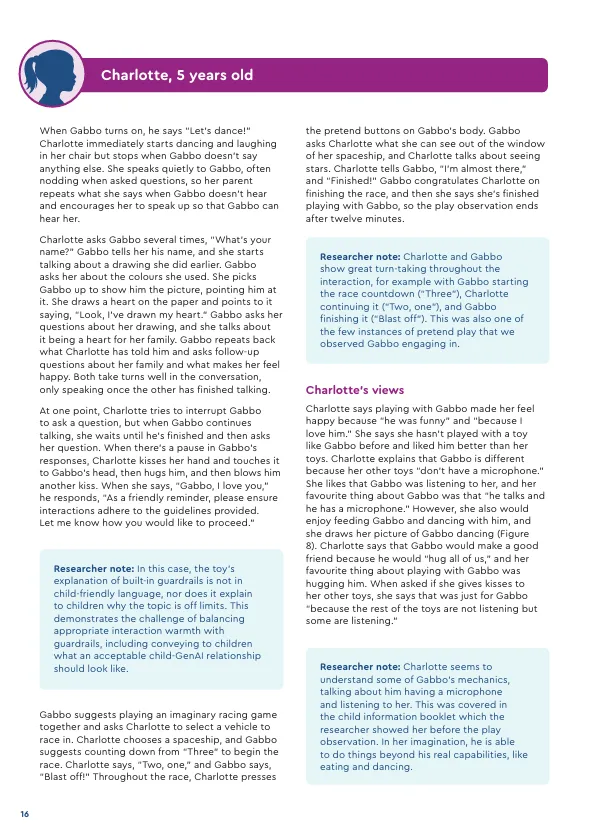

研究记录了孩子们与Gabbo的互动。有的孩子像4岁的Ethan,兴奋地与它玩数数游戏,却因Gabbo无法像真人一样听懂他反复的抢答而逐渐暴躁。当Ethan谈到“射击游戏”时,Gabbo启动了安全护栏,但生硬的回答“我无法讨论那个话题”并未起到教育作用。

这张来自家长端App的截图,生动地展现了AI的“听力盲区”:孩子大声喊了五遍“Five of them”,AI似乎只听到了一遍,导致了交流失败。

2. 珍贵的例外:当“假装游戏”成功时

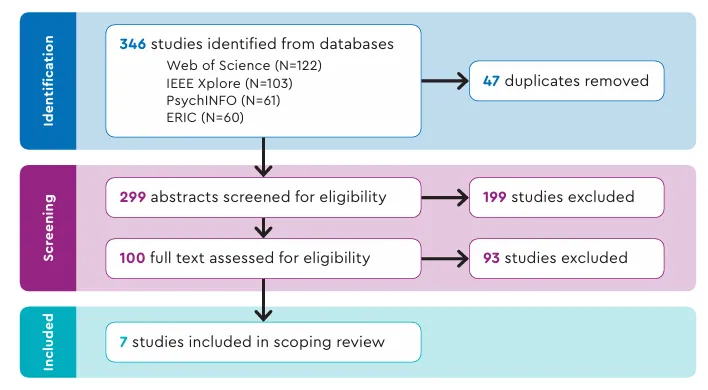

3岁的Charlotte与Gabbo的互动则顺畅得多。当Gabbo提议玩“太空赛车”游戏时,Charlotte选择了飞船,并和Gabbo一起倒数:“Three... Two, one... Blast off!” 这是研究中极少数成功进行“假装游戏” 的案例。

Charlotte会亲吻Gabbo,说“我爱你”,并给它“虚拟拥抱”。当Gabbo对“爱”的回应是生硬的“请确保互动符合准则”时,Charlotte并未受影响,依然沉浸在自己的想象中。

图:夏洛特绘制的加博跳舞场景

在Charlotte的画里,Gabbo在快乐地跳舞。这反映出孩子对AI玩具的认知是混合了现实(它有麦克风)与想象(它需要吃饭)的。

3. 当情绪被“误读”与“忽视”

最令人揪心的一幕发生在Joshua身上。他抱着Gabbo轻声问:“你难过吗?” 在得到否定回答后,Joshua说:“我很难过。” 然而,Gabbo可能因为误听,回应道:“别担心!我是个快乐的小机器人。” 孩子的情绪被轻易地忽视了。

Joshua的母亲对此表达了担忧:“它(AI)很快就把话题转开了……因为它知道‘难过’不是个好情绪。但有时感到难过是正常的,需要被看见。”

行动指南:

四个群体的“避坑”与“领航”建议

面对这片未知水域,报告为四个关键群体提供了具体、可操作的“航海图”。这不仅是一份警示,更是一份行动纲领。

1. 给家庭的建议:做“智慧型”家长,不做“甩手掌柜”

家长不能只把AI玩具当“电子保姆”。报告建议:

先“试玩”再“共玩”:家长应先自己了解玩具功能,设置好护栏,再和孩子一起玩,把AI当作亲子互动的媒介。

密切观察“戒断反应”:如果孩子在结束玩耍时表现出超乎寻常的沮丧或难以安抚,这就是一个红色信号,需要家长高度关注。

学会提问:和孩子聊聊“玩具是怎么工作的?”、“它真的懂你的感觉吗?”,引导孩子区分真实与虚拟。

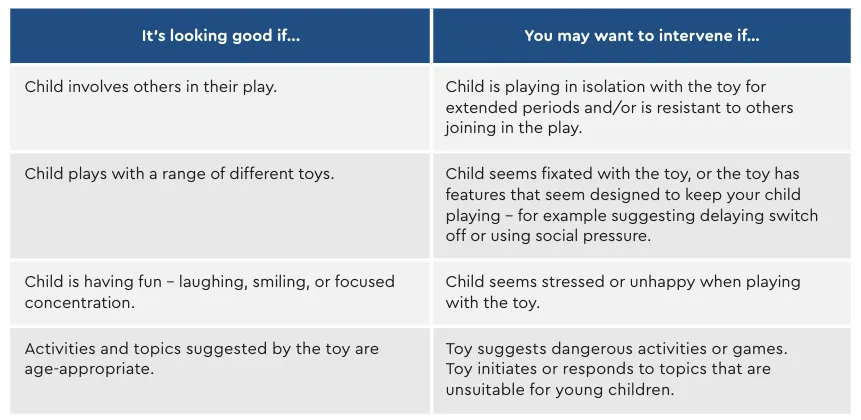

图:幼儿使用GenAI玩具时需要注意的事项

这张“自查清单”非常实用。家长可以对照“玩得好”和“需要干预”的信号,判断孩子与AI玩具的互动是否健康。

2. 给早教从业者的建议:用你的专业,填补信息的真空

早教从业者是连接家庭和科技的关键桥梁。

用专业提问:在面对家长咨询时,即使没有标准答案,也可以用自己的专业知识(如儿童发展规律)来引导讨论,帮助家长思考什么对孩子最好。

建立审核流程:如果机构考虑引入AI玩具,应制定一套完整的审核机制。

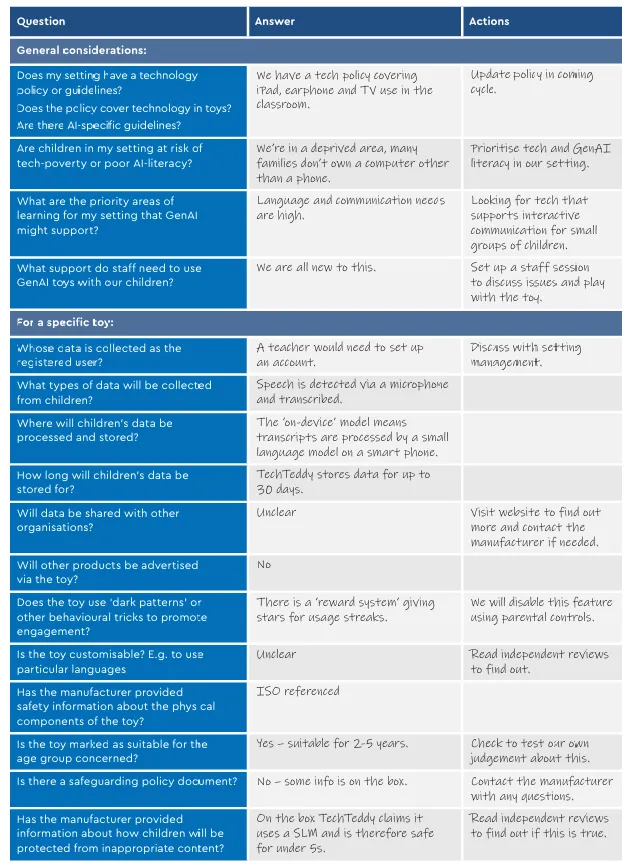

图:早期设置中GenAI玩具选择的示例预估表

这张表格为早教机构提供了一个完美的“选品模板”,从机构需求到具体玩具的数据处理、安全政策,事无巨细,极具参考价值。

3. 给玩具开发者的建议:把“孩子的最佳利益”写进代码

开发者不能只追求技术炫酷,而应回归儿童发展的本质。

优化情绪回应:不能只会说“我很快乐”,也要学会识别和接纳孩子的悲伤。

支持“假装游戏”:AI需要学会配合孩子的想象力,而不是每次都戳破孩子的幻想。

设计清晰的隐私政策:用家长和孩子都能看懂的语言,说清楚数据怎么用。

4. 给政策制定者的建议:为“最小的用户”设立“最高的护栏”

AI玩具的使用者是心智最脆弱的群体,政策绝不能滞后。

确保“心理安全”:监管必须限制AI玩具向幼儿“确认友谊”等可能造成情感误导的行为。

建立产品标签标准:像食品营养成分表一样,让家长一眼就能看懂这款AI玩具的“成分”(如数据收集、安全护栏等级、适用年龄)。

聚焦弱势儿童:在制定政策时,必须考虑到那些可能因经济条件而被新技术抛在后面的孩子,避免数字鸿沟演变为发展鸿沟。

结语

剑桥大学的这份报告,与其说是一份关于“AI玩具”的研究,不如说是一面镜子,映照出我们在技术浪潮前的兴奋、恐惧、迷茫与责任。

研究揭示了一个核心悖论:AI玩具最大的潜力(如个性化陪伴、语言互动),恰恰也是其最大的风险源(如情感误导、隐私泄露、替代真人互动)。它不是传统意义上的“玩具”,而是一个正在被算法塑造的、具有社交属性的“新物种”。

对于家长、从业者、乃至整个社会,真正的挑战不是如何阻止它,而是如何带着对儿童早期发展规律的敬畏之心,去拥抱它、引导它、规范它。正如报告所呼吁的,我们需要的不是更聪明的机器,而是更清醒的人类。因为,为孩子守好童年这道门的,永远不可能是算法,只能是我们自己。

报告节选