当虚假信息学会“逻辑自洽”,人类理性防线正在崩塌

你是否曾经被一张“突发新闻”图片震惊,随即转发给亲友?是否曾在短视频平台看到一段“现场实录”,内心产生强烈共鸣?如果答案是肯定的,那么你可能已经成为了AI谣言的“无意识传播者”。

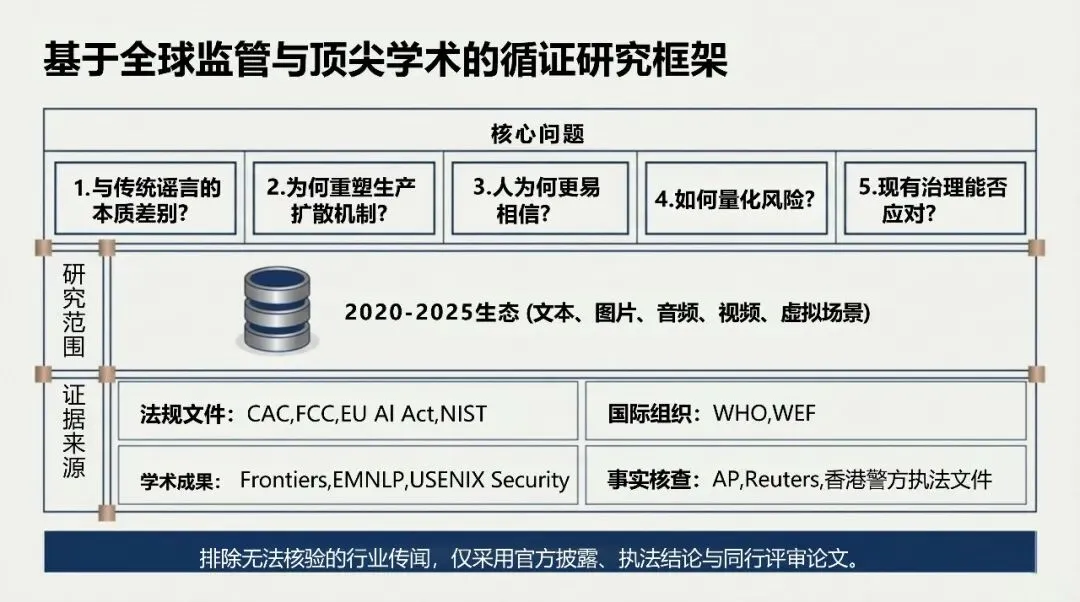

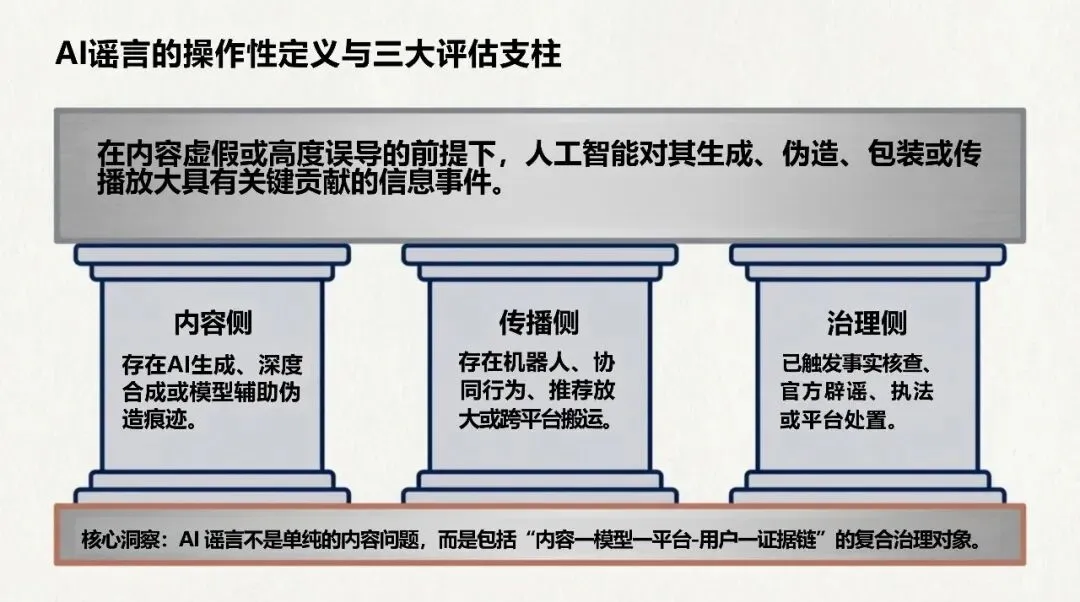

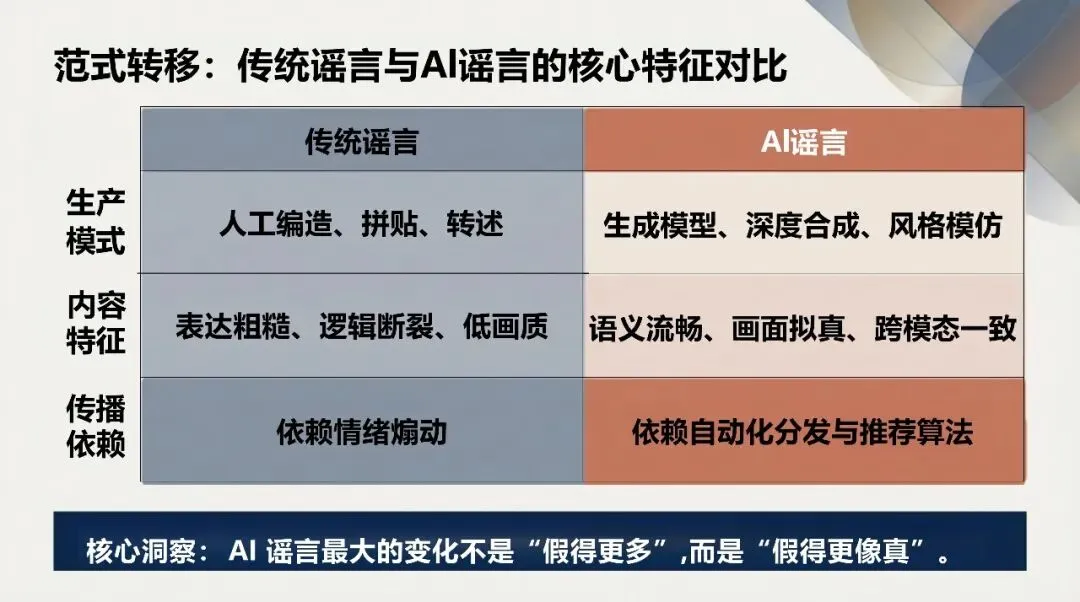

近日,清华大学新闻与传播学院发布《AI谣言深度研究报告》,揭示了生成式AI时代虚假信息的惊人演变:AI谣言最大的变化不是“假得更多”,而是“假得更像真”。这份报告由博士后张诗瑶与AI辅助完成,为我们敲响了警钟。

从“逻辑断裂”到“完美论证”:AI谣言的致命升级

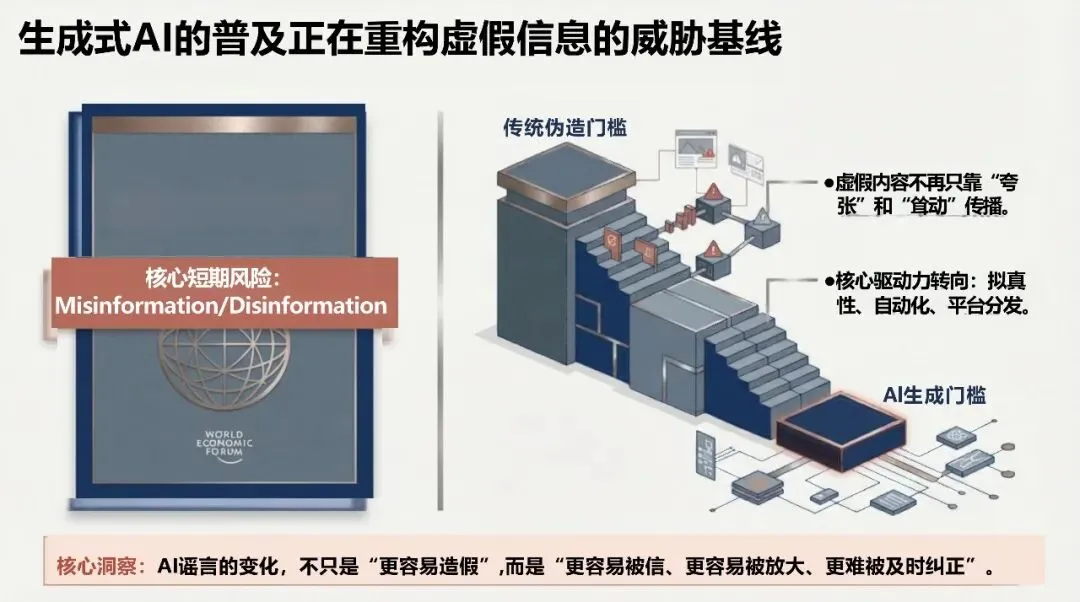

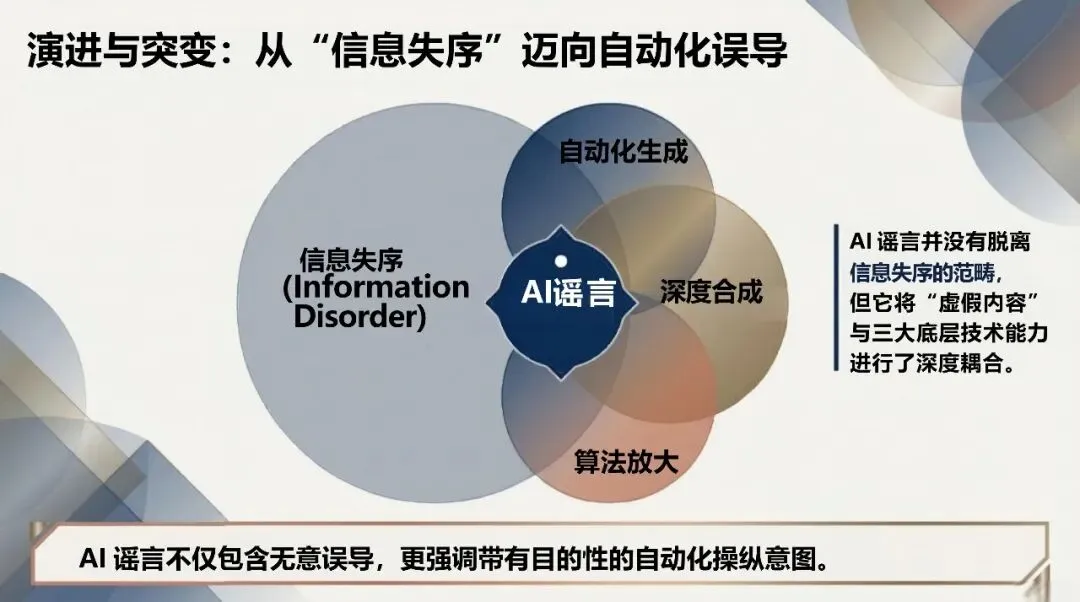

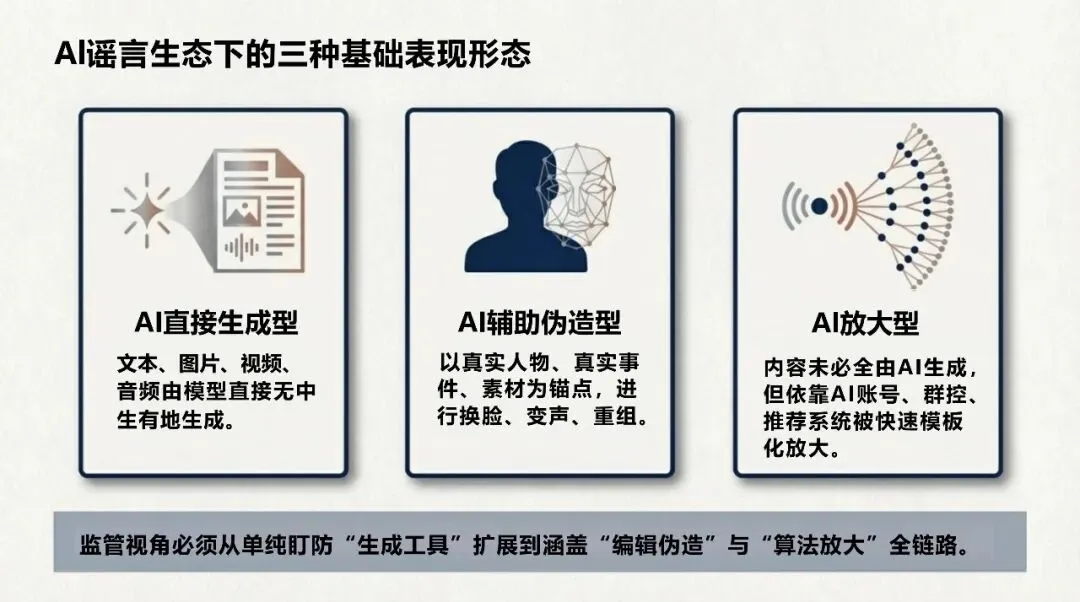

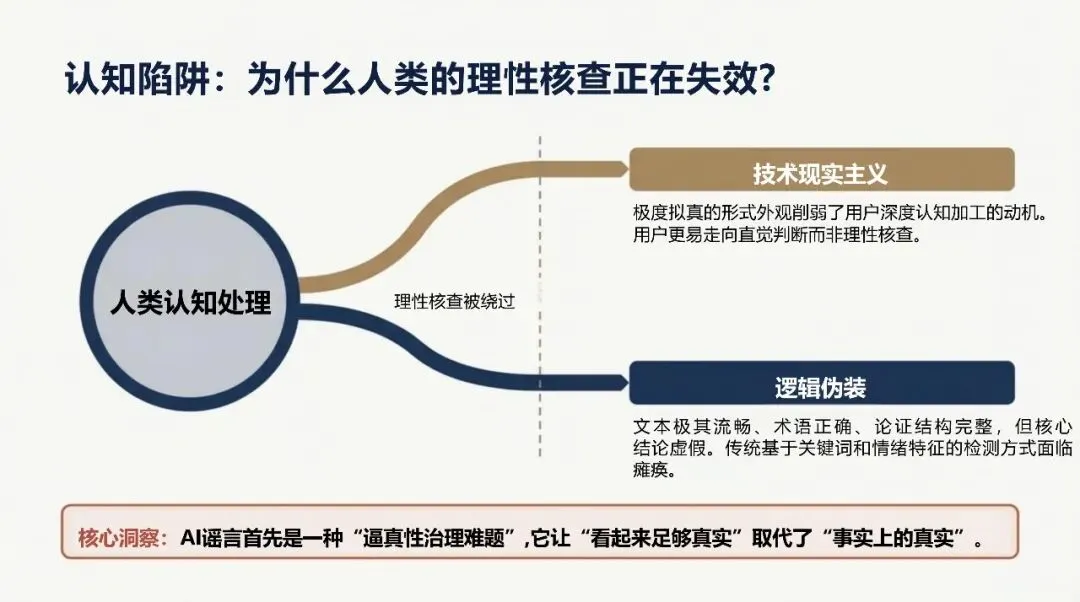

传统谣言往往存在明显的逻辑漏洞、粗糙的制作痕迹。而今天的AI谣言,却能实现文本极其流畅、术语正确、论证结构完整,只是核心结论是虚假的。这种“逻辑完美谣言”不再依赖夸张词汇,而是通过大模型的链式推理,构建出专业、严密的虚假论证。

报告指出一个令人警醒的核心洞察:AI谣言首先是一种“逼真性治理难题”,它让“看起来足够真实”取代了“事实上的真实”。

认知资源劫持:我们的大脑如何被“黑掉”

为什么在信息过载的社交媒体环境中,即使是理性的人也难以幸免?报告揭示了深层机制:

人类大脑处理信息存在“双轨制”——高阶理性系统和低阶直觉系统。当我们在信息洪流中快速浏览时,大脑高度依赖“启发式线索”快速判断可信度。而AI恰好完美模拟了这些“可信线索”,直接绕过了我们的理性防火墙。

恐惧、安全威胁等本能情绪被触发后,受众在未经高阶理性验证前,就已完成了转发与共享。这就是“认知资源劫持”的本质——AI不是单纯提供虚假信息,而是一套极其高效的注意力黑客系统。

说谎者红利:当造假反而成为“保护色”

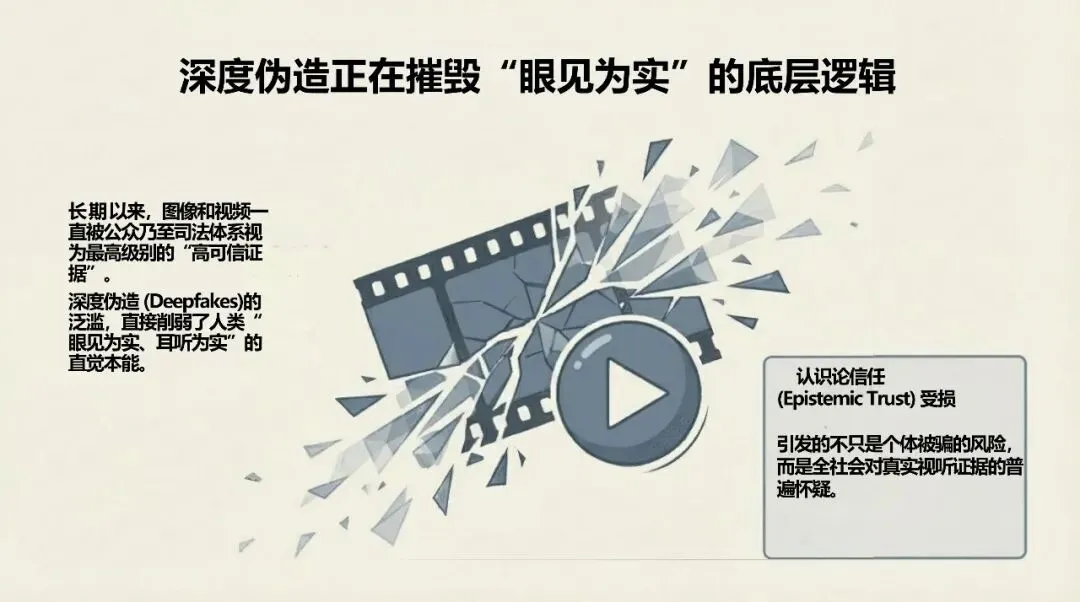

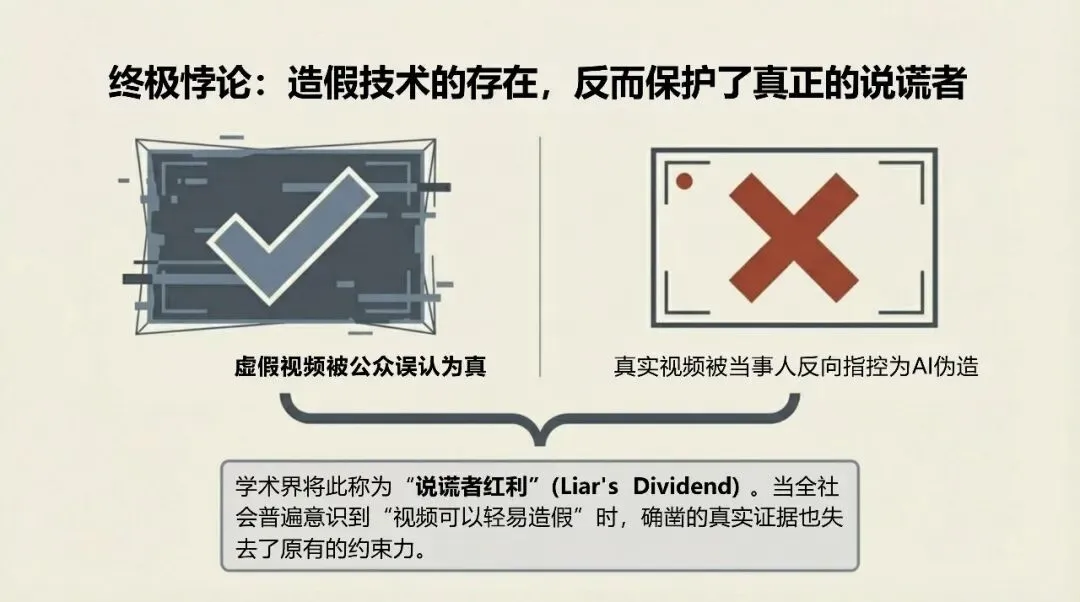

报告揭示了一个终极悖论:造假技术的存在,反而保护了真正的说谎者。

当社会普遍意识到“视频可以轻易造假”时,确凿的真实证据也失去了原有的约束力。一个真实视频可能被当事人反向指控为AI伪造,学术界将此称为“说谎者红利”。这意味着,我们赖以判断真相的“眼见为实”基础,正在被系统性动摇。

真实案例:从战争干预到金融动荡

报告梳理了近年来的典型案例,展示了AI谣言造成的真实世界伤害:

2022年:伪造泽连斯基呼吁投降的视频,虽制作粗糙,仍在战争环境中制造了短时混乱

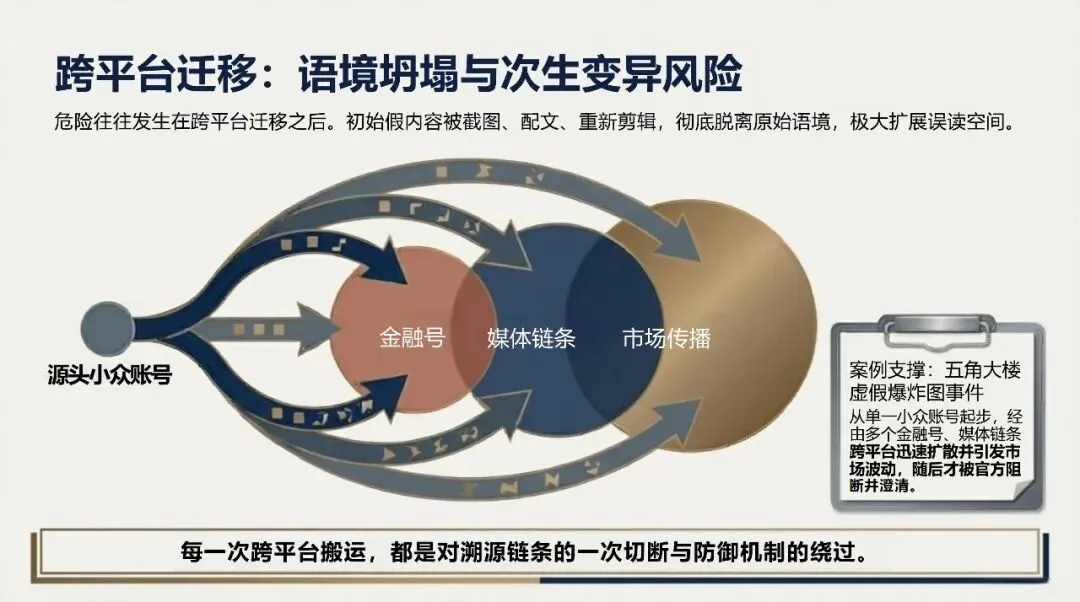

2023年:五角大楼“爆炸假图”引发金融市场短暂紧张

2024年:AI语音克隆冒充拜登,直接干预美国选举

2024年:香港深度伪造视频会议诈骗,造成超3.6亿港元损失

这些案例共同证实:AI谣言最危险的地方,不在于它能“持续欺骗很久”,而在于它能在很短的时间内造成真实的后果。

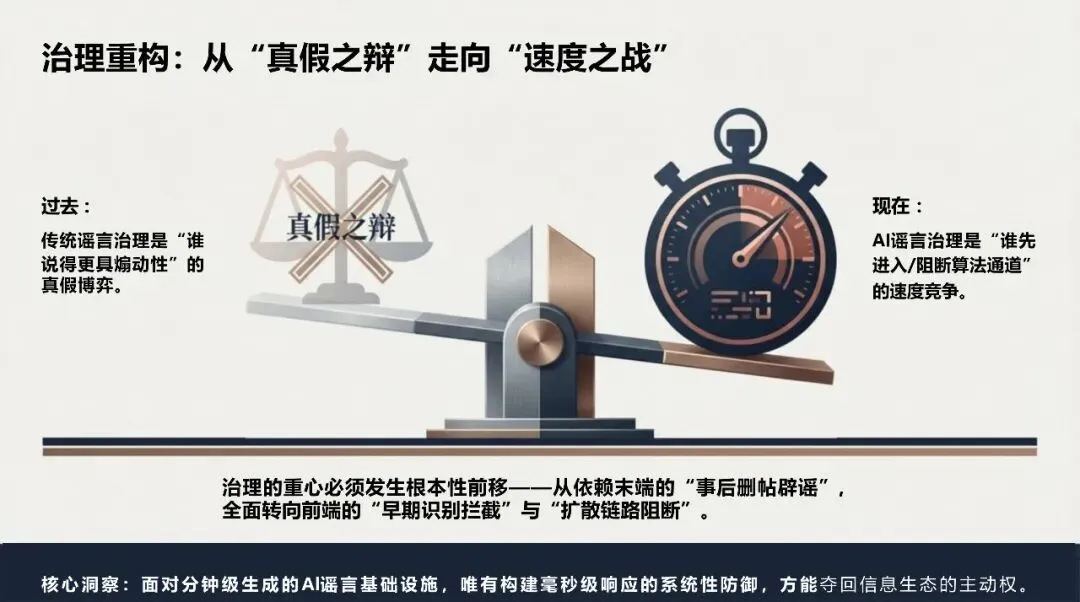

治理重构:从“真假之辩”到“速度之战”

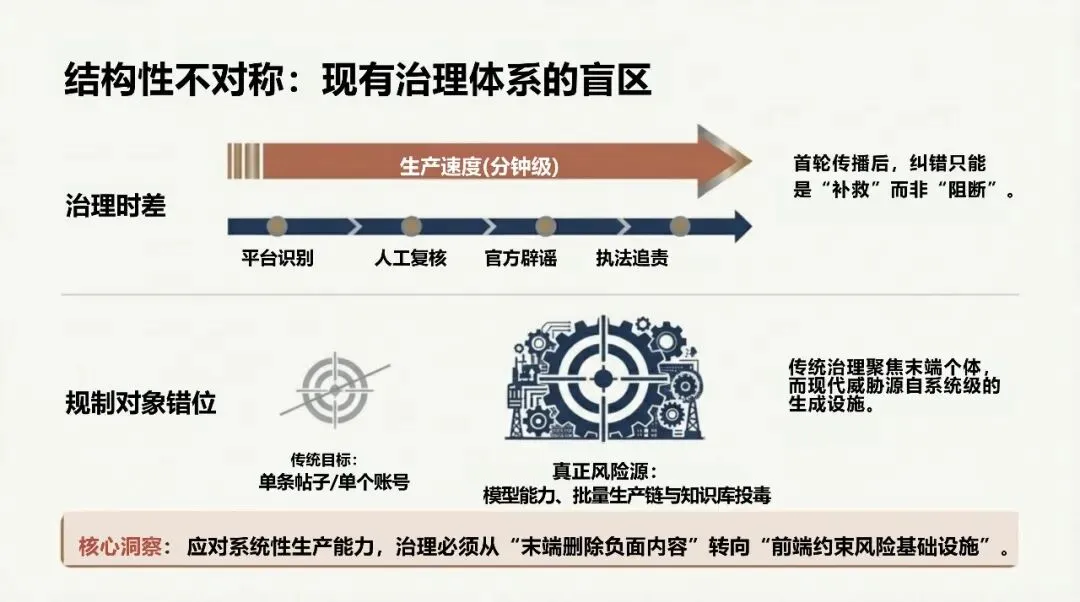

面对分钟级生成的AI谣言基础设施,传统“事后删帖辟谣”已无力应对。报告提出治理重心必须前移——构建毫秒级响应的系统性防御,从早期识别拦截与扩散链路阻断入手。

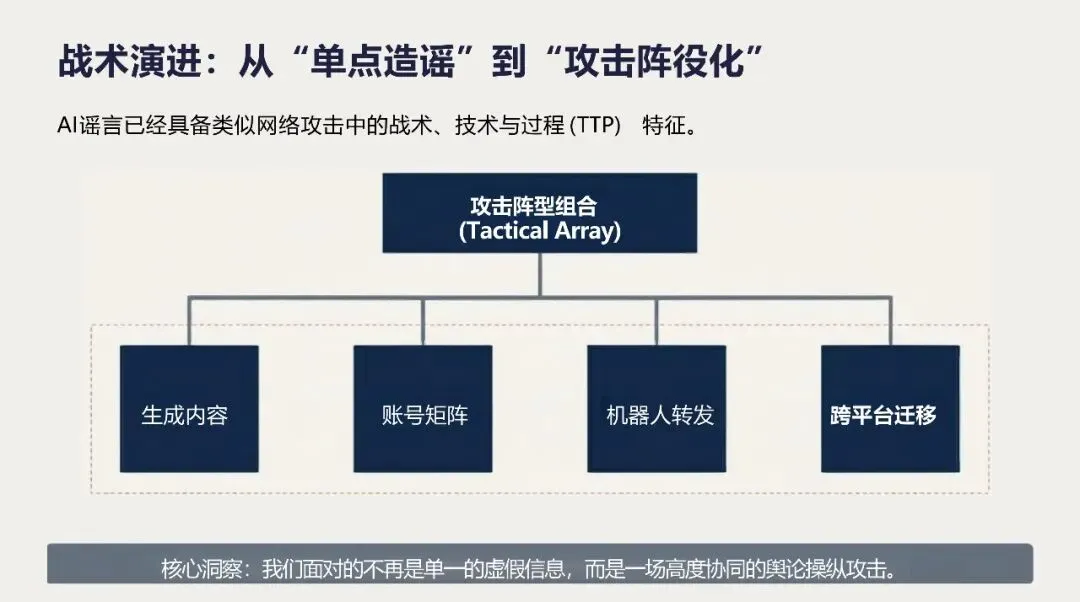

在技术层面,单一“神奇检测器”已全面失效。未来最可行的路径是构建“多路证据交叉”的复杂验证网络,引入“认知-交互-行为”三层检测思路,将孤立内容放入动态传播生态中审视。

写在最后:打败机器的不仅是更强的机器

在生成式AI时代,技术博弈将呈现长期化与链条化。报告强调,打败机器的不仅是更强的机器,还有被重新唤醒的人类理性。

当我们享受AI带来的便利时,也需要保持警惕——面对那些“逻辑完美”却可能虚假的信息,不妨按下暂停键,让高阶理性有时间介入判断。因为,在认知资源劫持的战场,我们每个人,都是最后的防线。

更多清华信息,点击 ↓ 链接

清华大学2025人工智能治理年度报告迈向可衡量的AI治理19页.pdf

清华大学2025年AIGC发展研究报告4.0版152 页.pdf

清华大学&华为:AI终端白皮书-AI与人协作、服务于人.pdf