жҠҖжңҜеҸҢеҲғеү‘дёӢпјҢжҲ‘们еҰӮдҪ•еә”еҜ№вҖңд»ҘеҒҮд№ұзңҹвҖқзҡ„дҝЎжҒҜж—¶д»Јпјҹ

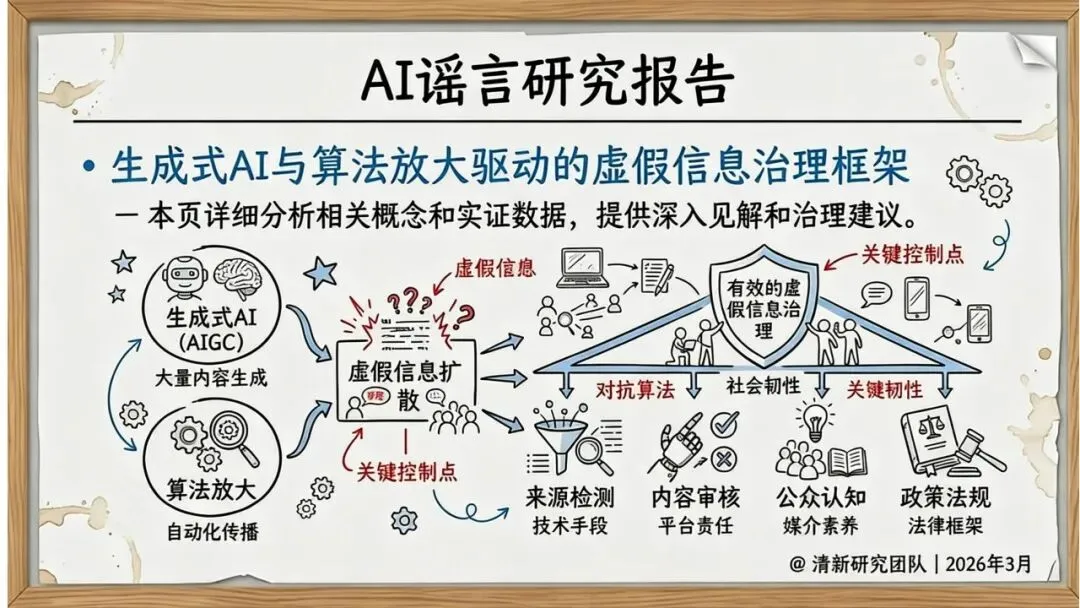

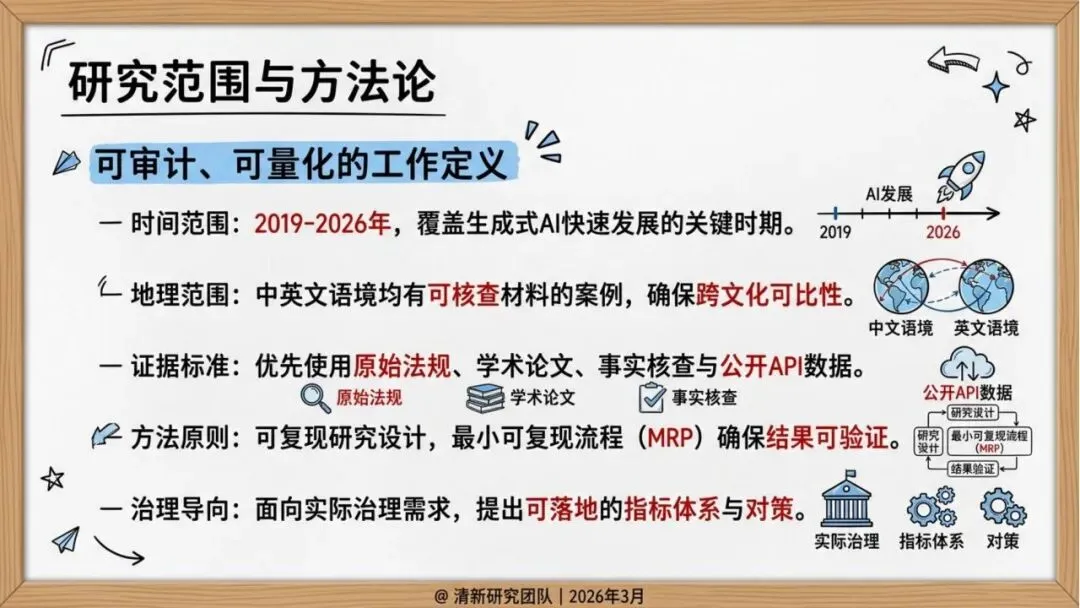

иҝ‘ж—ҘпјҢжё…еҚҺеӨ§еӯҰж–°й—»еӯҰйҷў/дәәе·ҘжҷәиғҪеӯҰйҷўеҸҢиҒҳж•ҷжҺҲжІҲйҳійўҶеҜјзҡ„жё…ж–°з ”з©¶еӣўйҳҹеҸ‘еёғдәҶгҖҠз”ҹжҲҗејҸAIдёҺз®—жі•ж”ҫеӨ§й©ұеҠЁзҡ„иҷҡеҒҮдҝЎжҒҜжІ»зҗҶжЎҶжһ¶гҖӢз ”з©¶жҠҘе‘ҠгҖӮиҝҷд»ҪиҰҶзӣ–2019-2026е№ҙзҡ„з ”з©¶жҠҘе‘ҠпјҢдёәжҲ‘们жҸӯзӨәдәҶAIи°ЈиЁҖз”ҹжҲҗдёҺдј ж’ӯзҡ„е…ЁиІҢпјҢ并жҸҗеҮәдәҶдёҖеҘ—еҸҜж“ҚдҪңзҡ„жІ»зҗҶжЎҶжһ¶гҖӮ

AIи°ЈиЁҖпјҡжҲҗжң¬дёӢйҷҚпјҢйҖјзңҹеәҰйЈҷеҚҮ

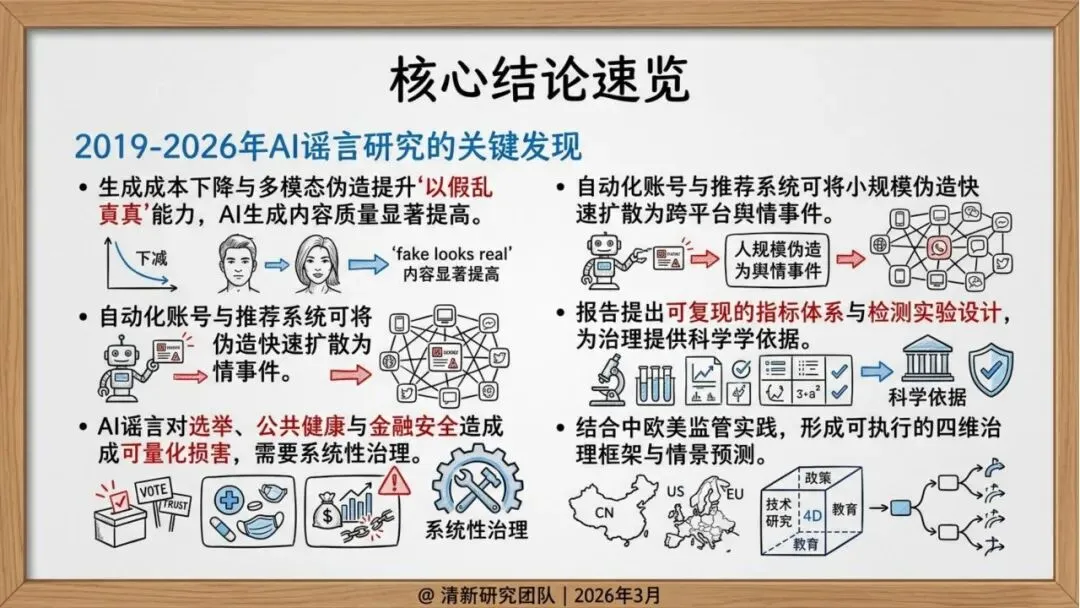

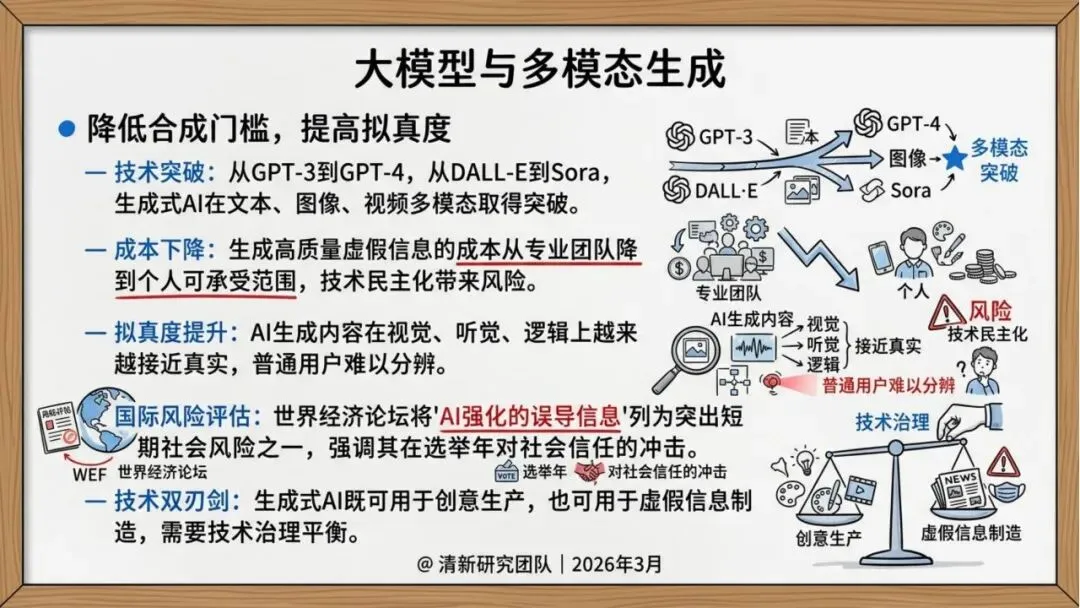

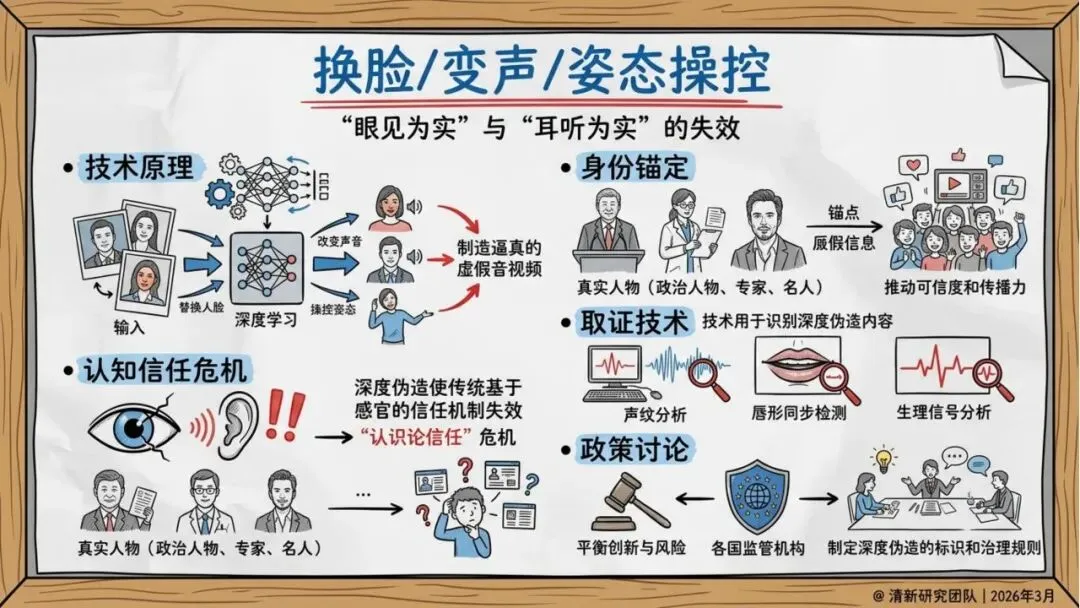

жҠҘе‘ҠжҳҫзӨәпјҢд»ҺGPT-3еҲ°GPT-4пјҢд»ҺDALL-EеҲ°SoraпјҢз”ҹжҲҗејҸAIеңЁж–Үжң¬гҖҒеӣҫеғҸгҖҒи§Ҷйў‘еӨҡжЁЎжҖҒйўҶеҹҹеҸ–еҫ—зӘҒз ҙжҖ§иҝӣеұ•гҖӮз”ҹжҲҗй«ҳиҙЁйҮҸиҷҡеҒҮдҝЎжҒҜзҡ„жҲҗжң¬д»Һдё“дёҡеӣўйҳҹйҷҚеҲ°дёӘдәәеҸҜжүҝеҸ—иҢғеӣҙпјҢжҠҖжңҜж°‘дё»еҢ–еёҰжқҘйЈҺйҷ©зҡ„еҗҢж—¶пјҢAIз”ҹжҲҗеҶ…е®№еңЁи§Ҷи§үгҖҒеҗ¬и§үгҖҒйҖ»иҫ‘дёҠи¶ҠжқҘи¶ҠжҺҘиҝ‘зңҹе®һпјҢжҷ®йҖҡз”ЁжҲ·йҡҫд»ҘеҲҶиҫЁгҖӮ

дё–з•Ңз»ҸжөҺи®әеқӣе·Іе°ҶвҖңAIејәеҢ–зҡ„иҜҜеҜјдҝЎжҒҜвҖқеҲ—дёәзӘҒеҮәзҡ„зҹӯжңҹзӨҫдјҡйЈҺйҷ©пјҢејәи°ғе…¶еңЁйҖүдёҫе№ҙеҜ№зӨҫдјҡдҝЎд»»зҡ„еҶІеҮ»гҖӮ

дј ж’ӯжңәеҲ¶пјҡз®—жі•ж”ҫеӨ§дёҺи·Ёе№іеҸ°иҝҒ移

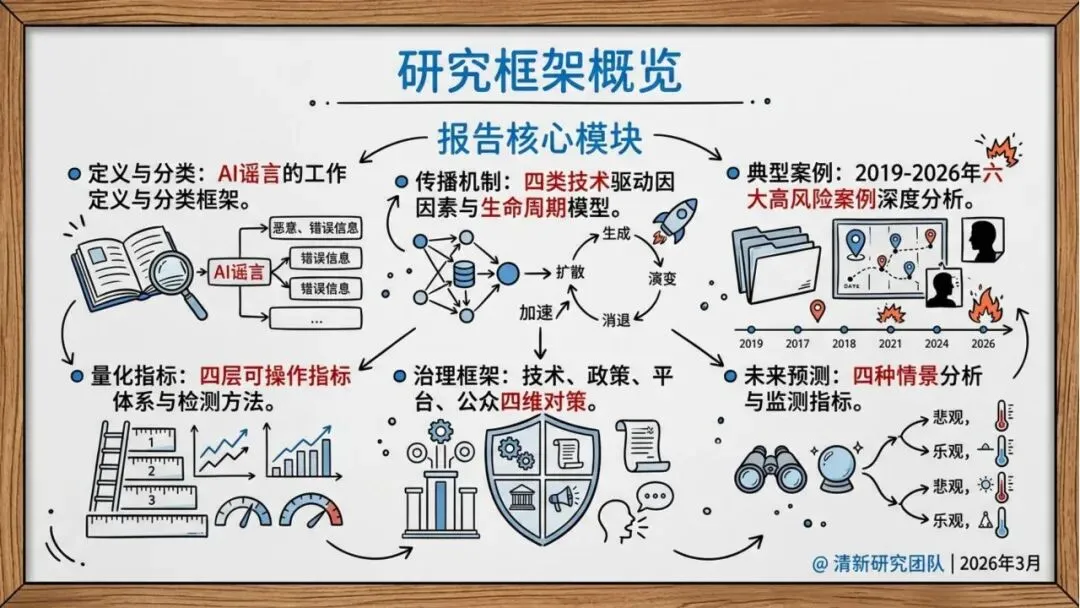

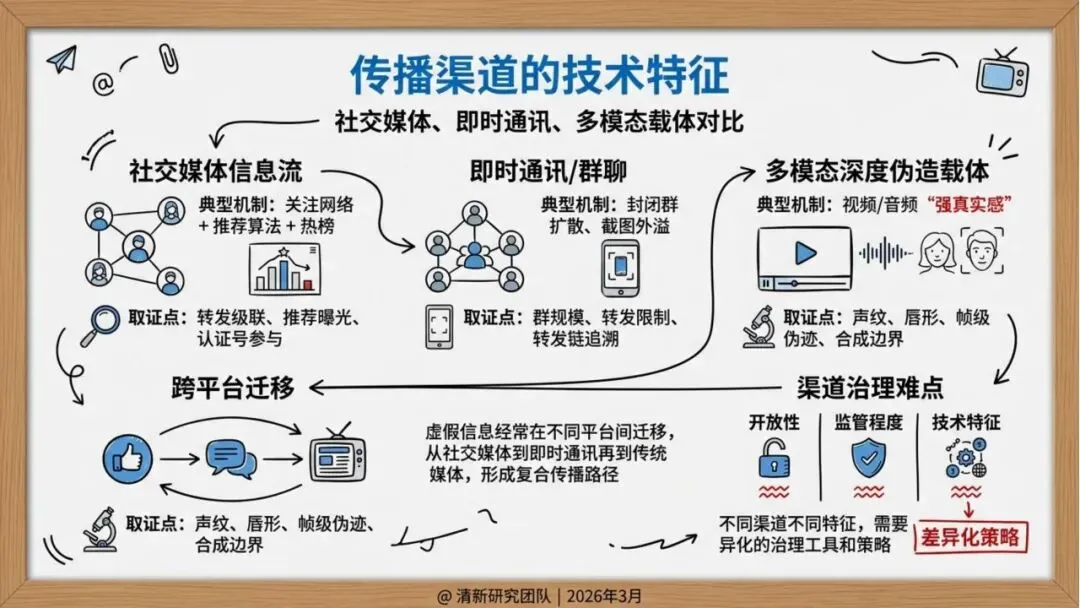

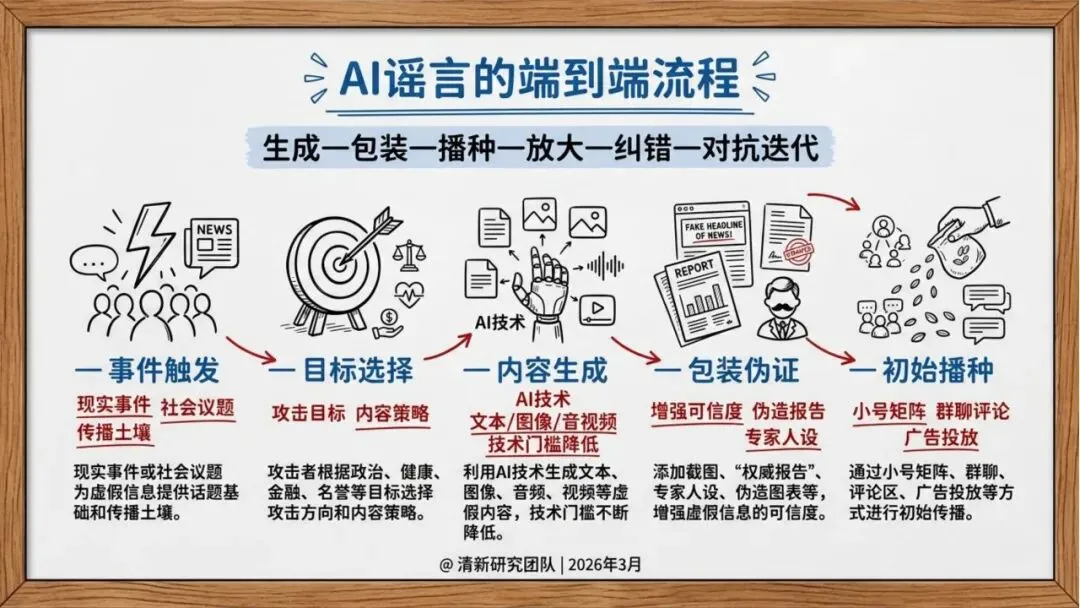

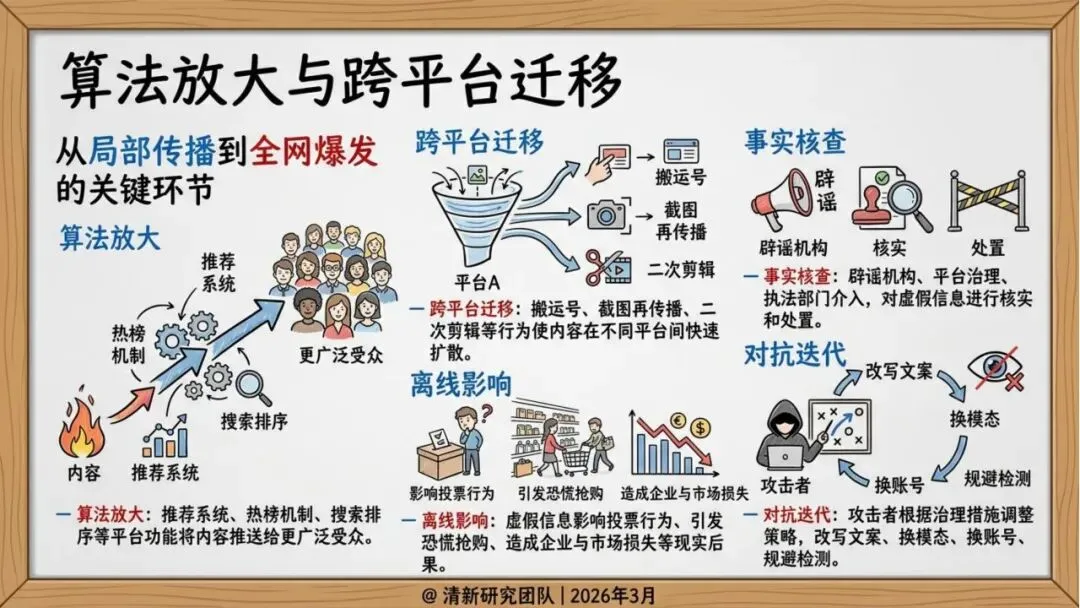

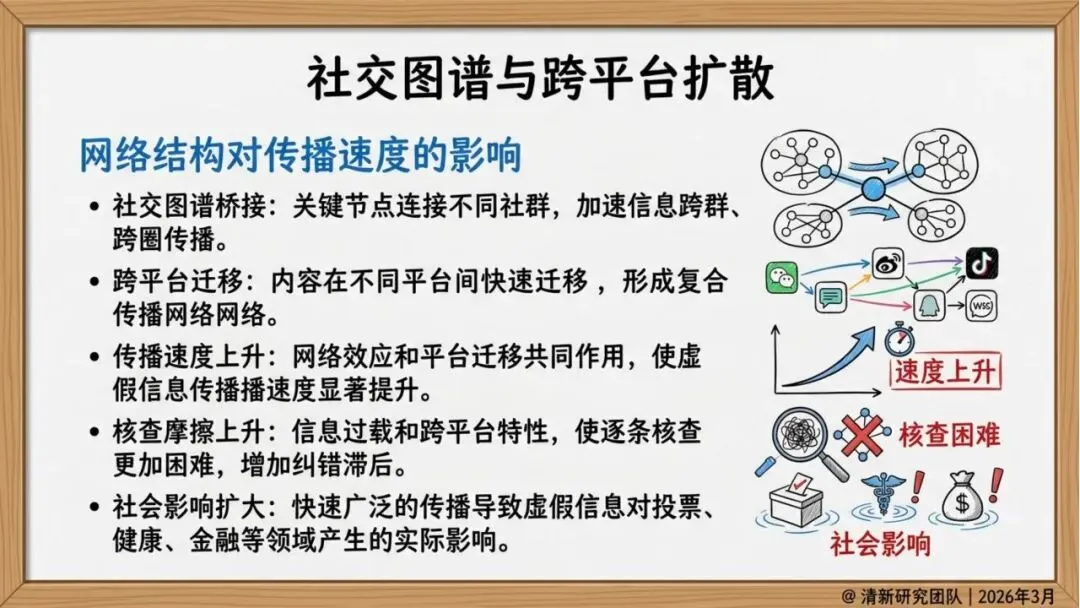

з ”з©¶еҸ‘зҺ°пјҢиҷҡеҒҮдҝЎжҒҜзҡ„дј ж’ӯе‘ҲзҺ°еҮәжҳҺжҳҫзҡ„жҠҖжңҜй©ұеҠЁзү№еҫҒпјҡ

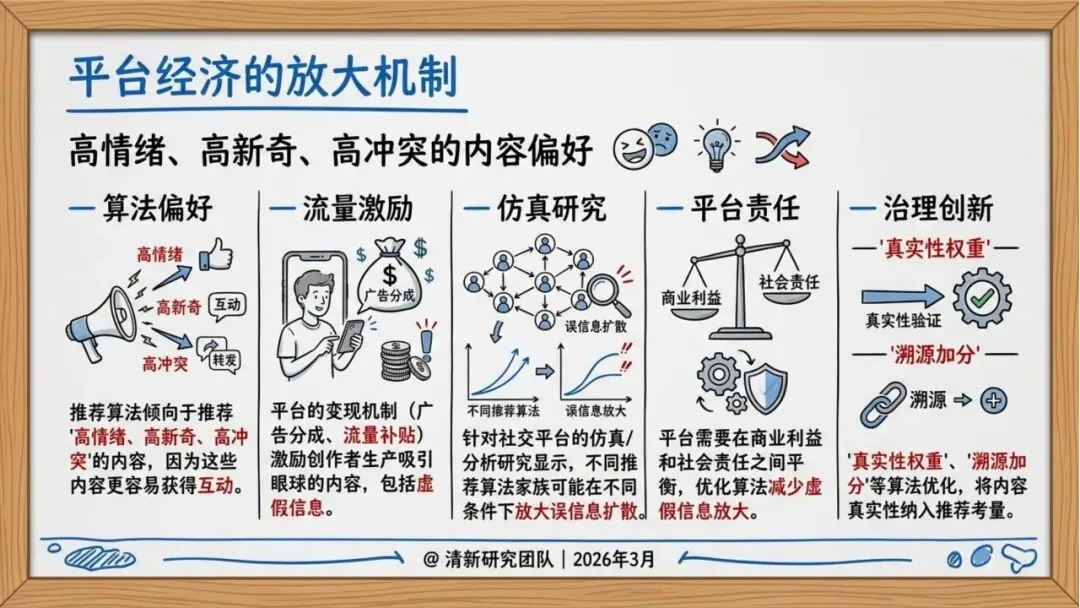

жҺЁиҚҗз®—жі•еҒҸеҘҪпјҡе№іеҸ°з®—жі•еҖҫеҗ‘дәҺжҺЁиҚҗвҖңй«ҳжғ…з»ӘгҖҒй«ҳж–°еҘҮгҖҒй«ҳеҶІзӘҒвҖқзҡ„еҶ…е®№пјҢеӣ дёәиҝҷдәӣеҶ…е®№жӣҙе®№жҳ“иҺ·еҫ—дә’еҠЁгҖӮ

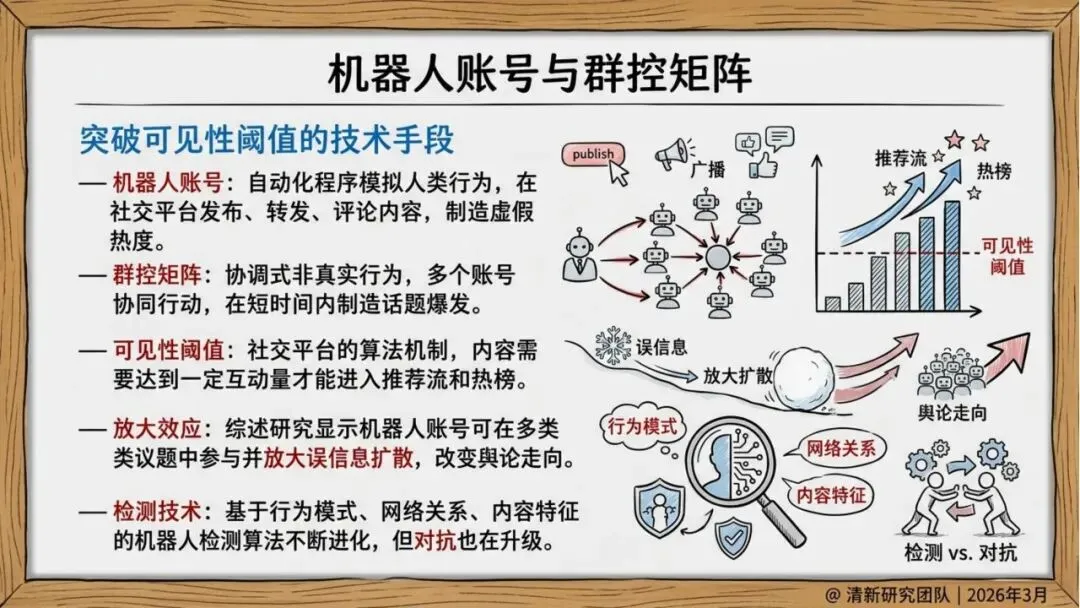

иҮӘеҠЁеҢ–еҚҸеҗҢпјҡжңәеҷЁдәәиҙҰеҸ·е’ҢзҫӨжҺ§зҹ©йҳөеңЁж—©жңҹжҺЁеҠЁеҶ…е®№дј ж’ӯпјҢеҪўжҲҗеҲқе§ӢеҠЁйҮҸгҖӮ

и·Ёе№іеҸ°иҝҒ移пјҡжҗ¬иҝҗеҸ·гҖҒжҲӘеӣҫеҶҚдј ж’ӯгҖҒдәҢж¬ЎеүӘиҫ‘зӯүиЎҢдёәдҪҝеҶ…е®№еңЁдёҚеҗҢе№іеҸ°й—ҙеҝ«йҖҹжү©ж•ЈпјҢд»ҺеұҖйғЁдј ж’ӯжј”еҸҳдёәе…ЁзҪ‘иҲҶжғ…дәӢ件гҖӮ

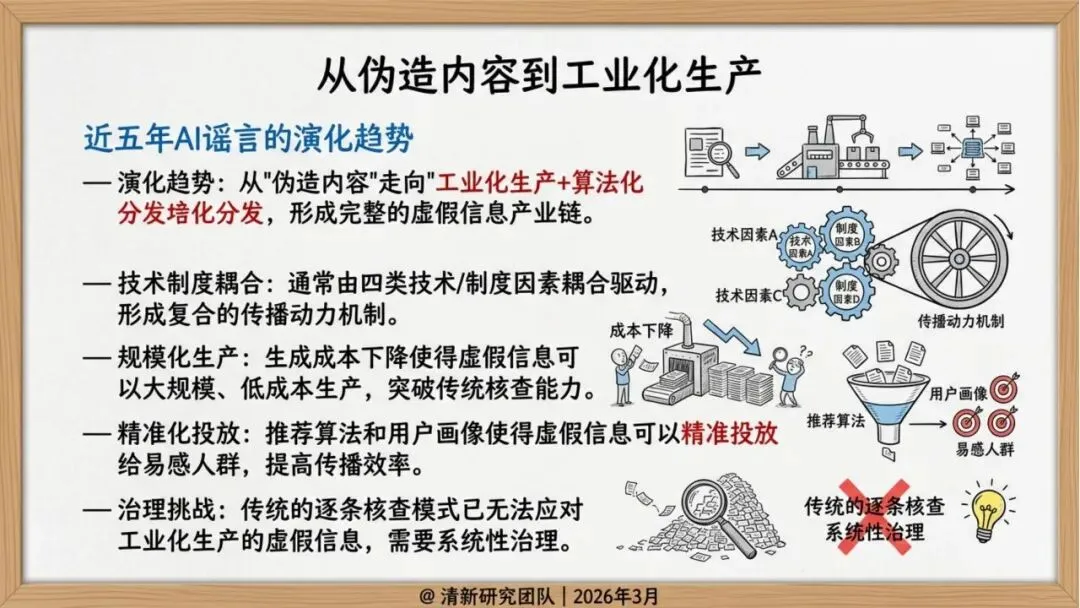

жІ»зҗҶжҢ‘жҲҳпјҡдёәд»Җд№ҲAIи°ЈиЁҖжӣҙеҝ«гҖҒжӣҙйҡҫжІ»зҗҶпјҹ

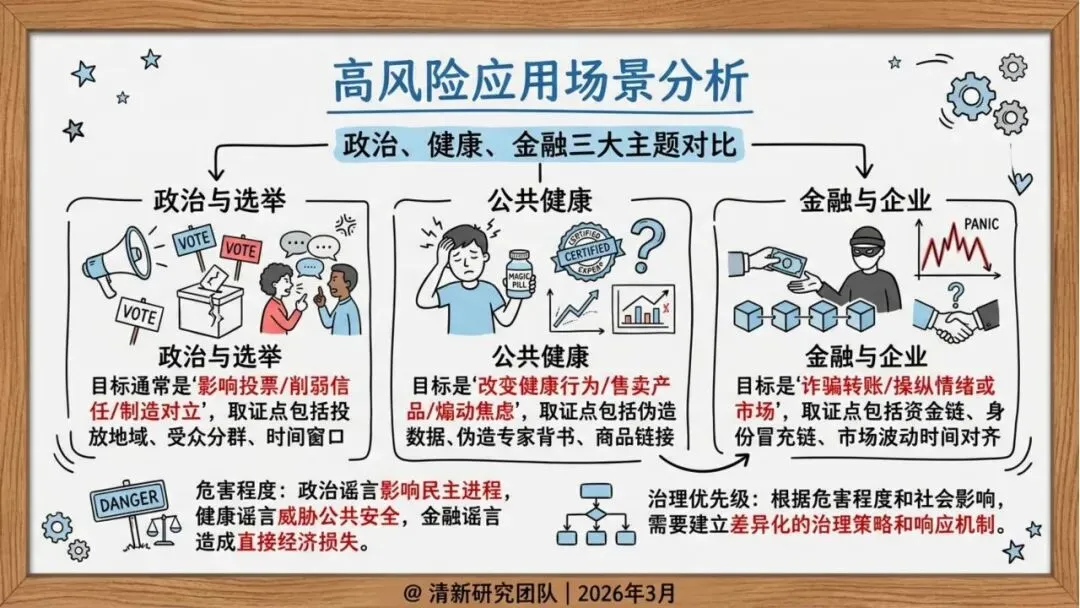

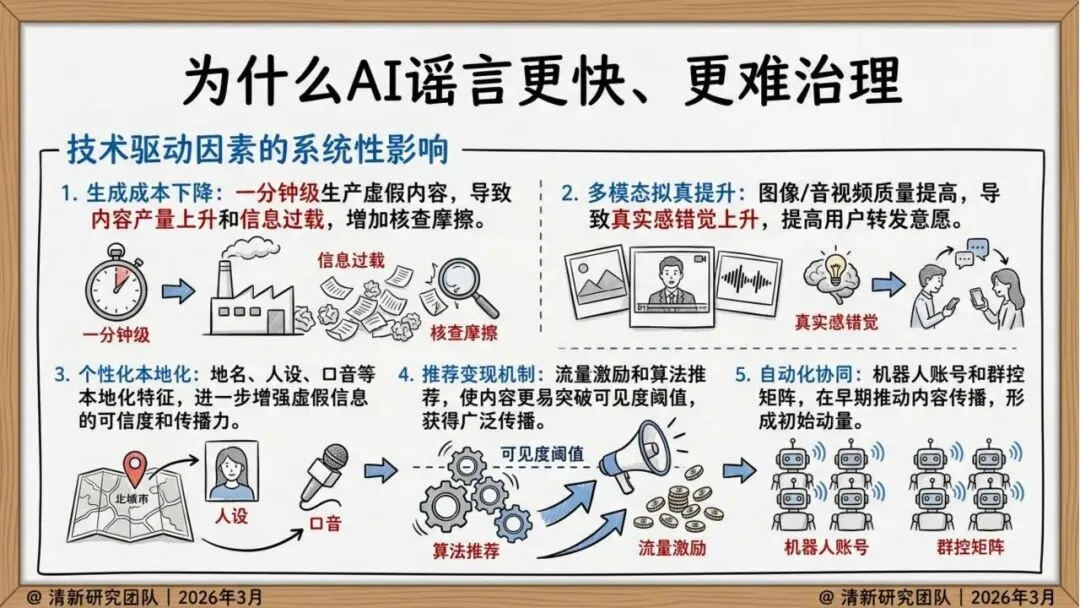

жҠҘе‘ҠжҢҮеҮәдәҶдә”еӨ§жҠҖжңҜй©ұеҠЁеӣ зҙ пјҡ

з”ҹжҲҗжҲҗжң¬дёӢйҷҚпјҡеҲҶй’ҹзә§з”ҹдә§иҷҡеҒҮеҶ…е®№пјҢеҜјиҮҙеҶ…е®№дә§йҮҸдёҠеҚҮе’ҢдҝЎжҒҜиҝҮиҪҪ

дёӘжҖ§еҢ–жң¬ең°еҢ–пјҡең°еҗҚгҖҒдәәи®ҫгҖҒеҸЈйҹізӯүжң¬ең°еҢ–зү№еҫҒеўһејәеҸҜдҝЎеәҰ

жҺЁиҚҗеҸҳзҺ°жңәеҲ¶пјҡжөҒйҮҸжҝҖеҠұдҪҝеҶ…е®№жӣҙжҳ“зӘҒз ҙеҸҜи§ҒеәҰйҳҲеҖј

иҮӘеҠЁеҢ–еҚҸеҗҢпјҡжңәеҷЁдәәиҙҰеҸ·зҫӨжҺ§жҺЁеҠЁж—©жңҹдј ж’ӯ

еӨҡжЁЎжҖҒжӢҹзңҹпјҡзңји§Ғдёәе®һгҖҒиҖіеҗ¬дёәе®һзҡ„дј з»ҹи®ӨзҹҘеӨұж•Ҳ

еӣӣз»ҙжІ»зҗҶжЎҶжһ¶пјҡжҠҖжңҜгҖҒж”ҝзӯ–гҖҒе№іеҸ°гҖҒе…¬дј—еҚҸеҗҢ

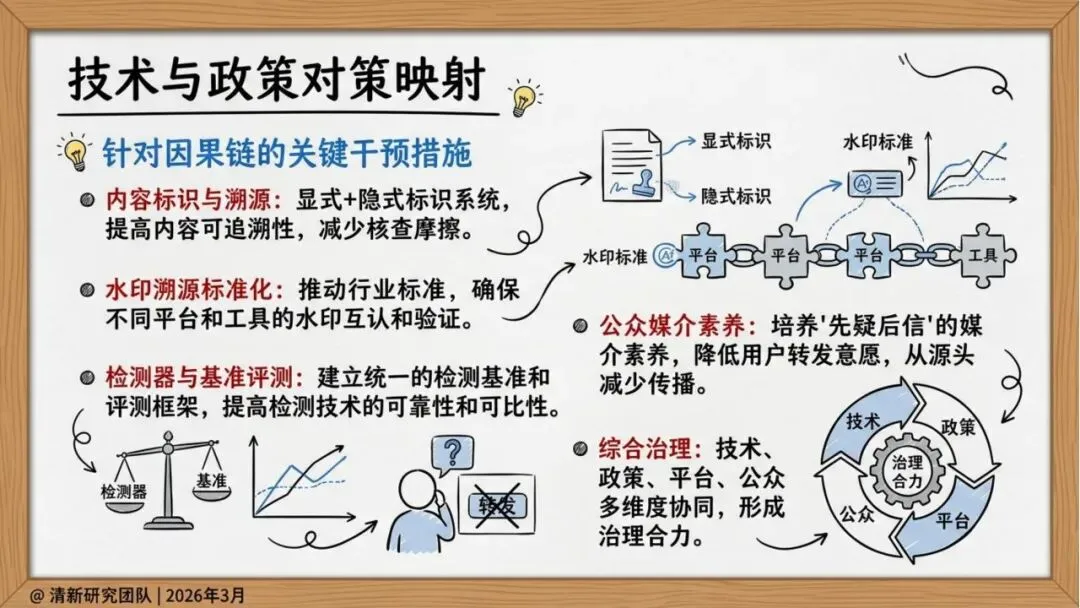

з ”з©¶еӣўйҳҹжҸҗеҮәдәҶеҸҜиҗҪең°зҡ„еӣӣз»ҙжІ»зҗҶжЎҶжһ¶пјҡ

жҠҖжңҜз»ҙеәҰпјҡеҶ…е®№ж ҮиҜҶдёҺжәҜжәҗгҖҒж°ҙеҚ°ж ҮеҮҶеҢ–гҖҒжЈҖжөӢеҷЁдёҺеҹәеҮҶиҜ„жөӢ

ж”ҝзӯ–з»ҙеәҰпјҡеҖҹйүҙдёӯ欧зҫҺзӣ‘з®Ўе®һи·өпјҢеҲ¶е®ҡеҲҶзә§еӨ„зҪ®ж ҮеҮҶ

е№іеҸ°з»ҙеәҰпјҡдјҳеҢ–жҺЁиҚҗз®—жі•пјҢе°ҶвҖңзңҹе®һжҖ§жқғйҮҚвҖқвҖңжәҜжәҗеҠ еҲҶвҖқзәіе…ҘиҖғйҮҸ

е…¬дј—з»ҙеәҰпјҡеҹ№е…»вҖңе…Ҳз–‘еҗҺдҝЎвҖқзҡ„еӘ’д»Ӣзҙ е…»пјҢйҷҚдҪҺиҪ¬еҸ‘ж„Ҹж„ҝ

еҸҜйҮҸеҢ–зҡ„жҢҮж ҮдҪ“зі»

жҠҘе‘Ҡи®ҫи®ЎдәҶеӣӣеұӮеҸҜж“ҚдҪңжҢҮж ҮжЎҶжһ¶пјҡ

еҶ…е®№еұӮпјҡеҸҜиҜҒжҳҺзҡ„жәҜжәҗиҜҒжҚ®

дё»дҪ“еұӮпјҡиҙҰеҸ·иЎҢдёәзү№еҫҒеҲҶжһҗ

дј ж’ӯеұӮпјҡз—…жҜ’зі»ж•°(K-factor)гҖҒдј ж’ӯйҖҹеәҰгҖҒз”ЁжҲ·иҰҶзӣ–еәҰ

еҸ—дј—еұӮпјҡз”ЁжҲ·жҺҘеҸ—дёҺиҪ¬еҸ‘ж„Ҹж„ҝ

жңӘжқҘеұ•жңӣпјҡеӣӣз§ҚеҸҜиғҪжғ…жҷҜ

з ”з©¶еӣўйҳҹйў„жөӢдәҶеӣӣз§ҚжңӘжқҘжј”еҢ–жғ…жҷҜпјҡ

жғ…жҷҜдёҖпјҡжәҜжәҗжҷ®еҸҠдёҺдә’и®ӨеҪўжҲҗдё»йҳІзәҝ

жғ…жҷҜдәҢпјҡжЈҖжөӢвҖ”еҜ№жҠ—вҖңжҢҒд№…жӢүй”ҜвҖқпјҢжІ»зҗҶйқ з»„еҗҲжӢі

жғ…жҷҜдёүпјҡй«ҳеҶІеҮ»дәӢ件и§ҰеҸ‘зӣ‘з®ЎдёҺе№іеҸ°зҙ§жҖҘеҚҮзә§

жғ…жҷҜеӣӣпјҡд»ҺвҖңйӘ—е…¬дј—вҖқиҪ¬еҗ‘вҖңйӘ—жЁЎеһӢвҖқзҡ„дҝЎжҒҜжҲҳ

з»“иҜӯ

еңЁAIжҠҖжңҜеҝ«йҖҹжј”иҝӣзҡ„д»ҠеӨ©пјҢиҷҡеҒҮдҝЎжҒҜжІ»зҗҶе·Ід»ҺвҖңдёҖеҜ№дёҖйӘҢиҜҒвҖқзҡ„дј з»ҹжЁЎејҸпјҢиҪ¬еҗ‘еә”еҜ№вҖңе·Ҙдёҡ规模иҷҡеҒҮдҝЎжҒҜвҖқзҡ„зі»з»ҹжҖ§жҢ‘жҲҳгҖӮжҠҘе‘Ҡејәи°ғпјҢжҠҖжңҜгҖҒж”ҝзӯ–гҖҒе№іеҸ°гҖҒе…¬дј—еӨҡз»ҙеәҰеҚҸеҗҢпјҢеҪўжҲҗжІ»зҗҶеҗҲеҠӣпјҢжүҚжҳҜеә”еҜ№AIи°ЈиЁҖзҡ„ж №жң¬д№ӢйҒ“гҖӮ

йқўеҜ№еҚіе°ҶеҲ°жқҘзҡ„жӣҙеӨҡжҠҖжңҜиһҚеҗҲйЈҺйҷ©пјҲAIдёҺз”ҹзү©жҠҖжңҜгҖҒи„‘жңәжҺҘеҸЈгҖҒйҮҸеӯҗи®Ўз®—зӯүпјүпјҢеүҚзһ»жҖ§з ”究дёҺеә”жҖҘйў„жЎҲзҡ„е»әз«ӢеҲ»дёҚе®№зј“гҖӮ

йҳ…иҜ»е…Ёж–ҮпјҢе…Қиҙ№дёӢиҪҪжҠҘе‘Ҡ

зӮ№еҮ» вҶ“ й“ҫжҺҘпјҢдёӢиҪҪж–ҮжЎЈ

жӣҙеӨҡжё…еҚҺдҝЎжҒҜпјҢзӮ№еҮ» вҶ“ й“ҫжҺҘ

жё…еҚҺеӨ§еӯҰгҖҠдёҖдәәе…¬еҸёеҸ‘еұ•з ”究жҠҘе‘Ҡ2.0гҖӢ

жё…еҚҺеӨ§еӯҰдёҖдәәе…¬еҸёпјҲOPCпјүеҸ‘еұ•з ”究137йЎө.pdf

жё…еҚҺеӨ§еӯҰ2025дәәе·ҘжҷәиғҪжІ»зҗҶе№ҙеәҰжҠҘе‘ҠиҝҲеҗ‘еҸҜиЎЎйҮҸзҡ„AIжІ»зҗҶ19йЎө.pdf

жё…еҚҺеӨ§еӯҰ2025е№ҙAIGCеҸ‘еұ•з ”究жҠҘе‘Ҡ4.0зүҲ152 йЎө.pdf

жё…еҚҺеӨ§еӯҰ&еҚҺдёәпјҡAIз»Ҳз«ҜзҷҪзҡ®д№Ұ-AIдёҺдәәеҚҸдҪңгҖҒжңҚеҠЎдәҺдәә.pdf

жё…еҚҺпјҡOpenClaw ж·ұеәҰз ”з©¶жҠҘе‘Ҡ2.0

жӣҙеӨҡзӣёе…іжё…еҚҺеҶ…е®№дҝЎжҒҜпјҢзӮ№еҮ» вҶ“ е°ҸзЁӢеәҸпјҢжҗңзҙўпјҡжё…еҚҺ