万众瞩目,英伟达发布了最新一季的财报,结果并没有让人失望。市场应该可以松了口气。

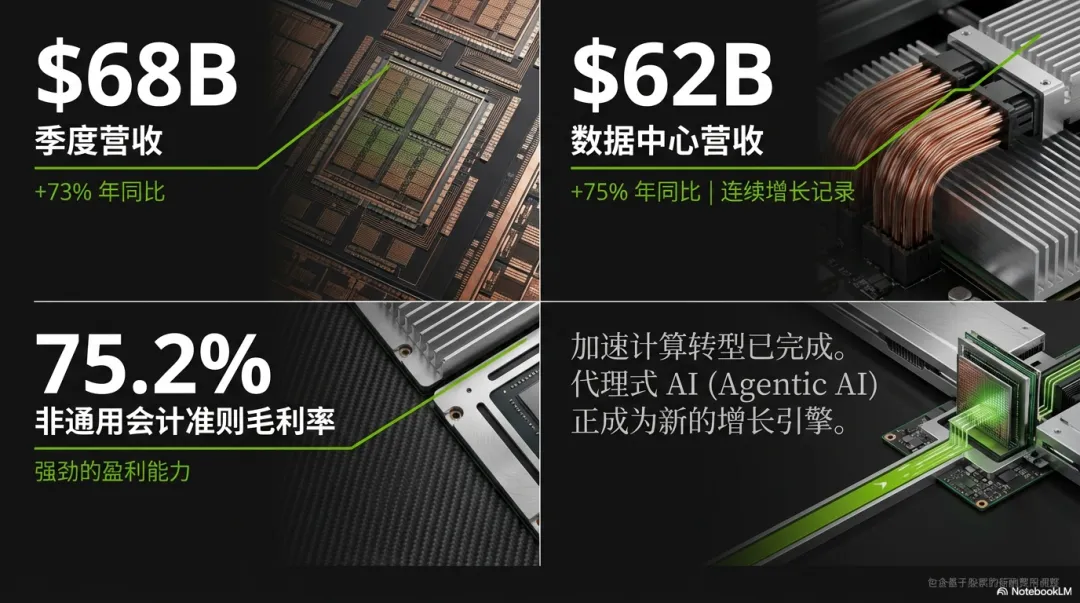

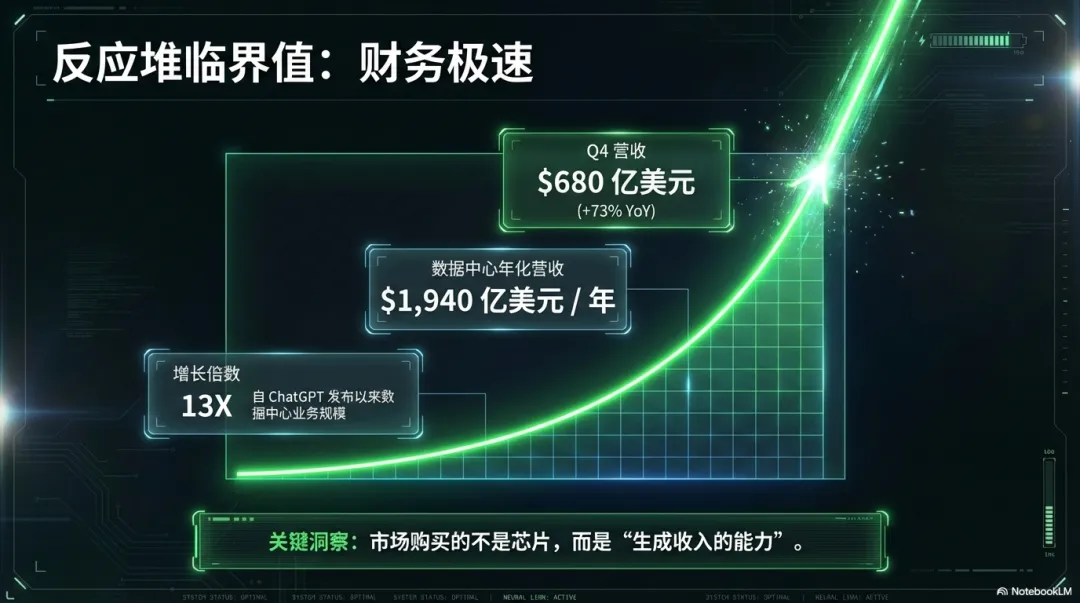

2026年第四季度营收约 680 亿美元、同比增长 73%,这种增速放在任何一家“体量已经大到离谱”的公司身上,都足够让人震一下。

除了这些亮眼的数据,我更关注财报电话会上管理层的表达。

对大多数普通投资者来说,最关注的问题莫过于三个:AI到底有没有泡沫;英伟达的高速增长还能持续多久(未来的需求来自哪里);以及最关键的——它的护城河究竟有多深。

这些问题可以在财报电话会里找到线索。

一、AI重心的迁移:从训练走向推理

过去两年,大家聊AI,默认都在聊训练:谁的参数更大、谁的预训练数据更猛、谁的集群更豪华。训练当然重要,但它有一个特征——它更像“开厂前的基建”,周期长、集中爆发,完成之后增长会暂时放缓。

电话会释放的一个很清晰的信号:AI行业的重心正在从训练转向推理(Inference)。推理是什么?你可以把它理解为“模型真正开始上班”的那一刻:用户问一次、模型答一次;企业调用一次、系统生成一次;每一次生成、每一个 token(词元),都在消耗算力。

如果训练是“修铁路”,推理更像“天天跑高铁”。修铁路很贵,但修完之后,真正决定收入的,是每天有多少车次、多少人上车、多少货在跑。推理时代的算力消耗,不再是集中式的大训练,而是持续的大规模服务;而持续,往往比一次性更可怕,也更值钱。

今天我们使用的很多AI产品,已经很难退回到“偶尔用一下”的阶段。写代码、分析数据、做方案、做客服、做运营,AI开始进入工作流之后,它就不是“锦上添花”,而是“缺了就卡壳”。

这也是黄仁勋把推理和收入牢牢绑定的底层原因:当推理成为产品交付的核心环节,算力就会变成服务能力的上限,服务能力上限直接决定收入上限。

二、AI Agent:推理需求进一步放大

如果只把推理理解成“你问一句、它答一句”,那对未来算力需求的估计,可能还会偏保守。

真正会把推理拉到新量级的,是 AI Agent(代理式AI)的普及。Agentic AI 的关键不是“更会聊天”,而是“能把任务做完”。

它会拆解目标、调用工具、写代码、跑流程、反复迭代,把一个原本需要人类盯着一整天的工作,变成一个可以持续运行的自动化过程。

这意味着什么?意味着推理不再是一段短对话,而是一条长链路;不再是一次生成,而是连续生成;不再是几秒钟的响应,而是几小时甚至更长的任务执行。你可以把它想象成:以前我们用AI像用计算器,按一下出结果;未来我们用AI更像用一个项目团队,你给目标,它自己开工、分工、复盘、再推进。

当工作方式变成这样,推理需求会呈现出一种“自我放大”的特征:更多任务交给Agent,Agent为了完成任务会调用更多工具、产生更多token、占用更多算力;而算力越充足,Agent越可靠,企业越敢把关键流程交给它,于是算力需求继续上升。

这就是为什么电话会里强调的不是“模型变强”,而是“应用方式变了”。应用方式一旦从“工具”变成“劳动力”,算力就会从“IT预算”变成“经营预算”,它的天花板会被重新定义。

三、真正的护城河不只在GPU

很多人第一时间看到英伟达,会把注意力放在GPU上:更先进的架构、更强的性能、更大的供不应求。

GPU当然是皇冠上的宝石,但如果只盯着芯片,就会漏掉一个更隐蔽、却越来越重要的层面——网络与互连。英伟达网络业务的年营收已经达到310亿美元。

我们可以用一个非常直观的类比来理解它:GPU像F1赛车的引擎,是极限性能的来源;但如果你把F1引擎塞进一条泥泞拥挤的乡间小路,它的优势会被立刻磨平,甚至不如一台普通车跑得顺。

现代AI早就不是“单个芯片”在工作,它更像一个由成千上万颗GPU组成的巨型系统——一个“AI工厂”。

在这种工厂里,算力不是一颗芯片的算力,而是整个集群协同的算力;协同效率的瓶颈,往往不在计算,而在数据怎么流动、模型怎么并行、任务怎么切分、节点怎么通信。

这就是 NVLink 这类互联技术的意义:它把多个计算节点紧密连接成一个更像“整体”的计算单元,让数据在节点间高速穿梭,减少等待,减少空转,把昂贵GPU的利用率拉到极致。再往外扩展,配合更大规模的网络方案,才能把成千上万个节点织成一个真正可用、可扩展、可运营的数据中心系统。

NVLink之所以被反复提及,是因为在推理时代,“算力=收入”不只是芯片更快,而是系统更顺;系统更顺,单位时间能生成更多token,能服务更多用户,能跑更多Agent,收入自然就更靠近天花板。

四、更长周期的增量:物理AI

如果说推理和Agent把算力变成了“数字世界的生产力”,那么物理AI(Physical AI)则在做一件更激进的事:把算力推向真实世界,让它去驱动机器、车辆、工厂、物流系统。

这条线之所以可怕,是因为它不再只服务于“屏幕里的信息”,而是服务于“现实中的动作”。自动驾驶、机器人、智能制造、仓储物流,任何一个场景一旦规模化,它对算力的需求都可能远超我们今天对“聊天机器人”的想象。

更重要的是,物理AI的训练方式也在变。

我们不可能让机器人在真实工厂里摔倒一万次来学习,那成本太高、风险太大,于是仿真与数字孪生平台的重要性迅速上升:在虚拟世界里反复试错,在现实世界里一次上岗。

这样的流程把“训练”和“推理”都拉长了链路:训练更依赖大规模仿真算力,推理更依赖实时决策算力,而两者叠加,会把数据中心的需求推到更高维度。

当把这条线看清楚,就会理解为什么英伟达在电话会里强调的不只是“AI更聪明了”,而是“AI开始进入工厂与道路”。一旦AI进入物理世界,它就不再是一个软件潮流,而是一场生产方式的改造。

结语:当软件能够实时生成,还是泡沫?

几千亿美元级别的资本支出,凭什么长期存在?这难道不是一场巨大的泡沫吗?这是许多人不断追问的问题。

黄仁勋洞察到了AI时代软件的范式转移,这将带来算力的指数级增长(参考老黄与思科CEO的对谈)。

过去的软件像DVD光盘:预先录制好,点击按钮就执行,算力消耗很小;未来的软件更像实时导演一部大片:它要理解你的语境、你的意图,甚至接入企业的数据与工具链,在当下生成答案、生成行动方案、生成流程,然后把任务推进到完成。

从“播放DVD”到“实时导演大片”,算力消耗不是线性增加,而是跃迁式增加;而一旦这种实时生成开始承接生产力与经营活动,它就会被企业纳入“刚性需求”的范畴。

刚性需求的特点,是你很难靠“节省”去对抗它,因为节省的不是成本,而是增长,是收入和竞争力。

这也是为什么黄仁勋敢把那句话说得这么绝对:当推理成为交付能力的一部分,算力就成了收入的一部分。

把这场电话会从头到尾串起来,重点并不是“本季度赚了多少”,而是“未来几年算力需求会怎么扩张”。

短期主战场在推理,推理的加速器是AI Agent;而NVLink 这类互联与网络能力构成了重要的系统级护城河。

更长周期的增量来自物理AI。当AI从数字世界到真实世界,算力需求的天花板将会不断突破。

当算力最终像“数字呼吸”一样融入每个流程,资本支出就不会只是“科技巨头的数字游戏”,它会变成手机里更聪明的助手、车上的自动驾驶系统、工作流里那支隐形的AI团队。