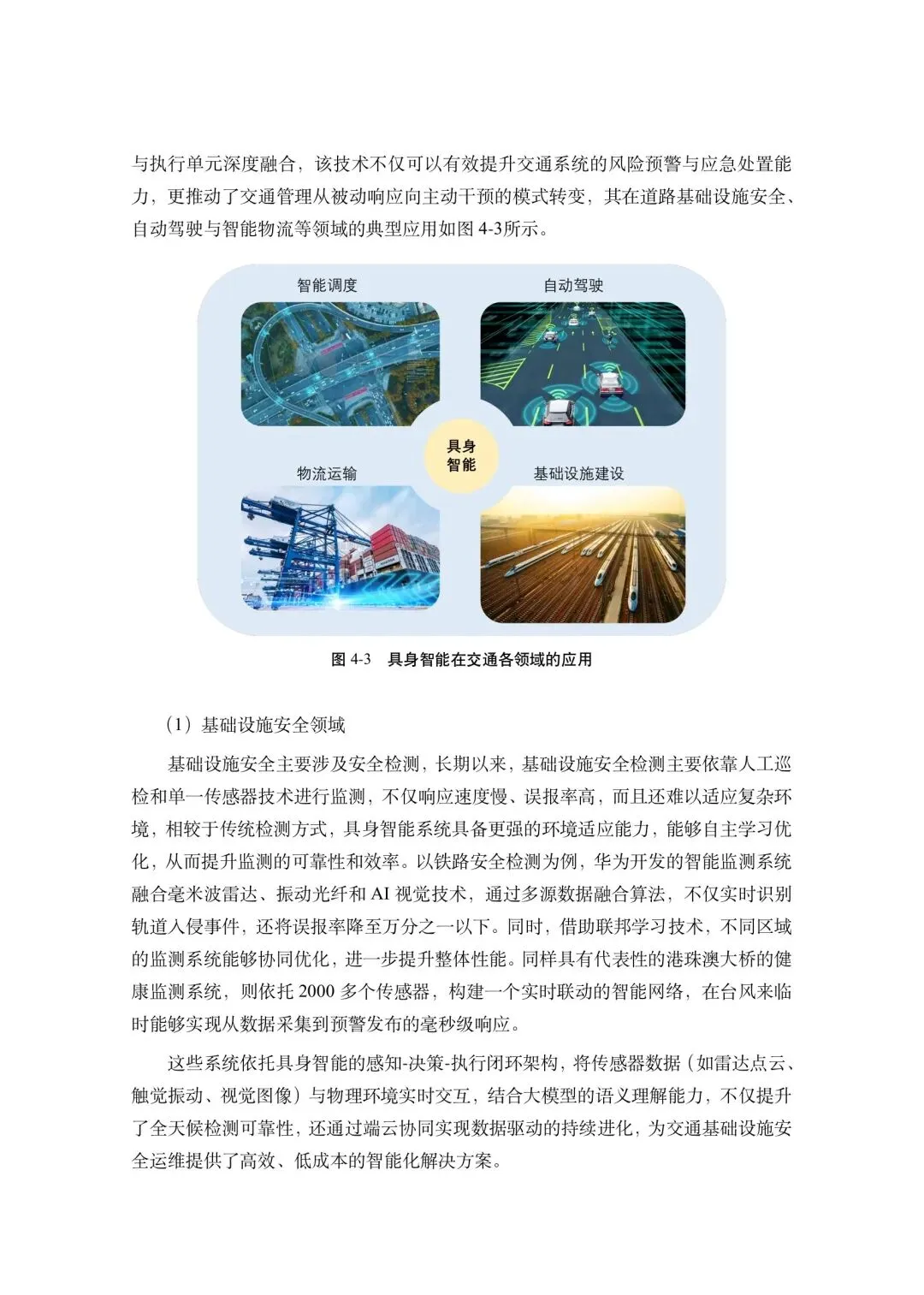

最近花时间细读了刚发布的《中国人工智能系列白皮书-具身智能(2026版)》,一个很深的感受是:这行当的底层逻辑正发生根本性切换,不再是单纯的“大模型+机械臂”,而是在往物理因果理解的方向深扎。

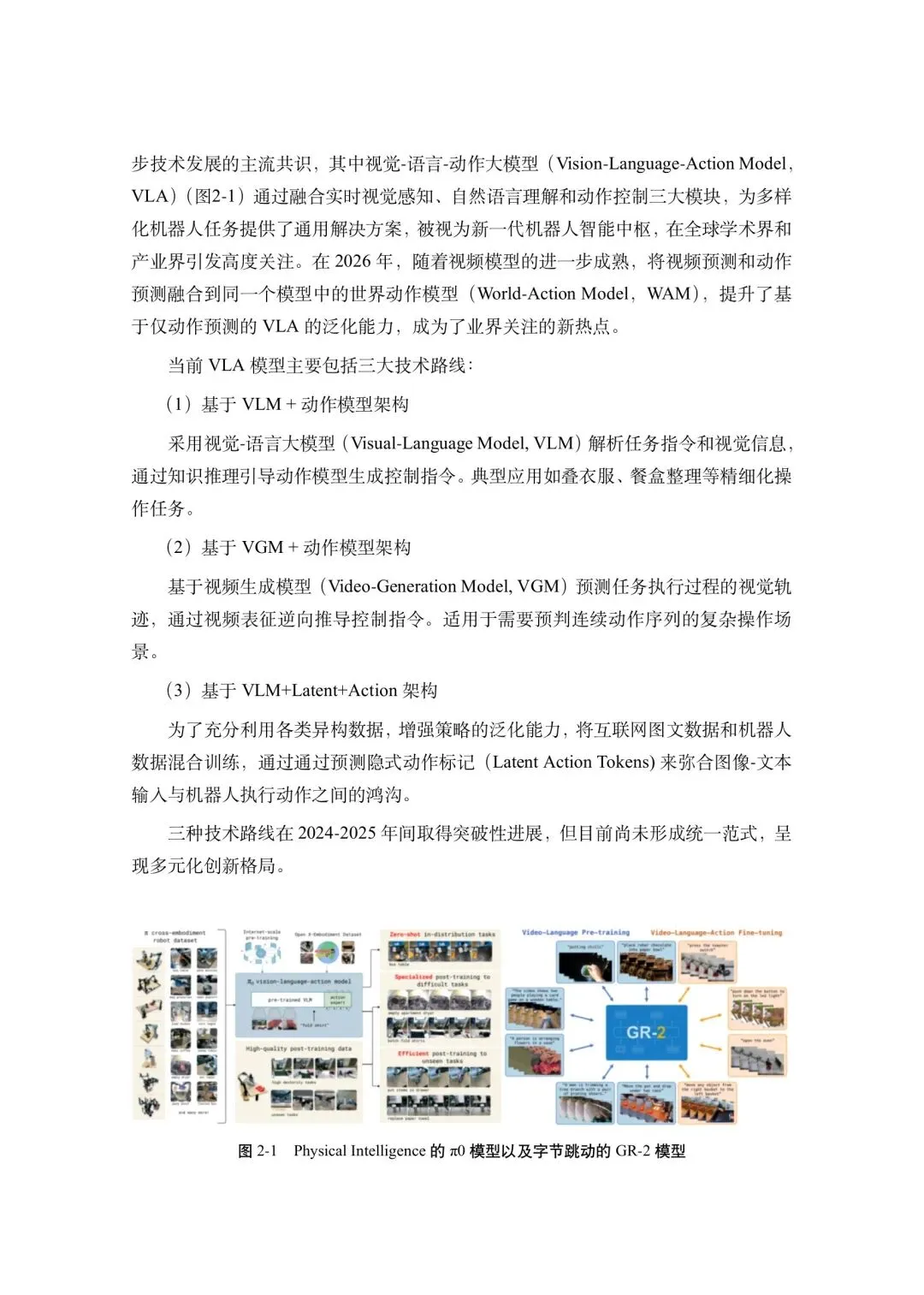

这份白皮书近80页,核心就在讲一件事——具身智能正从“VLA(视觉-语言-动作)范式”迈向“WAM(世界-动作模型)范式”的真正落地。挑几个我觉得真正值得关注的点聊聊。

1. WAM不是概念,是实打实的架构迭代

VLA模型是现在的主流,让机器人把看到的、听到的转化成动作指令。但问题很明明显,它本质是在“模仿”,遇到物理干扰、长程任务就暴露短板——比如叠到一半衣服被风吹跑了,它不知道怎么调整。

WAM的解法更底层一点,它要求机器人内置一个能预测“我的动作会引发环境怎样变化”的内部模型。说白了,就是让机器人具备了像人一样的“物理常识”:杯子没放稳会掉下去,用力推东西会倒。

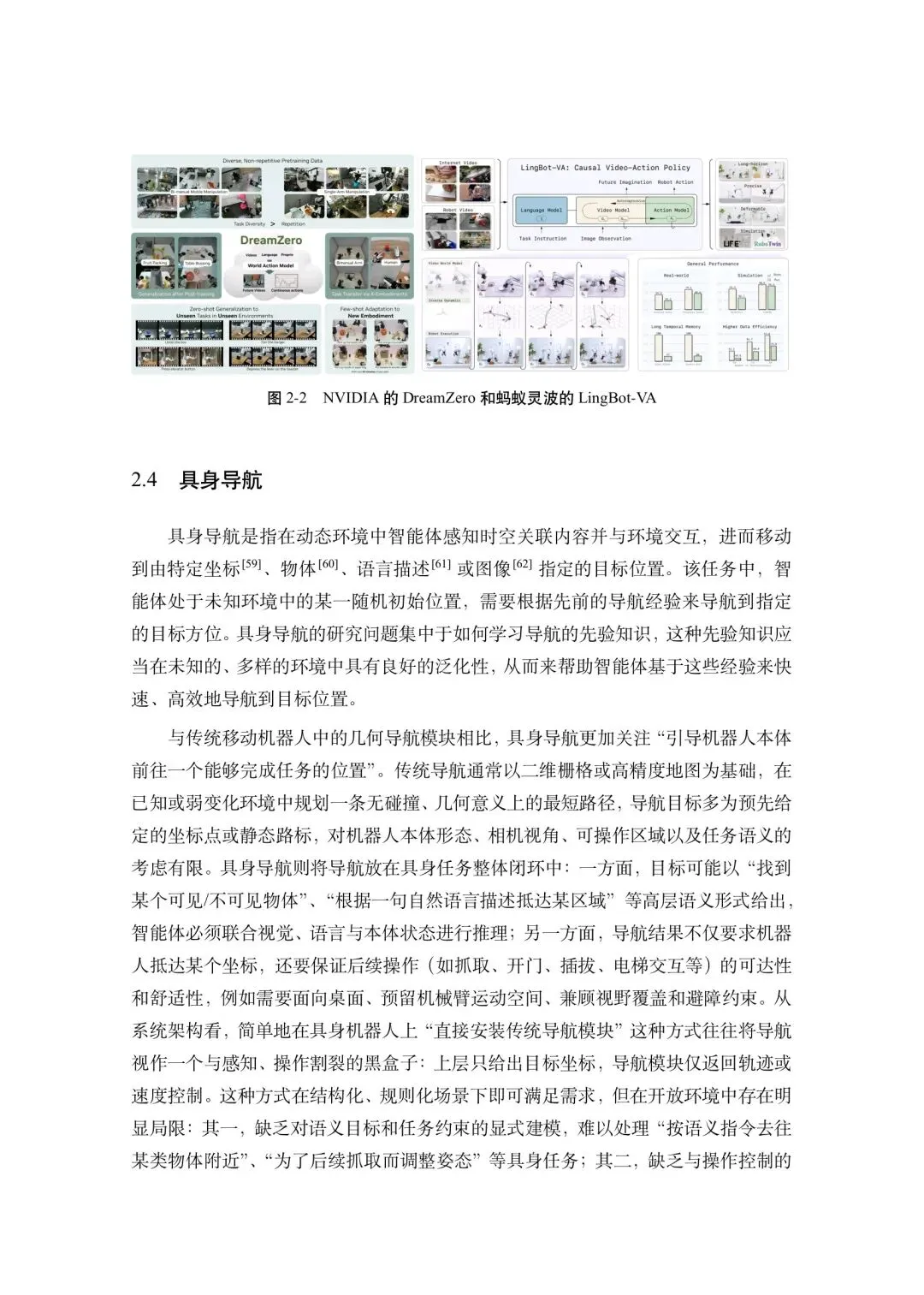

白皮书里提到Nvidia的DreamZero、蚂蚁灵波的LingBot-VA都是这条路线上的代表性工作。我觉得这是对的,也是具身智能真正走进家庭、工厂的必须跨越的坎——机器人必须理解重量、摩擦、弹性、重力这些物理量,不是靠大数据“背答案”,而是靠内在模型“推理”。

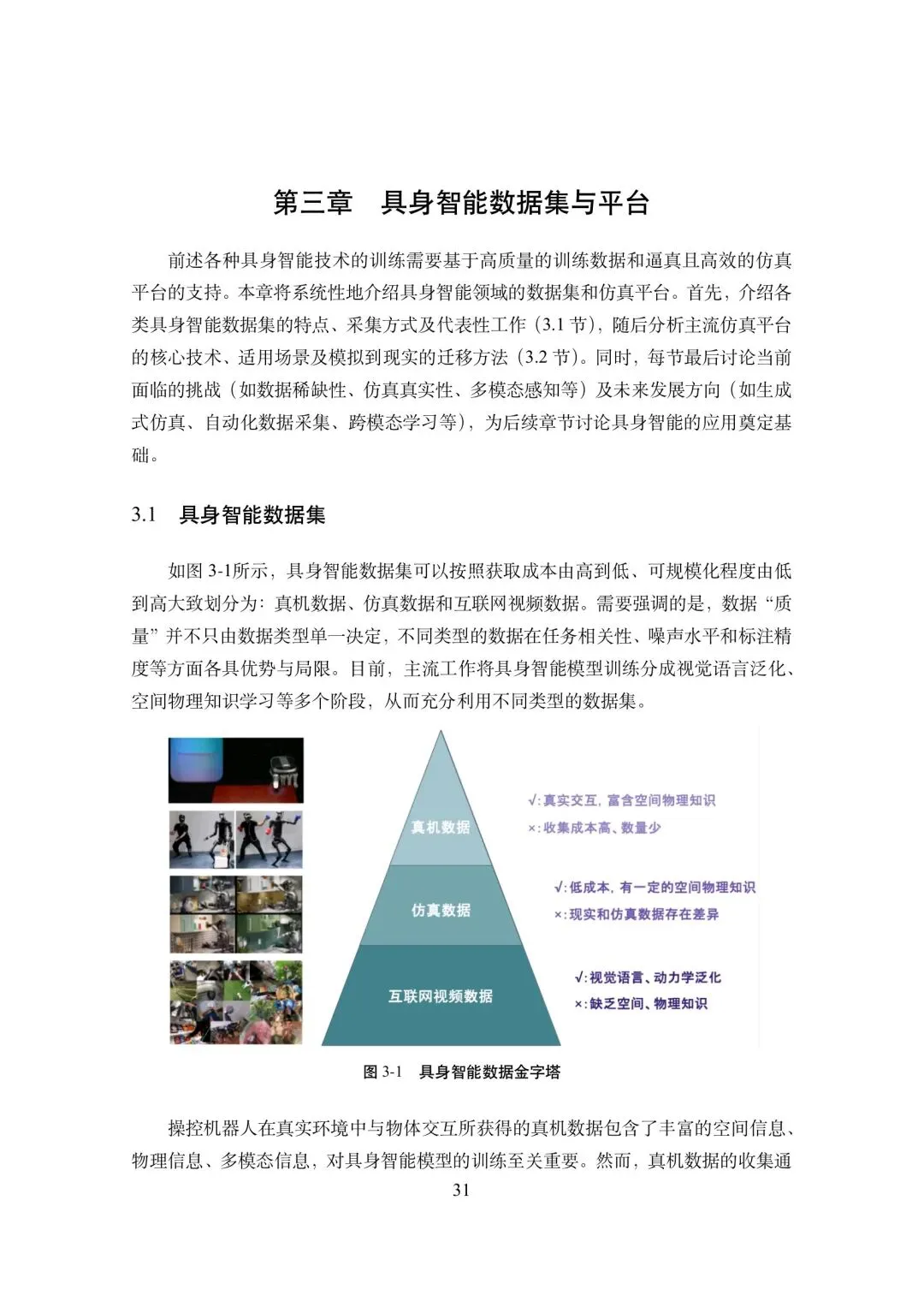

2. 数据范式在“降本”,是关键信号

另一个值得留意的是数据采集。白皮书花了很大篇幅讲UMI(通用操作接口)和自我中心感知,简单说就是让数据采集脱离昂贵的实验室环境。用便携式手持夹爪、第一视角摄像头就能提取高质量的演示数据,单次采集成本能压到一块以下。

这意味着什么?意味着数据飞轮能真正转起来。过去具身智能最大的瓶颈就是“缺数据”,而数据又高度依赖本体,换个机器人就得重新采集。现在这条路如果能走通,具身数据的通用性和可扩展性将彻底改观。产品化也就有了实际可能。

3. 强化学习终于“嵌”回主框架

强化学习过去两年在具身领域有点边缘,因为训练不稳定、耗时长。但白皮书明确把它重新拉回核心——特别是与VLA模型的深度整合。RLinf-VLA这类框架能实现VLA模型的在线微调,让策略从纯粹模仿进化到自主优化。

这个趋势我挺看好的。未来大概率是“预训练VLA + 强化学习后训练”的组合方案,预训练给基础能力,强化学习负责在真实环境里持续进化。这才是一个真正闭环的智能体应该有的样子。

总体看这份白皮书,一个明确的判断是:2026年往后,具身智能的核心竞赛不再是“谁的大模型参数量更大”,而是“谁的世界模型更准、数据飞轮转得更快、强化学习反馈更高效”。

今日分享:中国人工智能系列白皮书-具身智能(2026版)/ 75页 | 原文pdf 下载说明及机器人智库星球介绍

声明:报告版权归原创作者所有,仅作学习分享不作商业用途。其他仅为整理时间成本