技术圈的"开源革命" 兄弟们,今天这条不是吃瓜,是避坑。

你要是还在用ChatGPT当AI神器,每个月账单看着都肉疼,那今天这个开源大模型LLaMA,可能让你重新认识什么叫"技术革命"。

2023年Meta开源LLaMA 13B模型时,可能连他们自己都没想到:这个支持70亿-650亿参数的"开源选手",会在2024年成为中小企业、开发者甚至科研机构的"香饽饽"。 结果呢? ChatGPT还在收着每月20刀的订阅费,LLaMA已经让创业者用一张3090显卡就玩转大模型了。

这波谁在亏? 闭源AI巨头的"技术霸权"。 这波谁在赚? 所有想低成本"上车"AI时代的人。

ChatGPT、GPT-4这些闭源模型,就像租房子——月月交租,还不能装修。 LLaMA不一样,它是"买断制"——免费商用、二次训练、架构修改,随便你折腾。

这意味着什么? 中小企业:不用再掏百万级API费用,就能有自己的专属大模型 科研机构:可以深入底层架构,搞技术创新(斯坦福基于LLaMA优化出Alpaca模型) 开发者:2周就能搭出应用原型,加速产品落地 说白了,就是让AI从"奢侈品"变成"日用品"。

LLaMA的参数量设计,就像衣服尺码——从S到XXL,总有一款适合你。 轻量版(7B/13B):支持手机、边缘服务器部署,延迟低到50ms,适合实时交互 标准版(33B/65B):性能接近GPT-3.5,能满足企业级需求 多语言支持:覆盖中、英、日、德等20+语言,解决跨地域痛点 这波操作,直接把硬件门槛砍掉了80%。

生态闭环 开源的核心价值是什么?生态。

目前围绕LLaMA的工具链,已经形成完整闭环: 微调工具:LoRA、QLoRA让微调成本降低90% 部署框架:Hugging Face Transformers、vLLM支持快速上线

应用模板:客服、写作、代码、翻译,现成解决方案一大堆 翻译成人话:就算你是技术小白,也能靠现成工具快速上手。

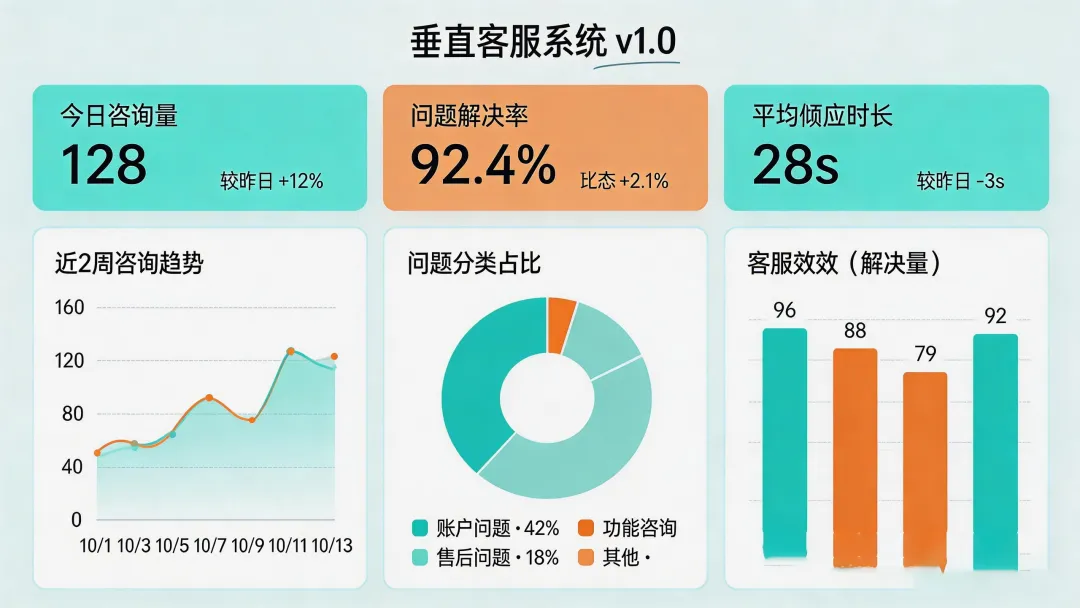

某创业公司基于LLaMA 7B模型,仅用2周就开发出垂直行业客服系统。 结果呢?

客服响应率提升40% 问题解决率从58%飙到82% 成本降低60%

关键点: 不用人工录入知识库,模型自动学习产品手册、售后案例。

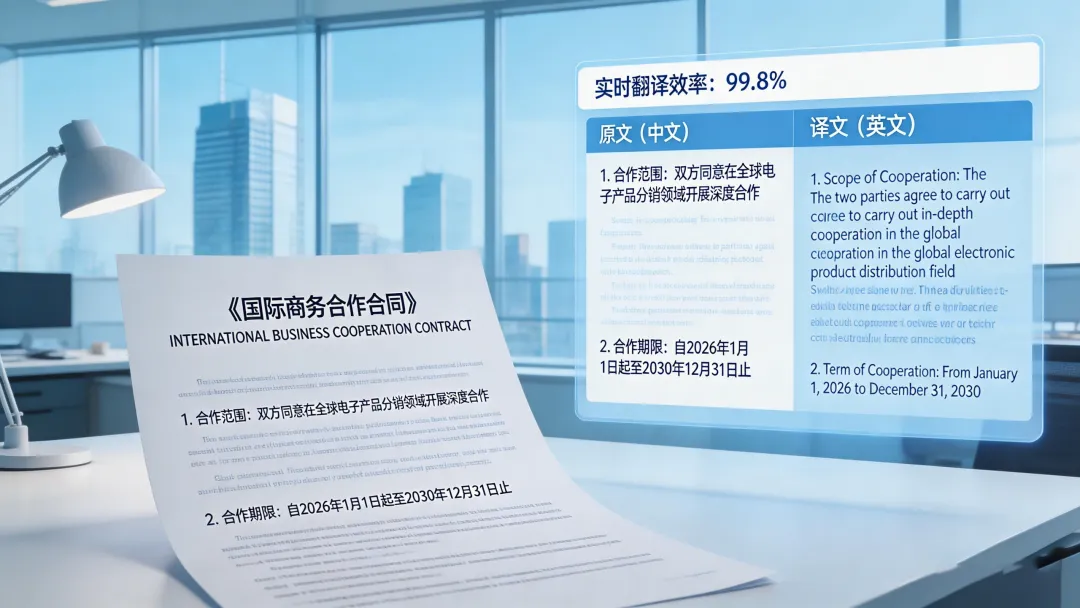

案例2:外企,中英文合同实时翻译

某外企用LLaMA实现中英文合同实时翻译。

效率提升: 3倍。

成本节省: 每年翻译费用砍掉70%。

员工反馈: "以前等翻译等一天,现在点一下,3分钟搞定。

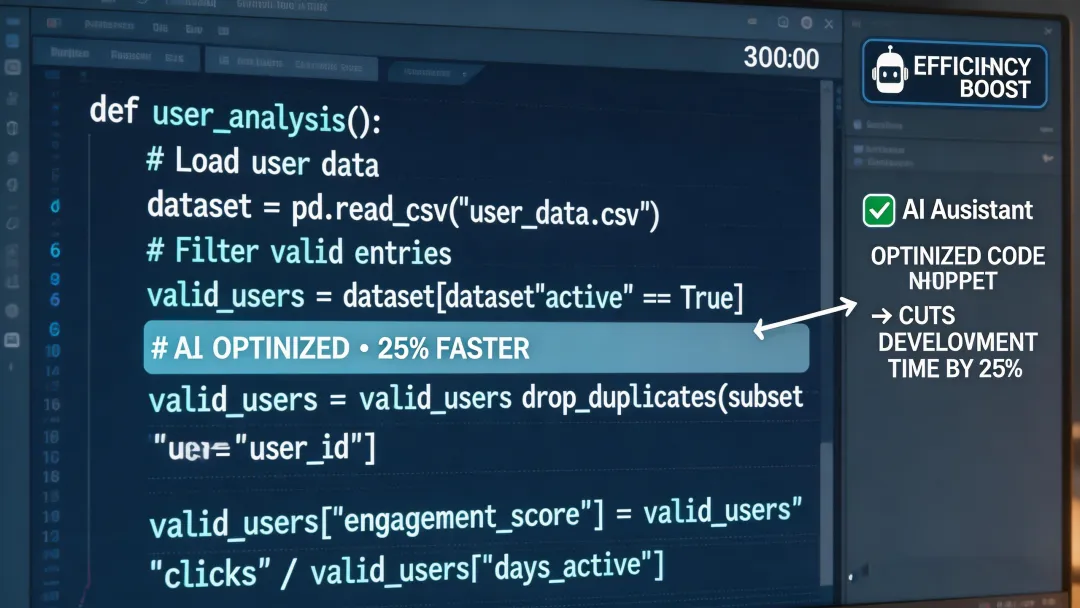

某互联网公司用LLaMA 33B模型当"代码助手"。

数据说话: 代码开发周期:缩短25% bug率:降低18%

文档生成:自动化完成 程序员原话: "这玩意儿比实习生还好用。

硬件门槛降低 核心逻辑: 参数量下降,性能不降。

影响: 硬件门槛降低(普通PC就能部署),个人开发者、小微企业成创新主力。

案例: 某创业团队用LLaMA 7B模型,开发出面向教师的教案生成工具,上线3个月用户破10万。

判断: 如果这趋势持续,2025年可能人手一个"私人AI助手"。

细分赛道 现状: 通用大模型竞争白热化。

机会: 垂直模型成新蓝海。

热门赛道: 医疗:病历分析、辅助诊断

法律:合同审查、法条检索

金融:风险控制、舆情分析

教育:个性化学习方案

关键: 数据闭环 + 行业知识融合。

提醒: 别再做"通用大模型",聚焦细分痛点才有出路。

万物交互 突破点: LLaMA 2已支持文本+图像输入,未来整合音频、视频。

应用场景: 智能驾驶:语音交互

虚拟人:实时对话 内容生成:文字转视频

终极目标: 实现"通用人工智能"雏形。

时间表: 保守估计,3-5年内多模态成标配。