解读:英飞凌 AI 供电七大预测白皮书

以下文章不小心写了近5千字,所以先附上链接,方便各位直接下载原文阅读,无需费事翻到文后, 或者直接私信我:https://www.infineon.cn/gated/infineon-powering-the-future-of-ai-whitepaper-cn_8a000365-842e-4361-ac4a-2574f44f15bb

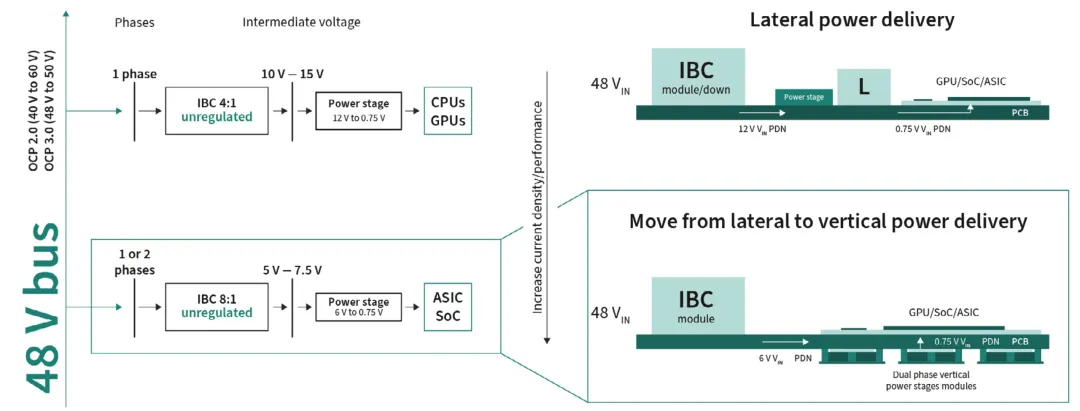

行文之前,先手动给英飞凌点个赞。英飞凌把内部对AI 供电的关键预测浓缩成一份简练的白皮书,有心的人会发现里面干货满满。英飞凌这份白皮书的作者之一Dr. Deboy是英飞凌的传奇人物,他目前是创新中心的主管,主导过很多前沿的项目而且也获得过空前的成功,事后都证明他对未来市场和技术的很多预测是极其精准和有前瞻性的,本人也有幸跟Dr.Deboy交流过几场关于AI供电Hypothesis的讨论,这份白皮书也是他对于AI 供电系统未来预测的高度浓缩,接下来就让我们对这七大预测进行解读,揭秘 AI 算力背后的 “电力革命”。 严格来讲,这已经不算预测了,算是板上钉钉的事了。在刚刚过去的2026 年 GTC 大会上,英伟达发布 Rubin 架构,单芯片功率直接突破2000W,黄仁勋直言 “横向供电已无空间”,正式官宣 Rubin 采用垂直供电(VPD)方案,成为英伟达首款规模化落地垂直供电的 GPU。未来三年,AI行业很大可能还是会继续这样的模式:英伟达负责造梦,其他人负责把梦想实现。老黄此前提出的五层蛋糕模型,在我看来他的潜台词是:这是AI 市场的盛宴,想上桌的人请自行找好自己的生态位。 当然,2000W的Rubin GPU还不是终点,预计28年推出的Feynman的单颗GPU的功率可能达到5kw+。 正如这份白皮书提到的:随着芯片尺寸的不断增大、供电电压降至约 0.4 V,其总电流消耗预计将在十年内攀升至 10,000 A。按照英伟达一贯的激进风格,英飞凌的预测可能还是太过于保守了。但不管怎样,笔者同意英飞凌的预测,垂直供电方案应该是大势所趋了。如下图横向供电和垂直供电的区别(图片来自白皮书) 为什么需要垂直供电,原文没有给出详细的原因,在我看来,原因主要有以下三点:- 损耗剧增 横向供电通过芯片四周的电压调节器供电,电流路径长、寄生电阻大,当电流从千安级迈向万安级,损耗将呈平方级上涨,H100 的横向供电损耗已超 100W,Feynman 若沿用该方案,损耗将突破千瓦级,大量电能转化为热量,不仅降低能效,更会制约芯片性能释放;

- 空间枯竭 H100 已搭载 80GB HBM3 显存,Rubin 和 Feynman 更是将 HBM4 显存拉满,芯片正面的空间被计算单元、显存、互联模块完全占据,横向供电的电压调节器、电感器已无布局空间,“电源线与数据线抢道” 成为必然;

- 瞬态响应失效 AI 算力的负载波动极具瞬态性,训练大模型时电流需求会在毫秒级剧烈变化,横向供电的长路径导致瞬态响应慢,电压跌落、降额问题频发,无法满足 Feynman 等高端 GPU 对小于 1V 的严苛电压容差要求。

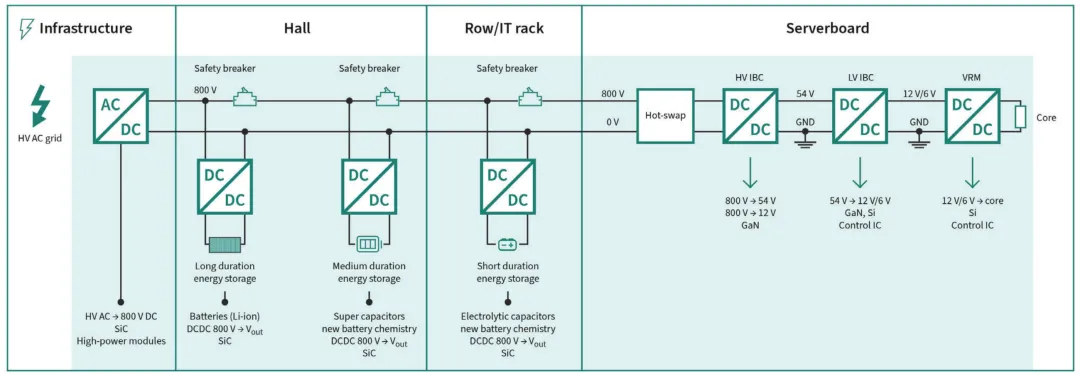

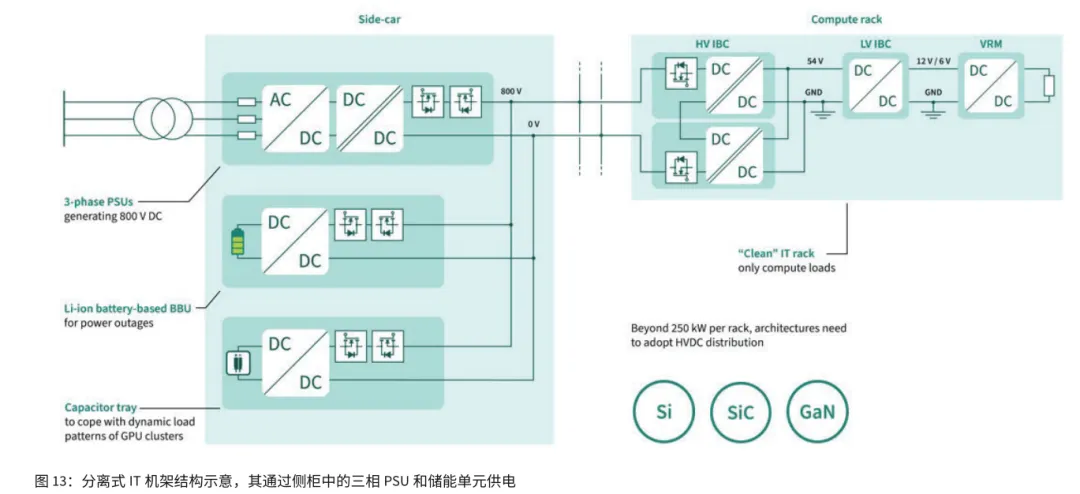

在 AI 向 AGI 演进的过程中,GPU 的功率还将持续增长,万安级电流、万瓦级功率或许只是下一个起点。而垂直供电作为这场算力革命的 “供电基石”,将从高端 GPU 向 TPU、ASIC 等所有 AI 专用芯片全面普及,从 “可选” 逐步变成 “必选”,这属于五层蛋糕第二层芯片层的竞赛。没有可行的供电技术,再强大的芯片也只是空中楼阁。预测 2:服务器主板将采用 HV DC 高压直流供电架构 这里英飞凌有两个关键预测:其一是单机架的功率需求将很快突破 1 兆瓦,其二是当单机架功率达到 200 千瓦至 250 千瓦时,目前主流的48V架构将不再适用,而必须使用800 V 或 ±400 V 架构。材料中展示了800 V DC 的集中发电和高压直流配电的示例,如下图(图片来自白皮书): 英飞凌提出的 200-250kW 临界点,并非凭空设定,而是 48V 架构在 AI服务器机柜功率增长中触达的物理极限,这一点也成为了数据中心行业讨论的核心痛点:

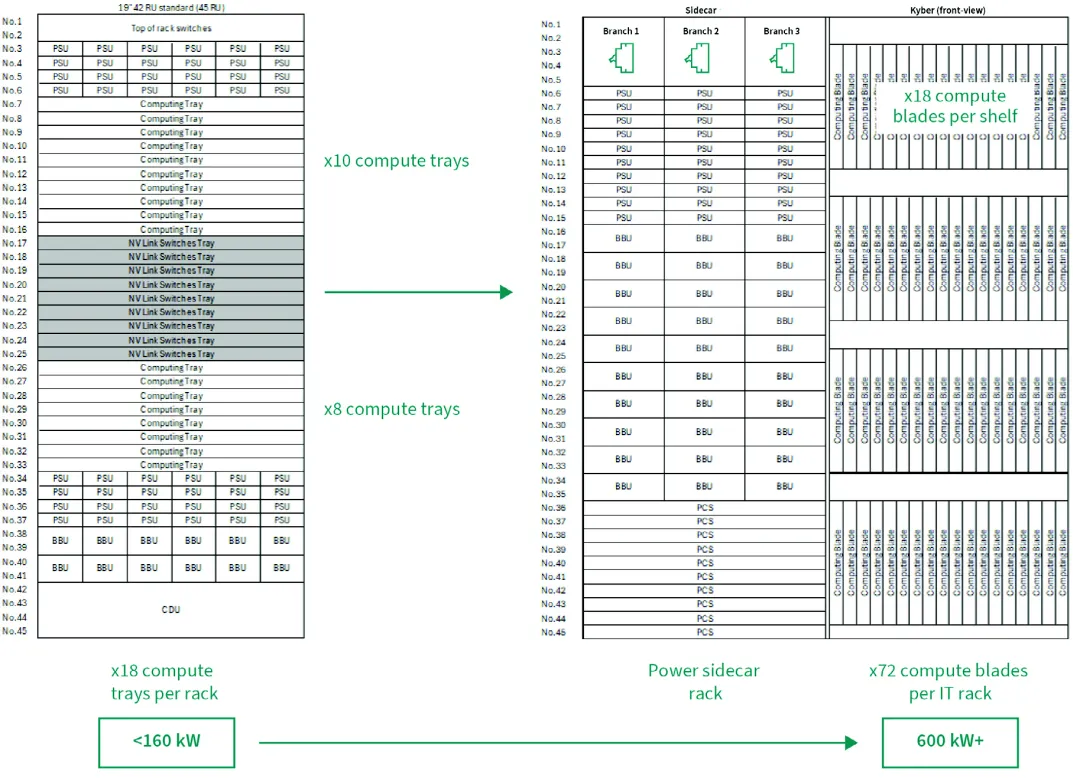

值得注意的是,目前量产的GB200 NVL72的满载功率约为120kW, GB300 NVL72 的满载功率约为140kW, 今年下半年发布的Vera Rubin NVL144 的满载功率预计会达到190kW, 按照英飞凌的预测,800V或 ±400V架构应该首先会出现在英伟达下一代的GPU的架构上,也就是Vera Rubin Ultra GPU 平台上。根据目前英伟达的产品规划来看也符合了这个预测。 说到这里,业界还有一个有趣的讨论。谈及高压直流,行业内的第一反应往往是安全顾虑:更高的电压是否意味着更高的触电、电弧、短路起火风险?关于这个问题,笔者认为:技术的迭代带来了功率增长,而功率增长的解决路径必然是提升电压,这是由物理定律决定的客观事实;而高压带来的特有安全风险,从来都是通过迭代出专属的技术来解决的。换句话说就是:新技术带来的问题,必须由更新的技术来解决。回顾新能源汽车从12V→ 48V→400V→800V→1000V 的电压升级历程,我们也能从中找到答案。AI 机柜将从传统 IT 托盘架构全面升级为刀片服务器,单柜 72 片 GPU 刀片的集群设计,将推动机柜功耗突破1MW;供电、储能、散热等非算力功能,将从主柜剥离至侧柜 / 辅助柜,实现算力与供电的解耦设计。如下图(图片来自白皮书) 记得大概一年前的时候,在英飞凌内部讨论这个概念时,大家都是无比震惊的。彼时,全球主流商用 AI 机柜的功率基线还停留在60-120kW,即便是英伟达顶配的 DGX GB300 机柜,满配功率也仅 140kW。1MW 意味着功率直接翻了 8-16 倍,相当于一个机柜的用电量抵得上一个小型居民社区。但短短一年时间,行业的情绪已经完成了从 “震惊质疑” 到 “冷静拆解”,再到 “全链狂奔” 的彻底反转。 1MW 机柜从电子电力的角度,核心壁垒可以总结成三个核心问题: 空间能不能装得下?电能不能供得上?热能不能散出去?- 空间难题:刀片架构 + 解耦设计,72 片 GPU 布局完全可行 英伟达专为超大规模 AI 训练集群打造的NVL72服务器,已经把传统的42U机柜的空间使用率推到了极限。如上图左侧42U(实际上是45U)的空间部署了柜顶管理交换、集中式供电、算力承载(GPU)、NVLink 高速互联、机柜级储能、液冷散热六大核心功能。其中集中式供电占8U,简单算一下摆放PSU的功率极限是240kW,18U用来放下72颗GPU. 如果想进一步增加单个机柜的算力,一切都得推倒重来。英伟达全新Blade GPU 刀片架构 (如上图右),由两个42U机柜组成:供电侧柜(Power Sidecar)+ 算力机柜(英伟达命名Kyber), Kyber 主柜采用 4 层 shelf(层架)布局,每层可部署 18 片 GPU 算力刀片,全柜合计72 片 Computing Blades(GPU 算力刀片),理论可塞入288颗GPU,按单颗GPU 5kw算, 极限功率是1.44MW。

- 供电难题:解耦架构 + 高压直流,彻底突破电流极限

1MW 功率如果沿用传统 48V 架构,母线电流将突破 20000A,没有任何铜排、接插件能承受如此大的电流。把PSU、BBU、PCS等供电模块全部从主柜剥离,放到侧柜 / 辅助柜中(Sidecar),从侧柜直接输出 800V 高压直流到主板,1MW 功率下母线电流仅 1250A,仅为 48V 架构的 1/16,完全在现有器件的承载范围内。至于在新的架构中,单个PSU会是什么形态,这里暂时不表,留待下个预测讨论。 传统风冷的散热极限仅 30kW / 柜,1MW 的发热量根本散不出去。但现今的液冷技术的商业化落地速度远超预期:冷板式液冷已经能稳定支撑 200kW / 柜的散热需求,浸没式单相 / 两相液冷,更是能轻松实现 1MW / 柜以上的散热能力。目前曙光、高澜、英维克等液冷厂商,均已推出可适配 1MW 机柜的商用浸没式液冷方案,甚至有厂商完成了 1.2MW / 柜的散热测试,散热效率、运维成本、可靠性均已达到商用标准。在黄教主三年1万亿业绩预测的刺激下,相信1MW的散热系统,对于中国厂商来说,那只是小菜一碟吧。 借着这个预测可以先来回顾下PSU近些年的几个关键阶段(这里排除偶然的挖矿机爆火行情下的需求)第一阶段: 在 2020 年之前的传统企业级 IT 时代,服务器电源是一个稳态、低增速、低估值的成熟赛道:

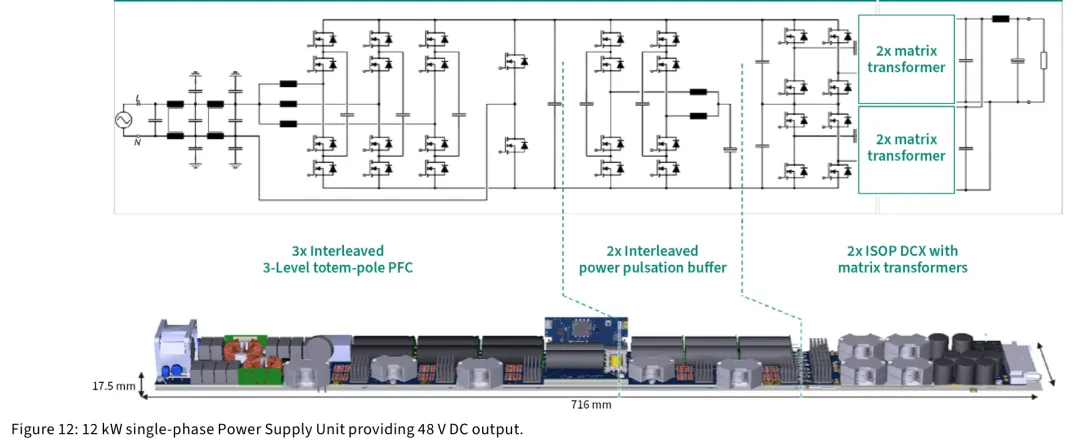

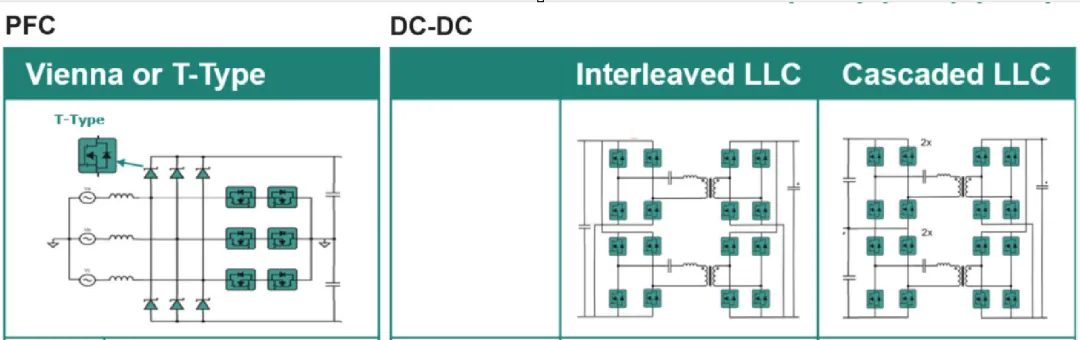

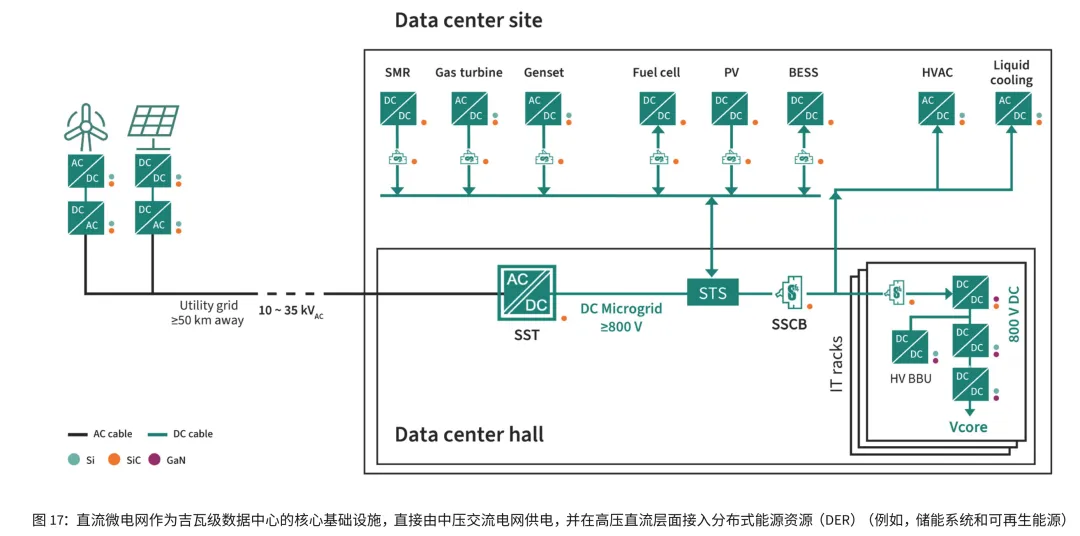

这时候主流产品为单模块 550W、750W、1200W 的单相 CRPS 电源,单台 2U 机架式服务器采用 1+1 冗余配置,整机功耗不超过 1kW。这时候的42U 标准机柜的主流稳态功率仅 5-15kW,上限普遍不超过 20kW,因为42U满打满算也不过能塞不超过20台2U服务器。第二阶段:A100 时代,3.3kW 单相电源成为 AI 服务器标配(2020-2022 年) 英伟达 DGX A100 8 卡服务器整机额定功耗达 3.2kW,传统 1kW 级电源完全无法适配,行业快速推出3.3kW 单相 CRPS 电源,采用 1+1 冗余配置,单台服务器搭载 2 个 3.3kW 模块,刚好满足 8 卡 A100 的供电需求。 这一阶段,AI 机柜的主流功率从 <20kW 跃升至 60-80kW,单柜需要 20-24 个 3.3kW 电源模块。单个1U电源架机柜功率大概也就20kW。第三阶段:H100/H200 时代,12kW 单相电源摸到物理天花板,成为过渡方案(2023-2026 年)随着 H100、H200、GB200 GPU 的落地,单台 8 卡服务器的功耗从 7kW 飙升至 15kW。 至于42U AI 服务器,以目前最新的GB200 NVL72为例,机柜顶部 / 底部分别部署4个电源架,每个电源架可安装6个单相 5.5kW CRPS 电源,总功率5.5*(4+4)=264kW, 按1+1冗余,实际负载也就120kW~132kW。这个故事今年还在延续,行业快速向更高功率的单相电源迭代,如8kW和12kW,以满足最新GPU功率的需求,如更新的GB300, VR200。 如下图(图片来自白皮书)就是资料上显示的12kW 单相电源,笔者认为,这已然是单相服务器电源功率的天花板了:单相220V AC输入下,12kW 额定电流达 54.5A,已经接近国标工业单相插头 63A 的安全电流极限,再往上提升功率,电流会进一步飙升,线缆发热、线路损耗、短路风险将呈指数级增长,完全无法适配更高功率的 AI 机柜。第四阶段:三相电源的时代已然悄悄开启(2027年-) 随着英伟达1MW 算力机柜的规划,三相电源将成为行业新的方向。英飞凌在这份白皮书也给出了自己的答案:每个电源机架用3-4个三相PSU组成大概100kW的功率输出,当每个侧柜安装最多 10 个电源架时,IT 机架的供电能力即可达到 1MW 。如下图(图片来自白皮书): 如下图白皮书还给出了三相电源的基本拓扑,细心的朋友很容易发现,这好像在哪见过。没错,直流充电桩模块大部分用的就是这个拓扑,单个充电桩电源模块的功率已经从一开始的7.5kW提升到如今的80kW,中国厂商表示此类电源毫无压力呀。预测 5:新建数据中心的电力需求将迈向 GW 级规模黄仁勋在本次 GTC 上宣布,英伟达将与微软、亚马逊合作建设首批 “算力工厂”,单座工厂总算力达 100exaFLOPS,峰值功耗突破 5GW,远超当前超大规模数据中心的水平。目前全球已有超 10 座 GW 级 AI 数据中心进入在建阶段,AI 算力的电力需求,正在从 “兆瓦级” 向 “吉瓦级” 跨越式增长。做个简单的计算,目前超大规模数据中心基本部署都是数千个机柜级别的,如果单个机柜是“兆瓦级”的,那超大规模数据中心确实会达到“吉瓦级”预测 6:配电架构将从 AC 转向 DC 直流微电网 三相电源可以把单个机柜堆到1MW,但对于“吉瓦级”的数据中心,这种简单的拼凑就显得过于低效,单是一套散热系统估计就是一项超大工程。所以对于“吉瓦级”的AI 数据中心,要满足能效与运维成本需求,必须对整个供电链条,从电网到芯片的全链路重构。英飞凌在白皮书中给出了自己的答案。如下图(图片来自白皮书): 整个链路简化为:10-35kV 中压交流电网 → 固态变压器(SST) → >800V 高压直流母线 → 全站直流微电网 → IT 机架高压 IBC → 54V/12V 中间电压 → VRM → GPU 核心电压。 这里的核心技术突破在于固态变压器(SST)替代了传统工频降压变压器,可直接从 10-35kV 中压交流电转换为稳定的高压直流电,无需中间降压环节,直接可以砍掉PSU,“没有中间商赚差价”。后面配套的固态断路器(SSCB),可以实现微秒级故障隔离。君不见市场已经嗅到了无限商机,相关股票已经悄然开启上涨行情。预测 7:可再生能源是满足 AI 数据中心能源需求的关键黄教主的AI 七层蛋糕模型把最底层给到了能源,这让我想到了卡尔达肖夫文明指数。在卡尔达肖夫文明体系中,文明层级的跃升,永远需要一个所谓的“技术载体”,把人类能掌控的能源转化为文明的实际进步:蒸汽机把化石能源转化为工业生产力,电力把能源转化为全球化的沟通与协同,而 AI,正在把能源转化为硅基智能,也就是黄教主口中的Token。AI 的指数级增长正在推动能源的指数级需求,而能源的指数级需求正在倒逼人类文明的跃迁。或许不远的将来,戴森球不再只能是出现在科幻小说或电影里......