国内外互联网大厂AI、算力与芯片布局深度调研系列之字节跳动 AI、算力与芯片布局深度调研分析及前瞻规划洞察报告

100页PPT 小红书AI大模型、算力及芯片业务专项调研及前瞻洞察分析报告.pptx

100页PPT 蚂蚁集团AI大模型、算力及芯片业务专项调研及前瞻洞察分析报告.pptx

133页PPT 腾讯公司AI大模型、算力及芯片业务专项调研及前瞻洞察分析报告.pptx

190页PPT 阿里巴巴公司AI大模型、算力及芯片业务专项调研及前瞻洞察分析报告.pptx

140页PPT 百度公司AI大模型、算力及芯片业务专项调研及前瞻洞察分析报告.pptx

133页PPT 字节跳动公司AI大模型、算力及芯片业务专项调研及前瞻洞察分析报告.pptx

102页PPT 谷歌GOOGLE公司AI大模型、算力及芯片业务专项调研及前瞻洞察分析报告.pptx

72页PPT Meta公司AI大模型、算力及芯片业务专项调研及前瞻洞察分析报告.pptx

第一章字节跳动自研芯片的战略布局与技术落地

在全球 AI 产业进入算力军备竞赛的核心阶段,大模型训练与推理带来的指数级算力需求,已成为互联网科技巨头核心竞争的底层战场。字节跳动作为国内 AI 产业的头部玩家,旗下豆包大模型日均 Tokens 使用量已突破 50 万亿,居中国第一、全球第三,视频生成模型 Seedance 2.0 实现工业级影视内容创作能力的突破,抖音、TikTok 两大国民级应用每日产生百亿级的视频处理与智能推荐算力需求,使得算力成本、供应链安全与软硬件协同能力,成为决定其 AI 业务长期竞争力的核心要素。

在此背景下,字节跳动自 2020 年启动芯片自研计划以来,历经六年时间完成了从技术探索到全产品线布局的跨越,形成了覆盖 AI 推理、通用计算、视频处理、网络加速四大场景的芯片矩阵,成为国内互联网企业中全栈式芯片布局速度最快的样本之一。本章将基于字节跳动芯片业务的一手产业信息,从产品线矩阵、研发体系、量产进展、战略规划与资本投入四大维度,全面拆解其自研芯片的布局逻辑与落地现状,所有数据与事实均来自本次调研所获取的官方文档与产业权威信源,确保内容的真实性与严谨性。

1.1 自研芯片产品线矩阵与核心技术架构

字节跳动的芯片自研并非单点技术突破,而是围绕自身业务场景与 AI 全栈能力构建的体系化布局,其产品线设计完全贴合集团 “AI 优先” 的核心战略,形成了与抖音、豆包、火山引擎等核心业务深度绑定的差异化技术路径。本章节将从业务发展沿革、产品线矩阵、技术架构设计三个层面,全面梳理字节跳动自研芯片的技术布局全貌。

1.1.1 字节跳动芯片业务的发展沿革与战略演进

字节跳动的芯片自研之路并非一蹴而就,而是伴随自身 AI 业务的发展逐步深化,整体历程可划分为三个核心阶段,每个阶段的战略重心与业务布局均与集团整体发展节奏高度契合。

第一阶段:技术探索与团队筹备期(2020 年 - 2022 年)

2020 年,字节跳动正式启动代号为 “硅基” 的芯片自研计划,标志着其正式进入芯片自研领域,这一时间点早于市场普遍认知的生成式 AI 爆发期,体现了集团对算力底层技术的长期布局思路。这一阶段的核心动作集中在团队搭建与技术预研,字节跳动开始系统性招募芯片领域的核心研发人才,同时针对自身业务场景的算力痛点进行技术可行性验证。

2022 年,字节跳动开启了芯片工程师的大规模招聘,为后续的芯片项目落地储备核心人才,截至 2022 年底,其芯片研发团队已完成初步的组织搭建,形成了针对视频处理、AI 加速两大核心方向的预研小组。这一阶段的战略核心,是解决 “要不要做芯片” 的战略决策问题,通过对抖音视频处理、推荐算法等核心业务的算力需求拆解,明确了自研芯片的业务价值与技术方向,为后续的规模化投入奠定了基础。

第二阶段:联合研发与多线布局期(2023 年 - 2024 年)

2023 年,随着ChatGPT 的发布,全球生成式 AI 产业迎来爆发,字节跳动旗下大模型团队 Seed 正式成立,豆包大模型进入快速迭代期,算力需求呈现指数级增长,自研芯片的战略优先级被大幅提升。这一阶段,字节跳动采取了 “联合研发 + 自主预研” 双轨并行的策略,一方面与国际头部芯片设计企业合作,快速掌握高端 AI 芯片的设计方法论;另一方面持续扩充自研团队,完成多场景芯片的产品线规划。

2024 年 6 月,路透社首次披露,字节跳动与美国芯片设计公司博通(Broadcom)合作开发先进 AI 处理器,制造环节原计划外包给台积电,这一合作项目聚焦于高端 AI 训练芯片的研发,旨在解决大模型训练环节的算力瓶颈。同年,The Information 披露,字节跳动制定了明确的芯片自研目标,计划在 2026 年前量产两款自研 AI 芯片,一款用于 AI 训练场景,一款用于 AI 推理场景,预计通过自研芯片节省数十亿美元的算力采购成本,这一规划标志着字节跳动芯片自研从技术预研进入了正式的产品落地阶段。

在这一阶段,字节跳动的芯片布局从单一的 AI 加速场景,拓展到了数据中心全场景算力芯片,VPU(视频处理单元)、DPU(数据处理单元)、服务器 CPU 三大产品线相继启动研发,其中 VPU 芯片率先完成规模化部署,支撑抖音、TikTok 的视频解码与内容审核业务,成为字节跳动首款实现商用落地的自研芯片。

第三阶段:全栈布局与量产攻坚期(2025 年 - 2026 年至今)

2025 年以来,字节跳动的芯片自研进入了全面加速阶段,核心特征是团队规模快速扩张、组织架构持续优化、产品线全面成型、核心产品进入流片与量产攻坚期。2025 年初,前 Google DeepMind 研究副总裁吴永辉加入字节跳动,担任 Seed 团队一号位,主导大模型基础研究,同时字节跳动将 AI Lab、AI for Science 等核心研究团队并入 Seed 部门,实现了大模型研发与芯片研发的组织协同,为软硬件协同优化奠定了组织基础。

2025 年下半年至2026 年初,字节跳动完成了芯片业务的核心组织架构调整,芯片研发团队规模突破千人,形成了覆盖 AI、CPU、视频与网络四大场景的完整产品线,标志着其芯片自研进入了全栈式布局的成熟阶段。2026 年 2 月,路透社独家披露,字节跳动自研的 AI 推理芯片 SeedChip 已进入流片倒计时,计划于 2026 年 3 月底前获取首批工程样片,年内实现规模化量产,这一事件成为字节跳动芯片自研历程中的关键里程碑,标志着其核心 AI 芯片正式进入商用落地的前夜。

截至 2026 年 2 月,字节跳动已完成 “四大核心产品线 + 全场景覆盖” 的芯片布局,从 AI 推理到通用计算,从视频处理到网络加速,形成了与自身业务场景高度匹配的芯片矩阵,成为国内互联网企业中除阿里巴巴、百度之外,少数具备全栈式芯片自研能力的科技巨头。

1.1.2 四大核心产品线的完整布局与技术定位

自 2020 年 “硅基” 计划启动以来,字节跳动历经六年研发,已形成四大核心芯片产品线,分别为AI 推理芯片(SeedChip)、服务器 CPU 芯片、VPU 视频处理单元芯片、DPU 数据处理单元芯片,四大产品线分别对应 AI 大模型、数据中心通用计算、短视频内容处理、数据中心网络加速四大核心场景,形成了覆盖数据中心算力全环节的芯片布局。相关产品线的详细信息、技术定位与应用场景,均来源于《字节自研芯片团队超千人已形成四大产品线.pdf》(文档 id=26)、《字节跳动芯片战略全面提速团队破千架构调整 SeedChip 即将流片 2026 年 AI 投入 1600 亿.pdf》(文档 id=33)、《字节芯片隐秘布局智能涌现独家.pdf》(文档 id=34)等核心调研文档。

1.1.2.1 AI 推理芯片产品线:SeedChip

SeedChip 是字节跳动自研芯片体系中的核心旗舰产品,也是集团投入资源最多、战略优先级最高的芯片项目,其项目代号直接来源于字节跳动旗下负责大模型研发的 Seed 团队,体现了该芯片与豆包大模型深度绑定的设计理念。

产品定位与核心应用场景

SeedChip 是一款专为 AI 推理任务设计的定制化ASIC 芯片,核心定位是服务于字节跳动内部海量的 AI 推理算力需求,同时为火山引擎 MaaS 业务提供底层算力支撑。根据《字节跳动 SeedChip 自研芯片信息汇总.pdf》(文档 id=37)披露,该芯片的核心应用场景包括四大类:一是豆包大模型的实时对话推理、多模态内容生成推理需求;二是抖音、TikTok 的短视频推荐算法实时推理需求,这也是字节跳动最大的算力消耗场景之一;三是抖音电商智能客服、内容审核等场景的 AI 推理需求;四是火山引擎对外提供的大模型公有云服务调用需求,支撑其国内 49.2% 的大模型服务调用市场份额。

区别于通用 GPU 芯片,SeedChip 从设计之初就完全围绕字节跳动自身的推理业务场景进行定制化开发,而非追求全场景的通用能力。字节跳动旗下 TikTok 的推荐算法、豆包 Chatbot、火山引擎云服务每天消耗的推理算力是天文数字,通用 GPU 在这些特定场景中存在大量的算力浪费与能效比不足的问题,而 SeedChip 通过场景化定制,能够在核心业务场景中实现更高的能效比与更低的单位算力成本,这也是其核心设计目标。

核心技术架构与设计特点

关于 SeedChip 的核心技术架构,本次调研获取的文档中披露了其核心设计理念与技术特征,核心信息来源于《字节跳动造芯突围战.pdf》。

- 场景化定制的算子优化架构:SeedChip 采用了 “算法定义芯片” 的设计理念,将字节跳动大模型推理、推荐算法中高频使用的算子直接固化在硬件底层,实现了算法与芯片架构的深度融合。通过这种定制化设计,芯片在处理字节核心业务场景的推理任务时,能够大幅减少通用计算带来的性能损耗,将能效比提升 3-5 倍,单位算力成本降低 50% 以上,即便单枚芯片的通用性能略逊于英伟达旗舰 GPU,在规模化部署后的总拥有成本(TCO)也具备显著优势。

- HBM 高带宽内存集成设计:SeedChip 在架构设计中深度集成了 HBM 高带宽内存,以匹配大模型推理带来的海量数据吞吐需求。字节跳动在与三星电子的代工谈判中,将 HBM 内存的稳定供应作为核心合作条件,正是为了保障 SeedChip 的内存带宽需求,这也是当前高端 AI 芯片的核心技术门槛之一。三星作为全球最大的 HBM 内存厂商,能够同时提供 “先进制程代工 + HBM 内存供应 + 2.5D 封装” 的一站式服务,这也是字节跳动选择三星作为主力代工厂的核心原因。

- 软硬件协同优化架构:SeedChip 从设计阶段就与豆包大模型的研发团队深度协同,实现了芯片架构与大模型架构的联合优化。字节跳动 Seed 团队不仅负责大模型的研发,同时也深度参与芯片的需求定义与架构设计,确保芯片能够最大化适配豆包大模型的推理特性,这种 “模型 - 芯片” 协同设计的模式,能够大幅提升大模型在自研芯片上的运行效率,这也是区别于第三方通用芯片的核心优势。

- 高可扩展性的集群部署架构:SeedChip 在架构设计中充分考虑了规模化集群部署的需求,针对数据中心万卡级集群的通信延迟、算力调度等问题进行了专项优化,能够与字节跳动自研的 DPU 芯片实现深度协同,大幅降低大规模推理集群的通信延迟,提升集群整体的算力利用率。

1.1.2.2 服务器 CPU 产品线:数据中心通用计算核心

服务器 CPU 是字节跳动芯片布局中的重要基础板块,也是其构建自主可控数据中心算力体系的核心环节,该产品线的核心信息来源于《字节自研芯片团队超千人已形成四大产品线.pdf》、《字节跳动芯片团队扩张已有上千人.pdf》。

产品定位与核心应用场景

字节跳动自研服务器 CPU 的核心定位是面向数据中心通用计算场景,为其全球布局的 IDC 数据中心提供自主可控的通用算力底座,核心应用场景包括:一是火山引擎公有云服务的通用计算实例;二是字节跳动内部业务的通用服务器算力需求,包括大数据处理、业务系统部署、中间件运行等非 AI 加速的通用计算场景;三是与自研 AI 芯片、DPU 芯片形成协同,构建完整的服务器算力体系。

研发进展与团队配置

截至 2026 年 2 月,字节跳动服务器 CPU 研发团队规模已达到 200 人左右,在整个芯片研发团队中占比约 20%,是仅次于 AI 芯片团队的第二大研发团队。该产品线已开展多轮架构验证,完成了核心架构的技术预研与可行性验证,进入了详细设计与流片准备阶段,是字节跳动继 AI 芯片、VPU 芯片之后,第三个重点推进的芯片项目。

从战略定位来看,自研服务器 CPU 是字节跳动实现数据中心算力全栈自主可控的关键环节。当前国内互联网厂商的数据中心 CPU 高度依赖英特尔、AMD 等海外厂商,供应链安全存在潜在风险,同时通用 CPU 的采购成本也是数据中心基础设施支出的重要组成部分。字节跳动通过自研服务器 CPU,不仅能够实现核心算力的自主可控,还能够通过场景化定制优化,提升内部业务场景的运行效率,降低通用算力的采购成本。

1.1.2.3 VPU 视频处理单元产品线:视频场景专用算力底座

VPU(视频处理单元)是字节跳动首款实现规模化商用落地的自研芯片,也是其芯片布局中商业化成熟度最高的产品线,核心信息来源于《字节自研芯片团队超千人已形成四大产品线.pdf》、《字节跳动芯片战略全面提速团队破千架构调整 SeedChip 即将流片 2026 年 AI 投入 1600 亿.pdf》。

产品定位与核心应用场景

字节跳动自研 VPU 芯片的核心定位是面向短视频场景的专用视频处理芯片,核心服务于抖音、TikTok 两大短视频平台的业务需求,具体应用场景包括三大类:一是高清视频的编解码处理,支撑抖音、TikTok 平台上海量的短视频上传、转码、播放需求;二是视频内容的 AI 智能审核,通过硬件加速实现视频内容的实时检测与审核;三是视频特效的硬件加速,支撑剪映、CapCut 等视频编辑工具中的 AI 特效、视频编辑功能。

技术特点与商用落地情况

字节跳动作为全球最大的短视频平台运营方,其旗下抖音、TikTok 每日需要处理的视频数量达到百亿级,传统的通用视频编解码芯片无法完全匹配其海量、高并发的视频处理需求,这也是其自研 VPU 芯片的核心动因。自研 VPU 芯片针对字节跳动自身的视频编解码协议、视频格式、AI 审核算法进行了深度定制优化,相比通用芯片,在视频处理效率、能效比、并发处理能力上均有显著提升,同时大幅降低了视频处理的单位成本。

截至 2026 年 2 月,该 VPU 芯片已实现规模化部署与商用,峰值日处理视频量超百亿条,全面支撑了抖音、TikTok 全球业务的视频处理需求,成为字节跳动芯片自研中首个实现全量业务落地的产品线,也为后续其他芯片的研发与商用积累了丰富的工程化经验。

1.1.2.4 DPU 数据处理单元产品线:数据中心网络加速核心

DPU(数据处理单元)是字节跳动数据中心算力体系的重要配套板块,核心聚焦于数据中心的网络卸载与加速,是支撑其大规模 AI 算力集群的关键基础设施,相关信息来源于《字节自研芯片团队超千人已形成四大产品线.pdf》。

产品定位与核心应用场景

字节跳动自研 DPU 芯片的核心定位是数据中心网络与存储加速专用芯片,通过硬件卸载的方式,将服务器 CPU 从网络协议处理、存储虚拟化、安全隔离等复杂的基础设施任务中解放出来,提升服务器的有效算力利用率,核心应用场景包括:一是大规模 AI 算力集群的 RDMA 网络加速,降低大模型训练与推理集群的通信延迟;二是火山引擎云服务的虚拟化、网络隔离、存储加速等场景;三是字节跳动全球数据中心的内部网络优化,提升跨区域数据传输的效率。

技术指标与研发进展

根据调研文档披露,字节跳动自研 DPU 芯片能够将数据中心的网络通信延迟降低 30% 以上,同时大幅提升服务器 CPU 的有效算力利用率,在万卡级 AI 算力集群中,能够显著提升集群的线性加速比,是支撑其大模型训练与推理业务的关键配套芯片。

截至 2026 年 2 月,该 DPU 芯片已完成多轮技术迭代与测试,与自研 AI 推理芯片 SeedChip、服务器 CPU 形成了技术协同,能够共同构建完整的服务器算力体系。同时,该芯片也已在火山引擎的部分数据中心完成试点部署,进入了规模化商用的前期准备阶段。

1.1.3 芯片核心技术架构的设计理念与差异化特征

字节跳动的芯片自研并非简单对标海外巨头的通用芯片产品,而是形成了一套贴合自身业务特点与 AI 战略的设计理念,在架构设计上呈现出鲜明的差异化特征,与阿里巴巴、百度等国内同行的芯片布局形成了明显的区隔。本章节将全面拆解其芯片架构的核心设计理念与差异化优势,相关信息来源于《字节自研芯片团队超千人已形成四大产品线.pdf》、《字节跳动造芯突围战.pdf》、《字节跳动 SeedChip 自研芯片信息汇总.pdf》、《液冷成 AI 算力刚需字节全链条布局架构技术供应链一次看懂.pdf》等调研文档。

1.1.3.1 算法定义芯片:业务场景深度定制的架构设计

“算法定义芯片” 是字节跳动芯片自研最核心的设计理念,也是其区别于传统芯片厂商的最本质特征。传统芯片厂商的设计逻辑是 “先做通用芯片,再寻找应用场景”,而字节跳动完全颠覆了这一逻辑,采用 “先明确业务场景与算法需求,再反向定义芯片架构” 的定制化设计思路,这一理念贯穿了其四大产品线的全流程设计。

接近字节跳动高层的业内人士在《字节自研芯片团队超千人已形成四大产品线.pdf》中明确评价:“芯片与云、算法、内容场景深度融合,才能形成可持续的算力护城河。” 这一评价精准概括了字节跳动芯片设计的核心逻辑。在具体的设计实践中,这一理念主要体现在三个层面:

- 需求定义完全来自内部业务场景:字节跳动所有自研芯片的需求定义,均来自抖音、豆包、火山引擎等内部核心业务的真实算力痛点,而非追求行业通用的性能指标。例如 SeedChip 的核心需求,完全来自豆包大模型的推理场景、抖音推荐算法的实时计算场景,芯片的架构设计、算子优化、性能指标均围绕这些场景进行定制,不追求无关的通用性能,从而实现了能效比的最大化。

- 高频算法算子的硬件固化:针对内部业务场景中高频使用的算法算子,字节跳动在芯片设计中直接将其固化为硬件电路,而非通过软件在通用计算单元中运行,从而大幅提升了算子的执行效率,降低了算力损耗。例如,在 VPU 芯片中,针对抖音视频审核中高频使用的 AI 检测算子进行了硬件固化,使得视频审核的处理效率提升了数倍;在 SeedChip 中,针对大模型推理中的 Transformer 算子、推荐算法中的协同过滤算子进行了深度硬件优化,大幅提升了核心场景的算力效率。

- 全链路的场景化性能优化:字节跳动的芯片设计不仅关注芯片本身的性能指标,更关注芯片在实际业务场景中的端到端性能表现。例如,在 SeedChip 的设计中,团队不仅优化了芯片的峰值算力,更针对大模型推理的端到端延迟、并发处理能力、长上下文处理效率等实际业务指标进行了专项优化,确保芯片在真实的业务场景中能够发挥最大价值,而非仅仅在理论测试中取得高分。

1.1.3.2 软硬件协同:大模型与芯片底层的深度融合

软硬件协同优化是字节跳动芯片架构设计的第二大核心理念,也是其作为互联网科技巨头,相比传统芯片厂商最大的优势所在。字节跳动同时掌握了大模型算法、应用场景、芯片设计三大环节的核心能力,能够实现从算法到硬件的全链路协同优化,这也是其自研芯片能够实现差异化竞争力的核心基础。

在《字节跳动 SeedChip 自研芯片信息汇总.pdf》中明确指出,AI 竞争的下半场是系统级竞争,字节跳动的 Seed 部门不仅做大模型,更在做 “软硬一体” 的垂直整合,通过自研芯片,将算法算子直接固化在硬件底层,实现大模型与芯片的深度融合。这种垂直整合带来的体验提升,是单纯购买通用芯片无法比拟的,尤其在 AI 视频生成等高负载场景中尤为关键。

具体来看,字节跳动的软硬件协同优化主要体现在三个维度:

- 组织层面的协同:芯片与大模型团队的深度整合:2025 年以来,字节跳动完成了核心研发组织的架构调整,将 AI Lab 等核心研究团队并入负责大模型研发的 Seed 部门,同时芯片研发团队与 Seed 团队建立了直接的协同汇报机制,实现了大模型研发与芯片研发的组织打通。在 SeedChip 的研发过程中,大模型团队全程参与芯片的需求定义、架构设计、测试验证全流程,确保芯片架构能够最大化适配豆包大模型的技术特性,从组织层面保障了软硬件协同的落地。

- 技术层面的协同:模型架构与芯片架构的联合设计:字节跳动打破了 “先有模型,再适配芯片” 的传统模式,开启了 “模型与芯片联合设计” 的新模式。在豆包大模型的迭代过程中,研发团队会充分考虑自研芯片的架构特性,在模型结构设计、算子优化、量化压缩等环节,针对芯片的硬件特性进行专项优化;同时,芯片设计团队也会根据大模型的迭代方向,提前在芯片架构中预留优化空间,实现模型与芯片的双向适配、联合优化。这种联合设计模式,能够最大化释放软硬件的综合性能,相比通用芯片 + 通用模型的组合,能够实现数量级的效率提升。

- 系统层面的协同:从芯片到应用的全栈优化:字节跳动的软硬件协同不仅局限于大模型与芯片层面,更延伸到了从底层硬件到上层应用的全栈体系。例如,在视频场景中,实现了 VPU 芯片、剪映 / CapCut 应用、抖音平台的全链路协同优化,视频特效、编辑功能从设计之初就考虑了自研 VPU 芯片的硬件加速能力,实现了 “应用 - 算法 - 芯片” 的全链路打通;在 AI 云场景中,实现了 SeedChip 芯片、豆包大模型、火山引擎 MaaS 平台的全栈优化,为企业客户提供了从底层算力到上层应用的一体化解决方案,大幅提升了 AI 服务的性能与稳定性。

1.1.3.3 全栈式布局:从端到云的算力芯片体系构建

字节跳动芯片布局的第三个核心理念,是构建覆盖 “云 - 边 - 端” 全场景的全栈式算力芯片体系,而非单点的芯片产品突破。从四大产品线的布局可以看出,字节跳动的芯片自研并非只聚焦于 AI 加速这一个单点,而是覆盖了数据中心通用计算、AI 加速、视频处理、网络加速等数据中心全场景算力需求,同时逐步向端侧芯片延伸,形成了完整的算力芯片布局。

从云侧来看,字节跳动通过 AI 推理芯片、服务器 CPU、DPU 芯片、VPU 芯片四大产品线,构建了数据中心完整的算力芯片矩阵,能够实现数据中心算力的全栈自主可控。其中,服务器 CPU 是通用算力核心,AI 芯片是智能算力核心,DPU 芯片是网络与存储算力核心,VPU 芯片是视频处理算力核心,四大芯片相互协同,共同构成了字节跳动数据中心的算力底座,能够完全支撑其内部业务与火山引擎云服务的全场景算力需求。

从端侧来看,字节跳动也已启动了端侧 AI 芯片的布局,围绕智能硬件、移动端场景进行专用芯片的研发。根据调研文档披露,字节跳动已为 PICO 头显研发了专用芯片,该芯片已进入量产阶段,能够将 MR 系统延迟压缩至约 12 毫秒;同时,其为 Ola Friend 智能耳机、智能台灯、AI 玩具 “显眼包” 等智能硬件产品,也配套研发了专用的端侧 AI 加速芯片,实现了端侧 AI 能力的本地化运行。

这种 “云 - 端一体” 的全栈式芯片布局,使得字节跳动能够实现从云端数据中心到终端智能硬件的全链路算力自主可控,同时实现云端大模型与端侧芯片的协同优化,为其 AGI 长期战略提供了完整的硬件底座支撑。这一布局思路与谷歌、亚马逊等全球科技巨头的芯片战略高度一致,体现了字节跳动在算力底层布局上的长期主义与全局视野。

1.2 芯片研发体系与量产落地进展

芯片自研是一项长周期、高风险、重投入的系统工程,完善的研发体系、高效的组织管理、稳定的供应链保障,是芯片产品从设计图纸走向规模化商用的核心保障。字节跳动历经六年的芯片研发探索,已构建起一套完整的芯片研发组织体系、管理机制与供应链体系,核心产品线也已进入量产落地的关键阶段。本章节将从研发组织架构、研发管理体系、量产落地进展、供应链建设四个维度,全面拆解字节跳动芯片研发的落地执行体系。

1.2.1 芯片研发组织架构与核心团队建设

芯片研发的核心竞争力归根结底来自于人才与组织,字节跳动能够在短短六年时间内完成四大芯片产品线的布局,核心得益于其快速扩张的高素质研发团队与持续优化的组织架构。本章节将全面梳理其芯片研发团队的规模结构、组织架构调整与核心管理团队体系,相关信息来源于《字节自研芯片团队超千人已形成四大产品线.pdf》、《字节芯片隐秘布局智能涌现独家.pdf》、《字节跳动芯片战略全面提速团队破千架构调整 SeedChip 即将流片 2026 年 AI 投入 1600 亿.pdf》等核心调研文档。

1.2.1.1 研发团队规模与人员结构

截至 2026 年 2 月,字节跳动芯片研发团队的整体规模已正式突破 1000 人,成为国内互联网企业中规模最大的芯片自研团队之一,团队规模较 2022 年实现了数倍的增长。这一团队规模,也印证了字节跳动在芯片自研上的坚定决心与大规模投入。

从人员结构来看,字节跳动的芯片研发团队呈现出 “核心方向重点倾斜,全链条能力完整覆盖” 的特征,具体人员配置如下:

- AI 芯片研发团队:是整个芯片研发体系中规模最大的团队,研发人员数量超过 500 人,占整个芯片团队总人数的 50% 以上,核心负责 SeedChip AI 推理芯片、AI 训练芯片的研发工作。该团队汇聚了来自英伟达、AMD、博通、华为海思、寒武纪等国内外头部芯片企业的核心研发人才,覆盖了芯片架构设计、前端设计、后端设计、验证、DFT、封装测试等芯片研发全流程的核心岗位,具备完整的高端 AI 芯片全流程设计能力。

- 服务器 CPU 研发团队:团队规模约 200 人,在整个芯片团队中占比约 20%,核心负责数据中心服务器 CPU 的架构设计与研发工作。该团队核心成员主要来自英特尔、AMD、ARM、华为海思等国内外头部 CPU 设计企业,具备丰富的高端服务器 CPU 研发经验,已完成多轮 CPU 架构的设计与验证工作。

- VPU 与 DPU 研发团队:两大团队构成了芯片研发体系的其余核心力量,其中 VPU 团队是字节跳动最早成立的芯片研发团队,具备成熟的芯片设计与规模化商用经验;DPU 团队则聚焦于数据中心网络加速芯片的研发,与 AI 芯片团队形成了紧密的技术协同。两大团队均实现了芯片研发全流程的能力覆盖,能够独立完成芯片的设计、验证、流片与商用落地全流程工作。

从人才梯队建设来看,字节跳动芯片团队不仅引入了行业资深专家,同时也建立了完善的年轻人才培养体系,通过校园招聘、顶尖人才计划等方式,吸纳了大量芯片领域的顶尖应届毕业生,形成了 “资深专家 + 青年人才” 的梯队化团队结构,为芯片业务的长期发展提供了持续的人才保障。

133页PPT 字节跳动公司AI大模型、算力及芯片业务专项调研及前瞻洞察分析报告.pptx

133页PPT 字节跳动公司AI大模型、算力及芯片业务专项调研及前瞻洞察分析报告.pdf

1页-消息称字节跳动计划斥资1600亿元大举投资人工智能850亿元砸向AI处理器.pdf

2页-SeedChip计划浮出水面字节跳动的芯片野望与算力突围10万颗量产在即试图打破英伟达依赖症.pdf

2页-天下苦英伟达久矣字节跳动被曝自研芯片成功已量产.pdf

2页-炸裂字节跳动估值5500亿美元.pdf

2页-专家调研双雄竞逐路径分野字节跳动与腾讯AI战略全景深度对比.pdf

2页-字节明年千亿加码AI预留850亿囤芯片.pdf

2页-字节跳动大战BAT从中国互联网巨头看伟大公司的兴衰算法人性与战略的终极较量.pdf

2页-字节跳动预计2026年AI基础设施投入1600亿.pdf

2页-字节自研AI芯片最新进展.pdf

2页-字节自研芯片团队超千人已形成四大产品线.pdf

3页-深挖字节跳动2025底牌2000亿营收目标背后的内战与突围.pdf

3页-字节SeedChip三星代工HBM.pdf

3页-字节跳动芯片团队扩张已有上千人.pdf

3页-字节跳动造芯突围战.pdf

4页-开年狂甩两王炸张一鸣在下一盘大棋.pdf

4页-梁汝波字节跳动2026年要勇攀高峰持续提高人才密度加大激励.pdf

4页-字节跳动芯片战略全面提速团队破千架构调整SeedChip即将流片2026年AI投入1600亿.pdf

4页-字节芯片隐秘布局智能涌现独家.pdf

5页-豆包凶猛深度解析字节AI战略.pdf

5页-说一句实话现在的字节比你想象得更可怕.pdf

5页-字节跳动SeedChip自研芯片信息汇总.pdf

6页-37万亿字节最新估值曝光13年涨9166倍.pdf

6页-算力硬件不要慌字节提高26年资本支出计划2万亿美金俱乐部有哪些成员.pdf

7页-从字节跳动看AIGC产业链布局.pdf

7页-炸了估值飙到38000亿的字节藏着张一鸣的终极野心.pdf

7页-字节在AI领域到底有多拼.pdf

8页-字节豆包大模型行业专题:豆包大模型崛起,国产算力链有望受益-上海证券.pdf

10页-20260213-兴业证券-计算机行业:Seedance2.0发布,国产多模态迎DS时刻.pdf

10页-液冷成AI算力刚需字节全链条布局架构技术供应链一次看懂.pdf

22页-传媒行业GenAI系列报告之66:字节AI,流量突围,MaaS及应用抢先-申万宏源.pdf

23页-20250722-东方证券-传媒行业AI产业研究系列(一)字节跳动AI底层架构篇:基模领先,组织财务双保障,占领AI时代高地.pdf

23页-字节(陈秋利):开发者体验驱动-上百个研发工具的知识管理实践.pdf

28页-20250720-华创证券-计算机行业深度研究报告:字节跳动,深度布局AIGC,竞逐新一轮技术浪潮.pdf

30页-汪喆:字节跳动资源画像和时间序列预测的运营实践.pdf

30页-字节AI深度:矢志登万仞,厚积起风云-长江证券.pdf

31页-苗永昌:字节跳动Kubernetes集群2w+节点性能优化实战.pdf

33页-2025年豆包大模型Seedream 2.0技术报告:原生中英双语图像生成模型(英文版)-字节跳动.pdf

37页-万字字节AI全景从豆包到全系产品布局的秘密.pdf

39页-彭璟雯:字节跳动FaaS的WebAssembly实践.pdf

47页-AI商业化的旗手:不止豆包的字节跳动-海通国际.pdf

71页-字节跳动:CloudWeGo 技术白皮书- 字节跳动云原生微服务架构原理与开源实践.pdf

101页-20260223-东吴证券-电子行业深度报告:2026年端侧AI产业深度,应用迭代驱动终端重构,见证端侧SoC芯片的价值重估与位阶提升.pdf

20260224-爱建证券-电子行业跟踪报告:字节跳动发布Seedance 2.0.pdf

20260308-中信建投-传媒行业:字节跳动系列之—Seedance的前世今生.pdf

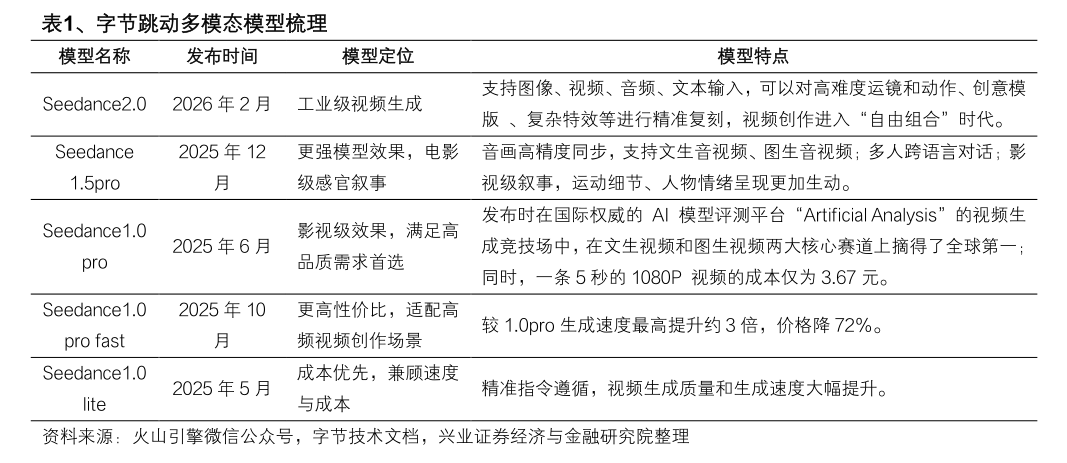

表1、字节跳动多模态模型梳理.png

传媒行业GenAI系列报告之66:字节AI,流量突围,MaaS及应用抢先-申万宏源.pdf

第二章 字节跳动 AI 算力基础设施的全栈建设.docx

第三章 字节跳动核心 AI 技术与大模型体系研发.docx

第四章 字节跳动 AI 技术的商业化落地与生态体系构建.docx

第一章 字节跳动自研芯片的战略布局与技术落地.docx

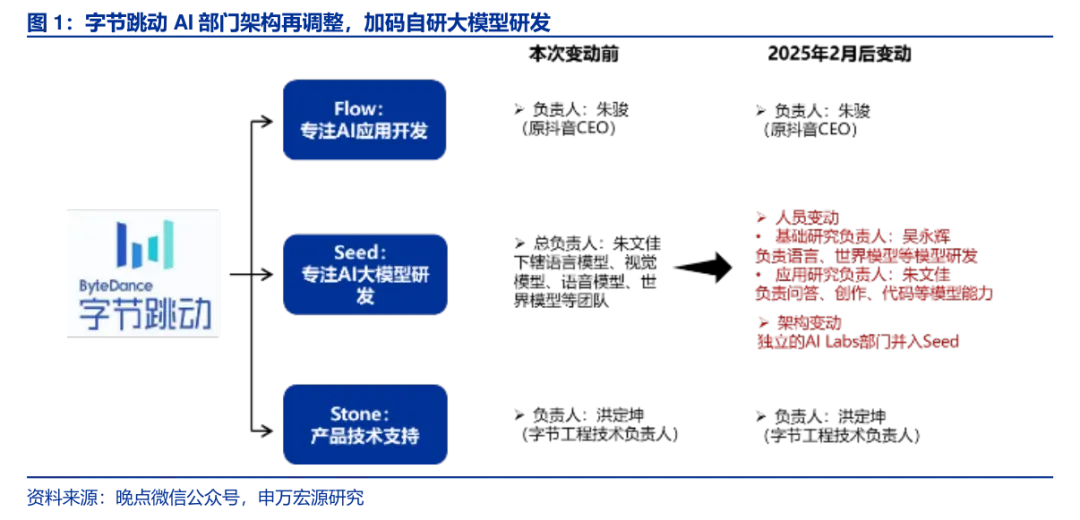

图1:字节跳动Al部门架构再调整,加码自研大模型研发.png

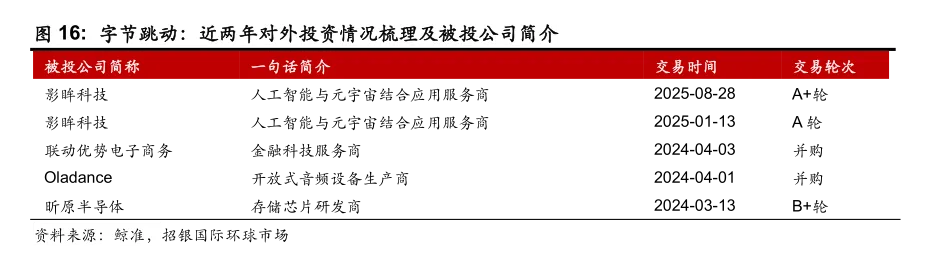

图16: 字节跳动:近两年对外投资情况梳理及被投公司简介.png

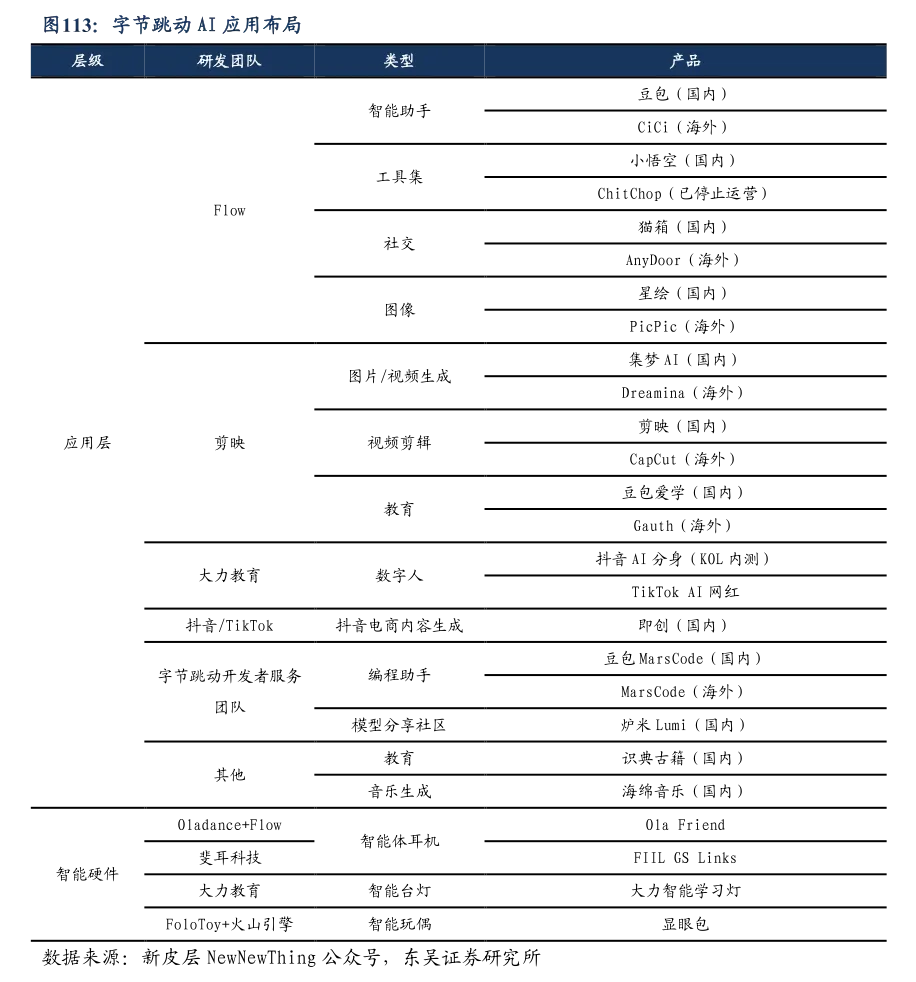

图113:字节跳动AI应用布局.png

图表22:字节跳动主要AI原生应用布局情况.png

字节AI深度:矢志登万仞,厚积起风云-长江证券.pdf

不断迭代更新中。。。一查就有,详询微信douyinbao。

近期热门军工专题报告一览:

2025年红外探测器与斯特林制冷机结合细分市场分析报告(军工科技行业专项定制调研) 2025年军工科技行业专题报告:AI智能时代的钢铁洪流与新质战力崛起 军民融合地面兵装国防武器信息化无人化体系化系列洞察 103页PPT全面解读应急面罩产业全景分析报告(2025-2030)安全应急装备行业现状竞争格局及发展趋势分析 隐身衣来了看材料混搭的魔力 2025-2026年隐身材料与超材料行业深度分析报告 180页.PPT 日韩火箭发射接连失败 再论商业航天当下的核心可回收火箭!113页PPT详解2025-2030年全球可回收火箭产业链行业分析报告 Palantir公司调研报告:认知作战,数据即武器,AI为军工之眼 附103页PPT深度解读全球军事智能化浪潮的引领者! 2025-2030年惯性导航行业分析报告 198页PPT 国防军工行业MEMS惯导产业链深度研究报告 210页重磅PPT!面向未来的无人机蜂群作战VS反无人机蜂群分析报告 2025-2030年无人作战集群与无人机蜂群作战行业分析报告 AI重塑未来战场!美国国防高级研究计划局2026财年49亿预算曝光,这些技术将主导下一代国防竞争 提前53天预警美军打击伊朗 中国版的Palantir+Anduril? 附192页PPT详解杭州民营新兴国防科技军事AI创新公司! 年终盘点 280页PPT系统梳理 俄乌冲突启示面面观——对我军建设发展的全方位多层次深度研究报告202602.pptx 【有求必应】高端特种电机、驱动器及机电一体化产品行业研究报告2025-2030年 84页PPT.pptx 2025-2030年隐身光学窗口行业分析报告(国防军工应用领域)105页PPT完美阐述光窗产业链全景洞察 2025-2030年电磁炮及激光武器行业深度分析报告.pptx 186页PPT完美解读未来高科技武器发展趋势 2025-2030年机载星载合成孔径雷达载荷、有源无源相控阵雷达竞争对比及军工雷达行业专题分析报告 硬科技上市潮涌 谁是下一个宇树科技??附1200+份硬科技项目BP商业计划书洞猹助您挖掘更多前沿创新企业标杆! 2025年中国及全球军用无人机行业全面洞察报告 100+页PPT 深度定制.pptx 中国及全球军工国防无人机主要企业及产品分析 反无人机行业全景分析报告(2025-2030)无人机反制无人机防御全球主要企业竞争格局洞察 2025年光电吊舱行业分析报告.pptx 98页PPT系统解读中国及全球电子吊舱市场及应用前景 2025-2030年中国及全球外骨骼机器人全产业链深度分析报告 208页PPT完美解读外骨骼市场及未来发展趋势 2025-2030年中国及全球碳纤维行业全产业链深度研究报告 108页PPT完美解读碳纤维市场竞争格局 2025年中国射频微波行业全产业链全景分析报告 (80页PPT).pptx 军民融合的多元应用场景 印巴空战背后的2025年中国军工体系全面盘点报告:电磁炮激光武器预警机数据链精准制导双脉冲固体火箭发动机蜂群无人机作战AI军工等 人工智能在精准打击体系中的应用 附2026年中国及全球智能弹药与精确打击市场全景洞察分析报告 106页.pptx 军用及民用四足机器人市场应用场景前景广阔!附2025-2030年中国及全球机器狗行业分析洞察报告 104页PPT.pptx 抢占军工装备升级制高点 2026年超高音速导弹及武器行业分析报告 148页PPT.pptx 电子战将决定未来军事主导权 2025-2030年电子战与信息安全(制信息权・制电磁权)行业分析报告 132页.pptx 蜂群无人机未来战争的颠覆者战术变革的新纪元 附2025-2030年无人作战集群与无人机蜂群作战行业分析报告 能够拍照并锁定台湾101的合成孔径雷达意外上热搜了?附166页PPT深度研究2025-2030年合成孔径雷达(SAR)行业全景洞察分析报告 罗永浩反复念叨的13999元外骨骼背后的大市场!附120页PPT解读2025-2030年消费级外骨骼机器人行业分析及前瞻洞察报告 “谁掌控频谱,谁就掌控战场” 2025-2030年电磁频谱制电磁权战争全景洞察分析报告 构建攻防兼备的频谱作战能力 电子皮肤站上产业风口自主突破正当时 2026 年电子皮肤行业全景洞察分析报告 市场格局与空间及产业链研究 美军前置情报作战的威力巨大!附外军(美国英国俄军以色列)情报战全景调研洞察分析报告202601 172页PPT.pptx 【有求必应】2026年AI智能体应用深度报告:聚焦企业业务形态、盈利模式及重点行业(公共事业能源交通教育及医疗政务等)转型趋势 重磅研究!128页PPT揭秘美军精锐特战力量!美军特种作战全景调研洞察分析报告202601.pptx 全球反无人机市场分析洞察报告202601 191页PPT系统解读无人机反制和无人机防御产业 无人机探测跟踪识别体系研究 372页PPT深度洞察:2026年可控核聚变产业迎来商业化临界点,人造太阳如何重塑未来能源格局附行业报告 223页!Claude Code深度科普报告PPT:从代码终端到战场风云,全面解锁 AI Agent 的革命性力量 高价值应用落地全解析! 疯狂的小龙虾AI风暴来袭! 附283页PPT深度调研报告助你全面了解OpenClaw!重新定义AI智能体的未来 LVC虚实融合+AI 智能体:军事仿真的技术变革与实战化应用 附399页PPT“十五五” 规划下中国军事仿真行业深度研究报告 300页重磅PPT!2026年Anduril安杜里尔工业Lattice晶格平台技术深度解析及配套无人装备专题报告 6G网真的要来了 产业链全景、发展现状与十五五周期发展趋势研判报告 附133页PPT全面洞察! 首次单列海洋为重点任务 陆海统筹内涵深化!附210页PPT解读水下十五五规划前瞻洞察报告(覆盖海洋产业深海经济水下装备等).pptx 2026年3月11日出品:美以对伊朗联合军事行动中AI人工智能赋能电子战研究特别报告附PPT 美伊冲突最新战况及信息汇总 2026年美伊军事冲突深度分析洞察调研报告 96页PPT! 国企央企标杆企业重磅分析 中国电子科技集团有限公司(中国电科)深度研究报告 十五五规划 产业布局 管理运营商业模式等