我们都知道,英伟达的通用GPU目前仍然在主宰世界。然而,当模型架构走向成熟,当推理成为更贴近商业化的主战场,通用 GPU 还是唯一答案吗?

那些被反复提起的“定制芯片”,它真正的优势到底在哪里?硅谷的六大巨头,现金多到可以“富可敌国”,为什么他们依然离不开博通?

如果只是“外包设计”,巨头们完全可以自己组建团队、找台积电流片,把利润留在自己手里。答案就藏在博通刚刚发布的最新财报与电话会细节里。

在刚刚发布的2026年第一季度财报里,博通不仅打出了近似“软件级”的盈利能力,更展现了AI军备竞赛的物理现实。良率、封装、互联、产能,缺一不可。

看懂这份财报,就能理解博通的护城河到底在哪里,以及为什么这场人工智能军备竞赛的胜负不在软件,而在冰冷的“物理世界”。

一、“软件级盈利”与反常识库存

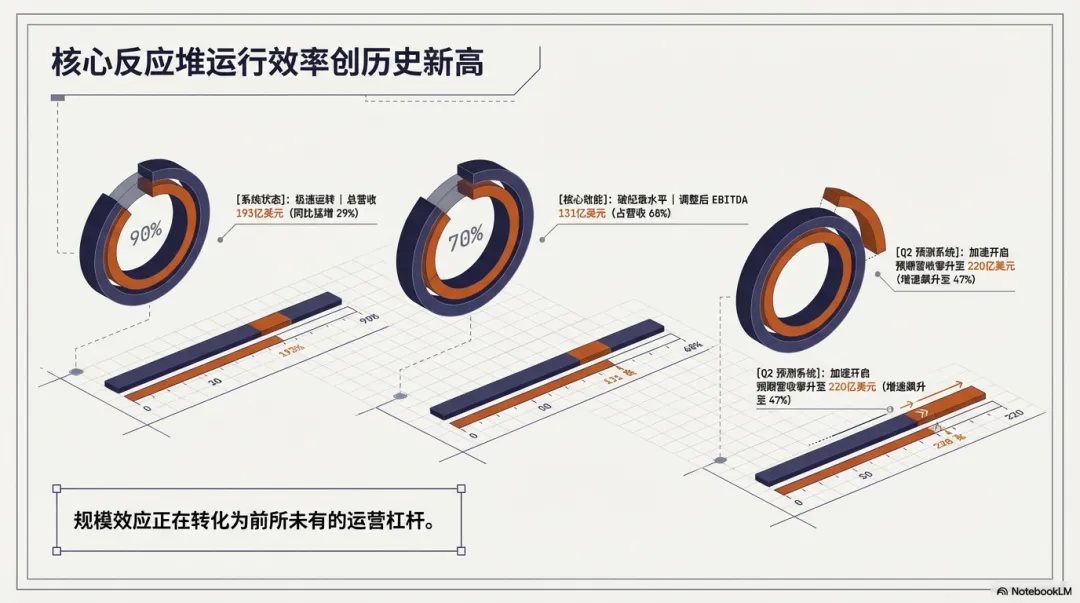

先看最直观的财务数字。博通2026年第一季度总收入达到创纪录的约193亿美元,同比增长 29%。

在硬件盘子里,这个增速本身已经足够吓人,但真正让人“惊掉下巴”的,是它的利润率。财报里提到 调整后的 EBITDA(息税折旧摊销前利润) 达到惊人的 131 亿美元,占总收入 68%。

通常很难在“卖物理芯片、做硬件制造”这种传统苦活累活里,看到如此夸张的利润结构。这个比例本来更像顶级 SaaS 软件公司,但它却出现在一家以半导体与基础设施为核心的公司身上。

如果把这组数字当成一个信号,它在告诉市场的其实是:博通卖的并不是“单颗芯片”,而是一整套让 AI 基础设施跑得起来、扩得起来、交付得出来的系统性能力。

换句话说,它在 AI 时代的位置,越来越像“底层算力引擎”,而不是传统意义上的零件供应商。

如果只看利润表,你会觉得这是一家在顺风顺水的公司。但真正引人深思的,是资产负债表上出现的一个非常反常的供应链信号。

在过去几年里,芯片行业巨头们都在追求“极致零库存”和精益生产。库存堆积在华尔街眼里,通常意味着危险:要么需求变差,要么产品卖不动,要么渠道在堆货,总之很难是好事。

但这一次,博通在季度结束时,库存直接堆到了 30 亿美元,库存周转天数从 58 天激增到 68 天。如果放在过去,哪个供应链主管敢一口气囤 30 亿美金的货?可能第二天门禁卡就被停用,直接卷铺盖走人。

然而在这个特殊的财报周期里,华尔街非但没有恐慌,反而把它视为“深谋远虑”。

原因很简单:管理层在电话会上摊牌得非常直白——这根本不是什么“卖不出去的库存”,而是为了支持强劲 AI 需求而 提前锁定的战略组件。他们是在为一场史无前例的超大规模交付周期“囤积弹药”。

当库存不再代表风险,而代表“提前占位”,你就能感受到这场 AI 军备竞赛的真实逻辑:它不是按季度节奏慢慢爬坡,而是像战争补给一样,谁先把关键组件锁住,谁就拥有下一阶段扩张的主动权。

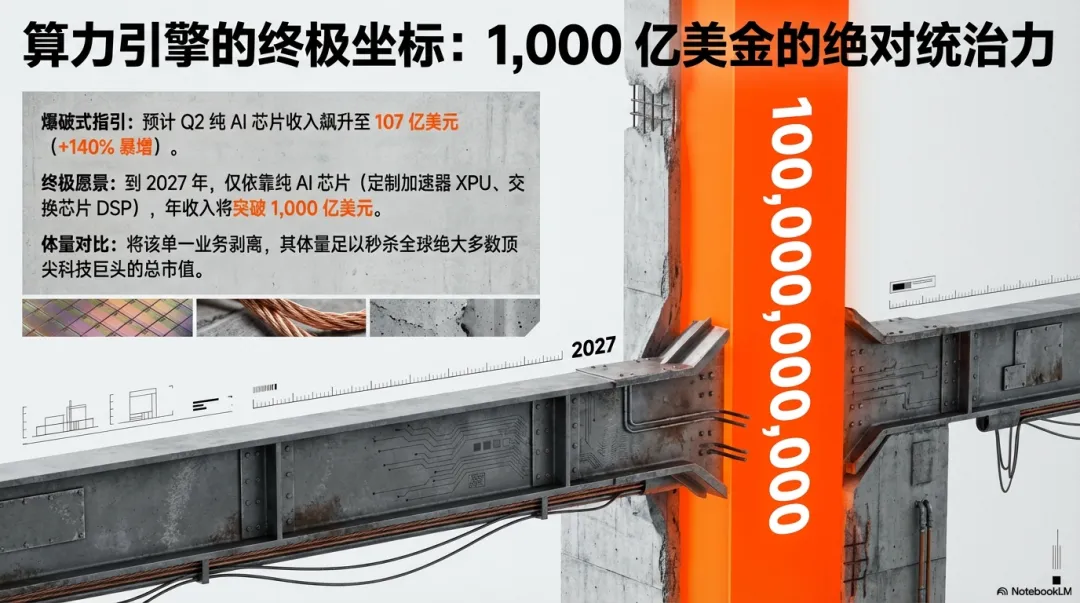

如果说库存只是让人意识到“交付周期要来了”,那真正称得上炸弹的,是管理层给出的长期指引。

他们预测到 2027 年,博通仅仅依靠 纯 AI 芯片(完全不包括软件业务),仅定制加速器、XPU、交换芯片等这些纯硬件收入,就可能达到 1000 亿美元。

1000 亿美元是什么概念?这个体量的单一业务,甚至可以在规模上碾压全球绝大多数顶尖科技公司的市值。

它不再是单纯的财务目标,更像是一份“产业宣言”:在席卷全球的 AI 基础设施浪潮中,博通正在从供应链一环,蜕变为底层物理世界的隐形霸主,控制着行业的“呼吸节奏”。

真正有趣的地方在于,当博通向华尔街汇报这种爆炸性增长时,它连度量衡都换了。

整场会议里,他们不再纠结“卖了多少颗芯片”或者“赚了多少美元”,而是开始频繁使用一个单位:吉瓦(Gigawatt,GW)。这通常是用来衡量大型电站发电功率的尺度。

当一家科技公司开始用“消耗城市级电力”的单位,来计算它在全球部署的芯片规模时,这就意味着 AI 数据中心已经彻底变异了:它不再是我们过去认知里那种铺地板、摆机架的传统机房,而正在变成一个吞噬巨大物理能源的超级工厂。这种算力工厂动辄几百亩土地,需要成排的巨型冷却塔,甚至需要靠近大型水电站或核电站,才能把电力与散热这两件事做成工程闭环。

AI 的扩张不再只受“资本开支”约束,而开始受“物理世界的上限”约束。

很多人听到这些,会觉得枯燥:巨头的资本开支、供应链、数据中心,跟我有什么关系?

关系极大。当你日常使用的每一次大模型对话,哪怕只是让 AI 帮你总结一份几十页的报告,你敲击键盘的每一次回车,背后调用的正是这科技巨头部署在沙漠或冰原深处的巨大物理能源与算力集群。你在直接榨取这个世界上最昂贵、最集中的物理算力资源。老实说,这就是我疯狂使用AI的心态,就跟薅互联网巨头的羊毛一样。

二、为什么硅谷巨头离不开博通

顺着“吉瓦”这个线索,财报里点名的那六个超级买家,就像一张算力需求的“狂热版图”。

·Google:对第七代 TPU 需求极其强劲,而且 2027 年以后还有更庞大的需求。

·Anthropic:据管理层描述,2026 年开局就已经部署了 约 1GW 级别的算力,后续还将向 3GW+ 扩张。

·Meta:管理层用非常强硬的措辞粉碎外界“Meta 放弃自研”的谣言,明确表示 MTIA 的定制加速器路线图依然充满活力,不仅在大量发货,2027 年也会扩展到多个 GW。

·客户 4 与客户 5:虽然更神秘,但被描述为“稳步翻倍”。

·OpenAI:作为第六大新增变量,博通预计 OpenAI 将在 2027 年批量部署第一代定制 XPU,规模同样 超过 1GW。

当你把这份名单排在一起,感受到的往往不是兴奋,而是一种强烈的生存焦虑:这些原本靠软件代码起家的公司,现在都被迫卷入泥泞的物理世界建设中。

更直白点说,做出 ChatGPT 这样惊艳全球产品的 OpenAI,本质上是一家软件算法公司,但现在也不得不去操心变电站和冷却塔该建在哪里。

到这里,你也许会问,为什么需要定制,而不是英伟达的通用GPU?

答案并不玄学,它背后其实是一条非常清晰的大模型架构演进路径:GPU 依然是训练时代的绝对王者,但当模型走向成熟与精细化,XPU/定制芯片会在越来越多关键场景里变成更合适的工具。

对于那种密集、通用、暴力的矩阵乘法计算——也就是大规模训练里最典型的张量运算,GPU 几乎是无可替代的。它的优势来自“通用性”和“并行度”,只要任务可以被抽象成大规模矩阵乘法,就可以用堆叠算力的方式硬推。GPU 就像一把大锤,抡起来就是效率,这也是英伟达能够在过去几年牢牢占据算力叙事中心的根本原因。

但问题在于,AI 的需求并不会永远停留在“抡大锤”的阶段。随着模型架构走向成熟,行业越来越广泛采用 MoE(Mixture of Experts,混合专家模型) 这样的结构,底层计算的组织方式开始发生变化。

MoE 的核心思想,是在处理具体问题时不必激活整个庞大的模型,而是通过路由机制只调用其中一部分“专家”网络,这听起来像是软件层面的聪明办法,但它对硬件提出了非常具体而苛刻的要求:极高效率的路由能力、极低的通信开销、以及对特定数据路径的优化能力。

在这种结构下,通用 GPU 就不再是“万能药”了,因为它擅长的是通用并行吞吐,而不是为某一种推理路径、某一种路由模式、某一种内存与互联拓扑做极限定制。

反过来,定制 XPU 的意义就凸显出来了:它不必像 GPU 一样承担所有场景的通用性包袱,而可以像一把锋利的手术刀,针对模型结构、推理模式、通信方式,把算力、带宽、缓存、互联乃至功耗都重新雕刻一遍,最终换来一个结果:同样的电力与成本,产出更多的有效推理能力。

因此,这些巨头甚至开始一年并行开发两款芯片:一款更偏训练阶段,为了追求更高的智能表现与更大的模型规模;另一款更偏推理阶段,为了把产品快速商业化、把单位成本压到可以规模化服务用户的水平。

他们不是在做“更便宜的 GPU”,而是在用双线并行的节奏抢占转瞬即逝的时间窗口,因为在推理成为主战场之后,决定胜负的往往不是“算力峰值”,而是“单位电力与单位成本能榨出多少真实可用的智能”。

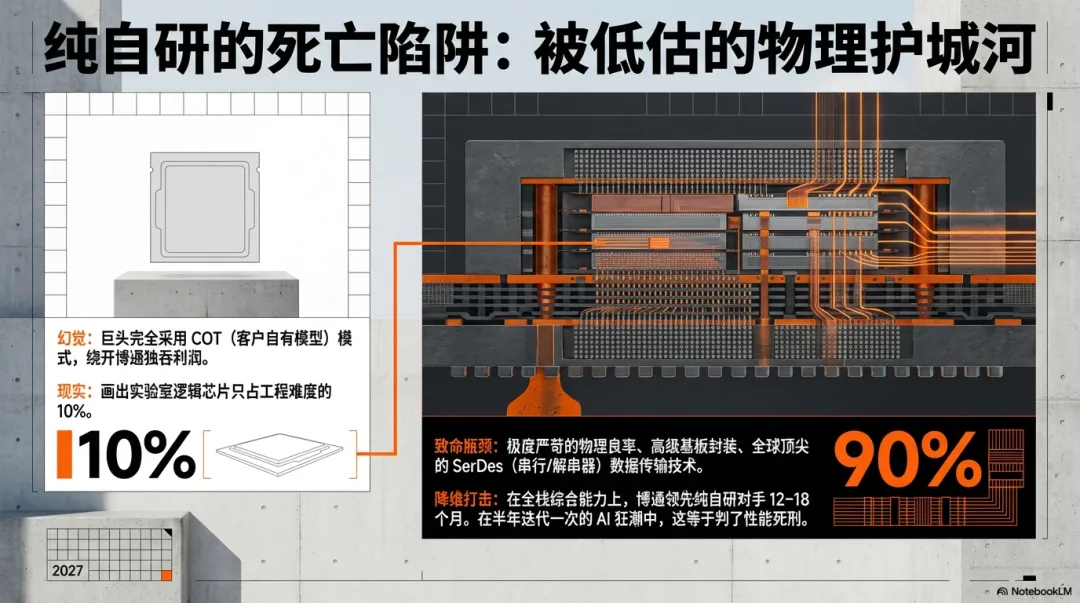

既然如此,巨头们为什么不彻底抛开博通,走所谓的 COT(Customer-Owned Tooling,客户自建工具/自有工具链) 路线,自己组建团队去搞芯片,把那“1000 亿美元的利润”全吃掉?毕竟像Google、Meta这样的巨头资金几乎无限,而且也不怕招不到顶尖人才。

博通 CEO 陈福阳(Hock Tan)在电话会上的解释很直白:设计一块能在实验室里跑通的逻辑芯片,可能只占整个工程难度的十分之一,真正要命的是剩下那 90%。

那 90% 是什么?是极其严苛的物理良率,是复杂的先进封装,是顶尖 SerDes(串行器/解串器) 能力来解决集群内部海量数据的超高速传输问题,是把成千上万颗芯片无缝连接成一个整体的网络与系统工程。

单颗芯片算力再高,如果无法在集群里高效互联,算力就很难真正转化成训练速度和推理吞吐。你最终要交付的是“能跑的大规模系统”,不是“能点亮的一颗芯片”。

所以博通才敢在电话会上公开声称:自己在这套综合能力上,领先目前的竞争对手 12 到 18 个月。在如今半年就迭代一次的 AI 狂潮里,落后 12 到 18 个月,往往就意味着模型在训练成本与推理效率上都可能失去竞争力。

管理层甚至强调,那些试图完全跳开博通的替代方案,在实际数据中心运行性能上至少落后“两倍”。

这就是为什么巨头很难“说跳就跳”,博通不单单是一家芯片供应商,而是一整套工程体系与产业协同网络的提供者。

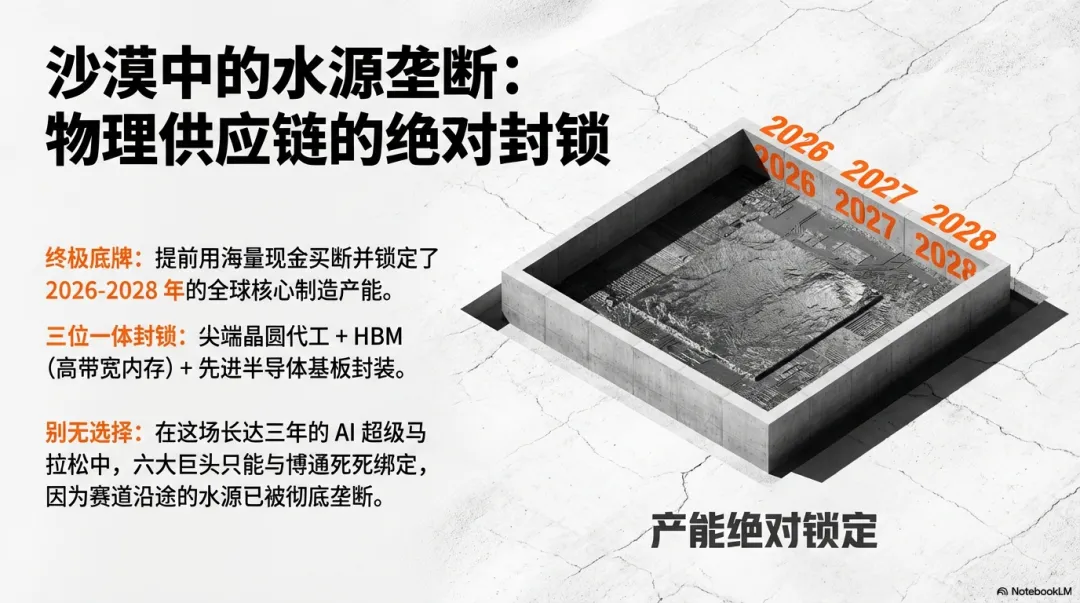

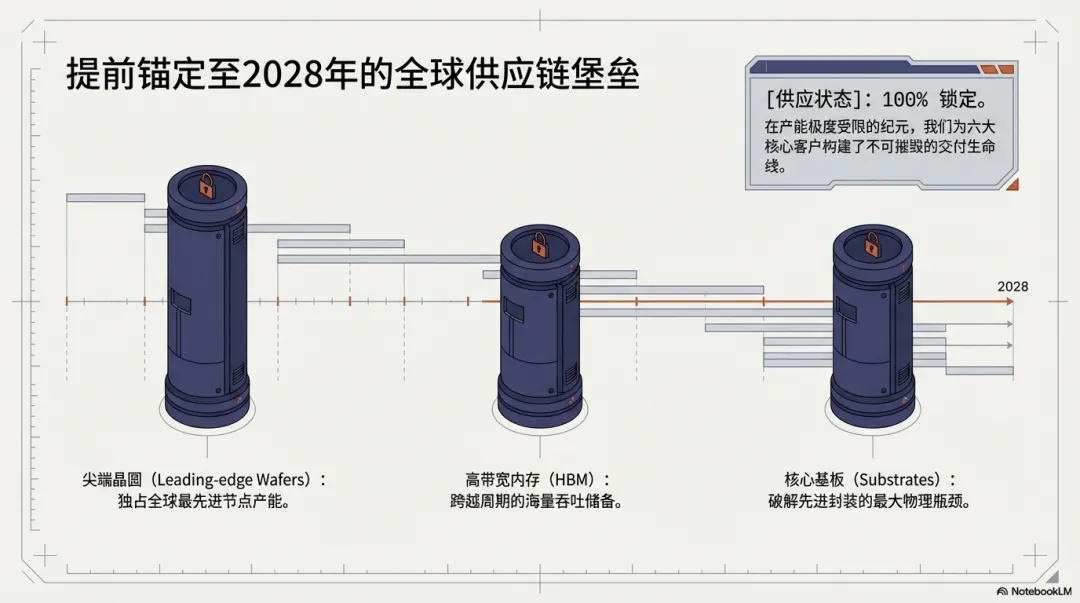

但博通真正掌控未来的底牌,还不止工程能力,而是更粗暴的东西:供应链锁定。

博通已经完全确保了 2026 年到 2028 年 这些核心组件的产能。它不仅仅是尖端晶圆代工的产能,更包括极其稀缺的 HBM 高带宽内存、以及先进的半导体基板与封装产能。

这就直接把“竞争”从软件世界拖回物理世界。科技巨头想进入 AI 硬件市场,想做新的 XPU、想做新的系统方案,首先要拿得到晶圆、拿得到 HBM、拿得到基板。而这些东西如果被提前买断,意味着他们还没开始打仗,决定胜负的弹药就已经不存在了。

用一个形象的比喻:当所有科技巨头都在参加一场穿越沙漠、长达三年的超级马拉松,博通不仅体能最好,而且提前用海量现金买断了赛道沿途未来三年所有的饮用水供应。那六大巨头想要跑完这场 AI 算力的马拉松,除了紧紧绑定博通,几乎没有第二条路可选。因为市场上,已经没有多余的水了。

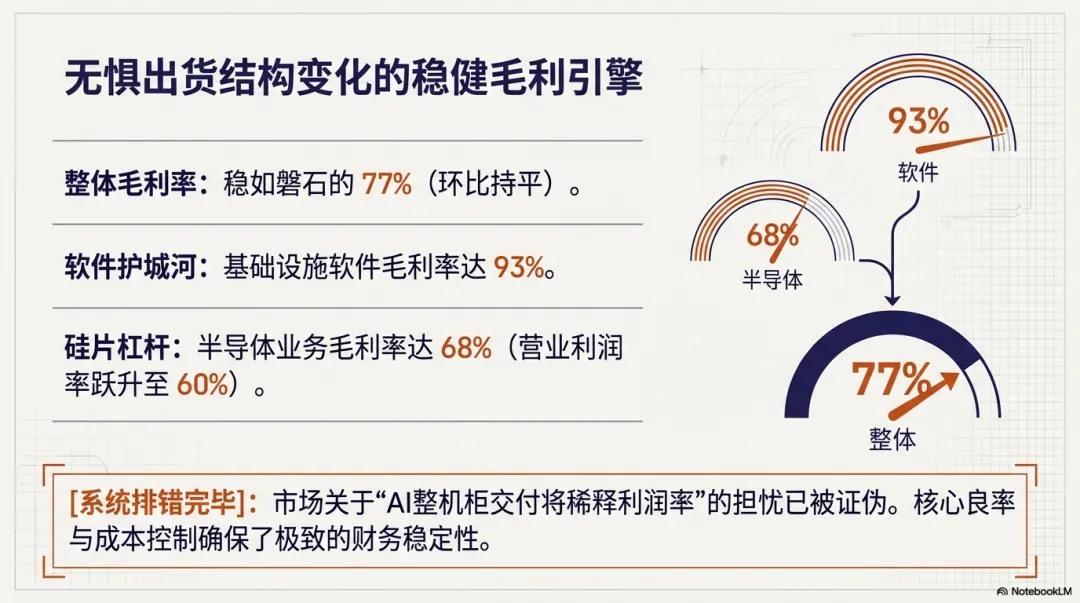

当供应链被锁死,合作关系被极度加固,博通自然会拥有一种“毛利率的傲慢”。

电话会上有个非常戏剧性的插曲:一位华尔街分析师提出了一个看似合理的担忧——既然博通要大规模出货那种包含各种组件的庞大 AI 机架系统,而传统上系统集成业务毛利率通常只有 45%~50%,这会不会拉低公司整体超高毛利率?

管理层的回击可以说相当不留情面。CEO 直接用了一个 AI 时代最火的词:“Hallucinating(幻觉)” 来回怼分析师,意思几乎是:这个担心本身就不成立。他非常强硬地确认,第二季度整体毛利率将环比持平在 77% 的高位。

这段对话的含义其实很清晰:博通不仅卖芯片,更卖交付体系;不仅能设计,也能把成本、良率、供应链、系统集成的每一项变量吃透到可以“维持 77% 毛利率”的程度。它在做的不是传统硬件生意,而是 AI 基础设施时代的“平台型硬件”。

三、护城河不止芯片

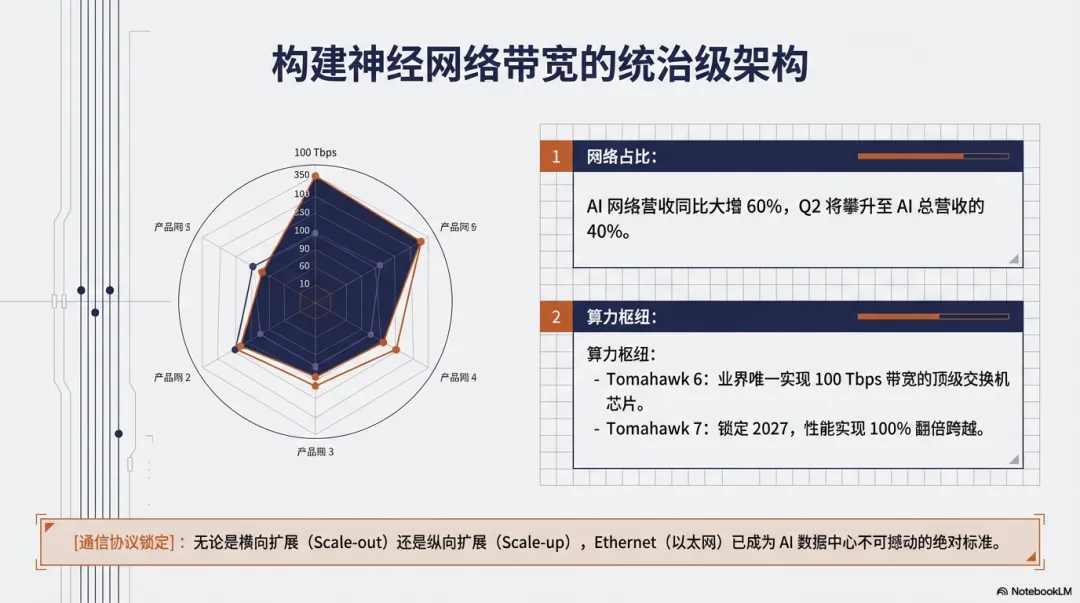

如果我们只盯着 AI 的“大脑”,也就是计算芯片,那眼光就太局限了。处理多达数十万颗芯片协同工作的集群,它的“神经系统”同样非常关键。

财报数据生动地印证了一点:第一季度博通的 AI 网络收入暴增 60%,并且管理层暗示它在 AI 收入中的占比还在继续提升。算力规模的每一步扩张,都在对数据吞吐量提出更恐怖的要求。

财报会上他们提到了高端交换芯片路线(如 Tomahawk 系列)与 100Tbps 级带宽的能力规划,并且在 2027 年还有进一步翻倍的迭代节奏。

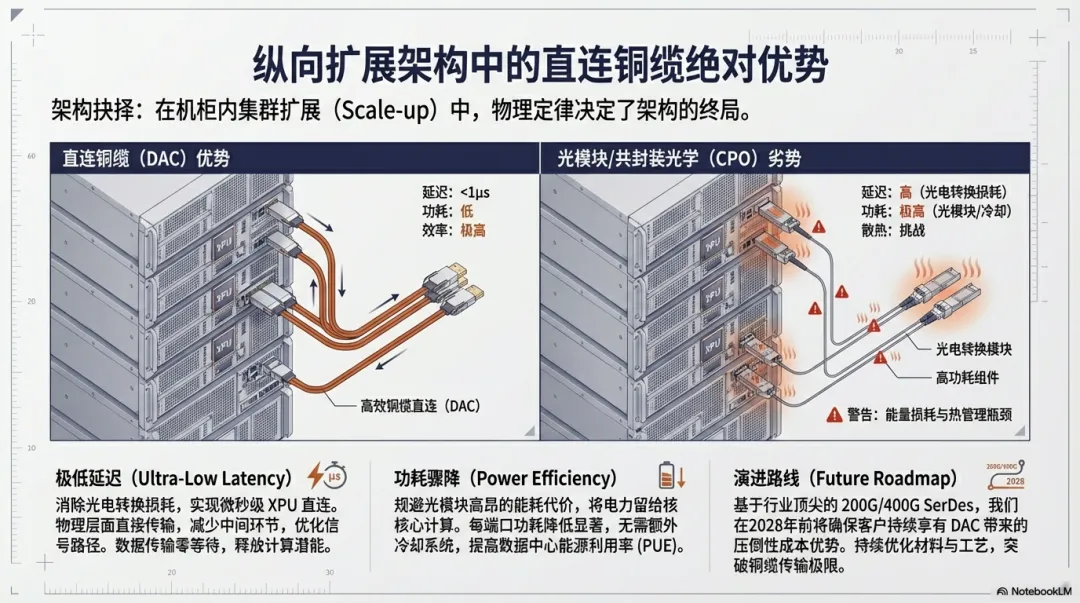

这些参数听起来很前沿,但比参数更值得关注的,是博通在网络传输介质上的一个反直觉战略选择。

现在整个行业都在炒作封装光学、光互联之类的新技术,大家理所当然觉得未来的数据中心传输必须走向光纤,毕竟“光速快”。但博通却逆势而行:在机架内部的向上扩展(Scale-up)里,它非常坚定地坚持使用 DAC(直接连接铜缆),配合先进的 200G / 400G SerDes 技术。

为什么在全行业追捧光通信的时候,偏偏固执地使用看似“老旧”的铜缆?答案就藏在最朴素的物理规律里:省电。

在机架内部极短距离内使用铜缆,不仅成本更低、延时更低,关键是它能显著降低功耗。在“算力即电力”的今天,数据中心的电力容量往往是卡死的:谁能在数据传输上哪怕省下一瓦电,谁就能把省下来的电通通喂给 GPU/XPU,转化为更大的可用算力空间。这看起来像“线缆之争”,但本质上是“单位电力能换到多少有效算力”的底层战争。

把成千上万根铜缆、上万颗发烫的 CPU/GPU/XPU 凑在一起,当然不可能靠工程师手动接线、手动调配资源。于是,还有一个容易被忽略、却同样充满韧性的维度:基础设施软件。

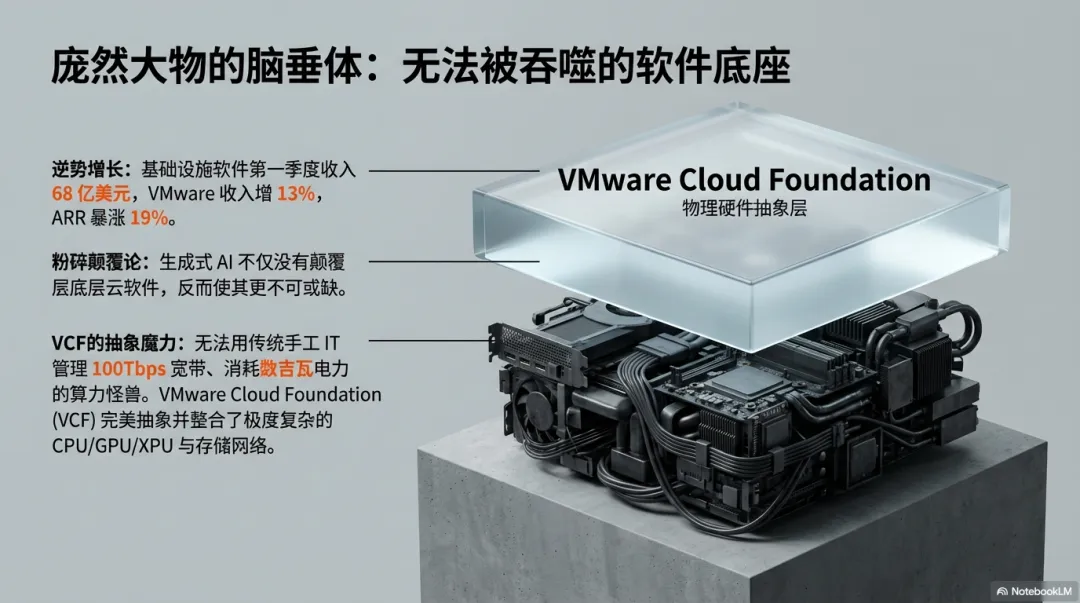

很多人觉得生成式 AI 一出来,传统计算机软件就要被扫进历史垃圾堆。但数据打了脸:第一季度博通的基础设施软件收入达到 68 亿美元;明星产品 VMware 收入不仅没跌,甚至逆势增长 13%;它的 ARR(年度经常性收入) 也大涨 19%。

管理层给出的解释非常清晰:生成式 AI 不但没有颠覆传统底座,反而需要更多的 VMware 部署。因为当你的物理硬件变成一个拥有 100Tbps 级带宽、消耗 GW 级电力的算力怪兽时,必须有一个足够强大的“操作系统”去驯服它。

VMware Cloud Foundation(VCF) 正是不可或缺的抽象层:它把极其复杂的 CPU/GPU/XPU、存储和网络,整合成一个可以被软件调用的私有云资源池,衔接上层花哨的 AI 算法与底层冰冷的硅片之间最关键的桥梁。

结语:AI战争的全景图

把所有线索串起来,我们会得到一张更完整的全景图:

博通就像一个全副武装的半导体寡头:它不仅手握顶尖的定制芯片设计与高速网络技术,还通过长期供应链长约,把全球最有权势的六个 AI 大玩家牢牢绑定在一起;它一边在疯狂投资未来,一边用股息与回购向股东回馈,并且还批准了新的大额回购计划——这种“进攻与回馈并行”的姿态,本质上是在宣告自己的定价权与确定性。

而更值得深层推演的问题在于:当博通宣称自己已经买断并锁定直到 2028 年的顶尖晶圆、HBM 与先进基板产能时,这对任何试图在未来三年进入 AI 硬件市场的新兴竞争者意味着什么?

这可能是一种非常冷酷的现实:当最核心的制造资源已经在物理层面被巨头们垄断并瓜分完毕,创新者是否正在面临一个根本无法获取生产要素的死局?

在这个时代,最坚固的护城河也许不再是代码或专利,而是对物理供应链的绝对锁定。

当后来者想跨越沙漠时,发现所有的水早就被巨头买光了——这就是AI基础设施军备竞赛的底层隐喻,也是这份财报最值得反复咀嚼的商业命题。