AI Ping:大模型API服务行业分析报告(附下载地址)

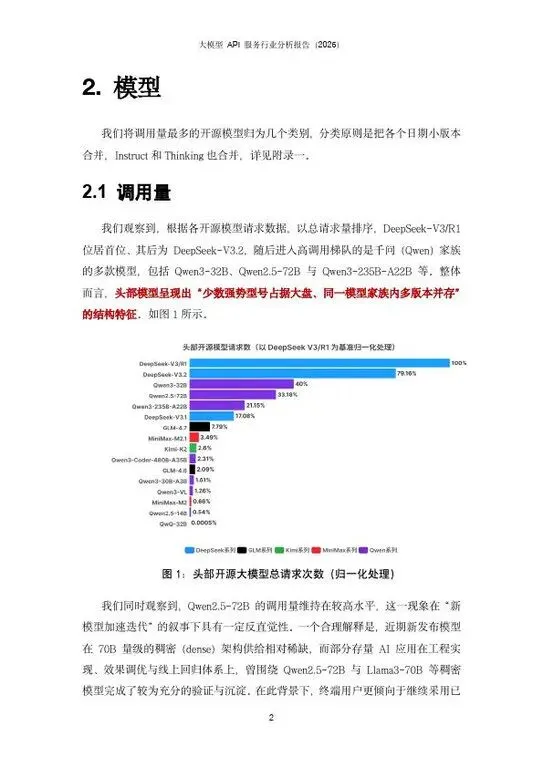

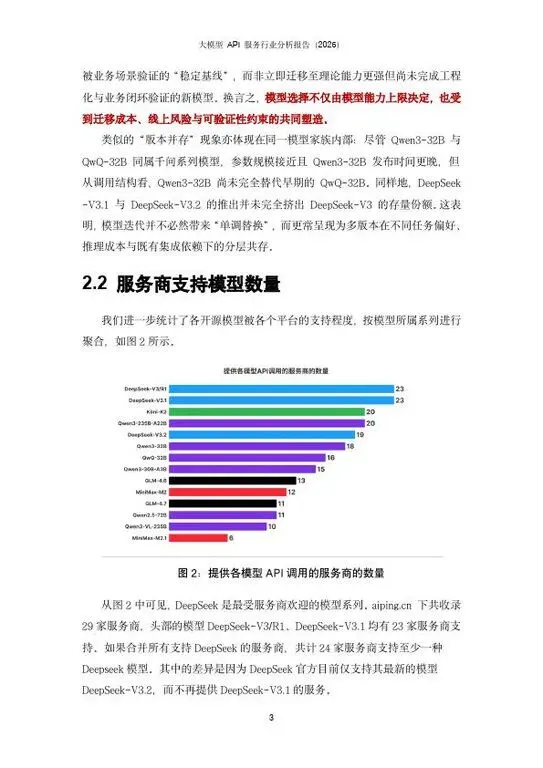

近年来,大语言模型(LLM)在内容生成、代码辅助、知识检索与复杂推理等场景中快速渗透,促使“模型能力”从单点算法指标走向可规模化交付的在线服务形态。大模型 API 服务,是指将模型推理能力以标准化接口对外提供,使开发者能够在不自建训练与推理基础设施的前提下,按需调用并在业务系统中快速集成。进一步地,Model-as-a-Service(MaaS,模型即服务)强调以云端资源与工程化运维为支撑,提供可计量、可观测、可弹性伸缩的模型供给体系,将模型推理的成本、时延与稳定性纳入统一的服务质量(SLA)框架,从而显著降低企业应用门槛并加速规模化落地。AI Ping 作为一站式AI评测与API服务智能路由平台,整合了中国境内的数十家算力提供商的数百个大模型 API 服务,并基于 7×24 小时的持续性能监测,为用户提供统一的 API 接入与智能路由能力。在模型供给快速扩张、服务商异质性显著、价格与性能竞争加剧的背景下,AIPing的价值在于通过专业评测、统一接口、弹性调度与数据驱动的性能治理,缓解“多模型、多服务商、多场景”带来的接入复杂度与运维不确定性,为应用侧提供更稳定的质量—成本最优解。本文基于 AIPing2025年第四季度的抽样数据,对开源大模型 API 服务市场的发展态势进行了系统分析。本文的三个关键结论如下:1. DeepSeek 与 Qwen 系列模型占据开源模型的 API 调用的主导地位;2. API 吞吐速率是用户选择服务商的重要因素,各服务商性能差距较大,全行业性能水平正在持续提升;3. 应用侧场景分化与模型偏好明显,通过智能路由可以有效提速降本。下文将从模型、服务商与应用三个维度展开具体分析。以上资料均从网络公开资料收集整理而成,所有报告版权归原公司、机构所有!如有侵权请留言联系我们,我们将第一时间处理。

微信号:mouse0232

你想要查询的关键字发给我,我会给你返回你想要的报告