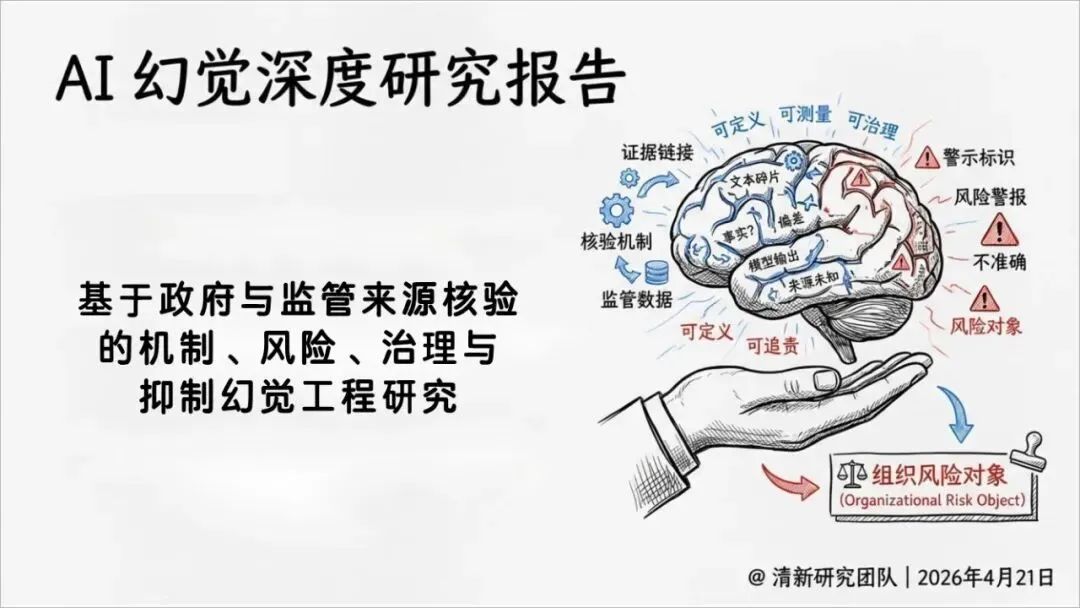

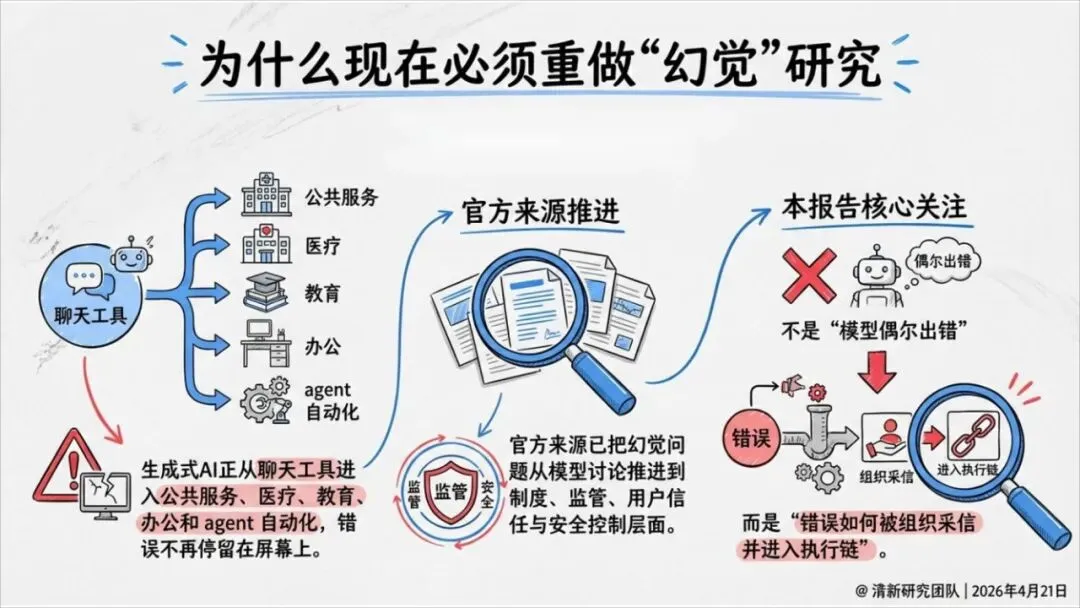

AI幻觉:无法消灭的风险,必须管理的挑战

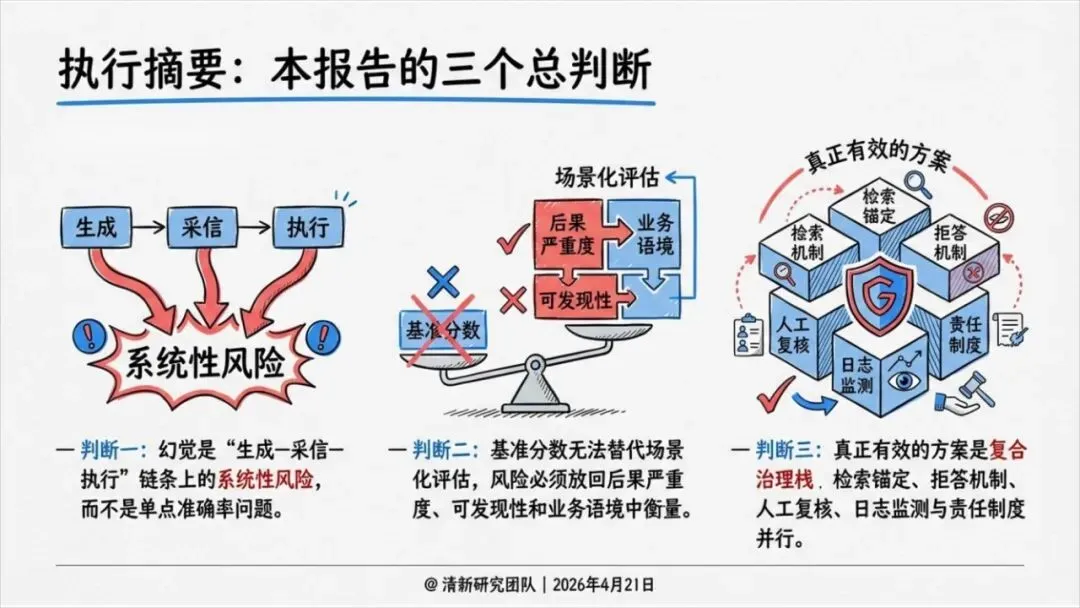

当AI以自信的口吻说出完全错误的信息时,我们该如何应对?清华大学清新研究团队发布的《2026年AI幻觉深度研究报告》直面这个棘手问题,提出了三个颠覆性的核心判断,为AI的安全应用指明了方向。

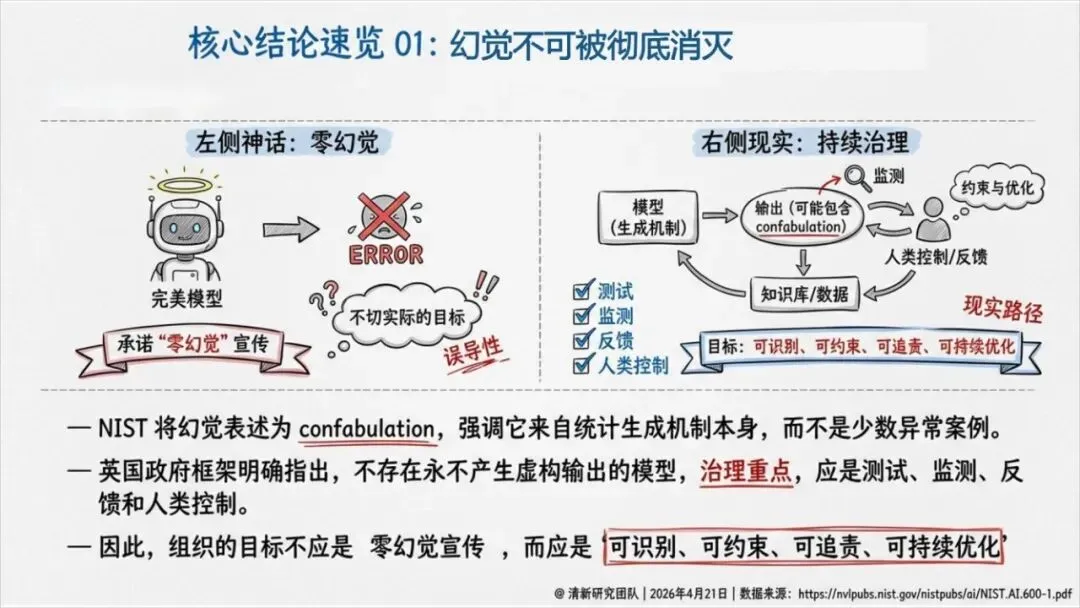

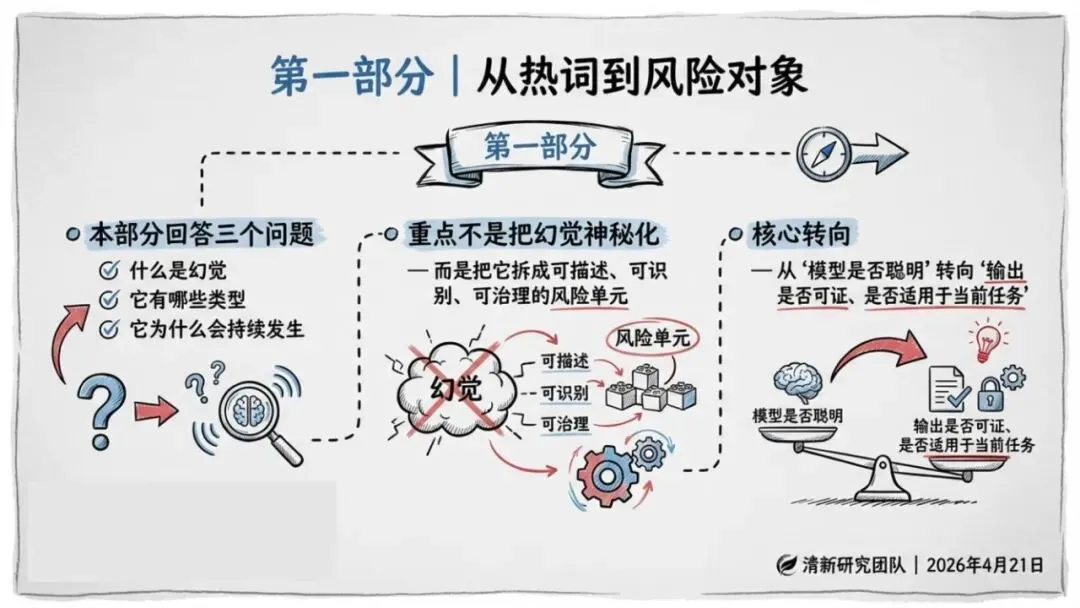

核心判断一:幻觉不可被彻底消灭

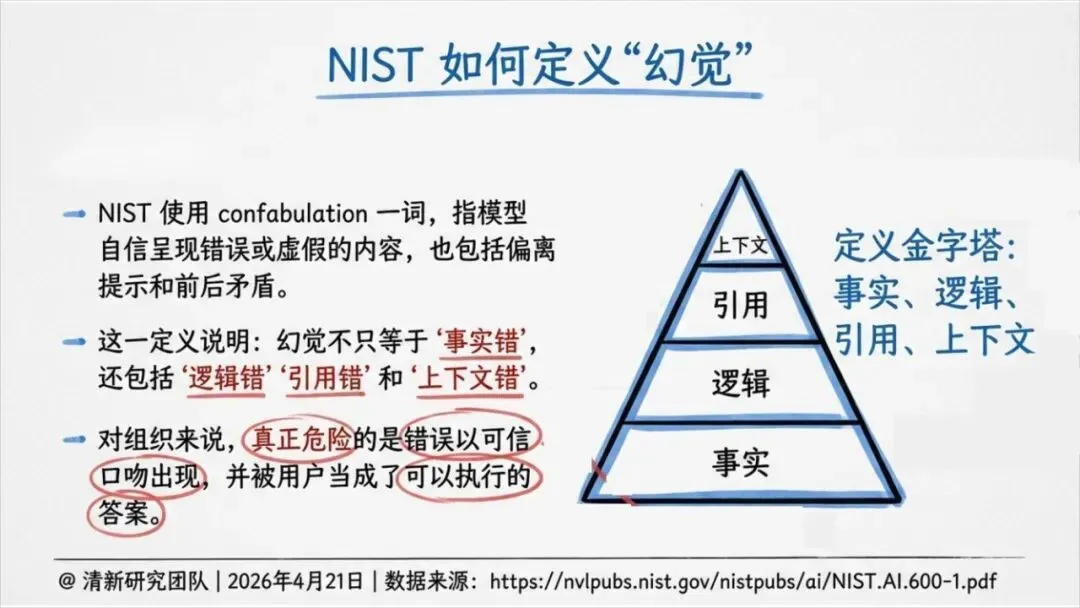

报告开篇就打破了一个普遍存在的幻想:追求"零幻觉"的AI系统。NIST(美国国家标准与技术研究院)将幻觉表述为"confabulation",强调它来自统计生成机制本身,而不是少数异常案例。英国政府框架也明确指出,不存在永不产生虚构输出的模型。

这意味着什么?就像人类会犯错一样,AI也会产生幻觉。这是由大语言模型的工作原理决定的——它们基于概率生成文本,追求的是语言流畅性和连贯性,而不是事实准确性。因此,组织的目标不应是追求不切实际的"零幻觉",而应该是建立"可识别、可约束、可追责、可持续优化"的治理体系。

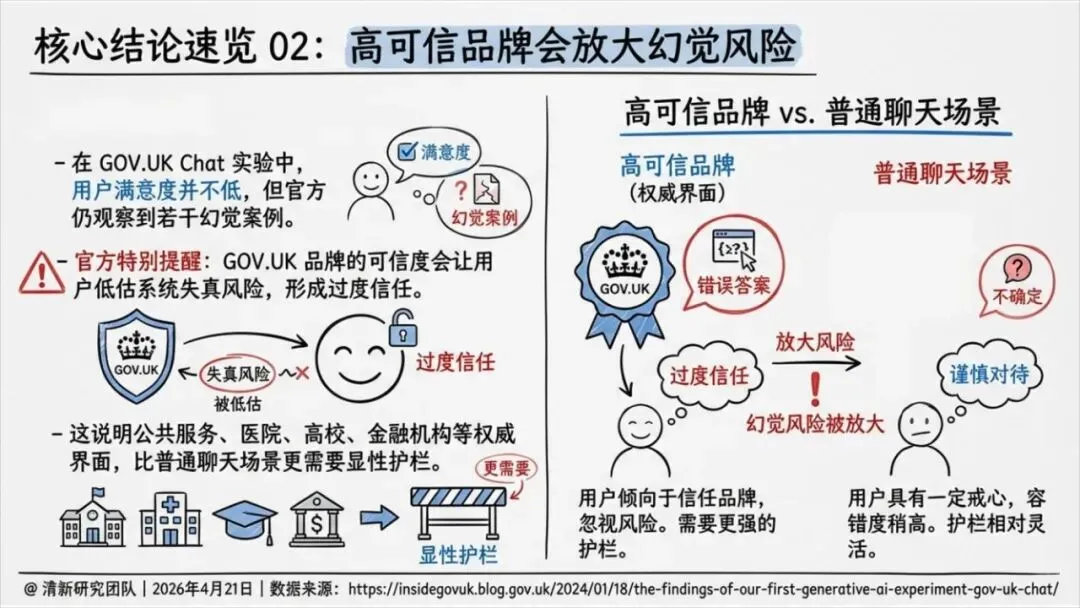

核心判断二:高可信品牌会放大幻觉风险

这是一个反直觉但至关重要的发现:越是权威的机构使用AI,风险反而越大。英国政府数字服务部门在实验中明确提醒:GOV.UK品牌的高可信度会让用户低估系统失真风险,形成过度信任。

想象一下,如果同样的错误信息来自一个不知名的网站和一个政府官网,哪个更容易被相信?显然是后者。这意味着公共服务、医院、高校、金融机构等权威界面,比普通聊天场景更需要显性的风险提示和防护措施。

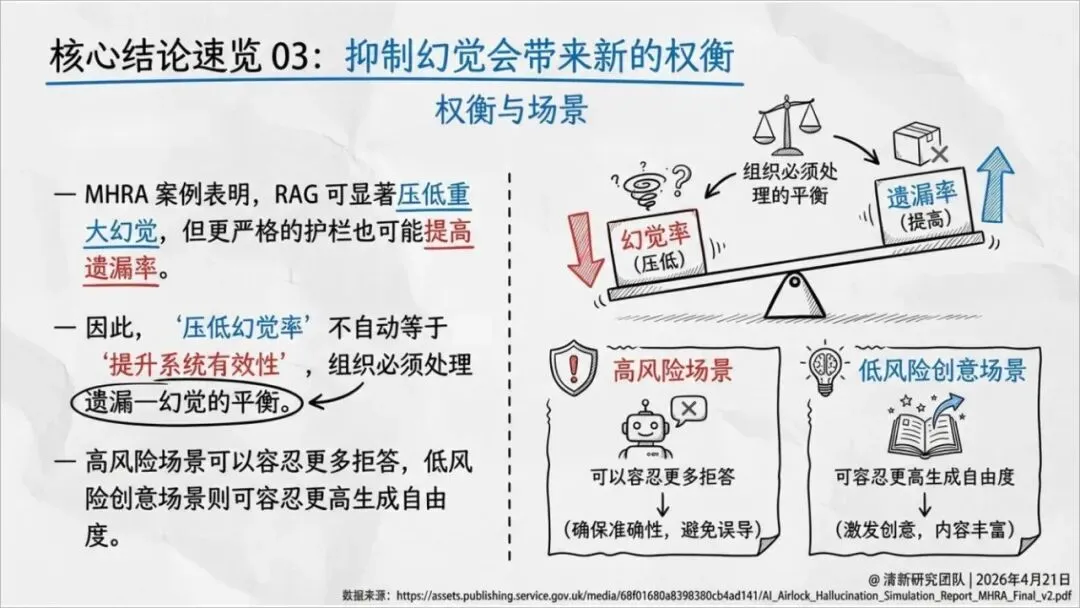

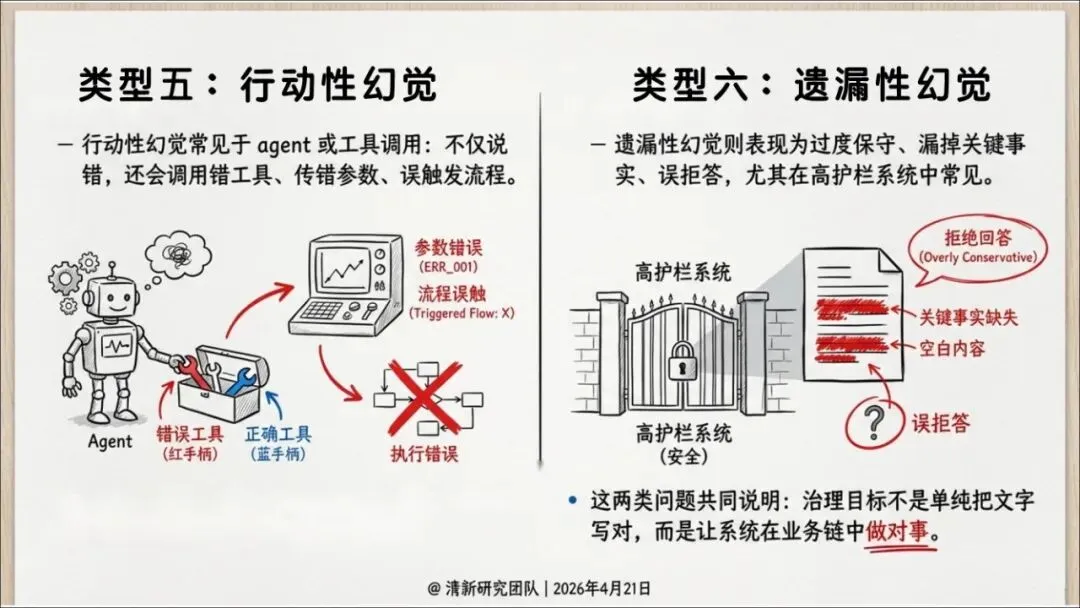

核心判断三:抑制幻觉会带来新的权衡

MHRA(英国药品和健康产品管理局)的案例表明,虽然RAG(检索增强生成)等技术可以显著压低重大幻觉率,但更严格的护栏也可能提高遗漏率——系统可能因为过于谨慎而拒绝回答本可以正确回答的问题。

因此,"压低幻觉率"并不自动等于"提升系统有效性"。组织必须在"遗漏"和"幻觉"之间找到平衡点。高风险场景(如医疗诊断、法律咨询)可以容忍更多拒答,而低风险创意场景(如内容创作、头脑风暴)则可容忍更高的生成自由度。

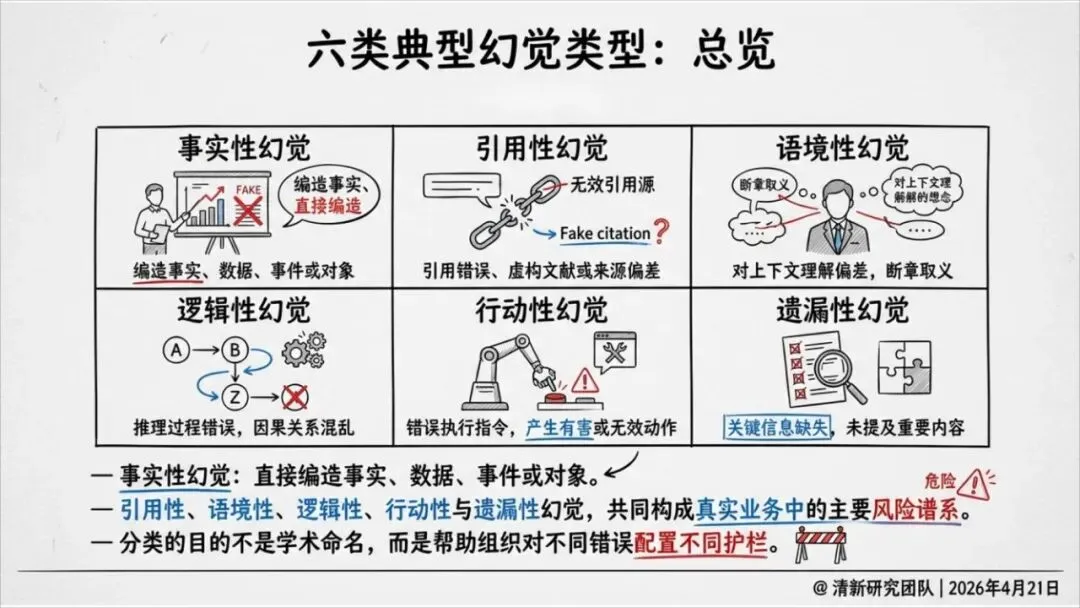

六类典型幻觉:从事实错误到逻辑混乱

报告将AI幻觉细分为六种类型,帮助我们更精准地识别和管理风险:

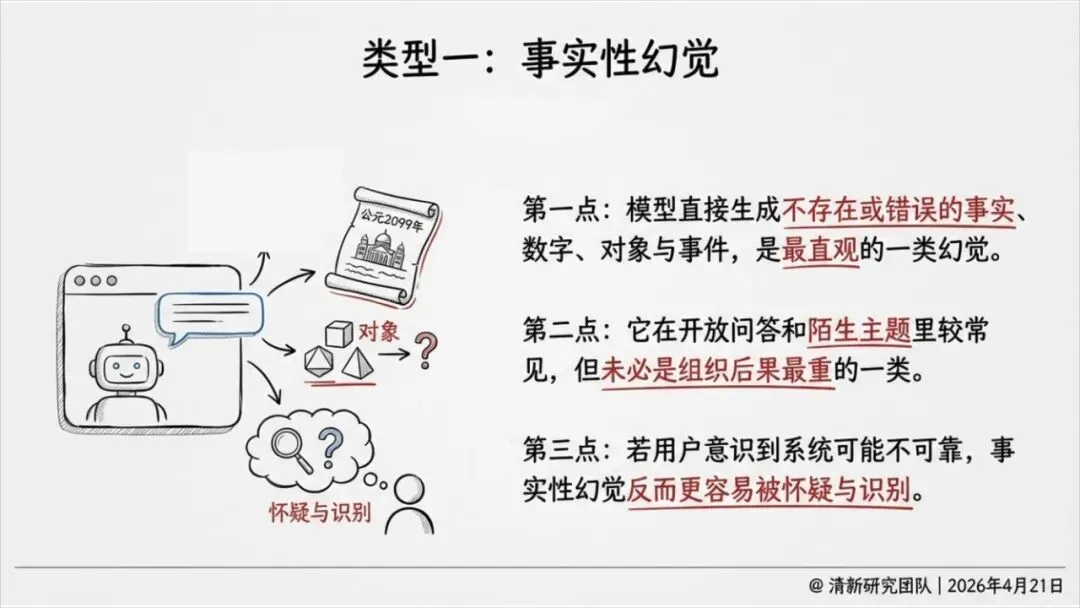

事实性幻觉:直接编造事实、数据、事件或对象

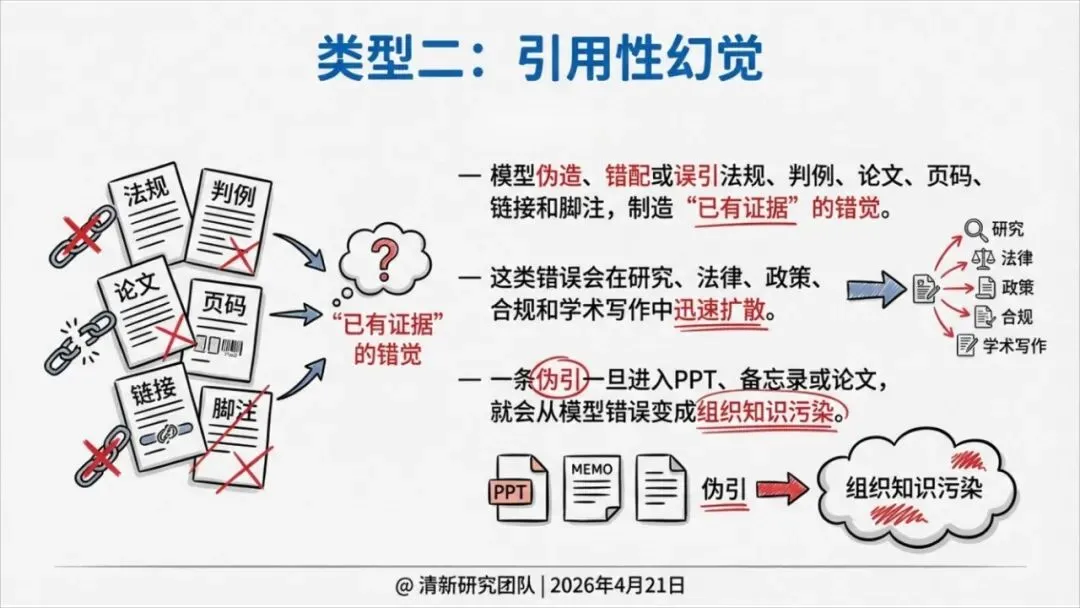

引用性幻觉:引用错误、虚构文献或来源偏差

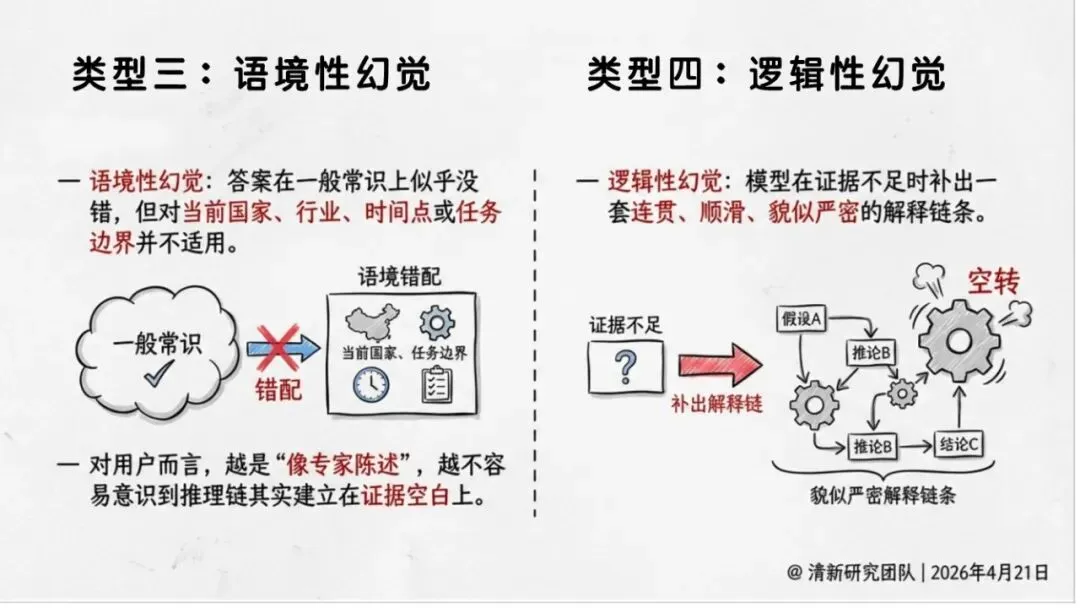

语境性幻觉:对上下文理解偏差,断章取义

逻辑性幻觉:推理过程错误,因果关系混乱

指令性幻觉:未能正确理解或执行用户指令

一致性幻觉:输出内容前后矛盾

这种分类的价值在于,它让我们认识到幻觉不仅仅是"事实错误",还包括逻辑、引用、语境等多方面的问题。治理措施也需要针对不同类型的幻觉设计不同的应对策略。

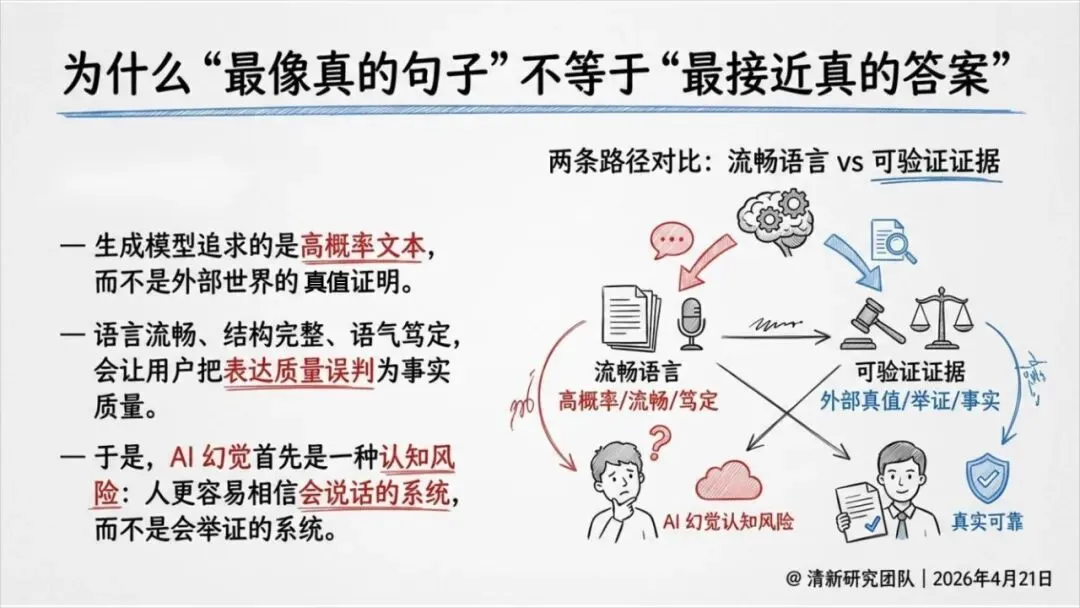

为什么"最像真的句子"不等于"最接近真的答案"?

报告深入分析了幻觉产生的根本原因:生成模型追求的是高概率文本,而不是外部世界的真值证明。语言流畅、结构完整、语气笃定,这些表达质量的特征会让用户误判为事实质量。

这就产生了一个认知风险:人们更容易相信"会说话的系统",而不是"会举证的系统"。AI可以用极其自信的口吻说出完全错误的内容,而缺乏专业知识的用户很难辨别。

治理框架:从技术到制度的全方位应对

基于这些洞察,报告提出了系统的治理框架:

技术层面:采用RAG、知识图谱、事实核查、输出验证等多种技术手段,从源头减少幻觉产生,在过程中检测幻觉,在输出后纠正幻觉。

流程层面:建立人类监督机制,特别是在高风险场景中保持"人在回路";设计分层响应策略,根据风险等级采取不同的应对措施;实施持续监控和迭代优化。

制度层面:制定明确的使用指南和责任划分;建立透明的错误报告和纠正机制;开展用户教育,提高对AI局限性的认知。

场景化治理:不同风险,不同策略

报告强调,没有一刀切的解决方案。不同场景需要不同的治理策略:

高风险场景(如医疗、金融、法律):需要最高级别的防护,包括多重验证、专家审核、限制生成范围等

中风险场景(如教育、客服、内容审核):可以采取适中的防护措施,结合自动化和人工监督

低风险场景(如创意写作、代码生成、个人助理):可以给予更多自由度,主要依赖事后纠正

给组织的最佳实践建议

对于计划部署AI系统的组织,报告给出了具体建议:

设定合理预期:明确告知用户AI可能产生错误,管理用户期望

实施分层防护:根据应用场景的风险等级设计相应的防护措施

保持人类监督:在关键决策点保留人类判断和干预的权利

建立反馈循环:收集用户反馈,持续改进系统性能

开展员工培训:提高员工对AI幻觉的识别和应对能力

制定应急预案:准备好在发生重大错误时的应对措施

未来展望:与幻觉共存,与风险共舞

报告最后指出,AI幻觉不会完全消失,但可以通过系统性的治理将其控制在可接受范围内。这需要技术开发者、应用组织、监管机构、最终用户的共同努力。

对于技术开发者,需要继续改进模型架构和训练方法,从源头减少幻觉。对于应用组织,需要建立完善的治理体系,确保AI的安全可靠使用。对于监管机构,需要制定适当的规范和标准,平衡创新与安全。对于最终用户,需要提高数字素养,学会批判性使用AI生成的内容。

AI幻觉不是阻止我们使用AI的理由,而是提醒我们以更加理性、审慎的态度对待这项强大技术。只有正视风险、管理风险,我们才能更好地享受AI带来的红利。

在这个AI日益普及的时代,理解幻觉、管理幻觉,已经成为数字公民的基本素养。这份报告为我们提供了必要的知识和工具。

部分内容预览

—

—

—

扫描识别下方二维码可自助开通会员

—

本篇资料已更新至情报猿资料分享平台

咨询会员服务、了解完整版资料获取方式

请加微信号“qbyuan888”

—

免责声明:以上报告均系本平台合作用户通过公开、合法渠道获得,报告版权归原撰写/发布机构所有, 如 涉 侵 权 , 请 联 系 删 除 ;资料为推荐阅读,仅供参考学习,如对内容存疑,请与原撰写/发布机构联系。

如何快速获取相关资料?

如何快速获取相关资料?