为了这份财报的实时解读,起的比鸡早?。

如果你最近总觉得AI很热,但又说不清到底机会在哪,这份Alphabet最新财报,其实已经把答案写得很直白了。

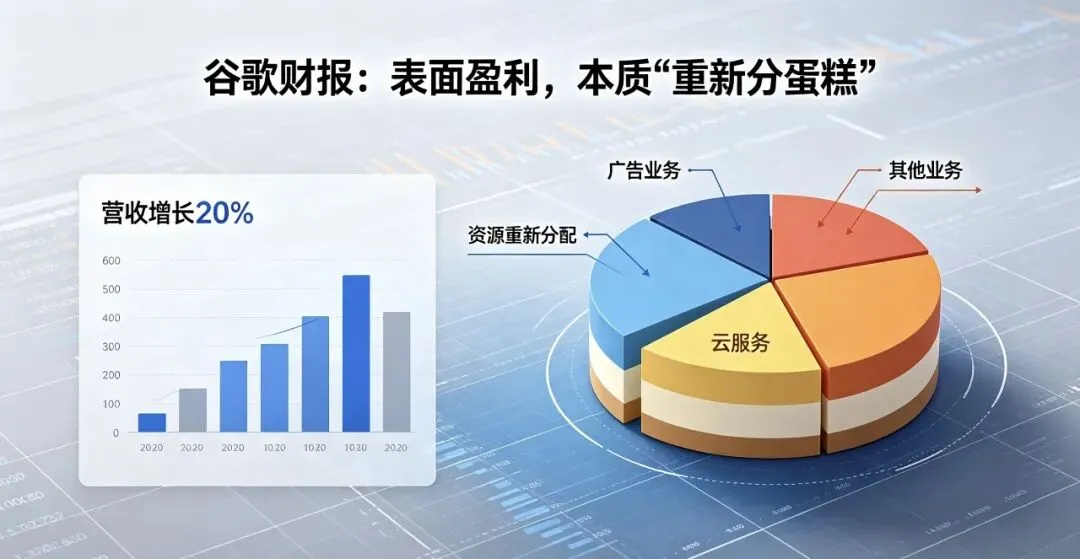

先说一句结论:这不是一份普通财报,而是一张“资金流向图”。

一、先把表面看清:确实很能赚。

2026年第一季度,几个关键数据:

* 营收:1099亿美元,同比增长22%(来源:Reuters)

* 净利润:同比+81%(来源:The Wall Street Journal)

* 云业务:+63%(来源:Reuters)

* 搜索广告:+19%(来源:The Verge)

用大白话翻译一下:原本赚钱的业务还在稳,新业务开始加速放量。

就像一家老店,原本靠堂食赚钱,结果外卖突然爆单,而且堂食还没变少。

二、很多人看错了:云增长,其实是“算力爆发”。

看到云业务+63%,很多人以为是云计算回暖。

但如果你往里拆一层,会发现:企业现在买的,不是云,而是AI能力(算力+模型)。

包括:

* 用模型(Gemini)

* 租算力(TPU / GPU)

* 调API做应用

可以这么理解:以前做生意,要自己买设备、请人。

现在直接租一个“AI后厨”。所以这波增长的本质只有一句话:

AI在疯狂消耗算力。

三、一个关键验证:搜索不但没被替代,反而更赚钱

之前很多人担心:AI会不会取代搜索?

但现实是:

* 搜索收入还在涨(+19%)

* 搜索量创历史新高(来源:The Verge)

为什么?用户行为变了:

以前:搜 → 点 → 自己找

现在:搜 → AI总结 → 再点广告

结果就是: 停留时间更长,广告价值更高。

就像短视频出来后,广告不但没消失,反而更贵了。

四、真正的大动作:开始“砸钱建底座”

这份财报最重要的一行,其实不是利润,而是:全年资本开支:1800亿–1900亿美元。

这意味着什么?不是简单扩产,而是在:

* 建数据中心

* 抢电力

* 堆芯片

* 铺网络

一句话总结:在建AI时代的基础设施,就像修高速公路,谁先铺好路,谁就掌握通行权。

五、一个很有意思的反差:一边做TPU,一边还在用GPU

很多人会问:既然谷歌在做自研芯片(TPU),是不是意味着别的算力不重要了?

答案恰恰相反。

1)TPU是什么?你可以把TPU理解为:

谷歌自己的“专用厨房”,用来:

* 训练自家模型

* 优化效率

* 降低成本

2)那为什么还离不开GPU?

原因很现实:外部世界更习惯用GPU

因为:

* 开发工具、生态都围绕GPU

* 使用门槛更低

* 迁移成本很高

所以结果是:想用TPU,但必须同时提供GPU。

否则客户很容易转去:

* Amazon Web Services

* Microsoft Azure

3)这件事真正说明什么?

很多人把它理解成: TPU在替代GPU。

但更准确的理解是: 算力需求太大 → 多种方案一起上。

* TPU:内部优化方案

* GPU:通用标准方案

两者不是对立,而是:并存 + 分层。

六、那钱到底流向哪里?

如果把这1800亿美元拆开,其实就是三条非常清晰的方向:

1)算力基础(最直接)

* AI芯片

* 服务器

* 数据中心

本质就是:给AI提供“体力”

2)数据传输(容易忽视)

* 光模块

* 网络连接

因为AI运行,本质是:数据在来回跑。没有通道,再强的算力也发挥不出来。

3)应用层(增长最快)

* 企业AI工具

* SaaS + AI

* API服务

云业务的爆发,本质就在这里。

七、一个更深的变化:行业开始“重资产化”

这份财报真正改变认知的一点是:AI已经不再是轻资产生意。

而是开始拼:

* 电力

* 资源

* 资本投入

这意味着什么?门槛在提高,参与者在变少。

八、老规矩用大白话总结

如果你只记住一句:过去卖的是流量,现在卖的是算力。

再补一句更关键的:TPU是谷歌的理想,GPU是行业的现实。

碎片里的逻辑:解读实时科技与产业热点。

所有内容仅为产业观察与个人观点,不构成任何建议。

芯片是怎么“长出来”的?把CCP、ICP、LPCVD、ALD讲明白

请在微信客户端打开