清华大学: 《Anthropic 为什么成为迭代最快的AI团队》 (完整版.pdf ) 以下仅展示部分内容 下载方式见文末

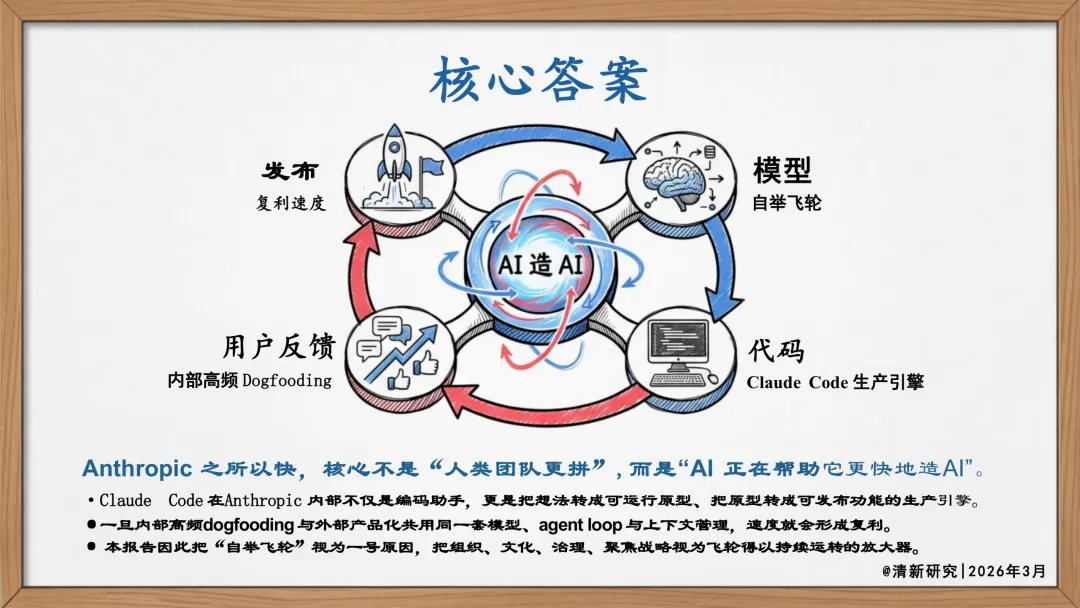

核心答案只有一句话:它不是靠人更拼,而是把AI变成了自己造AI的超级引擎

在AI行业狂飙突进的今天,模型能力固然重要,但谁能把能力进步最快地压缩成真实发布与真实使用,谁才能真正拉开差距。清华大学一份最新研究报告,将目光聚焦在Anthropic身上——这家被公认为“迭代最快AI团队”的公司,究竟做对了什么?

报告指出,Anthropic的速度不是单点快,而是模型、工具、组织、评测与治理一起快。其背后是一套被称为“自举飞轮”的系统性机制。以下为报告核心内容的详细解读。

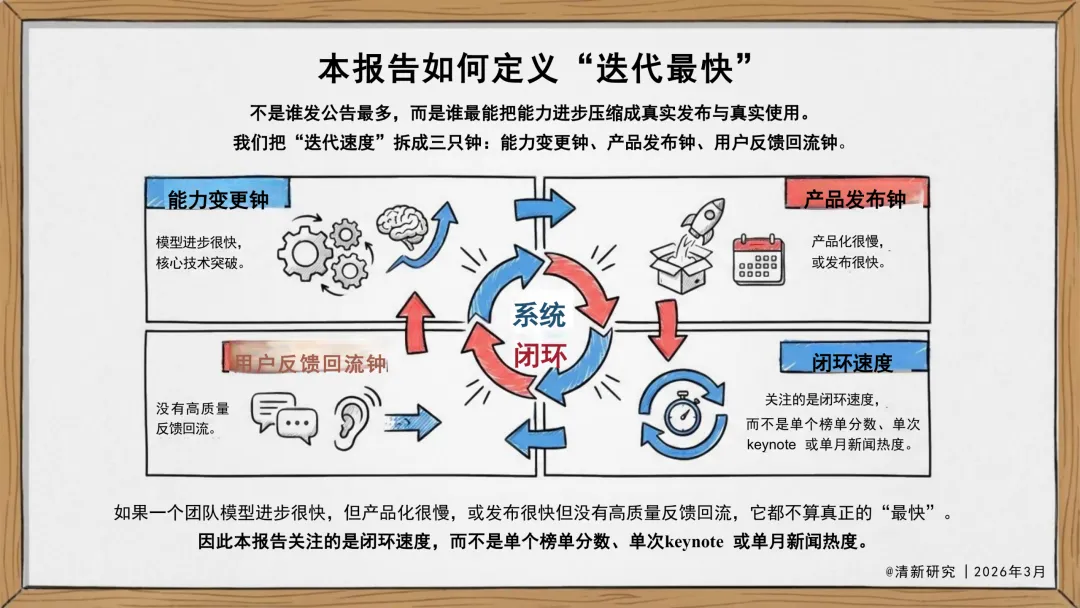

一、什么是“迭代最快”?三只钟的闭环速度

报告首先给出了一个关键定义:迭代最快不是谁发公告最多,而是谁最能把能力进步压缩成真实发布与真实使用。

为此,报告提出“三只钟”的度量框架:

能力变更钟:模型本身进步的速度

产品发布钟:功能推向市场的速度

用户反馈回流钟:从使用到改进的闭环速度

如果一个团队模型进步很快但产品化很慢,或者发布很快但没有高质量反馈回流,都不算真正的“最快”。真正的速度是闭环速度,而不是单项榜单分数或单月新闻热度。

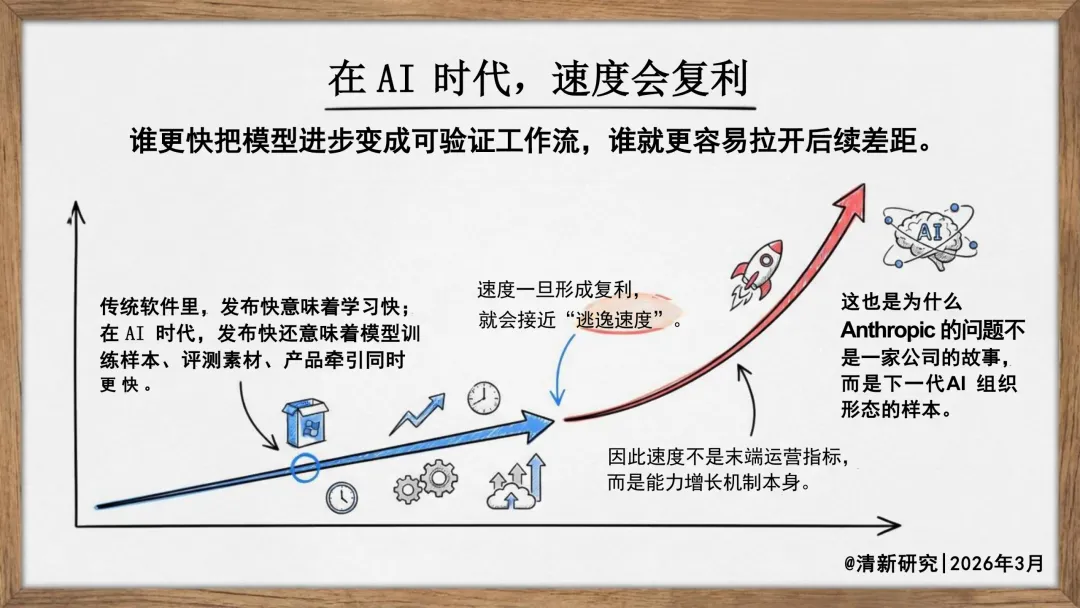

在AI时代,速度会复利:谁更快把模型进步变成可验证的工作流,谁就更容易拉开后续差距。

二、公开证据:为什么说Anthropic在第一梯队?

报告列举了多条可公开核验的证据:

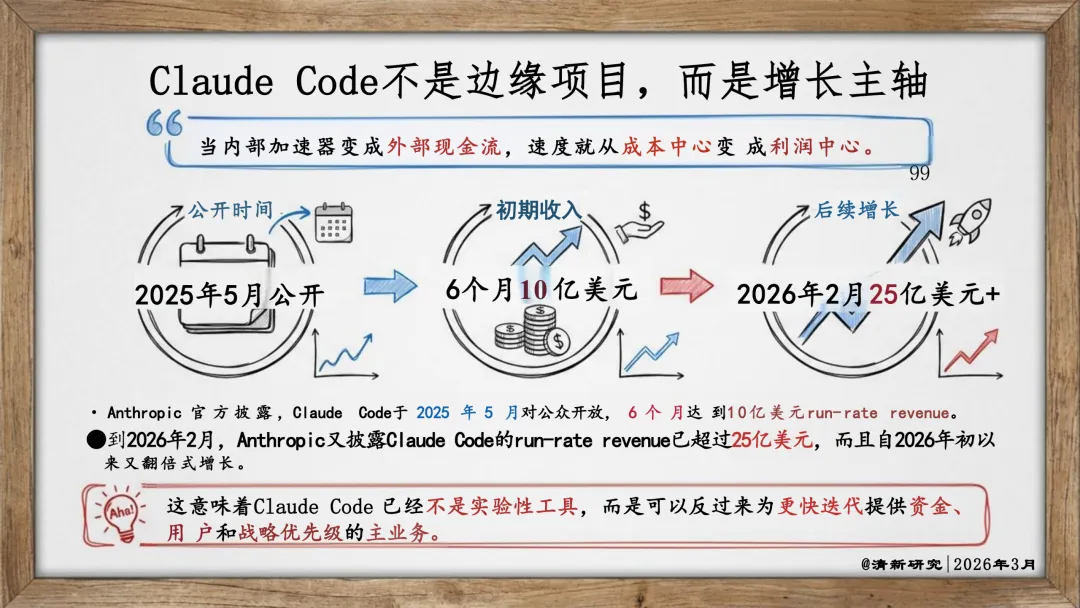

Claude Code的商业成功:2025年5月对公众开放,6个月达到10亿美元年化收入(run-rate revenue);到2026年2月,这一数字已超过25亿美元,且自2026年初以来翻倍增长。这意味着Claude Code不仅是内部工具,更成为反向为更快迭代提供资金、用户和战略优先级的主业务。

高频发布节奏:2026年1月,Anthropic一个月发布了超过30个产品与功能。这不是感受,而是官方披露的公司级节奏。

小步快跑的产品迭代:Claude Code的发布说明展示出大量1.x、2.x的连续点版本更新,涵盖UI、插件、MCP、权限、模型选择与性能优化。团队在做非常密集的修正、扩展与试验,而不是等完美版本再上线。高频小步快跑的价值在于:把风险拆小,把反馈拉近,把产品和内部使用同步校正。

内部工程吞吐量的结构性跃升:速度飞轮首先表现在工程输出,而非抽象愿景。Anthropic内部研究显示,27%的Claude辅助工作属于“如果没有Claude就不会做”的任务。这类任务包括扩展项目范围、制作原本不值得人工投入的小工具、以及更多探索性工作。当一个组织能把边角需求、探索性修补和小型自动化都吞下去,累计进化速度会显著上升。

工程师角色从“专才”转向更广义的全栈:一个人不再必须等另一个专门岗位排期,很多跨栈等待被Claude压缩掉了。Anthropic的工程师开始跨越前端、数据库、可视化、调试等原本不熟悉的领域完成任务。速度因此不只是token更快,而是组织排队时间显著减少。

Agent任务复杂度提升:Claude Code的自主能力显著增强,能独立完成更多连续动作,推动快速迭代和更复杂功能的实现。

综上,公开证据已经足够说明:Anthropic的速度不是营销幻觉,它同时表现在工程吞吐量、发布频率、用户牵引与收入牵引上。

三、核心机制:为什么能持续快?

报告的核心答案非常直接:Anthropic快,是因为它已经把AI变成了自己的研发操作系统。Claude Code在Anthropic内部不是编码助手,而是把想法转成可运行原型、把原型转成可发布功能的生产引擎。

1. 高强度、跨职能的内部使用(Dogfooding)

Anthropic官方案例显示,数据基础设施、产品开发、安全工程、推理、数据科学、增长营销、产品设计、法务等团队都在使用Claude Code。这意味着内部反馈不是单一工程场景,而是覆盖从调试、理解代码、自动化到跨职能协作的真实任务集。

很多公司内部工具和对外产品是两套栈,内部收益无法快速转成市场验证;Anthropic恰恰相反。Claude Code的内部使用会直接暴露问题、提出需求、产生新工作流,这些发现又能快速沉淀到对外版本。产品团队不是隔着用户猜需求,而是在用自己每天的工作流直接制造需求。

2. 共享同一套Agent Loop

Anthropic文档明确写道,Agent SDK提供的tools、agent loop与context management,正是驱动Claude Code的同一套核心机制。内部已经证明有效的执行框架,可以非常快地变成可编程的外部能力,被客户和生态复用。当内部和外部共用底座,组织不会为“内部版”和“客户版”维护两套完全不同的系统。

3. 模型变强直接提升自身开发速度

因为内部广泛使用Claude Code,任何模型在代码理解、调试、规划和长链路执行上的增强,都会立刻变成内部生产率增益。Anthropic的模型进步不需要经过漫长的“组织吸收期”,而是可以快速体现在开发节奏上。当模型改进、工具改进与组织吸收同时发生,速度就会呈现出复利效应。

4. 真实任务反馈成为“活数据”

高频真实使用,让Anthropic拿到的是“活数据”而不是“纸面反馈”。内部员工每天在真实代码库、真实权限、真实协作关系中使用Claude Code,这些反馈比实验室环境更接近生产。当一个问题在内部被高频撞到,它通常会以更短路径进入产品修正或模型改进。Dogfooding不是文化口号,而是高速反馈基础设施。

5. 原型即规格

传统组织里,需求先变成长文档,再变成排期,再变成实现。Anthropic的优势在于,这条链路被Claude Code强行压短。因为原型产出成本骤降,讨论可以更早围绕可执行物展开,而不是围绕大量前置文字展开。这意味着“原型先行、文档补全”的比例显著上升。

这种模式会把组织节奏改造成小批量连续发布。每次改动更小、解释成本更低、回滚更容易,组织更愿意加速。发布本身因此从“重大仪式”转成“日常动作”。

6. 收入反哺速度飞轮

Claude Code达到十亿美元、再到二十五亿美元以上的年化收入,意味着它已经能反向争取资源、人才与组织优先级。继续给Claude Code投入并不是“研究预算”,而是“增长预算”。产品增长、模型改进与工程效率共同争夺更多内部权重,进一步强化速度优势。

7. 为什么是编码场景?

编码任务有清晰输入输出、可自动验证、可拆分步骤、可持续复用上下文,天然适合Agent化。更重要的是,编码又直接决定AI公司的产品交付速度,因此在Anthropic内部具有双重杠杆。谁先把编码做成高效Agent,谁就更容易把整家公司变成“AI帮助建造AI”的系统。

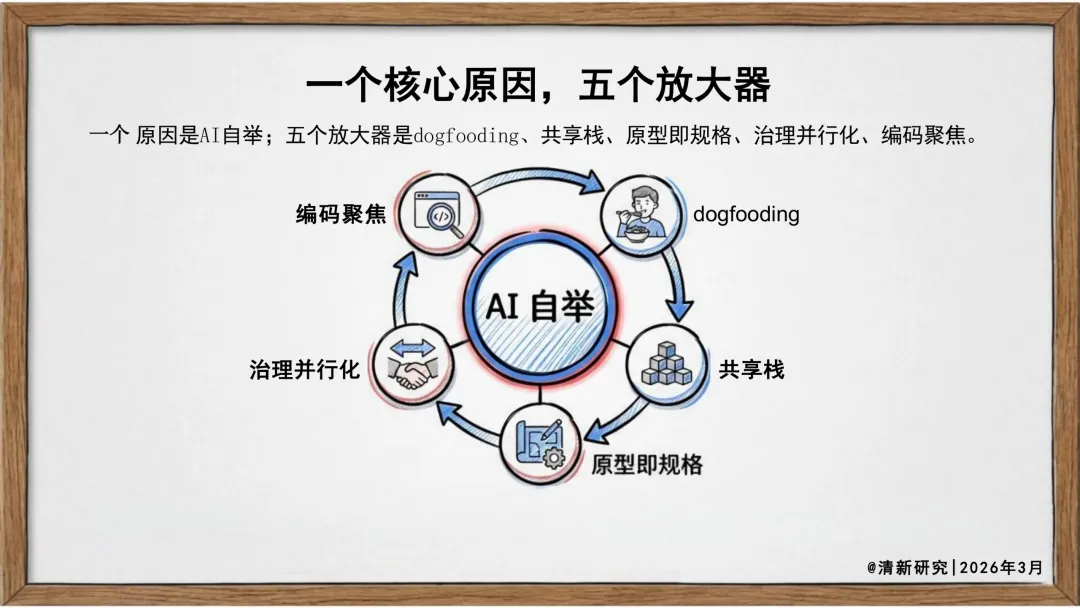

四、五个放大器:让飞轮持续运转

报告提出,一个核心原因(AI自举)之外,还有五个放大器,它们共同把Claude Code从“一个好工具”变成了“组织操作系统”:

Dogfooding(内部先行):内部高频使用与外部产品化共用同一套模型和工具,速度形成复利。

共享栈:内部和外部共用同一套agent loop与上下文管理,改进成果能快速扩散。

原型即规格:用可运行原型代替长文档前置,协调成本下降。

治理并行化:安全与风控不是末端审批,而是嵌入开发全过程,减少最后一分钟扯皮。

编码聚焦:从最容易复利的编码场景切入,形成突破口。

没有这些放大器,Claude Code只是工具;有了它们,它才变成组织操作系统。

五、组织形态:小团队、短链路、并行制

Anthropic的速度不需要每一步都经过重文档和长排期。当个体被Claude放大后,一个小团队就能承担原本需要更多角色接力的工作,协调成本下降。组织更容易形成短链路试错:先做、先用、再修,而不是先协商完整、再执行。

同时,稳定的组织味觉也很关键。公开资料显示,Anthropic七位联合创始人仍在公司,并持续把安全与产品能力作为共同主线。这种连续性让组织在工具、模型与政策持续演进时仍保持比较稳定的判断基线,少走反复推翻的弯路。

治理并没有成为刹车,而是被工程化成了护栏。系统卡、风险报告与透明机制,减少了“最后一分钟政策扯皮”。真正快的组织,会把治理做成运行时,而不是末端审批。Anthropic的RSP(负责任扩展政策)与系统卡实践,正是把NIST的AI风险管理框架落成内部可运行机制的范例。它的速度不是“绕过治理”,而是“让治理更少阻塞”。

六、工具化护城河:不只是模型强

如果只有模型,没有agent runtime、开发者界面、插件与上下文管理,速度优势很难放大。Claude Code + Agent SDK + MCP构成的是一整套工具化护城河。这种护城河比单一模型分数更能支撑持续迭代。

Anthropic的强点在于,它把模型能力沉到一套可复用工具链里,让内部开发、外部使用和生态接入共用同一引擎。这会使改进更容易扩散,bug更容易复现,需求更容易沉淀为平台能力。

七、边界与弱证据:不靠算力独大,也不靠文化独大

报告也明确指出了一些常见误解:

速度优势不足以由“算力更多”单独解释。算力是燃料,不是传动系统。很多AI实验室都能获得大量算力,但并不是所有团队都把算力差异转成同样密集的产品节奏。Anthropic的独特之处,是把模型能力通过Claude Code和Agent SDK变成了组织速度,而不只是benchmark成绩。

模型强并不自动等于组织快。如果模型强但内部吸收慢,能力不会自动变成速度。Anthropic自己的内部研究证明,速度提升依赖使用占比、任务委派方式、可验证性与工具链配置,而不只是模型本身更聪明。

不是文化alone。扁平文化或使命感也不足以单独解释速度。如果没有可执行工具与共享栈,文化只能提高意愿,不能压缩周期。正确的理解是:文化让组织更愿意相信和采用AI,自举工具让这种信任转成真实速度。

此外,报告刻意没有把一些流传很广的数字(如“52天74个功能”“代码库90%由AI编写”等)纳入主证据链,因为缺少足够稳定的一手公开出处。这些信息只作为方向性信号,不承担主结论。

八、速度飞轮也有成本

报告也坦率指出,速度飞轮并非没有代价。Anthropic内部研究提到,AI使用会带来技能退化、协作减少、监督变难等担忧。越快的系统,越需要及时修复自己的副作用。如果agent速度继续上升而验证机制没有同步增强,速度会反而转化为质量债。因此,真正成熟的速度系统,不只追求更快,还要不断升级校验、评测、权限与训练。

九、五个原创概念:Anthropic的速度操作系统

报告提炼了五个核心概念,共同构成Anthropic的速度操作系统:

自举飞轮:模型变强 + Claude Code变强 + 内部开发变快 + 更多真实反馈 + 再反哺模型。这是一个自我增强系统,组织速度从线性提升变成复利提升。

原型即规格:可运行原型前置 + 长文档后置 + 协调成本下降。当AI把想法变成可运行原型的成本降到足够低,最重要的规格不再只是文档,而是先跑起来的东西。

运行时型组织:统一agent runtime + 实时验证 + 边做边决策。传统组织像“编译型”,先写很多静态说明再整体执行;Anthropic更像“运行时型”,在统一runtime上不断试、改、发。

治理并行化:规则前置 + 评测内嵌 + 风险在开发中被持续处理。把“能不能发”的摩擦,转成“按什么规则持续发”的制度。

工具化护城河:模型能力沉到runtime、接口与生态里,形成持续迭代优势。单一模型分数容易被追平,但被嵌入工作流的能力更难被复制。

这五个概念分别解释起点、节奏、组织、治理与护城河,组合起来就是Anthropic的速度操作系统。

十、对外部团队的七点启示

报告最后为希望学习Anthropic的团队提出了具体建议:

启示一:先在编码dogfooding上突破

不要一开始追求所有场景全面铺开。先在最容易复利的环节——编码、调试、文档、自动化——把AI变成默认工作面,比同时铺开所有知识工作更容易形成飞轮。

启示二:最强的内部工具,应该变成最强的外部产品

很多组织把内部提效工具做成“仅内部可用”,于是优先级总被外部业务挤压。Anthropic反过来把Claude Code做成收入主轴,让内部提效工具与外部增长工具变成同一件事。只有内外同构,内部投资才会不断得到市场强化。

启示三:把评测、权限与治理嵌进运行时

越早做成系统,越不容易在速度上被治理拖住。参考NIST的AI风险管理框架和Anthropic的RSP,用明确阈值与模板,把高风险治理做成日常工程。

启示四:用“三只钟”测速度,而不是只看每周上线次数

真正的速度度量,需要同时看能力、发布与反馈。如果只看上线次数,团队很容易变成低质量快发;如果只看benchmark,团队又会变成高分低产。三只钟相互校验才是正解。

启示五:工程师会越来越像“AI主管”,组织要重做角色定义

速度飞轮会改变岗位,而不是只改变工具。工程师的角色重心在转向委派、验证、审校和最终责任。外部团队如果还把AI当作单纯的插件,而不改变岗位边界,很难吃到全部速度红利。下一代高效团队,很可能是“少量专家 + 大量agent + 强验证习惯”的组合。

启示六:坚持小批量、连续发布,而不是攒功能包

快团队的核心美德不是“大动作”,而是“更短的学习半径”。小批量发布能让错误更小、解释成本更低、回滚更快,长期看比大版本冲刺更容易保持高速度。真正的速度不是偶尔冲刺,而是连续形成肌肉记忆。

启示七:金字塔底部是编码楔子,上层才是更广平台

最后结论

Anthropic之所以成为迭代最快的AI团队,根本上是因为它先把自己改造成了“AI帮助建造AI”的组织。

Claude Code不是附属产品,而是Anthropic的研发超级加速器;Agent SDK、发布节奏、治理规则和商业化让这台加速器持续增压。因此Anthropic的领先,不只是能力领先,更是速度系统领先。只要这个自举飞轮继续转动,它在未来一段时间内仍大概率保持极强的执行优势。

对于所有AI从业者而言,真正的分水岭可能不是“谁先有模型”,而是“谁先把模型嵌入组织操作系统”。Anthropic已经提前显现了这种分化。

☟☟☟

☞人工智能产业链联盟筹备组征集公告☜

☝

精选报告推荐:

Openclaw龙虾专题:

【报告】Openclaw龙虾专题一:清华大学-龙虾OpenClaw发展研究报告1.0版(附PDF下载)

【报告】Openclaw龙虾专题二:清华大学-龙虾OpenClaw自我研究报告1.0版(附PDF下载)

【报告】Openclaw龙虾专题三:2026年部OpenClaw代理解决方案(附PDF下载)

【报告】Openclaw龙虾专题四:OpenClaw发展研究报告2.0版--深度研究报告(附PDF下载)

【报告】Openclaw龙虾专题五:OpenClaw蓝皮书:人人都能拥有的AI常驻助手(附PDF下载)

【报告】Openclaw龙虾专题六:OpenClaw未来可能方向研究报告(附PDF下载)

【报告】Openclaw龙虾专题七:OpenClawAI从聊天到行动下一代智能助手白皮书(附PDF下载)

【报告】Openclaw专题八:2026年OpenClaw安全部与实践指南(360护航版)(附PDF下载)

【报告】Openclaw专题九:2026年OpenClaw入门指南-当AI长出了手脚:一份给聪明人的理性上手手册(附PDF下载)

【报告】Openclaw专题十:OpenClaw新手入门宝典(附PDF下载)

【报告】Openclaw专题十一:腾讯2026最全企业级安全养虾教程(附PDF下载)

【报告】Openclaw专题十二:OpenClaw养虾全景报告(附PDF下载)

【报告】OpenClaw专题十三:吹响AIAgent时代号角(附PDF下载)

【报告】OpenClaw专题十四:OpenClaw从入门到精通指南一-技能提升必看2026(附PDF下载)

【报告】OpenClaw专题十五:OpenClaw深度调研报告-从对话到执行的AI智能体革命(附PDF下载)

【报告】OpenClaw专题十六:厦门大学-智能体OpenClaw(小龙虾)应用实践(附PDF下载)

【报告】OpenClaw专题十七:龙虾全自动科研报告一-OpenClaw替我干科研(附PDF下载)

【报告】OpenClaw专题十八:投研人如何养“虾”?(附PDF下载)

【报告】OpenClaw专题十九:清华大学:OpenClaw与数字员工研究报告(附PDF下载)

【报告】OpenClaw专题二十:2026年OpenClaw生态威胁分析报告(附PDF下载)

【报告】OpenClaw专题二十一:清华&北航:OpenClaw科研手册实操精简版(附PDF下载)

【报告】OpenClaw专题二十二:政企版龙虾OpenClaw安全使用指南(2026)(附PDF下载)

【报告】OpenClaw专题二十三:九章智算云:2026年OpenClaw安全操作指南报告(附PDF下载)

【报告】OpenClaw专题二十四:北京大学:OpenClaw001龙虾使用入门(2026年)(附PDF下载)

【报告】OpenClaw专题二十五:OpenClaw:驯化还是进化?(附PDF下载)

【报告】OpenClaw专题二十六:北京大学:龙虾第三次AI平民化自主Agent时代到来(附PDF下载)

【报告】OpenClaw专题二十七:腾讯云智能体开发平台企业级ADPClaw最佳实践与教程(附PDF下载)

【报告】OpenClaw专题二十八:AI原生组织:OpenClaw推动组织形态重塑(附PDF下载)

【报告】OpenClaw专题二十九:龙虾(OpenClaw)管理学-面向Al Agent 时代的组织设计、流程治理与经营控制(附PDF下载)

【报告】OpenClaw专题三十:2026阿里云DataClaw帮你“智”动驾驶数据库(附PDF下载)

11份清华大学的DeepSeek教程,全都给你打包好了,直接领取:

【清华第四版】DeepSeek+DeepResearch让科研像聊天一样简单?

【清华第七版】文科生零基础AI编程:快速提升想象力和实操能力

【清华第十一版】2025AI赋能教育:高考志愿填报工具使用指南

10份北京大学的DeepSeek教程

【北京大学第五版】Deepseek应用场景中需要关注的十个安全问题和防范措施

【北京大学第九版】AI+Agent与Agentic+AI的原理和应用洞察与未来展望

【北京大学第十版】DeepSeek在教育和学术领域的应用场景与案例(上中下合集)

8份浙江大学的DeepSeek专题系列教程

浙江大学DeepSeek专题系列一--吴飞:DeepSeek-回望AI三大主义与加强通识教育

浙江大学DeepSeek专题系列二--陈文智:Chatting or Acting-DeepSeek的突破边界与浙大先生的未来图景

浙江大学DeepSeek专题系列三--孙凌云:DeepSeek:智能时代的全面到来和人机协作的新常态

浙江大学DeepSeek专题系列四--王则可:DeepSeek模型优势:算力、成本角度解读

浙江大学DeepSeek专题系列五--陈静远:语言解码双生花:人类经验与AI算法的镜像之旅

浙江大学DeepSeek专题系列六--吴超:走向数字社会:从Deepseek到群体智慧

浙江大学DeepSeek专题系列七--朱朝阳:DeepSeek之火,可以燎原

浙江大学DeepSeek专题系列八--陈建海:DeepSeek的本地化部署与AI通识教育之未来

4份51CTO的《DeepSeek入门宝典》

51CTO:《DeepSeek入门宝典》:第1册-技术解析篇

51CTO:《DeepSeek入门宝典》:第2册-开发实战篇

51CTO:《DeepSeek入门宝典》:第3册-行业应用篇

51CTO:《DeepSeek入门宝典》:第4册-个人使用篇

5份厦门大学的DeepSeek教程

【厦门大学第一版】DeepSeek大模型概念、技术与应用实践

【厦门大学第五版】DeepSeek等大模型工具使用手册-实战篇

10份浙江大学的DeepSeek公开课第二季专题系列教程

【精选报告】浙江大学公开课第二季:《DeepSeek技术溯源及前沿探索》(附PDF下载)

【精选报告】浙江大学公开课第二季:2025从大模型、智能体到复杂AI应用系统的构建——以产业大脑为例(附PDF下载)

【精选报告】浙江大学公开课第二季:智能金融——AI驱动的金融变革(附PDF下载)

【精选报告】浙江大学公开课第二季:人工智能重塑科学与工程研究(附PDF下载)

【精选报告】浙江大学公开课第二季:生成式人工智能赋能智慧司法及相关思考(附PDF下载)

【精选报告】浙江大学公开课第二季:AI大模型如何破局传统医疗(附PDF下载)

【精选报告】浙江大学公开课第二季:2025年大模型:从单词接龙到行业落地报告(附PDF下载)

【精选报告】浙江大学公开课第二季:2025大小模型端云协同赋能人机交互报告(附PDF下载)

【精选报告】浙江大学公开课第二季:DeepSeek时代:让AI更懂中国文化的美与善(附PDF下载)

【精选报告】浙江大学公开课第二季:智能音乐生成:理解·反馈·融合(附PDF下载)

6份浙江大学的DeepSeek公开课第三季专题系列教程

【精选报告】浙江大学公开课第三季:走进海洋人工智能的未来(附PDF下载)

【精选报告】浙江大学公开课第三季:当艺术遇见AI:科艺融合的新探索(附PDF下载)

【精选报告】浙江大学公开课第三季:AI+BME,迈向智慧医疗健康——浙大的探索与实践(附PDF下载)

【精选报告】浙江大学公开课第三季:心理学与人工智能(附PDF下载)

篇幅有限,部分展示 加入会员,任意下载 资料下载方式

Download method of report materials

关注公众号后回复:DD260425 即可领取完整版资料

荐: 【中国风动漫】《姜子牙》刷屏背后,藏着中国动画100年内幕! 【中国风动漫】除了《哪吒》,这些良心国产动画也应该被更多人知道!

【中国风动漫】《雾山五行》大火,却很少人知道它的前身《岁城璃心》一个拿着十米大刀的男主夭折!

如需获取更多报告

报告部分截图

编辑:Zero

文末福利

1.赠送800G人工智能资源。

获取方式:关注本公众号,回复“人工智能”。

2.「超级公开课NVIDIA专场」免费下载

获取方式:关注本公众号,回复“公开课”。

3.免费微信交流群:

人工智能行业研究报告分享群、

人工智能知识分享群、

智能机器人交流论坛、

人工智能厂家交流群、

AI产业链服务交流群、

STEAM创客教育交流群、

人工智能技术论坛、

人工智能未来发展论坛、

AI企业家交流俱乐部

雄安企业家交流俱乐部

细分领域交流群:

【智能家居系统论坛】【智慧城市系统论坛】【智能医疗养老论坛】【自动驾驶产业论坛】【智慧金融交流论坛】【智慧农业交流论坛】【无人飞行器产业论坛】【人工智能大数据论坛】【人工智能※区块链论坛】【人工智能&物联网论坛】【青少年教育机器人论坛】【人工智能智能制造论坛】【AI/AR/VR/MR畅享畅聊】【机械自动化交流论坛】【工业互联网交流论坛】

入群方式:关注本公众号,回复“入群”

戳“阅读原文”下载报告。