写代码、做分析、处理多语言文档、生成报告......大语言模型(LLM)正在以前所未有的速度融入我们的日常工作流,且产出更快、更流畅、更专业。

但有一个问题很少被讨论:当我们用 LLM 做出一份高质量产出时,这份产出究竟在多大程度上反映了我们的真实能力?

过往研究大多聚焦在系统侧,即模型的可靠性、幻觉问题、用户对 AI 的信任。而“LLM 如何重塑用户对自身能力的认知”这一用户侧问题,尚未被大量研究。

在这项工作中,来自 ddai Inc. 的研究团队提出了“LLM 谬误”(LLM Fallacy)这一新概念,将其定义为一种认知归因错误:个体将 LLM 协助产生的输出,误认为是自己独立能力的证据,导致感知能力与实际能力之间出现系统性偏差。

论文链接:https://arxiv.org/pdf/2604.14807

据论文描述,LLM 的不透明性、流畅的输出表现,以及低摩擦的交互模式,共同模糊了人机贡献之间的边界,使用户倾向于从产出结果而非产出过程中推断自身的能力水平。

分析进一步表明,这一模式广泛存在于计算、语言、分析、创意、认识论与职业等多个领域,说明 LLM 谬误并非特定领域的孤立现象,而是跨认知工作形式的结构性规律。

研究团队认为,“越来越好用”的 LLM 究竟如何影响我们对自己的认识、如何扭曲我们的能力判断,在未来是一个绕不开的问题。

从更长远的眼光来看,正视这一问题,是确保人机协作真正有益的前提,不只是让我们做得更好,也要让我们对自己的判断保持正确的认知。

LLM谬误到底是什么?

LLM 谬误,不等于幻觉(hallucination”)。

幻觉指的是“模型凭空生成错误的内容”,是一个系统侧的失败;而 LLM 谬误讨论的是“用户如何在认知层面解读这份产出”,是一个用户侧的归因问题。即便模型输出完全正确,LLM 谬误依然会发生。

LLM 谬误与“自动化偏差”(automation bias)和“认知卸载”(cognitive offloading)也不同。

后两者关注任务执行与决策,即用户是否过度依赖系统、是否把认知负担外包给系统;而与 LLM 谬误相关是“系统产出如何被吸收进用户的自我能力评估中”。

研究团队表示,LLM 谬误只有在以下三个条件同时满足时才会发生:

- 任务由 LLM 中介生成;

- 人机交互的衔接足够顺滑,以至于输入与输出的边界被模糊;

- 输出的流畅度达到了通常与熟练人类表现相关联的水平。

LLM谬误是怎么产生的?

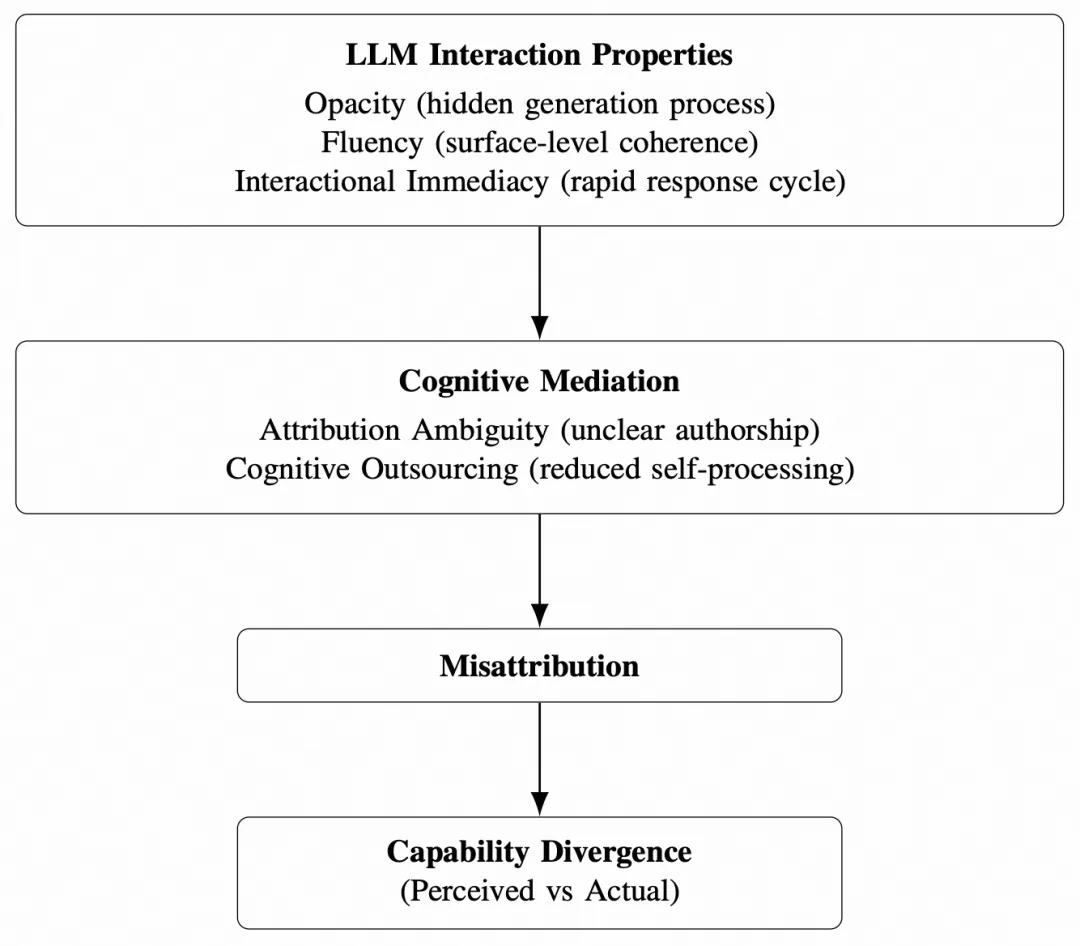

在他们看来,LLM 谬误几乎是一种“结构性必然”,并给出了一个四环节机制模型,如下:

1.归因模糊(Attribution Ambiguity)

在 LLM 交互中,用户提供的 prompt 往往是零碎、迭代、不完整的,而系统返回的是结构化、连贯的成品。在这种反复来回的循环中,“哪部分是人写的、哪部分是机器生成的”变得难以区分。

研究团队援引 Nisbett & Wilson 的经典工作指出,人对自己认知过程的内省本就有限,在人机协作里,这种局限被进一步放大,用户容易在事后构建出一套关于“自己贡献了什么”的叙事。

2.流畅性错觉(Fluency Illusion)

LLM 的产出通常语法正确、语境贴切、风格统一,几乎与熟练人类表现没有差异。这种表层流畅会作为一个启发式线索,让用户从“处理起来很顺”,直接推断出“写得很好、甚至我写得很好”。

同时,流畅度还会影响对可信度与专业性的判断,即便没有做深入评估,用户也倾向于认为产出是准确且高水平的。

3.认知外包(Cognitive Outsourcing)

LLM 让用户能以非常小的代价把推理、写作、问题求解等复杂任务外包出去。当系统承担越来越多的认知负担,用户本人参与产出的思考过程就越少,评估自身理解深度的能力也随之减弱。

4.流程不透明(Pipeline Opacity)

在传统工具中,中间步骤是可观察、被用户“左右”的;而 LLM 把检索、模式匹配、综合生成统统抽象进了黑盒。用户看不到中间过程,就无法追溯输出是怎样一步步生成的,也就更难判断贡献的分配。

这四个因素相互强化,最终导致用户“感知能力膨胀”,高估自己的独立能力。

图|LLM 谬误的产生机制。LLM 的交互特性(不透明性、输出流畅与即时响应)塑造了认知中介过程,具体表现为“归因模糊”与“认知外包”。这些过程导致用户对系统生成内容产生系统性的错误归因,最终造成感知能力与真实能力之间的差异。

LLM谬误是广泛存在的

他们还搭建了一套跨领域的类型学,指出尽管底层机制一致,LLM 谬误在不同任务中的具体形态各有差异。

计算领域:用户借助 LLM 生成脚本或应用,代码能跑通,但对底层架构、依赖关系、优化策略缺乏理解。“跑通”被误读为“技术能力”。

语言领域:用户生成了流畅的多语言文本,但并不具备独立使用该语言的能力。LLM 产出的语法正确、语境得当,让用户将表层形式误判为内化的语言能力,这对应语言学研究中“形式”与“语义能力”的经典区分。

分析领域:LLM 能生成结构化的推理与分步分析,用户在接触这些产出后,会产生“自己具备分析能力”的错觉,但真正独立推理时并不能复现。

创意领域:LLM 参与了叙事、论证、文风润色,但用户可能将其误认为自己的创造力或作者身份。

认知领域:LLM 能总结复杂材料、生成通俗解释,用户容易将“能够获取信息”等同于“已经掌握概念”,这与认知科学中长期记录的“解释深度错觉”相吻合。

职业信号领域:这是最具现实冲击力的维度。个人在简历、面试、对外沟通中呈现的能力,可能基于“我能用 LLM 做出这些产出”,而非“我独立掌握这些技能”,从而导致能力的系统性虚报。

研究团队虽然没有设计随机对照实验,但梳理了他们在多个应用场景中反复观察到的规律,以此作为这一概念的经验依据。

在代码与系统构建中,他们发现,LLM 确实能提升完成率、帮助理解代码,但用户常常不内化背后的推理;更关键的是,代码的表层正确性并不等于深层正确性,很多隐性错误在缺乏领域经验时根本看不出来。

同时,在招聘与候选人评估中,AI 协助会提升可观察的任务表现,同时增加用户对系统的依赖,但个人的独立能力未必会同步提升,如果只看产出,就很容易做出系统性高估。

此外,在教育场景中,当 AI 直接提供解法或中间推理时,用户参与材料的深度会下降,“附带学习”(incidental learning)的机会减少,尽管可能带来短期成绩的提升,但会弱化任务完成与概念掌握之间的关联。

他们指出,这背后的共性是:从产出推断能力,而非从产生产出的过程推断能力。这是一种在心理学中很早便有记录的偏差,只是被 LLM 的流畅性与即时性进一步放大了。

LLM谬误如何改写评估体系

研究团队还写道,LLM 谬误不止是个人认知问题,它会穿透到依赖“可观察产出”作为能力代理指标的一切制度安排。

例如,在招聘中,候选人提交的作品或展示的解决方案,可能反映的是 LLM 协助下的产出,而非其独立专长。如果招聘流程无法识别并纳入 AI 使用情况,就会系统性地高估候选人的真实能力。

在教育中,学生可以借助 LLM 完成作业、获取解释、搭建解题思路,短期表现或许有所提升,但表现与真实理解之间的关联并不清晰,评估的有效性也降低。

在技能认证中,证书本是已验证能力的背书。然而,当用户可以在 LLM 协助下达到基于产出的认证门槛,却并未形成相应的内化能力,证书作为能力信号的可靠性同样会降低。

因此,评估框架需要从以产出为中心,转向兼顾过程与人机贡献分配的评估模式。

与此同时,AI 素养框架也该同步更新,把一个关键的元认知能力纳入进来,即“搞清楚哪些是系统帮你做到的,哪些是你自己真正掌握的”。

不足与未来方向

研究团队坦承,这是一篇概念性论文,尚未经过受控实验验证。未来的研究方向包括:

首先,我们需要通过对照研究,直接比较“有 LLM 协助”与“无 LLM 协助”条件下的感知能力差异,进而观察感知与实际能力之间的发散;其次,我们需要开发量化这一发散的测量框架,将 LLM 谬误从“推断性现象”转化为“可测量的构念”,捕捉主观感知的同时,也评估客观表现。

他们还建议做纵向研究,随着 LLM 越来越深地嵌入日常工作,归因错位会越来越严重,还是会趋于稳定,抑或随着用户对LLM的认识逐渐成熟而减弱?

此外,在类型学的 6 个领域内分别做研究也很重要,不同领域的任务结构、评估标准和反馈机制差异显著,可能深刻影响这一现象的程度与表现形态。

最后,我们还需要探索降低归因错位的干预手段:让系统贡献更显性化的界面设计、提升用户对 LLM 能力边界意识的教育方案、以及能够区分“协助表现”与“独立表现”的评估框架。

总体而言,LLM 谬误所指向的,是生成式 AI 讨论中的一个视角转移:从关注系统本身的可靠性与对齐,转向关注人类认知如何在持续的人机交互中被重塑。

如今,当 AI 越来越深地嵌入我们日常的认知工作中,我们对其影响的评估就不能只看系统表现,还必须看人在其中的自我认知如何变化。

未来,如何让人机协作不仅提升绩效,也保持对自我能力的准确认知,会是 AI 素养与评估体系需要共同回答的问题。