锋行链盟推荐阅读

来源:中国信通院与人工智能产业发展联盟联合发布

以下是内容详情

一、 核心脉络:从“单点性能突破”到“系统协同优化”的范式转变

报告最核心的论断是,大模型推理优化已进入一个全新的阶段。其发展脉络可概括为:

需求侧的根本性转变:推理已成为大模型产业化的核心瓶颈与焦点。数据表明,推理计算量、服务调用量(如OpenAI API消耗增长320倍)、预算占比(OpenAI推理预算为训练成本的15倍)均已远超训练。这意味着优化重心必须从“如何造出好模型”转向“如何高效、经济地使用模型”。

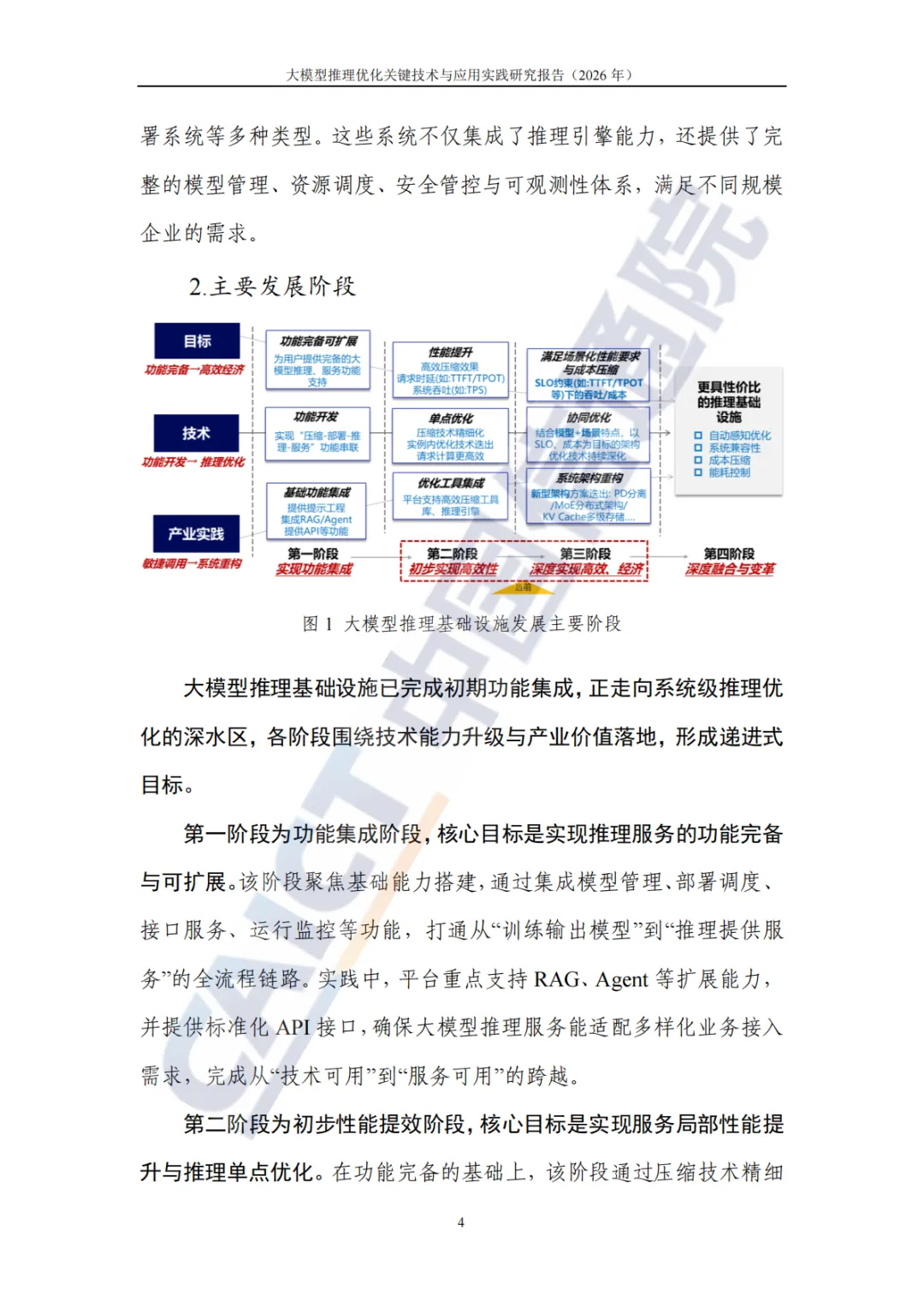

优化目标的演进:从早期追求单一的时延或吞吐指标,转变为在满足具体场景服务等级目标(SLO) 约束下的 “效果-性能-成本”多目标协同优化。成本控制被提到与性能同等重要的位置。

技术路径的深化:从模型压缩、推理引擎等“单点优化”工具,演进到以 “模型-架构-场景”协同 为特征的系统级优化。报告用大量篇幅介绍的PD(Prefill-Decode)分离、AF(Attention-Feedforward)分离、以KV Cache为中心的多级存储架构等,都是这一范式的典型体现。

二、 深层驱动逻辑:产业化压力下的“效率”与“经济性”双轮驱动

报告揭示的底层逻辑是,技术演进由强烈的产业化需求所驱动:

成本压力是首要驱动力:推理是持续性消耗,其成本伴随服务始终。企业无法承受粗放的资源利用方式。这直接催生了PD分离(让计算和内存密集型任务各得其所)、AF分离(在MoE中进一步精细分工)、以及将KV Cache卸载到更便宜的DRAM/SSD等“以存储换计算”、“以低成本硬件换高成本硬件”的设计哲学。

场景复杂性倒逼架构革新:低时延(对话)、高并发(批量生成)、长上下文(文档分析)、流量波动等多样化场景,无法用一套固定参数的传统架构满足。这要求系统具备弹性、可调度、可分解的特性。PD分离和动态调度策略正是为了灵活适配不同场景的SLO。

模型演进与系统架构的共设计:MoE模型成为主流,但其“稀疏激活”的特性对传统稠密模型推理架构提出了新挑战。报告重点分析的DeepSeek推理方案、MegaScale-Infer、Step-3 等,都是针对MoE模型的特性,在系统层面进行深度定制(如专家并行、负载均衡、AF分离)的典范,标志着模型设计与推理基础设施设计开始深度协同。

三、 关键技术体系的协同与层次关系

报告将关键技术分为模型、引擎、系统三层,这并非割裂,而是一个紧密协同的体系:

模型层是“源头”:旨在从根本上让模型变得“更易推理”。MoE架构通过稀疏计算降低单次推理开销;MLA(多头潜在注意力) 等算法优化直接目标就是压缩KV Cache;模型压缩(量化、剪枝)则直接减少计算和存储需求。这些为下层优化创造了更好的前提条件。

引擎层是“枢纽”:负责高效执行单个模型实例。其核心任务是管理好KV Cache(通过PagedAttention、RadixAttention)和计算(算子融合、内核优化)。它是系统层能力的执行基石,例如PD分离中的Decode阶段,高度依赖vLLM等引擎的连续批处理能力。

系统层是“大脑”:进行全局的资源调度与架构设计。PD分离 和 AF分离 是当前最核心的系统架构创新,它们从全局视角将不同计算特性的任务解耦,部署到最合适的硬件上,从而实现集群资源利用率的最大化。以KV Cache为中心的统一存储池(如Mooncake, UCM)则是解决长上下文和成本问题的系统性答案。

三者关系:模型层定义了计算和存储的基本模式;引擎层以最高效的方式实现这种模式;系统层则根据场景需求,灵活组织和调度多个引擎实例与存储资源,以达到全局最优。例如,一个采用MLA的MoE模型(模型层),通过SGLang引擎(引擎层)运行,并被部署在基于PD分离和AF分离的异构集群(系统层)上,构成了一个完整的协同优化范例。

四、 典型案例的启示:技术如何解决真实业务痛点

报告的案例部分至关重要,它验证了前述技术的价值:

金融案例:直击“推不动”(长上下文超出窗口)和“推得慢”(高并发时延高)两大痛点。解决方案(KV Cache持久化、动态稀疏、以查代算) 的核心思想是避免重复计算和智能压缩信息,这完全是“效果-性能-成本”三角平衡的实践。华为UCM套件的作用在此凸显。

运营商(九天)案例:展示了从“训推一体”到“PD分离”的全栈优化思路。“训推一体”降低了从训练到推理的迁移成本;PD分离 则直接提升了生产环境的吞吐并降低了硬件成本。这体现了大型平台方构建一体化、高效率AI基座的路径。

电力、农畜案例:证明了在专业领域(电力检修、养殖监控),通过结合领域知识(业务规则、场景识别)与推理优化技术(MoE适配、PD分离部署),能够实现从通用优化到场景化深度适配的跨越,解决特定行业的时效性、准确性难题。

五、 综合与展望:推理优化成为AI工程能力的核心壁垒

综合来看,本报告传递出一个明确信号:大模型竞争的下半场,推理优化能力将成为企业构建AI应用的核心工程壁垒和竞争力来源。

专业化与精细化:推理优化已从一个工程问题,发展成为一个涉及模型结构、硬件特性、调度算法、存储体系的专门学科。未来企业的AI团队需要具备相应的系统架构能力。

开源与生态竞争:报告列出的众多推理引擎和开源架构(vLLM, SGLang, Mooncake, DeepSeek等)表明,社区创新极其活跃。技术选型和融入生态的能力变得关键。

国产化与异构算力:报告中多次提及国产芯片适配(如Step-3案例),以及利用CPU、DRAM等异构资源。这表明未来推理基础设施将必然是异构、多元的,能够灵活调度和管理异构算力的平台更具优势。

从“资源消耗”到“价值服务”的桥梁:最终,所有优化技术的目标,都是为了更经济、更可靠地将大模型的能力转化为可规模化的商业服务。推理优化水平直接决定了AI服务的单位成本、响应速度和用户体验,从而决定了一项AI业务能否可持续地运营下去。

结论:这份报告不仅是一份技术综述,更是一份产业发展的路线图。它明确指出,大模型落地已进入“深水区”,成功的关键在于能否采用系统思维,实现跨模型、引擎、系统层级的协同优化,在保障效果的前提下,极致追求性能与成本的平衡。这标志着AI工程化从“粗放部署”进入“精耕细作”的新时代。

【锋行链盟】

锋行链盟一站式企业全周期赋能平台

已累计服务付费会员超 5000+,构建起高粘性、高价值的企业服务生态。依托由研究院、上市公司高管、创始人、投资人、券商投行、高校及政府机构组成的高端会员生态,为企业提供资源共享、专业人才对接、项目合作及港股 / 纳斯达克上市等全链条服务。

资源共享

汇聚企业、投资机构、政府部门、科研院所等核心资源,实现信息、渠道与机会互通。

项目合作与产业协同

提供产业链上下游匹配、技术合作、政企合作、园区落地、项目路演等合作机会。

专业化上市服务

由资深投行背景团队提供全流程上市辅导,助力企业登陆资本市场:

上市前期筹备

企业上市资质诊断、合规性梳理、财务规范指导、股权架构设计;

上市路径规划

结合企业实际情况,纳斯达克、香港联交所等多板块上市路径分析与选择建议;

中介机构对接

精准对接头部券商、知名律所、会计师事务所、保荐机构,降低沟通成本;

资本运作支持

涵盖上市融资、并购重组、再融资等全流程财务顾问服务,保障上市进程顺畅。