液冷技术加速渗透,大陆厂商迎来切入全球高端供应链机遇

1.1 算力爆发驱动液冷成为必选项,英伟达Rubin 架构引领“全液冷”革命

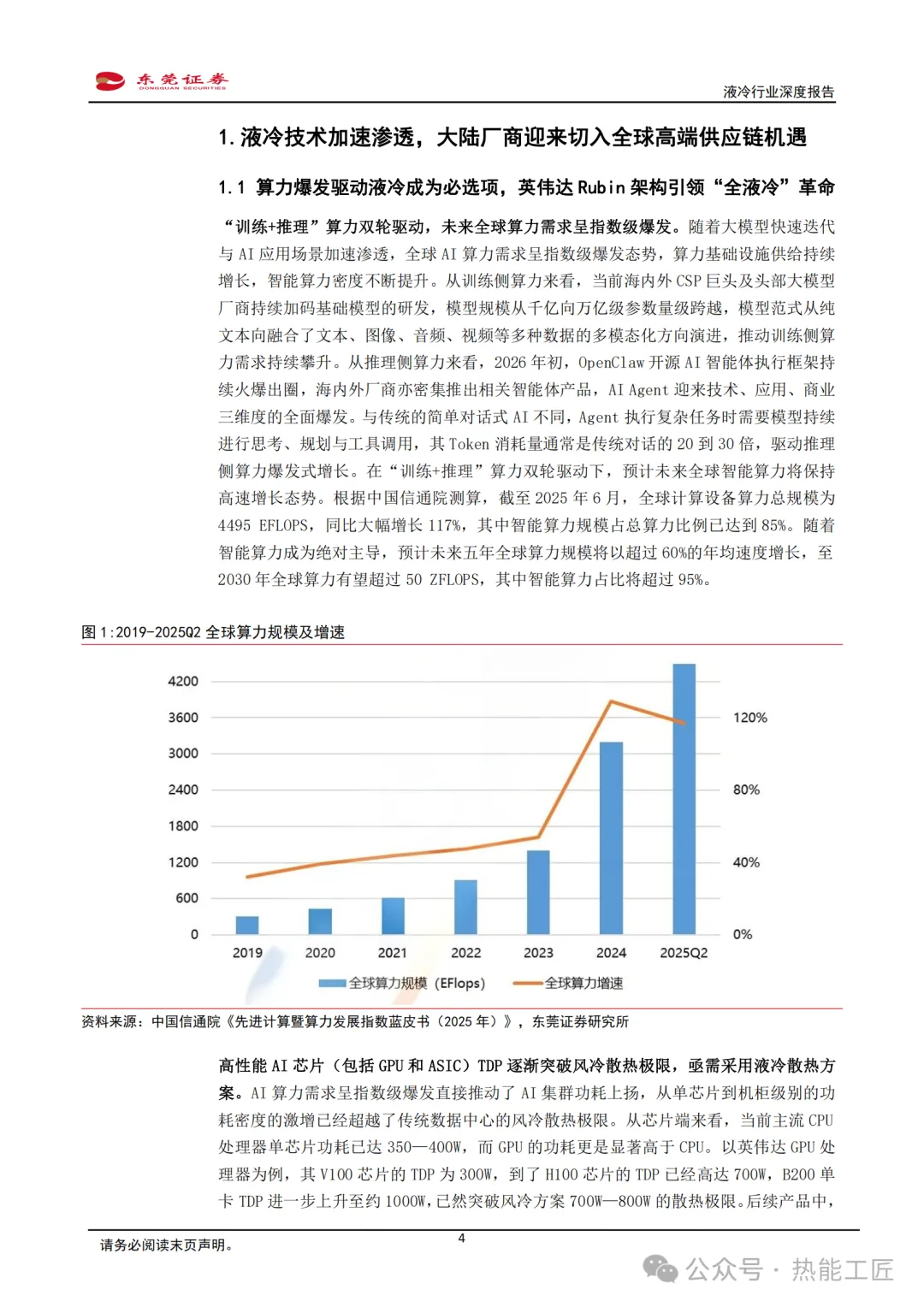

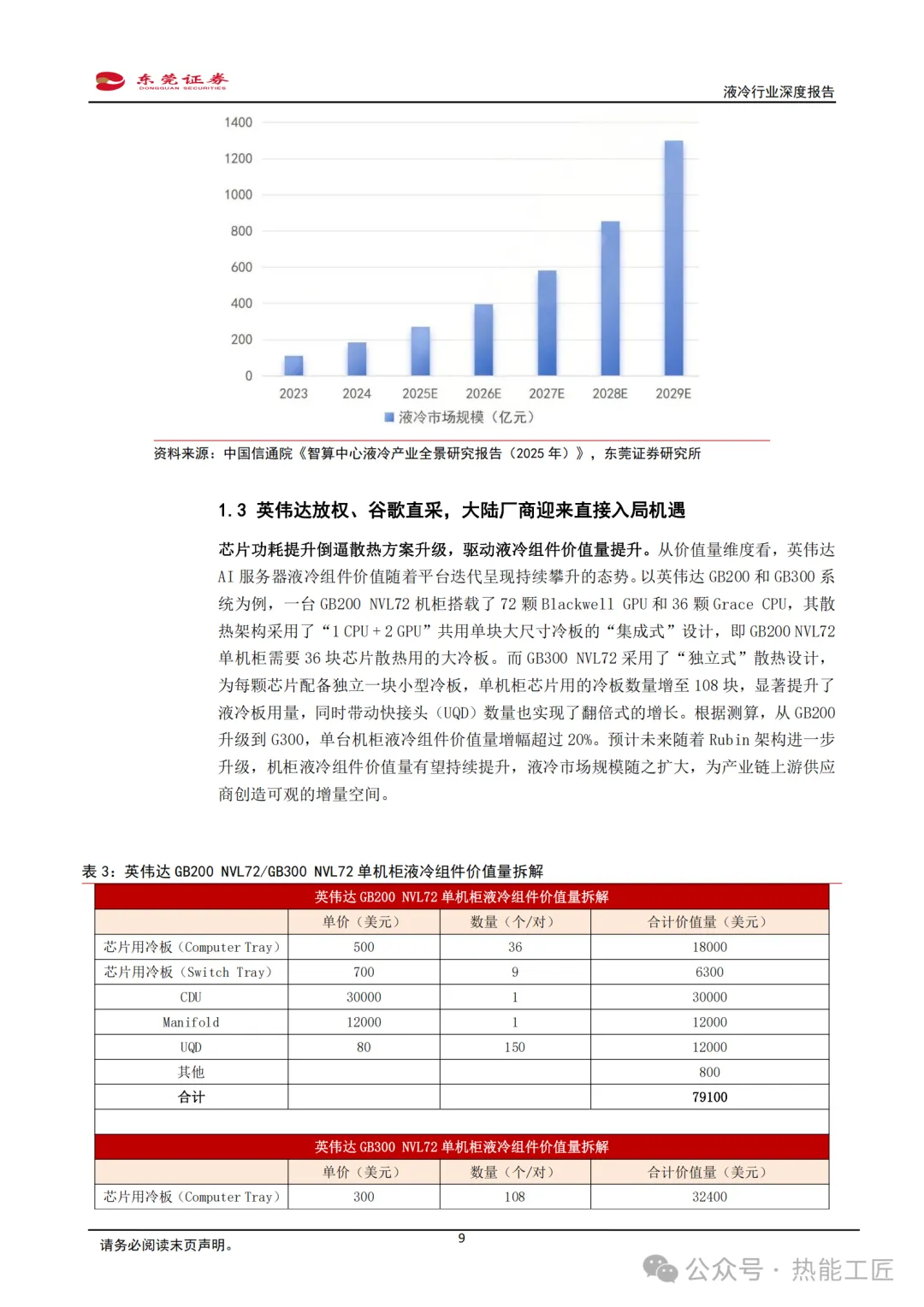

“训练+推理”算力双轮驱动,未来全球算力需求呈指数级爆发。随着大模型快速迭代与 AI 应用场景加速渗透,全球 AI 算力需求呈指数级爆发态势,算力基础设施供给持续增长,智能算力密度不断提升。从训练侧算力来看,当前海内外CSP 巨头及头部大模型厂商持续加码基础模型的研发,模型规模从千亿向万亿级参数量级跨越,模型范式从纯文本向融合了文本、图像、音频、视频等多种数据的多模态化方向演进,推动训练侧算力需求持续攀升。从推理侧算力来看,2026 年初,OpenClaw 开源AI 智能体执行框架持续火爆出圈,海内外厂商亦密集推出相关智能体产品,AI Agent 迎来技术、应用、商业三维度的全面爆发。与传统的简单对话式 AI 不同,Agent 执行复杂任务时需要模型持续进行思考、规划与工具调用,其 Token 消耗量通常是传统对话的20 到30 倍,驱动推理侧算力爆发式增长。在“训练+推理”算力双轮驱动下,预计未来全球智能算力将保持高速增长态势。根据中国信通院测算,截至 2025 年 6 月,全球计算设备算力总规模为4495 EFLOPS,同比大幅增长 117%,其中智能算力规模占总算力比例已达到85%。随着智能算力成为绝对主导,预计未来五年全球算力规模将以超过60%的年均速度增长,至2030 年全球算力有望超过 50 ZFLOPS,其中智能算力占比将超过95%。

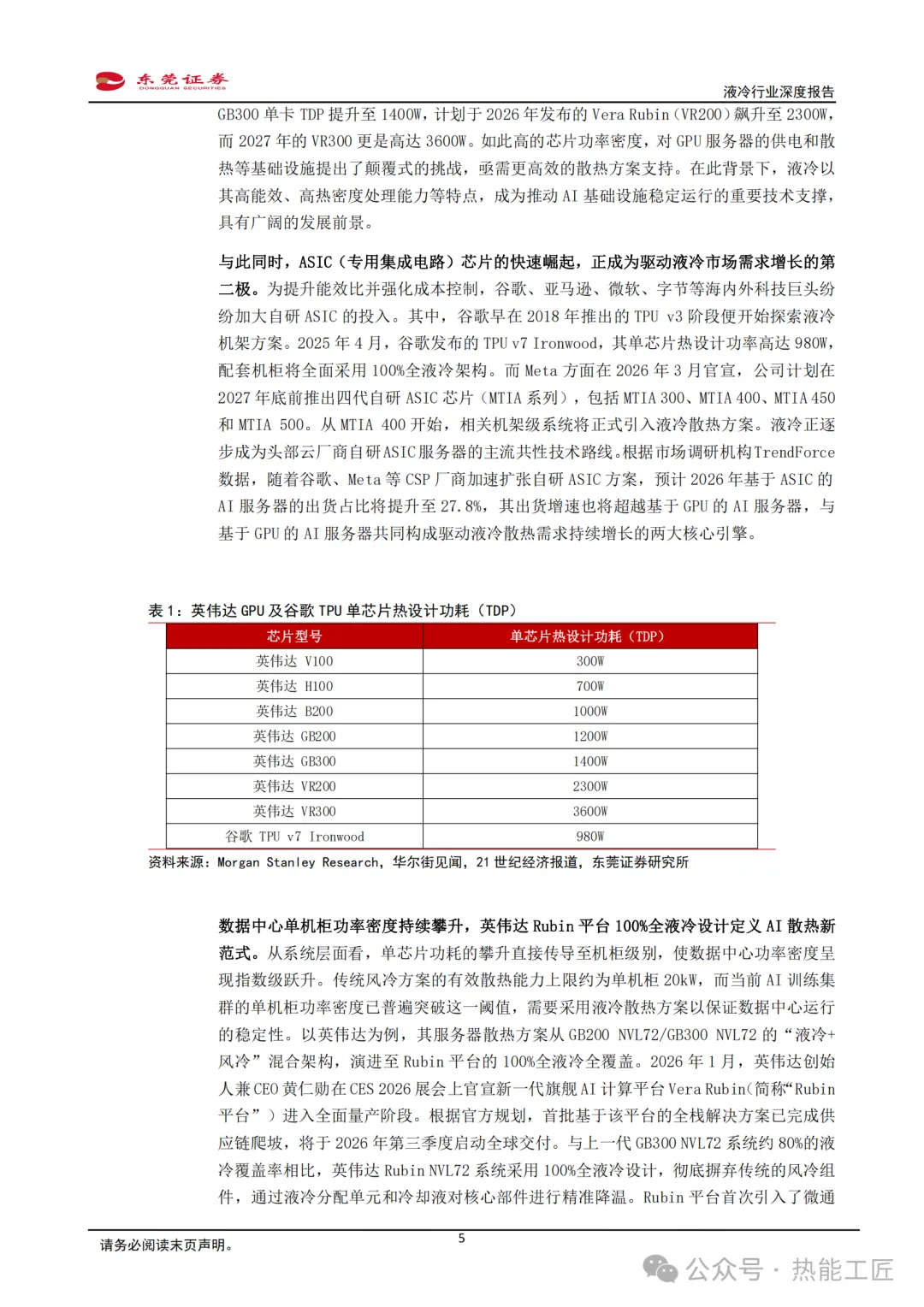

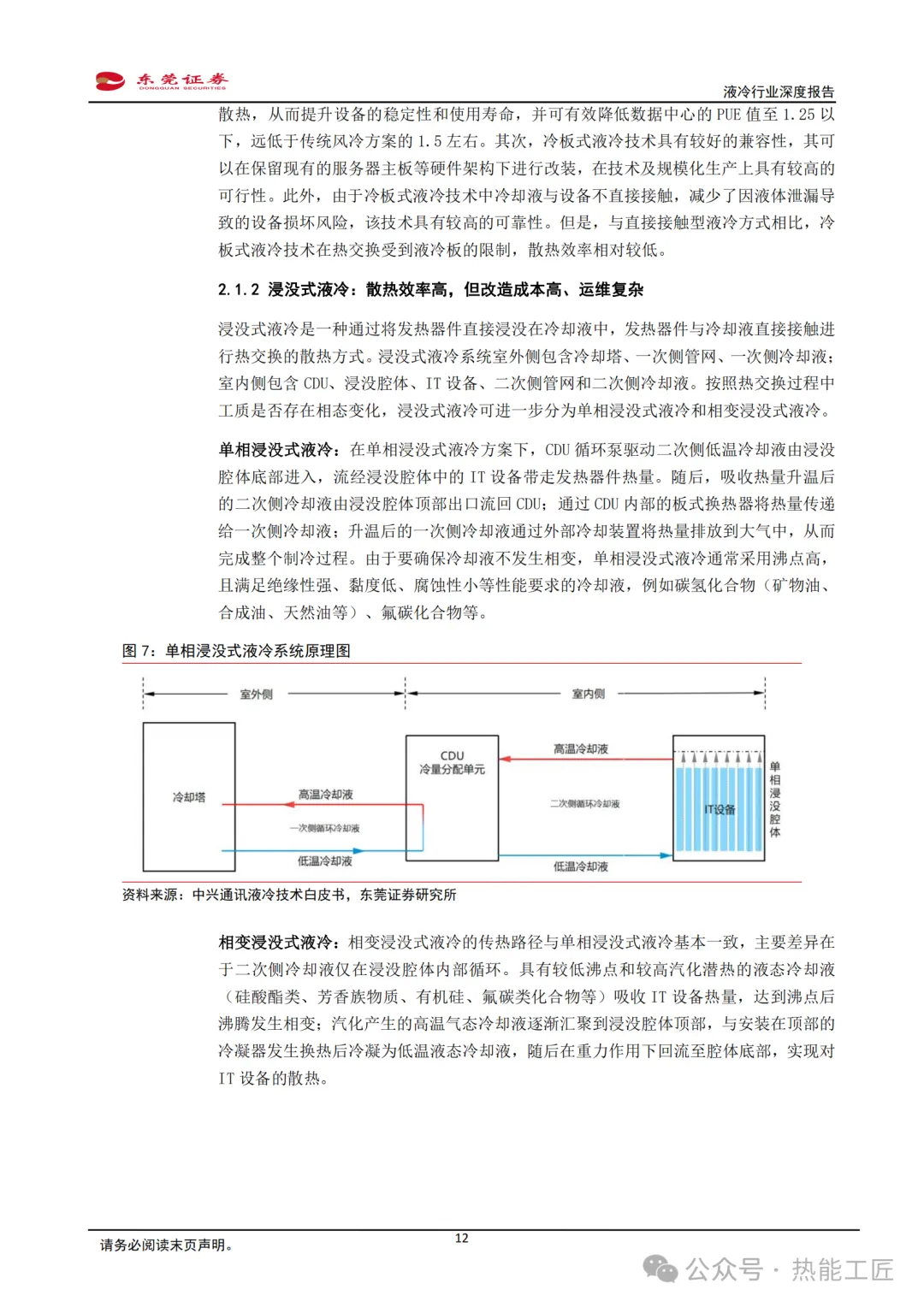

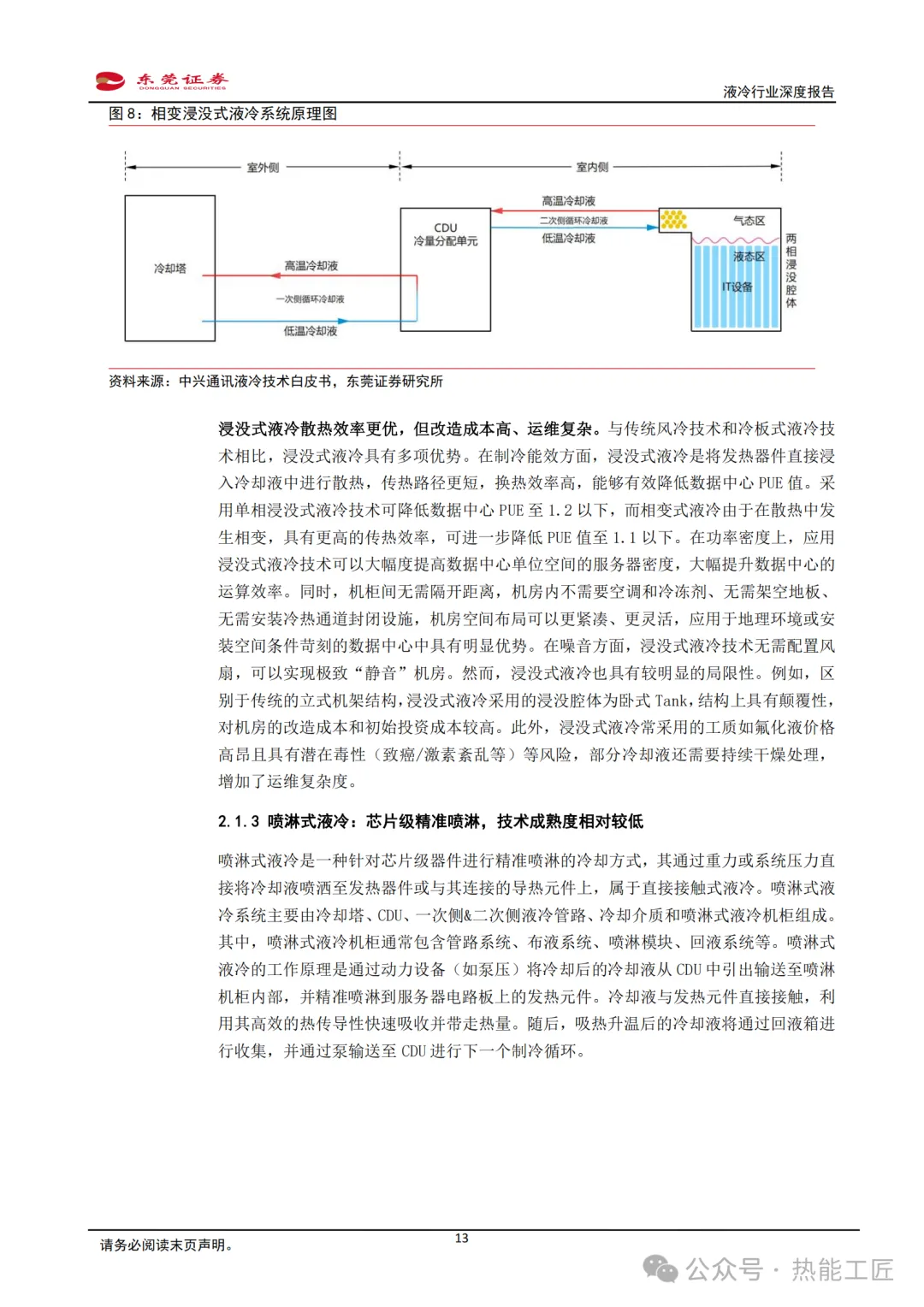

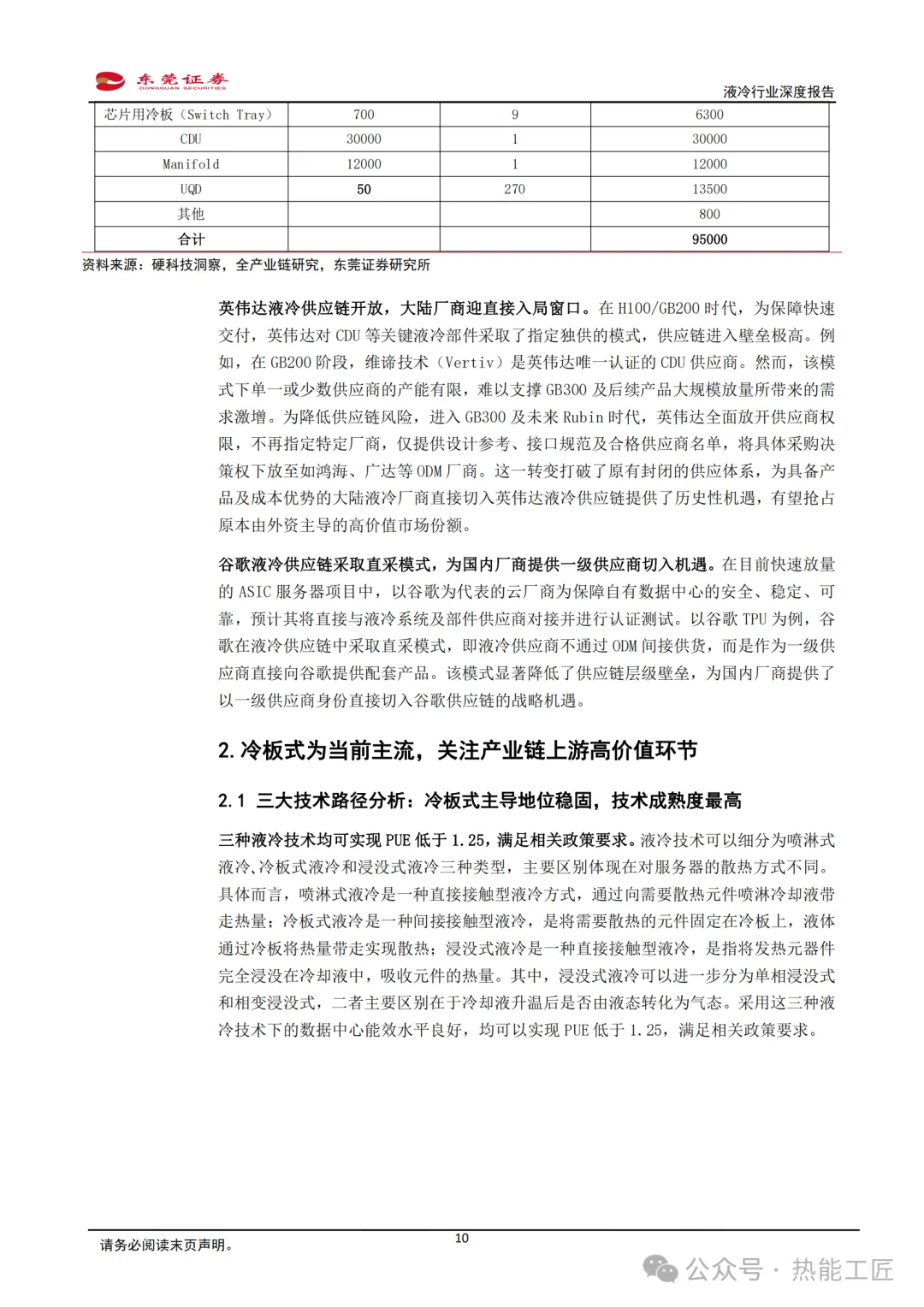

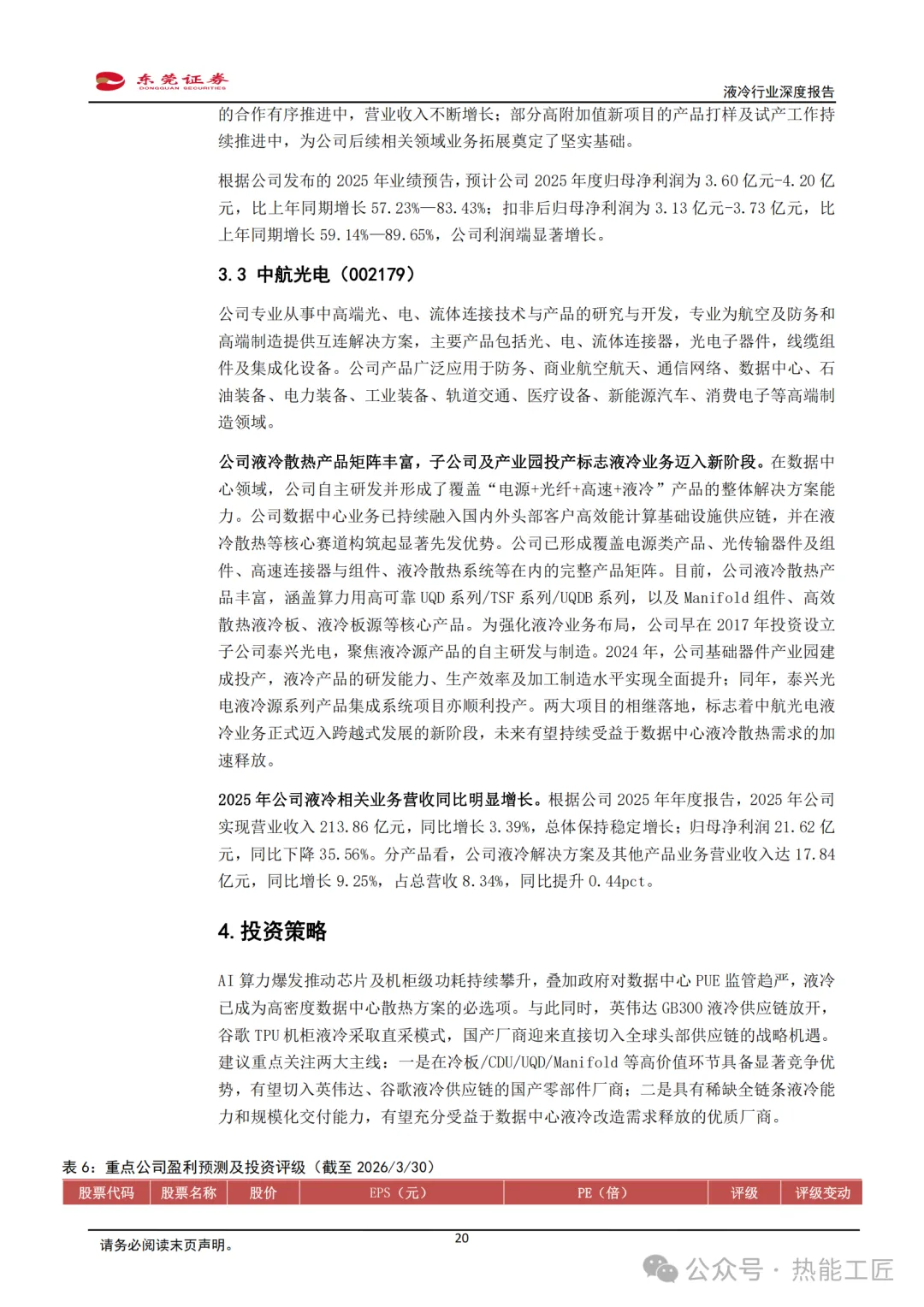

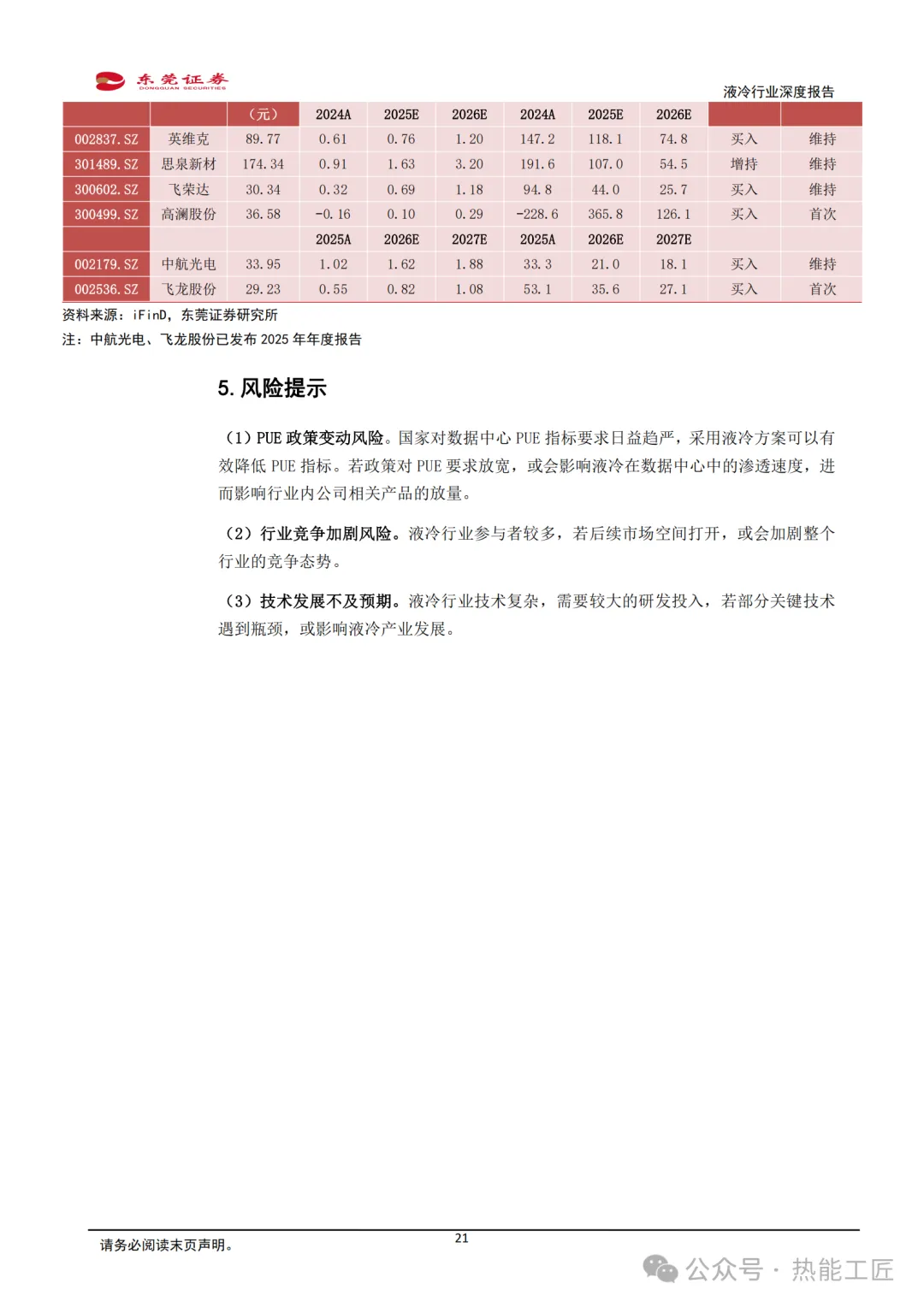

高性能 AI 芯片(包括 GPU 和 ASIC)TDP 逐渐突破风冷散热极限,亟需采用液冷散热方案。AI 算力需求呈指数级爆发直接推动了 AI 集群功耗上扬,从单芯片到机柜级别的功耗密度的激增已经超越了传统数据中心的风冷散热极限。从芯片端来看,当前主流CPU处理器单芯片功耗已达 350—400W,而 GPU 的功耗更是显著高于CPU。以英伟达GPU处理器为例,其 V100 芯片的 TDP 为 300W,到了 H100 芯片的TDP 已经高达700W,B200单卡 TDP 进一步上升至约 1000W,已然突破风冷方案 700W—800W 的散热极限。后续产品中,GB300 单卡 TDP 提升至 1400W,计划于 2026 年发布的 Vera Rubin(VR200)飙升至2300W,而 2027 年的 VR300 更是高达 3600W。如此高的芯片功率密度,对GPU 服务器的供电和散热等基础设施提出了颠覆式的挑战,亟需更高效的散热方案支持。在此背景下,液冷以其高能效、高热密度处理能力等特点,成为推动 AI 基础设施稳定运行的重要技术支撑,具有广阔的发展前景。 与此同时,ASIC(专用集成电路)芯片的快速崛起,正成为驱动液冷市场需求增长的第二极。为提升能效比并强化成本控制,谷歌、亚马逊、微软、字节等海内外科技巨头纷纷加大自研 ASIC 的投入。其中,谷歌早在 2018 年推出的TPU v3 阶段便开始探索液冷机架方案。2025 年 4 月,谷歌发布的 TPU v7 Ironwood,其单芯片热设计功率高达980W,配套机柜将全面采用 100%全液冷架构。而 Meta 方面在 2026 年3 月官宣,公司计划在2027 年底前推出四代自研 ASIC 芯片(MTIA 系列),包括MTIA 300、MTIA 400、MTIA450和 MTIA 500。从 MTIA 400 开始,相关机架级系统将正式引入液冷散热方案。液冷正逐步成为头部云厂商自研ASIC服务器的主流共性技术路线。根据市场调研机构TrendForce数据,随着谷歌、Meta 等 CSP 厂商加速扩张自研 ASIC 方案,预计2026 年基于ASIC的AI 服务器的出货占比将提升至 27.8%,其出货增速也将超越基于GPU 的AI 服务器,与基于 GPU 的 AI 服务器共同构成驱动液冷散热需求持续增长的两大核心引擎。

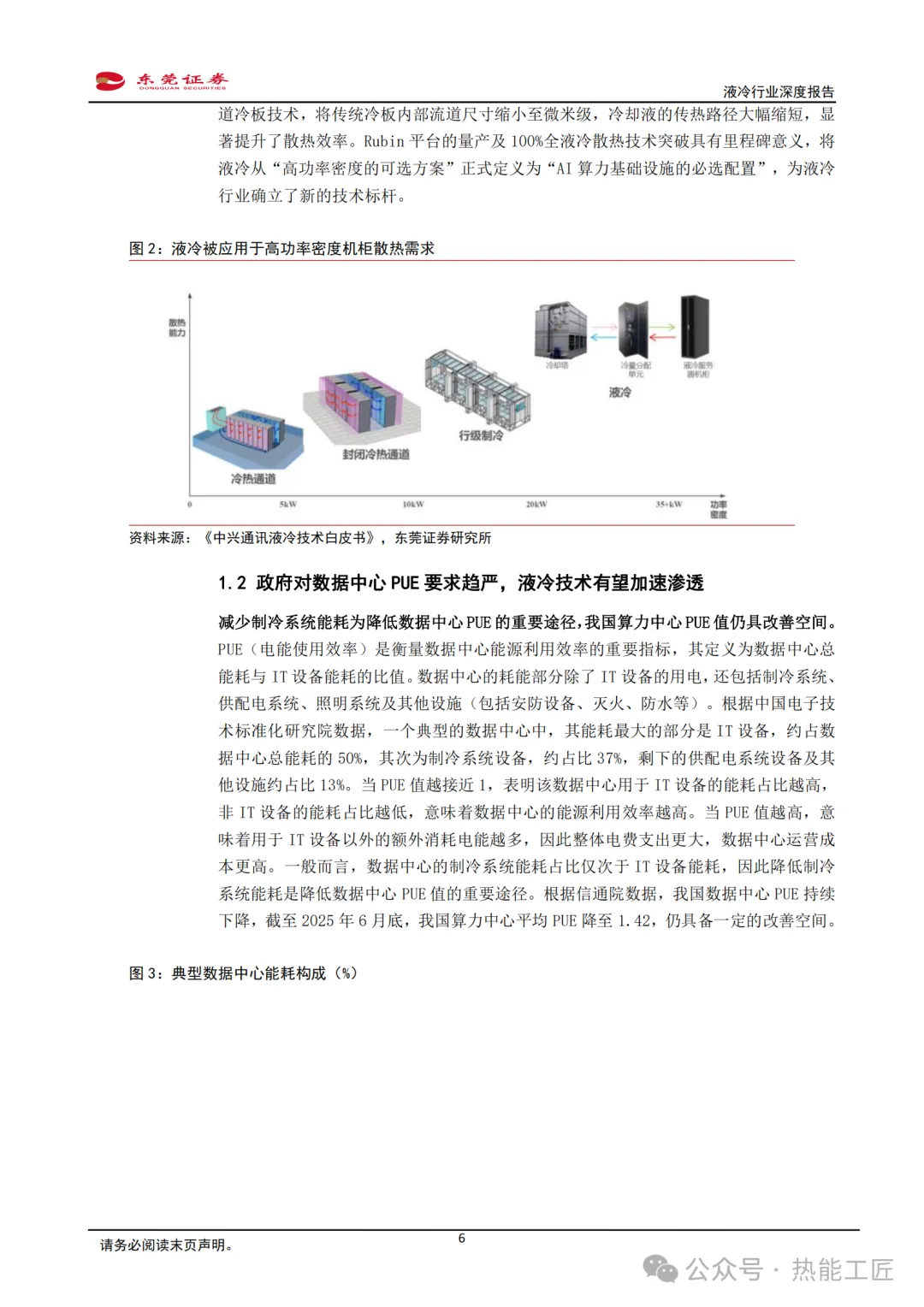

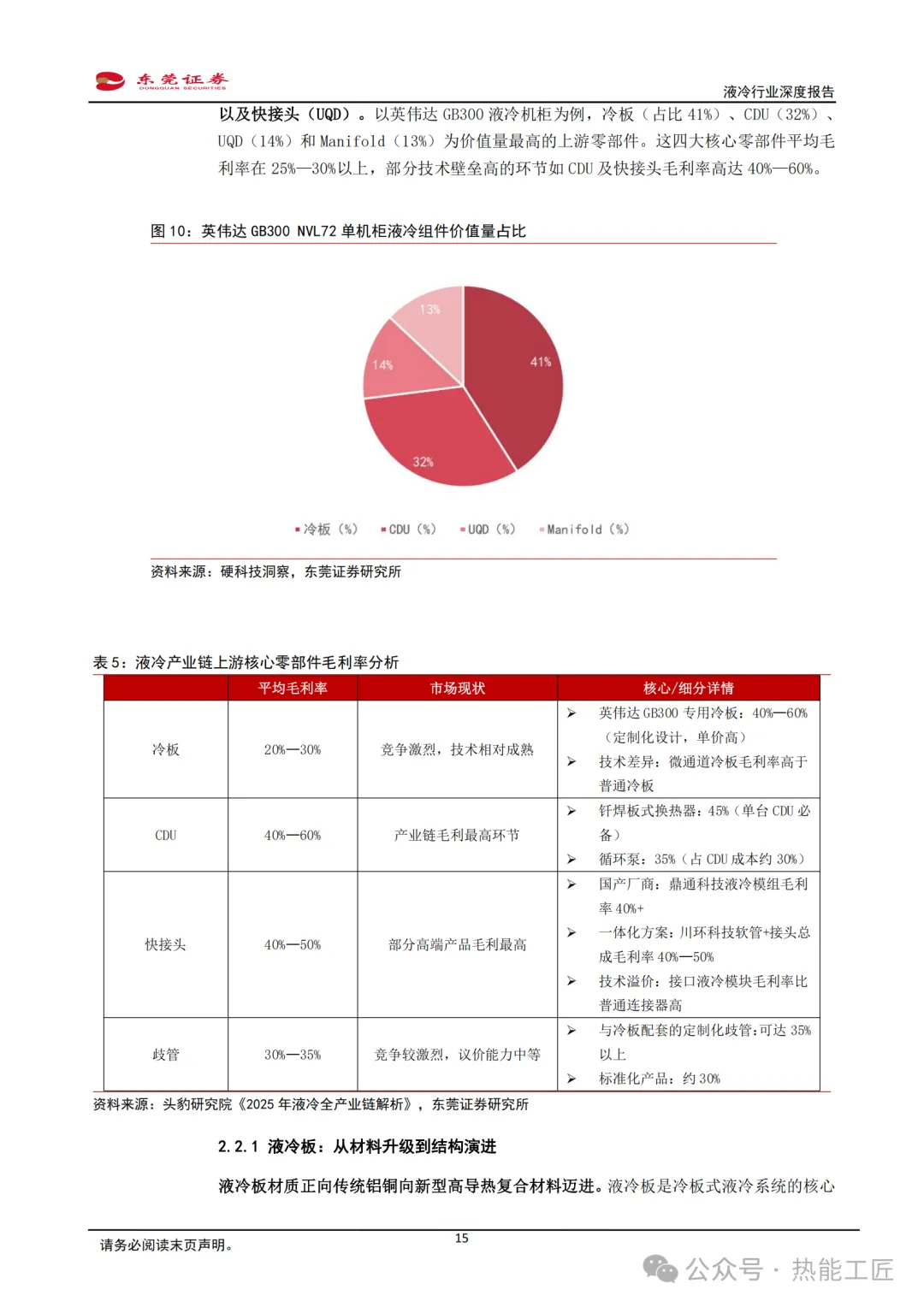

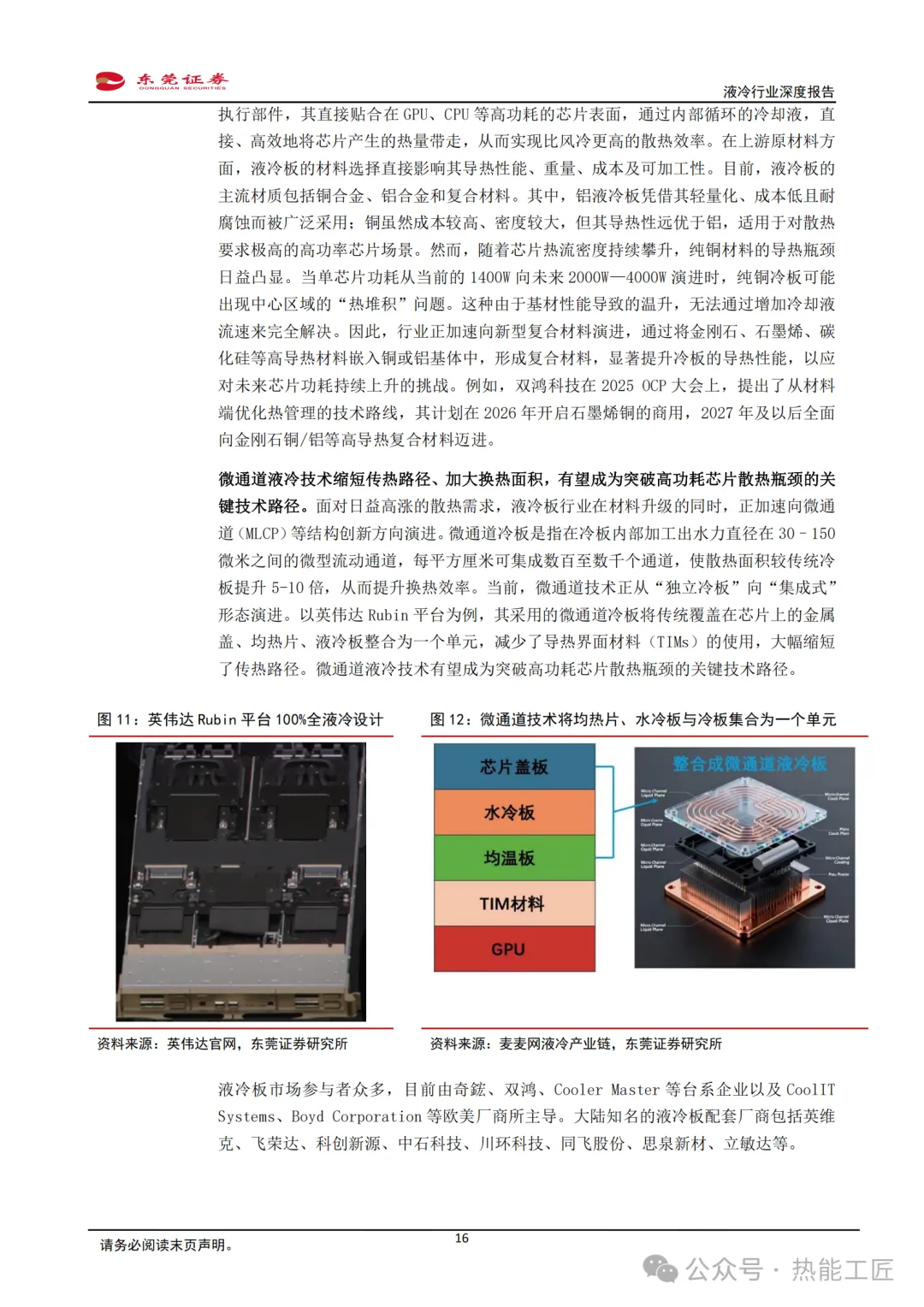

数据中心单机柜功率密度持续攀升,英伟达 Rubin 平台 100%全液冷设计定义AI散热新范式。从系统层面看,单芯片功耗的攀升直接传导至机柜级别,使数据中心功率密度呈现指数级跃升。传统风冷方案的有效散热能力上限约为单机柜20kW,而当前AI训练集群的单机柜功率密度已普遍突破这一阈值,需要采用液冷散热方案以保证数据中心运行的稳定性。以英伟达为例,其服务器散热方案从 GB200 NVL72/GB300 NVL72 的“液冷+风冷”混合架构,演进至 Rubin 平台的 100%全液冷全覆盖。2026 年1 月,英伟达创始人兼 CEO 黄仁勋在 CES 2026 展会上官宣新一代旗舰 AI 计算平台Vera Rubin(简称“Rubin平台”)进入全面量产阶段。根据官方规划,首批基于该平台的全栈解决方案已完成供应链爬坡,将于 2026 年第三季度启动全球交付。与上一代GB300 NVL72 系统约80%的液冷覆盖率相比,英伟达 Rubin NVL72 系统采用 100%全液冷设计,彻底摒弃传统的风冷组件,通过液冷分配单元和冷却液对核心部件进行精准降温。Rubin 平台首次引入了微通道冷板技术,将传统冷板内部流道尺寸缩小至微米级,冷却液的传热路径大幅缩短,显著提升了散热效率。Rubin 平台的量产及 100%全液冷散热技术突破具有里程碑意义,将液冷从“高功率密度的可选方案”正式定义为“AI 算力基础设施的必选配置”,为液冷行业确立了新的技术标杆。

扫码加入知识星球,可以获得最新、最全热管理行业最新报告!

文琳编辑

免责声明:转载内容仅供读者参考,观点仅代表作者本人,不构成投资意见,也不代表本平台立场。若文章涉及版权问题,敬请原作者添加wenlin-swl 微信联系删除。

为便于研究人员查找相关行业研究报告,特将2018年以来各期文章汇总。欢迎点击下面红色字体查阅!

提供每日最新财经资讯,判断经济形势,做有价值的传播者。欢迎关注

公众号:就业与创业

提供宏观经济下的行业现状及区域地方经济发展机遇的信息;分享案例,为就业与创业的选择、定位解决疑惑,并提供帮助。 点击下方可看