AI科普馆部分垂类内容转移至?

【长三角人工智能联盟】公众号,快点进去瞧瞧!

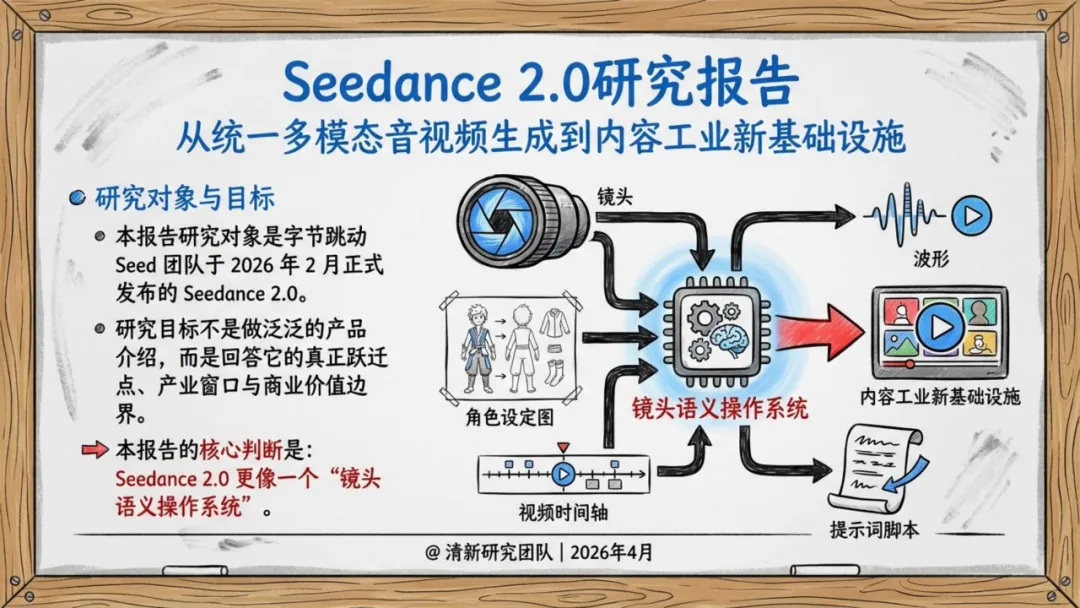

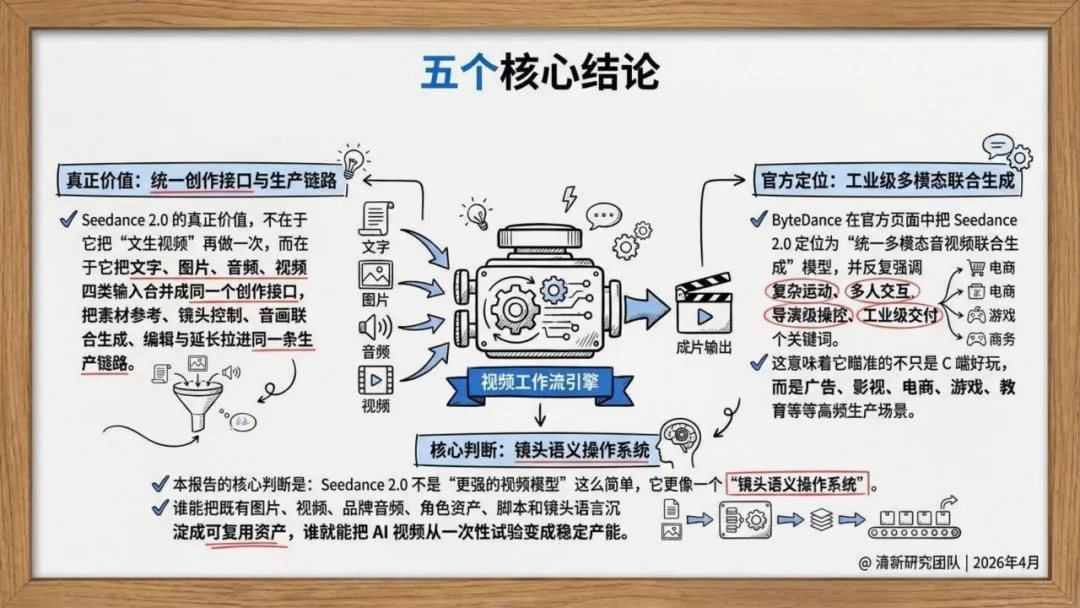

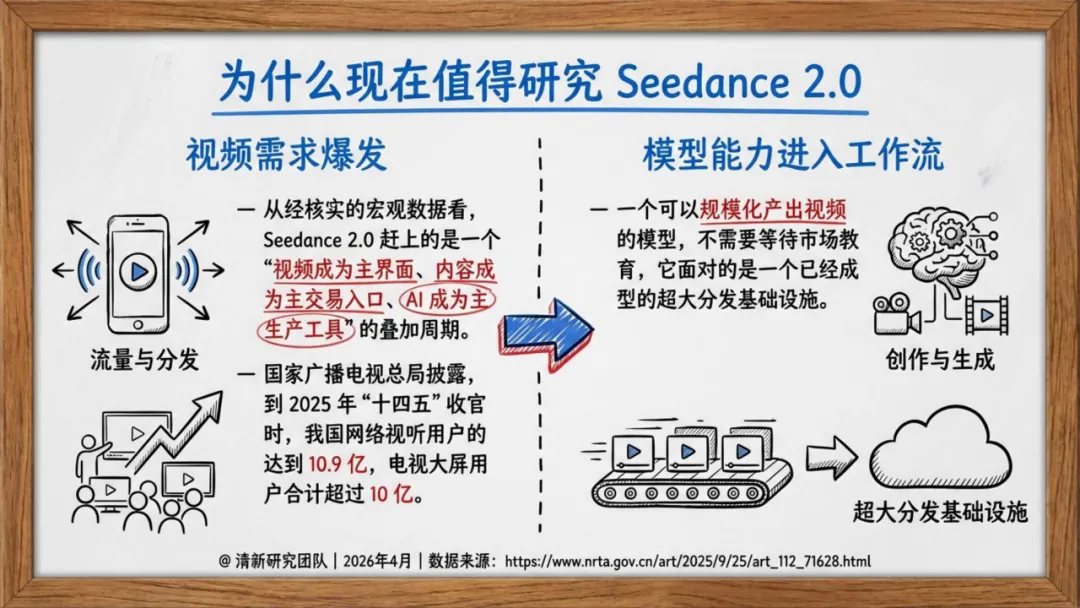

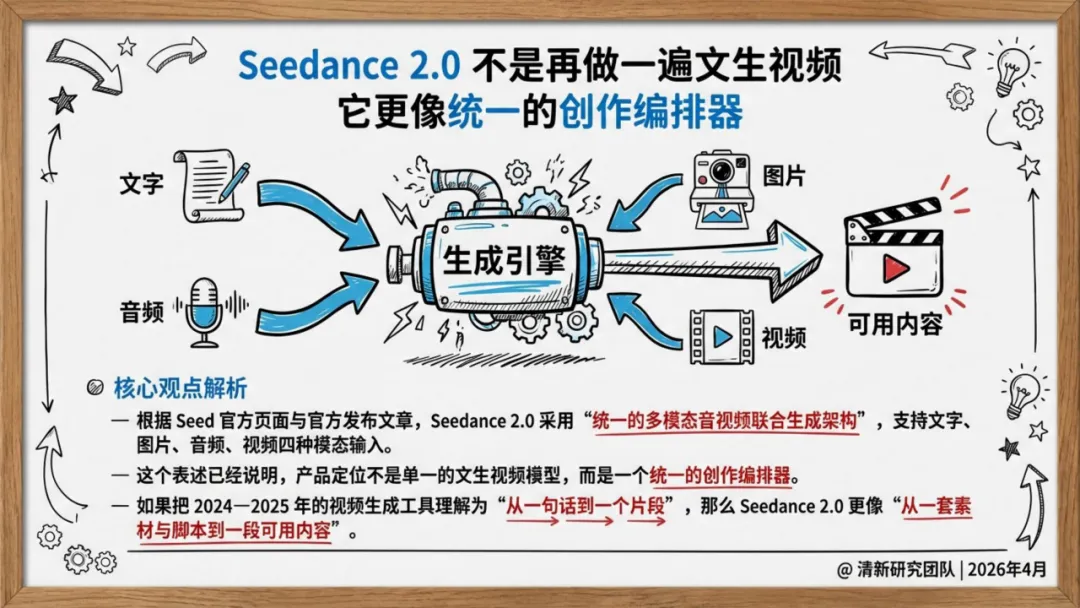

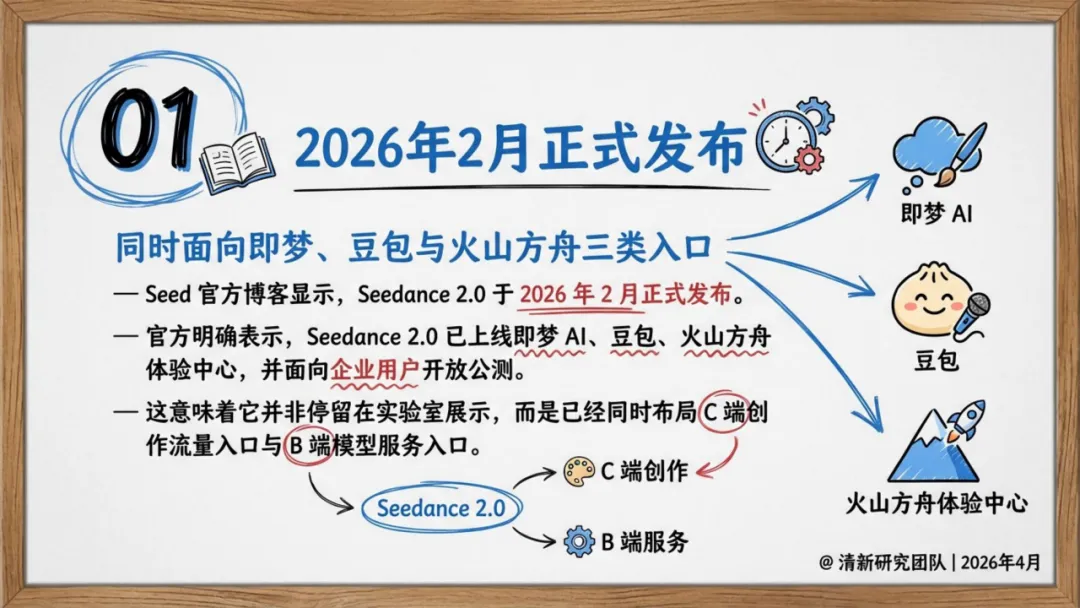

2026年2月,字节跳动Seed团队发布了Seedance 2.0。最初大多数人的第一反应是"又一个更强的视频模型",但这份来自清新研究机构的研究报告给出了一个截然不同的判断——Seedance 2.0不是更强的视频模型这么简单,它更像一个"镜头语义操作系统"。

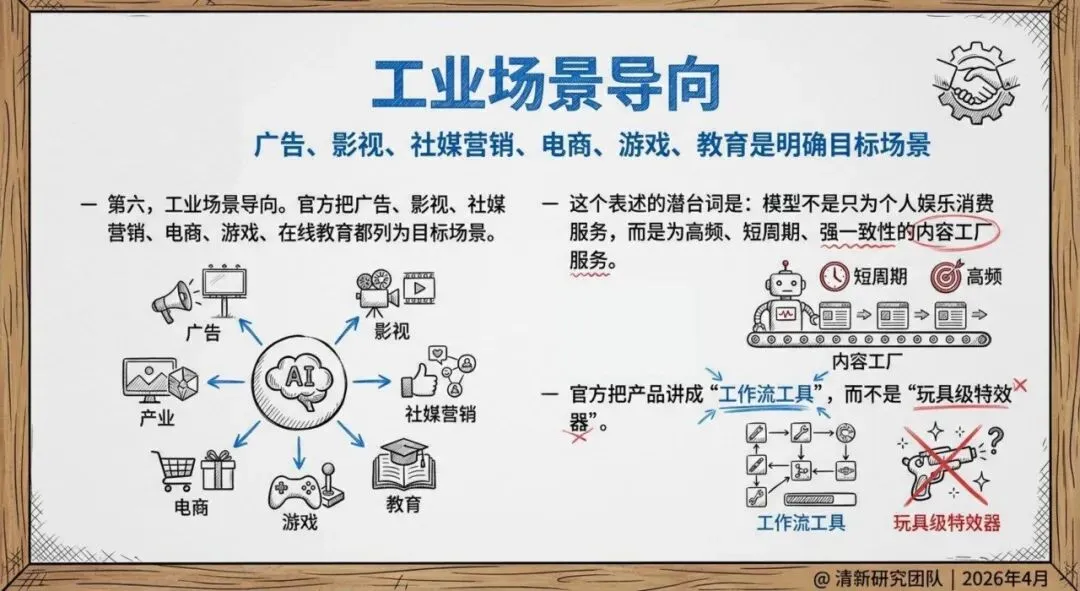

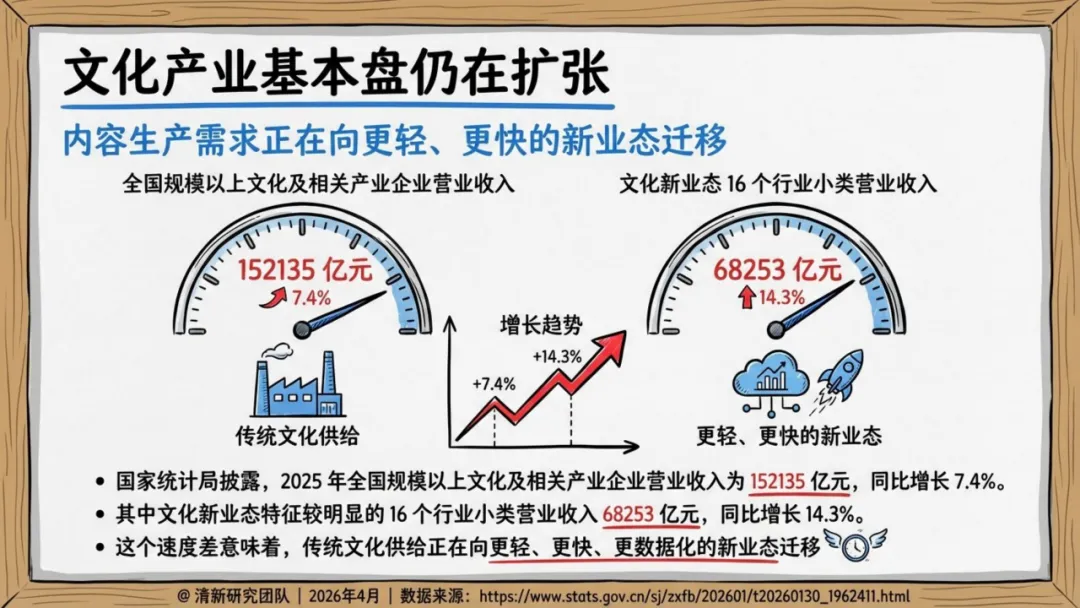

这意味着,AI视频的竞争逻辑正在发生根本性转变:从"谁的模型参数更大、画质更高",转向"谁能把AI视频能力真正嵌入工业生产流程"。本报告的核心价值,正是系统性地论证了这一判断,并给出了可落地的战略建议。

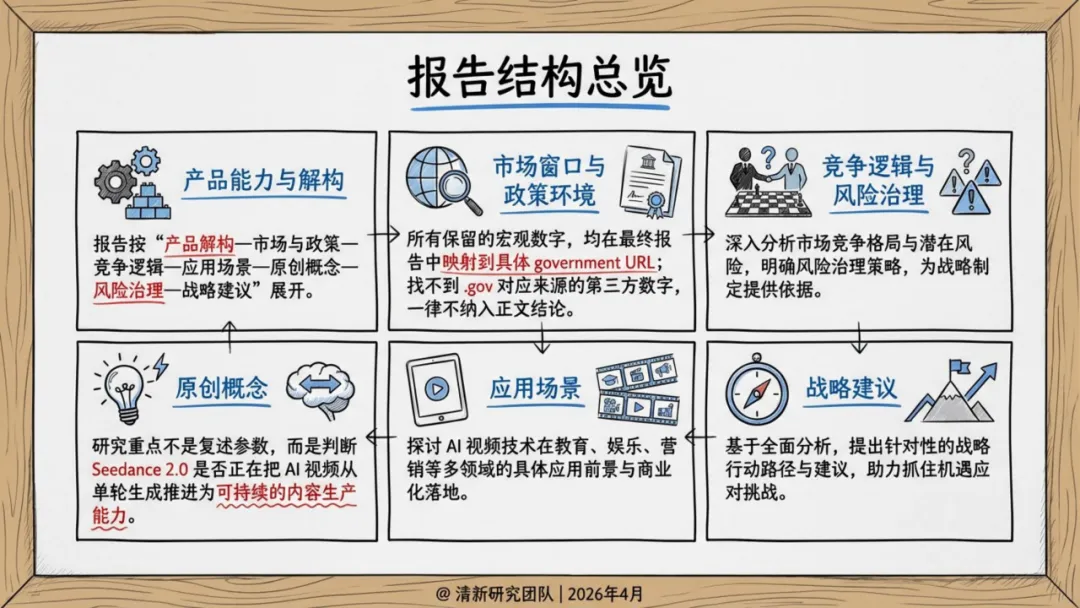

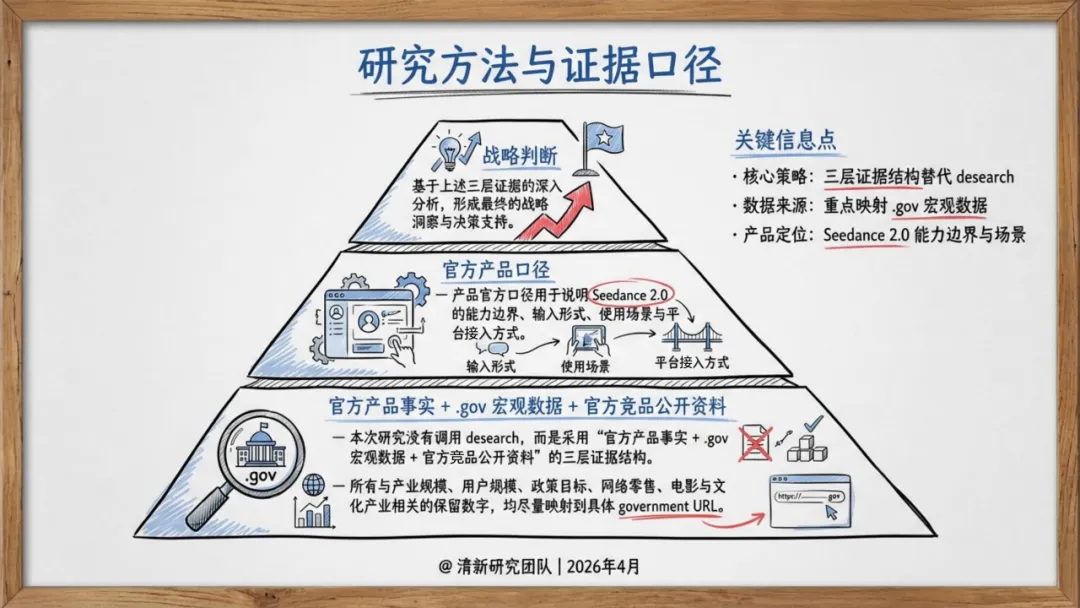

以下为报告核心内容的分层解读。

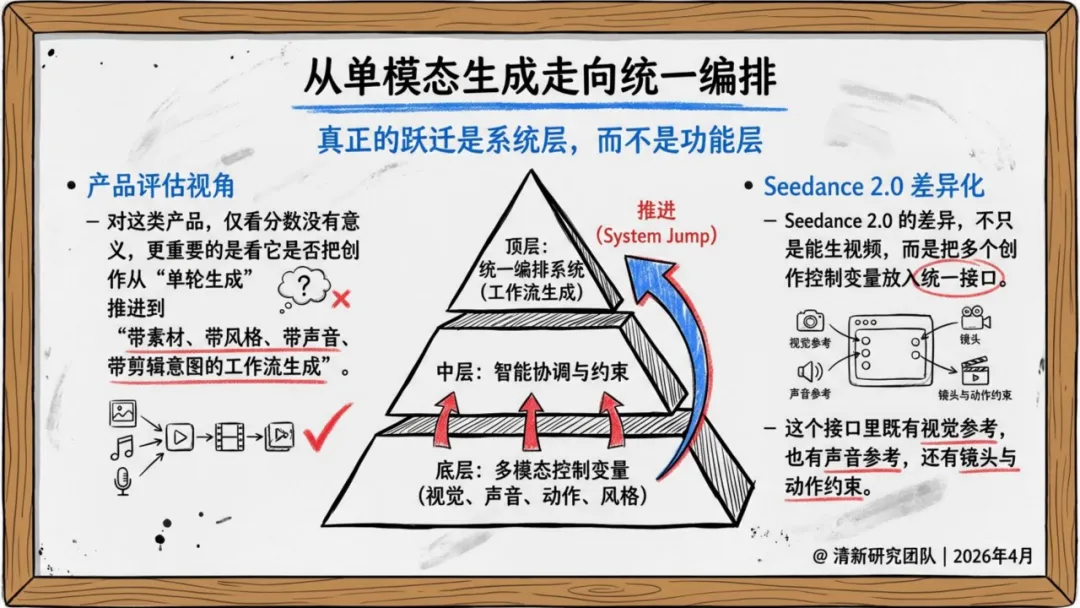

一、产品定位跃迁:从"工具"到"操作系统"

报告最核心的洞察在于重新定义了Seedance 2.0的产品本质。

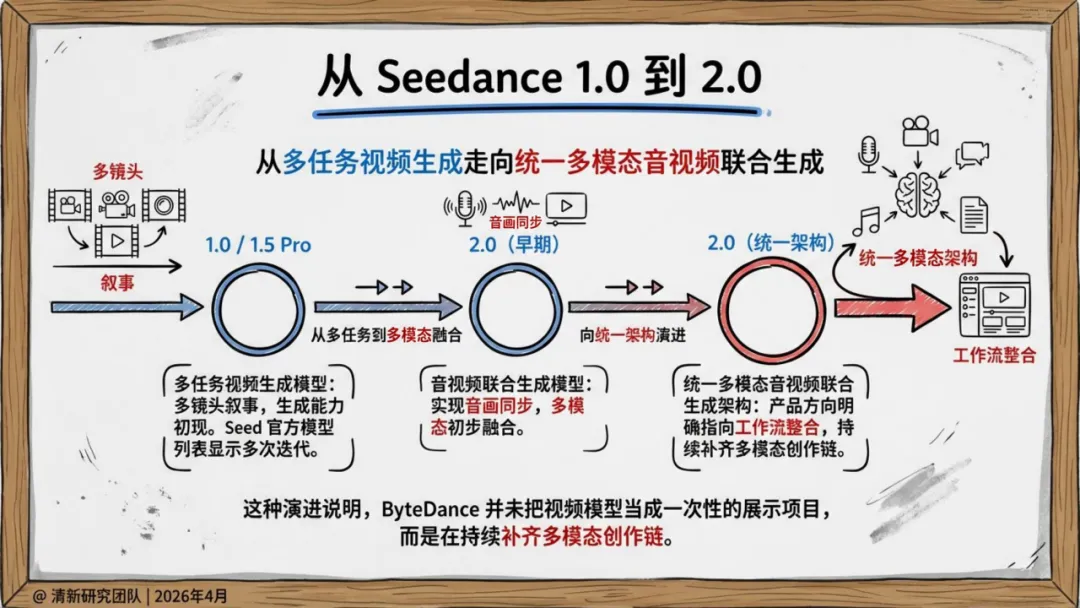

过去一年,Sora、Kling、Runway Gen-3相继发布,行业讨论的焦点始终停留在"生成时长""物理真实感""画面分辨率"等技术参数上。这份报告直接跳出了这个框架,提出了一个更具解释力的概念:镜头语义操作系统。

什么是"镜头语义操作系统"?报告拆解为三个层面:

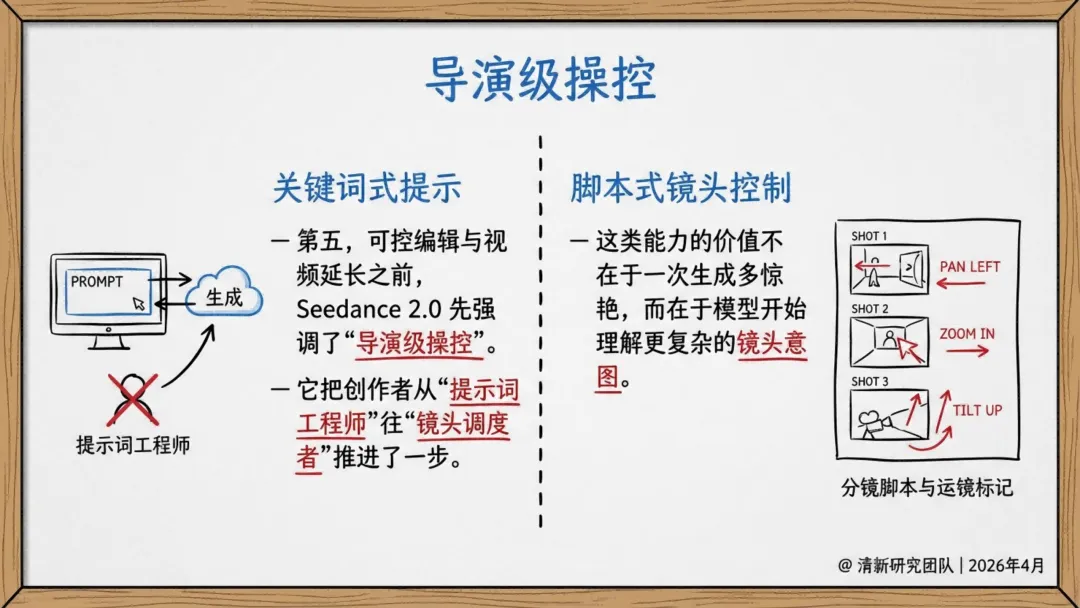

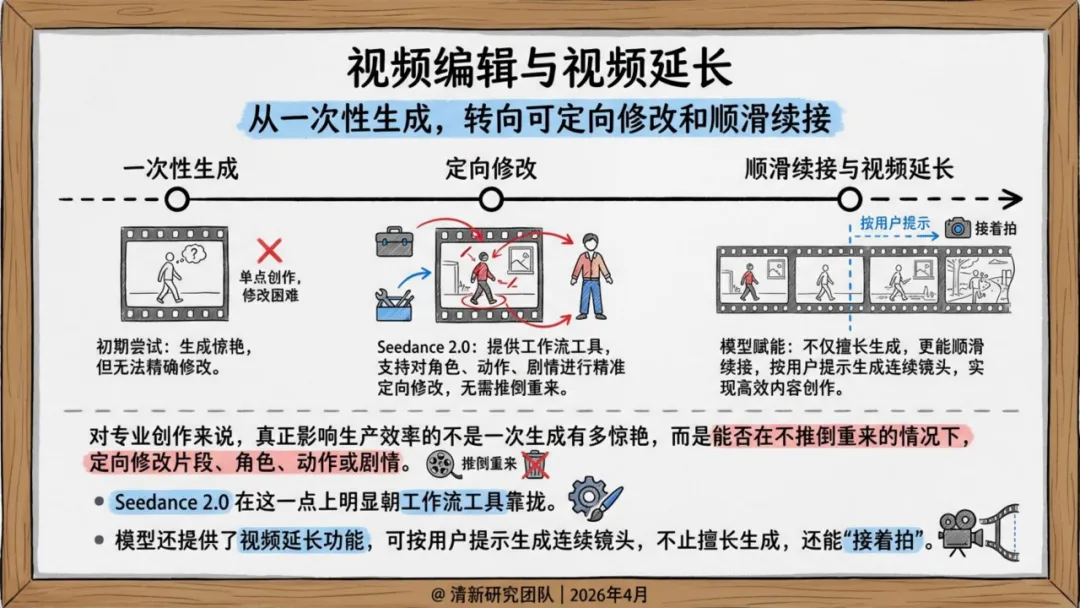

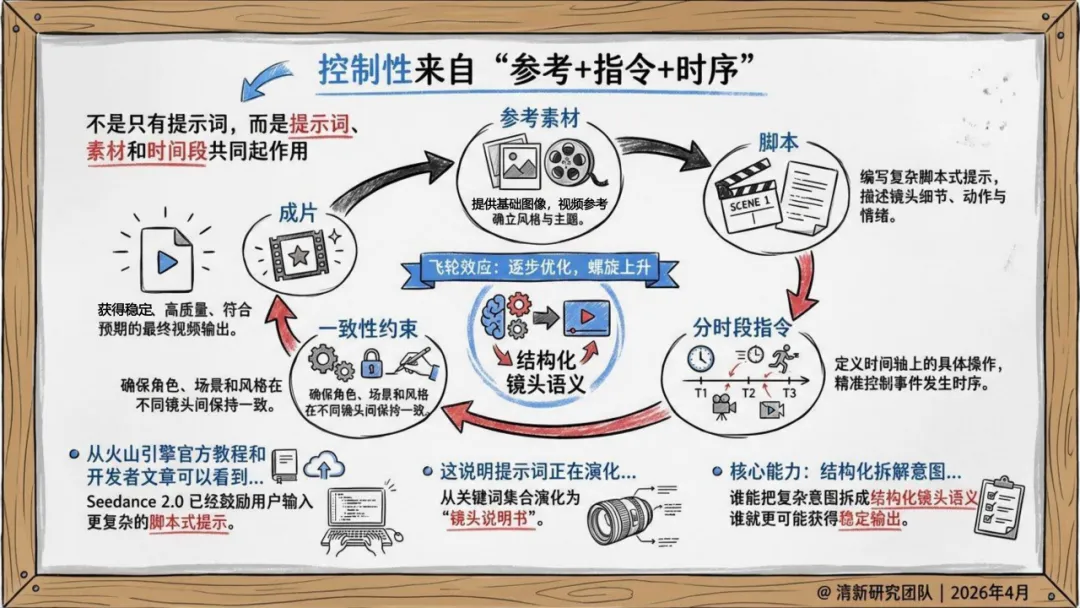

第一,导演接口化。 传统AI视频生成依赖自然语言提示词(Prompt),创作者需要用大量文字"描述"想要的画面。Seedance 2.0将这一过程标准化——创作者可以通过结构化的镜头调度指令(如"全景→特写,缓慢推进")和可复用的语义模板直接操控生成过程。这意味着视频创作从"关键词盲猜"升级为"标准化生产指令"。

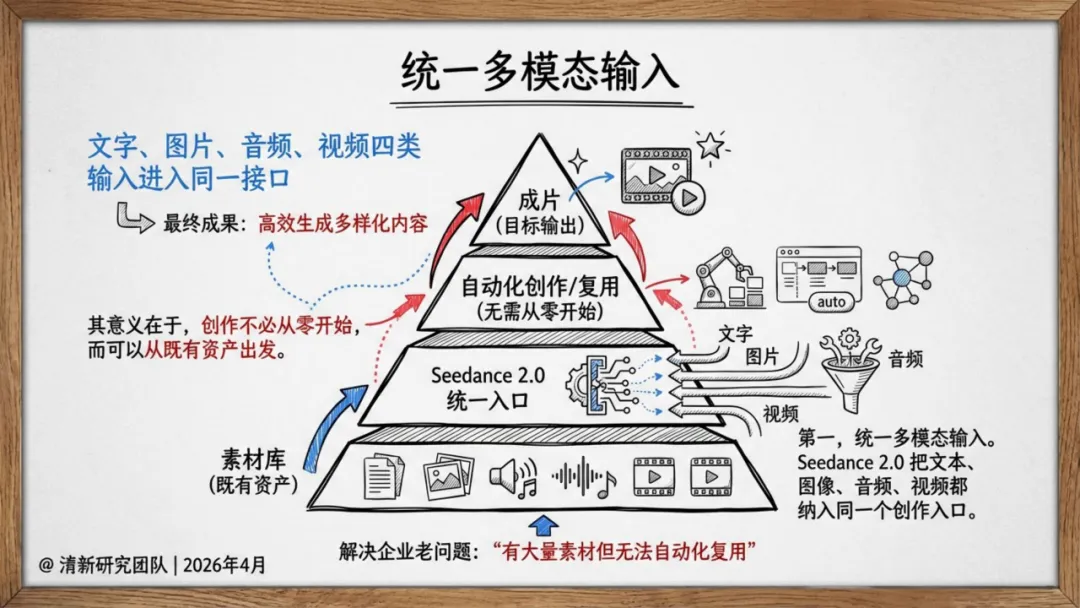

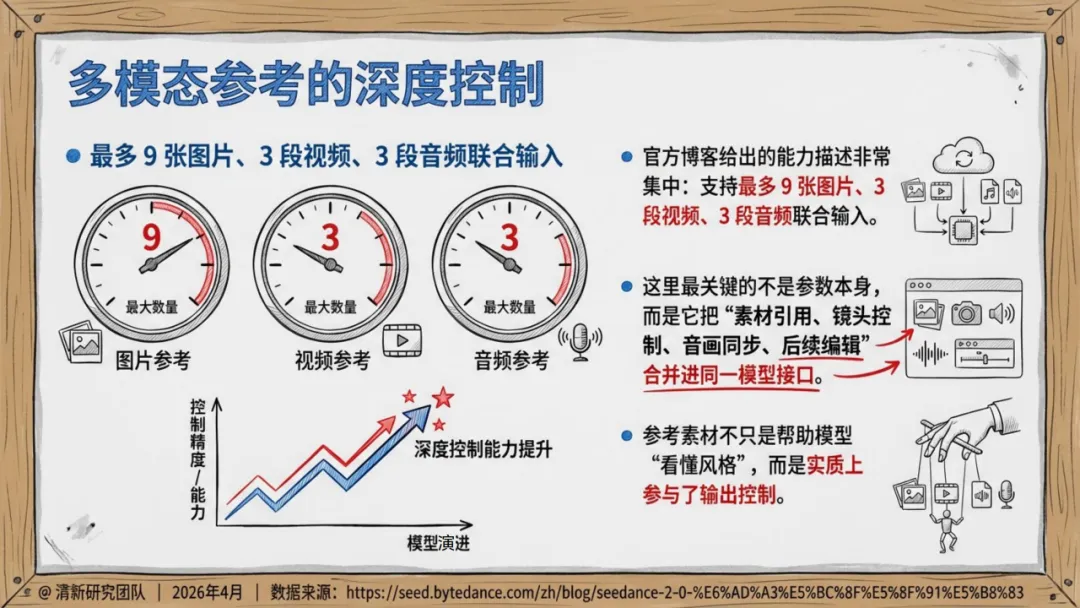

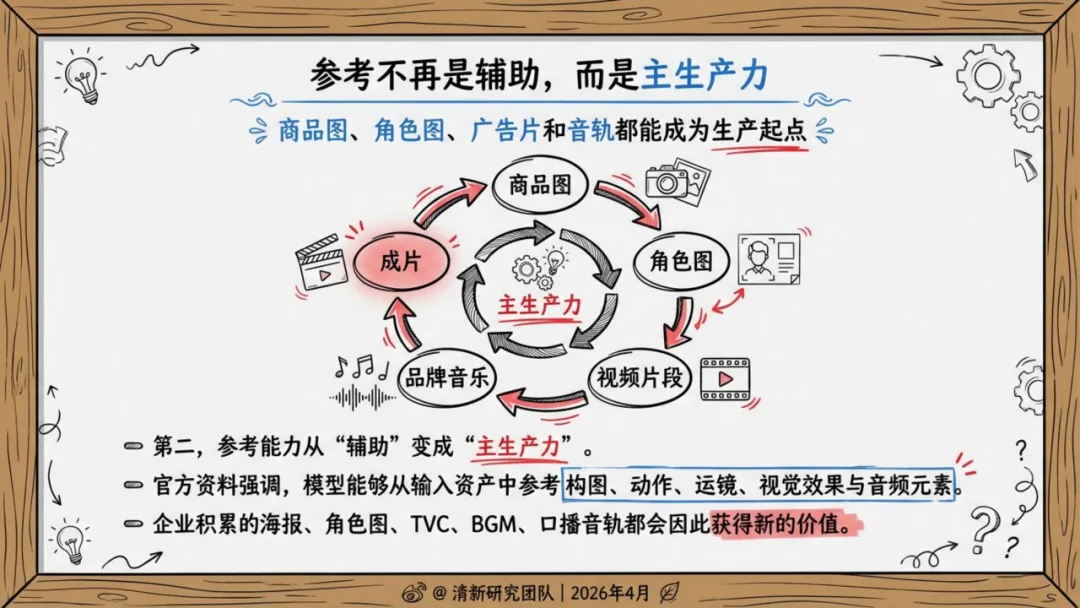

第二,参考即资产。 Seedance 2.0支持文字、图片、音频、视频四模态联合输入,最高可同时接入9张图片、3段视频、3段音频。更关键的是,这些参考素材不再是辅助性的,而是核心生产资料——企业的存量素材(品牌LOGO、产品图、历史视频)可以直接转化为新内容的生成基础,实现边际成本递减。

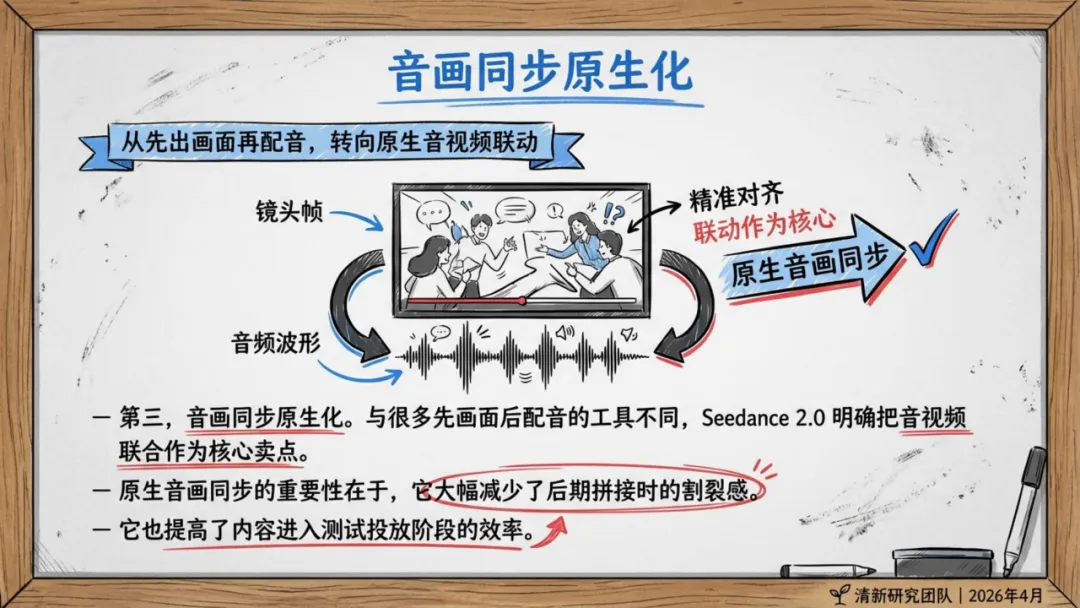

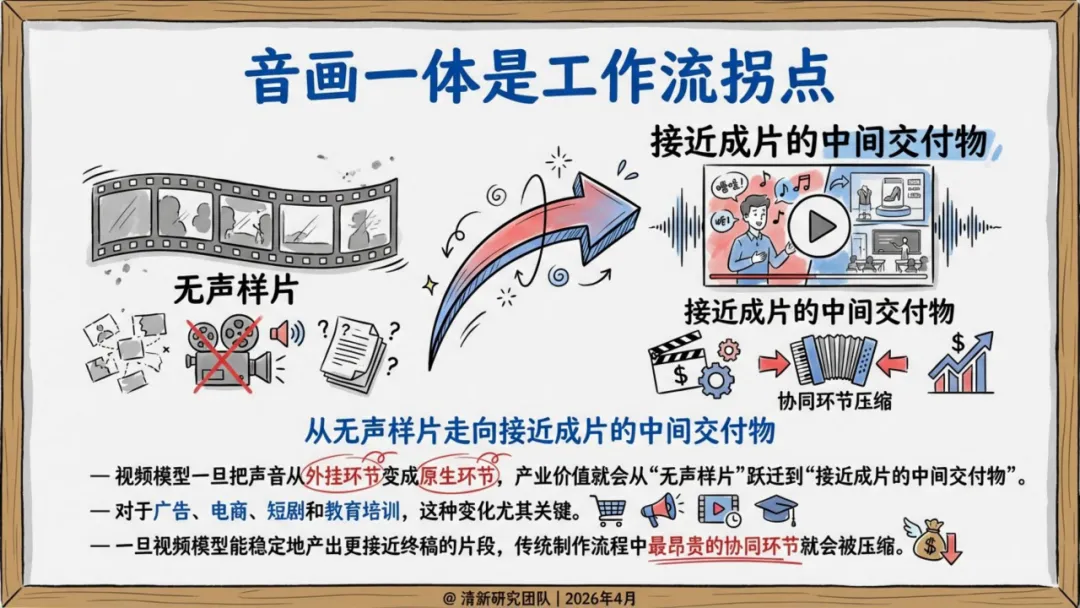

第三,音画同生工业化。 这是最具标志性的突破。传统AI视频是"先画面后配音"的割裂流程,而Seedance 2.0采用双分支扩散Transformer架构(DB-DiT),视觉分支与音频分支通过"注意力桥"进行帧级精确同步——声音与画面是伴随生长的,而非后期拼凑。这意味着生成产物从"无声样片"直接跃升为"可投放成片"。

二、技术架构:双分支架构与三项能力突破

报告从技术维度论证了Seedance 2.0为什么能支撑"操作系统"的定位。核心在于三项关键能力:

1. 原生音画同步。 双分支DiT架构让视频和音频在同一生成过程中同步产出。具体而言,视觉分支负责空间补丁和时间帧的生成,音频分支负责频率和时间维度的生成,两者通过交叉注意力层实现帧级精确对齐。这解决了一个被长期忽视的行业痛点:在短视频和广告场景中,音画节奏的契合度直接决定用户留存与转化。

2. 多镜头叙事一致性。 全局上下文缓冲区存储"角色ID"和"场景光照"数据,当镜头切换(全景→中景→特写)时,模型自动引用缓冲区确保角色面部、服装、光照的一致性。这突破了AI视频"单镜头还行,切镜头就崩"的经典难题。

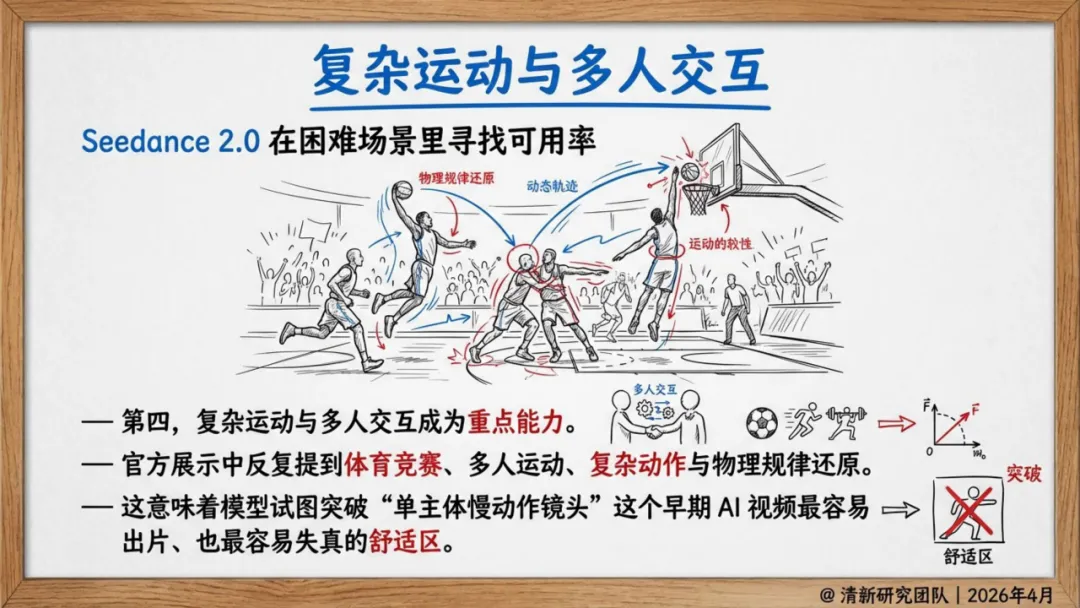

3. 复杂运动与物理还原。 引入动态时空解耦生成器,基于隐式神经表示(INR)实现像素级运动轨迹编码,并施加平滑性正则项确保运动场局部连续。实测数据显示,语义-关键帧对齐度达94.1%(对比1.0版本的73.5%),场景过渡平滑性达88.3%(对比1.0版本的61.9%)。

三、产业落地:从"技术Demo"到"量产工厂"

报告用大量篇幅分析了Seedance 2.0的产业落地逻辑,这是区别于一般技术解读的关键。

商业化数据印证了工业化拐点。 豆包大模型日均Token使用量已突破120万亿,位列全球前三;公测首日申请企业超千家;API服务覆盖30多个行业。一个典型案例是电梯广告:传统一条高质量TVC成本从数万到数十万、周期两周起步,而通过Seedance 2.0,同一广告可批量生成10+变体版本用于A/B测试,成本趋近于零。

字节生态的"飞轮效应"。 报告敏锐地指出,Seedance 2.0真正的壁垒不在于模型本身,而在于字节的生态闭环:即梦AI(C端工具)→ 剪映/CapCut(剪辑工具)→ 抖音/TikTok(分发平台)→ 抖音电商(商业变现)。用户从生成到发布到变现,全程在体系内闭环。OpenAI、Google均无此垂直整合能力。

成本变革的量化呈现。 报告对比了传统视频生产与AI视频生产的效率差异:1分钟720p视频,传统流程成本数千元、周期至少一周;Seedance 2.0仅需几十元、几分钟出片。这一数量级差异直接重新定义了"视频内容"的经济可行性边界。

四、竞争格局:从"参数竞赛"到"系统能力"之争

报告指出,当前AI视频已进入 “四强竞争” 阶段,核心逻辑彻底改变。

HappyHorse的冲击。 2026年4月,阿里推出的匿名模型HappyHorse以Elo 1379分登顶评测榜,超越Seedance 2.0。报告认为,HappyHorse削弱了Seedance在"模型最强"上的叙事,使其不再具备技术垄断感;但反过来强化了Seedance在"系统能力"上的稀缺性——当生成质量可以被不断追平时,真正稀缺的是如何把这些能力组织起来并嵌入生产流程。

"四强争霸"格局。Sora、Google Veo、快手Kling、字节Seedance——四强玩家无一例外,都在将重心转向工作流整合;在四强格局中,字节的差异化优势在于C端与B端的双入口布局:即梦AI、豆包覆盖大众创作,承担用户教育和数据回流;火山方舟面向企业提供API和行业方案。字节从生成到剪辑到分发到变现的全链路闭环,在四强中独一无二。相比之下,Sora背靠OpenAI但缺乏自有分发渠道,Veo有Google的资源支撑却缺乏场景聚焦,Kling有创作者生态但在全球化和B端能力上相对受限。

报告的核心判断是:决定胜负的不再是技术参数,而是能否建立"技术-场景-商业-合规"的正向飞轮。

五、风险与建议:不可忽视的"灰犀牛"

报告提出四个核心挑战:

- 版权合规风险。 AI短剧侵权事件频发,肖战、成毅等明星肖像权纠纷已引发社会关注,平台被迫限制特定人物生成。

- 深度合成标识审核压力。监管要求生成内容必须标识,技术实现与用户体验之间存在张力。

- 细节稳定性仍待优化。生成质量尚未完全对齐工业交付标准,存在"Demo能跑、量产翻车"的落差。

- 企业认知偏差。许多企业错误地将"模型Demo能力"等同于"组织产能",低估了建立配套基础设施的必要性。

报告的核心建议——对企业端而言,首要任务是搭建三大基础设施:参考素材库(盘活存量数字资产)、镜头语义模板库(将成功经验标准化复用)、合规审校流程库(防范版权与安全风险)。这恰好呼应了报告"镜头语义操作系统"的核心论点:真正稀缺的不是模型,而是系统。

结语

正如清新研究团队所言:Seedance 2.0的真正意义,是把AI视频从工具变成内容工业新基础设施。谁能率先实现"系统能力+模型上限"的双重突破,谁才可能成为视频生成革命的核心平台。

历史总是惊人的相似。一百多年前,汽车行业的竞争焦点从"谁的发动机更快"转向"谁的流水线更高效",福特T型车由此改变了世界。AI视频,或许正在经历同样的转折时刻。

本文基于清华大学清新研究团队《Seedance 2.0研究报告》整理解读,更多详细内容请查阅原报告。

以下是内容节选↓↓↓ 文末点击链接免费下载pdf,扫二维码加入交流群

AI科普馆:打开AI世界之窗