真是一幕巨大反差。

这既是刻意“制造”的偶然,也是长期压力下必然出现的戏剧性碰撞。

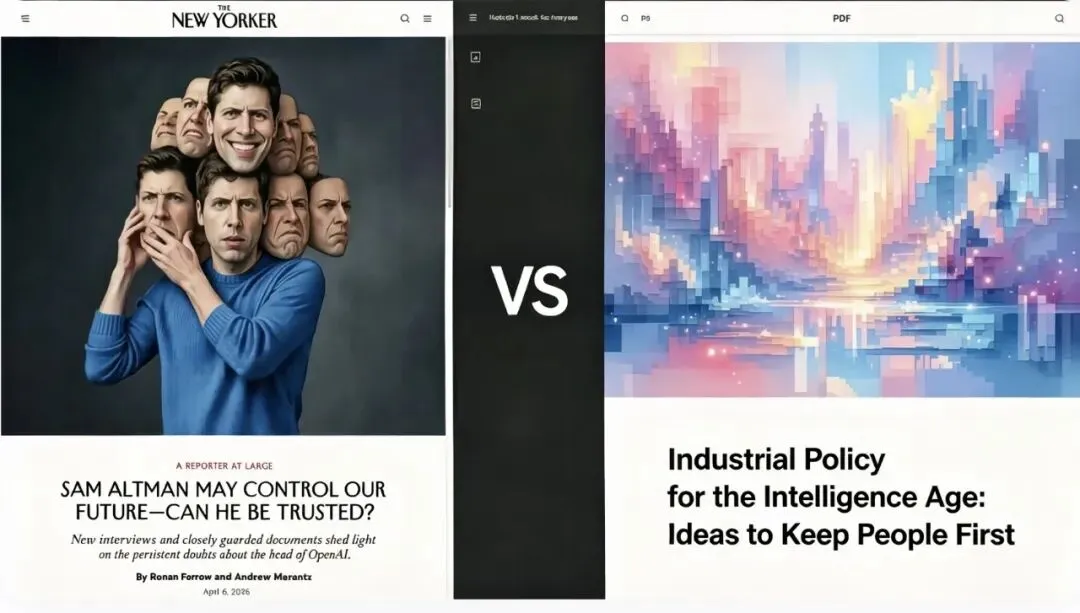

美国时间4月6日,《纽约客》在线刊发了一篇有关OpenAI的深度调查报道。

几小时后,OpenAI迅速发布题为《智能时代的产业政策:以人为本的理念》白皮书,随后官方X平台推出"安全奖学金计划",旨在支持AI安全和一致性独立研究及培养下一代人才。

白皮书一共13页,笔触优雅,引经据典,将罗斯福新政与进步主义时代援引为历史先例,呼吁建立公共财富基金、匹配的劳工福利、自适应社会安全网以及围绕超级智能的全球治理架构。

报告甚至坦言,"经济收益可能集中在少数公司,比如OpenAI自身",这一自我解剖式的坦诚,令人印象深刻。

不过,两相结合,你会瞬间感受到一种讽刺。

那就是,一家以人类福祉为创立使命的公司,正以前所未有的速度抛弃这一使命。而此刻却选择用一份所谓"以人为本"的宏大政策蓝图,来争夺公众叙事的主导权。

要理解这种反差,先得看清楚,这是一个怎样的语境。

OpenAI成立之初是非营利机构,使命是确保AI造福全人类。这一出发点,与白皮书今日所呼吁的理念,在字面上确实高度一致。

不过,过去两年,奥特曼主导下的OpenAI,却拉出一条与使命渐行渐远的轨迹。

这轨迹,首先体现在数字上。

奥特曼频繁抛出令人咋舌的估值与规模预测,将OpenAI描述为一家需要数千亿乃至数万亿美元才能实现使命的公司,并以此为杠杆撬动资本市场。公司估值在短短数年间被推向数千亿美元级别,市场持续渲染其即将启动IPO的预期。就在白皮书发布当天,奥特曼接受采访时仍在强调,超级智能的到来指日可待,将带来颠覆性变革,美国需要一份类似大萧条时期"新政"的新社会契约来应对。

与此同时,OpenAI与英伟达之间形成了深度的循环投资关系,算力需求推高英伟达股价,英伟达市值又反过来强化了整个AI行业的估值逻辑,泡沫与系统性风险在这一循环中不断累积。

这些数字所渲染出的,与其说是普惠愿景,不如说是为资本服务的市梦率。白皮书呼吁"让全民共享AI红利",但当企业的核心目标是为华尔街投资者创造巨额回报时,这承诺的落地空间,从结构上就已被压缩殆尽。

商业化加速的同时,公司从非营利机构转型为营利性实体,早就架空了创立时的原始章程约束。

白皮书呼吁建立"使命导向的企业治理",要求AI公司采用公益公司架构,嵌入公共利益问责机制。但OpenAI从非营利转向"营利优先"的复杂治理结构,实际走向恰恰与此相反。

这是第一层背离,使命承诺与商业化轨迹之间的背离。它提供了理解白皮书的基本语境。

第二层背离,发生在公司内部,《纽约客》的调查报道可谓一次致命的重击。

这篇报道,由美国杰出调查记者Ronan Farrow与Andrew Marantz联合撰写。他们援引了前首席科学家伊利亚·苏茨克弗秘密整理的内部备忘录,以及曾在OpenAI任职、如今担任Anthropic CEO的达里奥·阿莫迪在当时留下的200多页私人工作记录。

其中,苏茨克弗的备忘录,以"山姆表现出一贯的行为模式……"为开头,第一条便是:"说谎。"

而阿莫迪在笔记中则直言:"OpenAI的问题根源就是山姆本人。"

报道采访了100多名知情者,记录的是在商业化压力持续推进的过程中,安全承诺如何被一步步系统性搁置、牺牲。这不是偶发的管理失误,而是一种长期博弈的沉淀结果。

白皮书将"规避风险"作为核心目标,强调"当能力提升时,安全必须同步提升"。奥特曼也曾公开承诺将为"超级对齐"安全团队分配20%的计算资源。但调查报道中披露的数据是,实际获得的算力仅占1%至2%,且都是老旧的低性能芯片,顶级硬件全被抽调给能快速变现的业务了。核心安全团队随后被解散,发出风险警示的研究人员,要么遭解雇,要么被边缘化。

在GPT-4的安全审批流程上,奥特曼向董事会做出了误导性表述。当一位董事要求提供书面批准文件时,发现相关程序从未以文件形式完成。在GPT-4o的开发中,安全测试被要求"快速完成",企业甚至在评估开始前就已计划好发布庆祝活动。报道还提及,2023年发生的一起相关黑客入侵事件,相关方被指在长达一年时间里未向监管机构与公众披露。

就在白皮书发布前数日,COO布拉德·莱特卡普被冠以"特殊项目负责人"的名义调离日常运营岗位,这种安排在企业界历史上往往是边缘化异见高管的委婉说法。他的出局,为奥特曼加速推进上市计划清除了内部阻力。

白皮书写道,AI对齐不应"由工程师或高管在密室里定义",需要"代表性公众参与"。而奥特曼在采访中也说,"一项将对我们所有人产生如此深远影响的决定,不应由一人单独做出"。然而,连安全审查的内部透明度尚且如此,遑论公众参与。

《纽约客》的调查,正是揭露了这套表里不一的治理逻辑。在国会作证时呼吁建立严格的AI监管规则,背后却游说削弱具体条款。在Anthropic以伦理立场拒绝向五角大楼提供自主武器支持后,奥特曼迅速填补了这一缺口。

至此,两层背离叠加在一起,构成了理解白皮书的完整语境。

也正是在这个语境下,白皮书与《纽约客》调查同天落地所制造的反差,有了更清晰的解读空间。

当然,纯看时间,这反差,可能是偶然。但很多时候,多重压力博弈到极点的释放,常常就这么有戏剧性,因此也就有了一种必然性。

更大的可能是,OpenAI知道《纽约客》即将发布这篇报道,明白它的杀伤力。所以选择同一天,用一份强调"民主、透明、以人为本"的白皮书,抢占媒体注意力,对冲负面影响。

对于这一幕,外界批判亦相当直接、犀利。

卡内基国际和平基金会访问学者安东·莱希特在评论中写道,这报告不过是一种"为监管虚无主义提供掩护的公关工作"。

认知科学家加里·马库斯则强调,每当奥特曼陷入麻烦时,惯用手法就是以宏大叙事转移视线,这次报告同样是"奥特曼式的",借此掩盖其内部治理与安全承诺上的失败。

白皮书还将自己定位为"AI时代民主价值观的守护者"。然而,它所描绘的这场竞争中,另一套体系正在全球范围内快速扩张,并在"民主化AI接入"这一具体维度上,提供着更具实质性的产品。

DeepSeek以远低于美国同类产品的成本实现了可比性能,阿里Qwen开源模型系列亦已催生逾18万个衍生项目。中国AI企业拥有一个美国同行没有的结构性优势,它们不必依赖什么"民主、人本"一类道德修辞来维系商业合法性,却同样接受严格的合规与安全监管,在开源普惠上走出了不同路径。

而在全球新兴市场,一个可以低成本部署的高质量开源模型,可能比一份精心撰写的"民主AI治理白皮书"更具说服力。

真正的挑战,其实是相同的。无论是OpenAI还是中国AI企业,都需要回答同一个问题,如何在实际产品、实际安全实践和实际治理结构中,让"以人为本"成为可被验证的现实,而不仅仅是政策文件中的愿景。

当然,夸克君这里绝非完全否定OpenAI这份白皮书的价值。它确实也值得被认真对待,尤其可以作为议程设置文件,作为了解顶层AI公司如何思考自身政治经济处境的窗口。其中一些具体提案,尤其是自适应安全网和国际信息共享机制,具有真正的政策价值。

但我们强调的是,不要被它的修辞所迷惑。

这份"以人为本"宣言,与《纽约客》调查在同一天落地,不是道德领导力的展示,而是危机公关的工具。

"民主治理"的呼吁,来自一家正在拆解内部制衡机制的公司,是对这些价值观语言的战略性借用,而非践行。

如果OpenAI真的相信自己所写下的那些承诺,最紧迫的任务是从内部开始,重建独立的安全团队,公开透明地回应《纽约客》揭示的结构性问题,在IPO压力下而非之后,证明公司拥有与其愿景相称的治理能力。

相比切实的行动,言词的代价低廉而脆弱。白皮书虽好,但不应成为公关遮羞布,而应成为自我改革的起点。