随着AI应用进入规模化落地阶段,智能体(Agent)也逐步快速渗透到各个行业,企业对智算设施的需求已经从单纯的算力供给转向为业务赋能,从而实现性能优化、成本管控、运营效率、安全保障以及应用落地等全方位赋能。

基于分布式架构的AI Infra 底座:分布式的AI Infra 底座为企业提供了灵活弹性的智算平台构建方案,支持基于混合云架构的、云边一体的算力布局与调度,实现AI模型和应用开发的全流程管理;

异构的AI Infra 硬件:异构的AI Infra硬件以多元化的智算芯片、高性能存储和智能网络设备为基础,与企业传统通用云平台硬件进行融合,构建起统一纳管的异构计算资源池,为企业智能化升级提供坚实的基础;

高性能的AI Infra 软件:AI Infra是当前企业进行AI应用实践的技术框架,并逐渐演进为企业核心的智算技术平台。

高性能的AI Infra软件从智算基础设施和平台的角度,通过异构计算、高性能存储和高性能网络组件,充分发掘AI Infra硬件性能;

提供基于场景化服务能力形成的行业解决方案:企业在进行AI业务和应用拓展过程中,AI Infra基于分布式底座、异构硬件和高性能软件为其提供场景化的技术方案,包括模型训练/微调、在线/离线推理、模型准确率优化、智能体开发,以模板化方案构建的方式帮助企业高效地进行新型业务支撑和应用实践。

异构算力调度能力:针对当前算力多元化的发展趋势,AI Infra通过算力调度技术和平台,实现对异构算力芯片的深度适配和统一纳管,能够根据不同业务场景进行高效的算力选型、编排和分发。

智能应用支撑能力:基于云原生调度编排、微服务框架和高性能应用服务,AI Infra针对智能应用提供开发、部署、运维的全生命周期管理,具备支撑复杂多业务场景智能应用的能力。

全链路数据管理能力:基于湖仓一体对数据采集、清洗和预处理流程的支撑能力,以及向量数据库对向量数据检索的支撑能力,AI Infra具备针对AI模型开发和部署的全链路数据管理能力。

训推一体化和加速能力:AI训推平台针对AI模型训练/微调和推理框架的支撑能力,以及对于AI训推流程的加速能力,成为AI Infra在AI模型开发层面的核心技术平台。

安全体系构建能力:基于隐私计算和联邦学习的核心安全能力,AI Infra融合基础云安全能力,构建适配AI模型和应用的智算安全体系,保障AI模型和用户敏感数据的安全。

全流程场景化服务能力:针对智能体(Agent)在各行业领域加速应用的趋势,AI Infra具备支撑智能体开发与应用全流程的场景化服务能力,为MCP等智能体相关技术提供了稳定的运行环境。

在面向行业的具体落地过程中,AIInfra结合不同行业的业务特性,提供适配的部署模式、资源配置和技术能力,满足从算力管理到AI应用落地的全流程需求。

AI Infra基于行业性AI业务和应用需求视角,具备云边一体的算力池化、调度与管理能力,云原生的应用开发、运维,全链路的湖仓一体、向量数据检索能力,一体化的训推框架、训推加速能力,以及体系化的基础云安全、模型安全和数据安全。

在交通出行行业,AI Infra通过云边端协同架构,实现车路协同、多模态感知等关键能力,推动智能出行与交通管理革新;

在工业制造领域,依托实时数据处理与分布式算力,优化生产全流程,实现柔性制造与供应链智能决策;

教育行业则借助训练加速、向量数据库等技术,构建个性化学习与智能教学新范式;

泛互联网与IT服务依赖其高并发支撑与敏捷扩展能力,保障业务快速迭代;

具身智能通过多模态融合与云边端协同,赋予机器人精准感知与实时决策能力;

而医疗行业则基于高性能算力与隐私计算,推动AI诊疗、精准药物研发等场景落地。

AI Infra基于行业智算业务和智能应用现状洞察,提供场景化的支撑能力和技术方案。

AI Infra具备灵活的算力适配、弹性的资源交付和丰富的技术特性,能够根据各行业细化的需求异同,构建模板化的智算基础设施和技术平台部署,并提供智能应用和智能体的开发、运维方案。

当前,AI Agent(智能体)和生成式AI等先进AI技术在多个领域已经展现出强大的应用价值,驱动全球产业智能化升级。

从通用场景到特定行业场景,从单点应用到企业全业务流程,行业智能化先行者不仅积极构建智能营销、数字员工等应用场景,更致力于通过数据资产重构和智能服务开发,探索全新的商业模式和增长曲线。

这种探索正从技术验证迈向规模化应用,通过效率跃升和商业模式重构,推动产业实现革命性转型。

目前智能体技术已经突破实验室阶段,在金融、制造、零售等流程标准化程度高的行业加速规模化应用。

IDC数据显示,超过64%的中国企业已进入智能体的测试验证和采购培训阶段,预计到2028年中国企业级智能体应用市场规模将达到270亿美元。

与此同时,生成式AI正加速渗透各个领域,2028年预计中国生成式AI占AI市场总投资规模比例将达到30.6%,突破300亿美元,五年年复合增长率(CAGR)高达51.5%。

当前,软件与信息服务行业以41亿美元领跑投资规模,预计2028年将达149亿美元;此外,医疗健康、能源、制造、交通出行和教育五大行业投资增速值得关注,预计将保持在64.3%-67.2%的高速年复合增长率,展示出强大发展潜力。

AI Agent与生成式AI等AI技术的持续深化和规模化应用正在重塑云基础设施的核心范式,对云端AI能力支持体系提出了全新要求。

这种由AI驱动的云基础设施演进,正在重塑整个云计算产业的技术栈和价值。在这一进程中,企业云技术布局正经历着从“资源规模导向”向“业务价值创造”的战略升级,这种转变主要体现在四个维度:

企业在智能化转型中往往会产生搜索推荐、内容生成、语义分析、图像识别等多种AI应用需求。

为满足这些高性能计算场景,企业需要可扩展、低延迟、高吞吐的AI Infra支持,通过部署高性能计算资源、采用智能化模型编排服务、建立完善的数据治理机制,以全面提升对多模态数据处理、多框架模型部署和多Agent协同的核心支撑能力。

企业不再单纯强调技术 “可用” 或追求计算资源的堆砌,而是更多聚焦 “可创造业务价值” 的AI部署逻辑,如:提升客户转化率的推荐引擎部署、降低成本的自动审核与理赔系统、提高客户满意度的智能客服与语音助手,以及提高自动化监测与问题排障处理效率。

这一转变促使云基础设施的设计与部署需要同业务场景实现深度耦合,形成“AI能力—业务指标—系统反馈”的闭环模式,使基础架构成为业务增长的推动器。

技术架构基于业务目标设计:将业务指标(如转化率、降低成本)转化为技术需求(如模型类型、实时性,Agent开发和运维要求);

基础设施配置与业务场景动态匹配:通过构建弹性伸缩能力,根据场景复杂度和业务峰值自动调整算力、存力和运力资源;

建立反馈优化机制:基于用户行为、成本等业务数据反馈,实现架构的持续改进。

由于企业AI旅程涉及多个触点与平台(APP、小程序、网页、客服等),其将推动AI应用从“单点模型部署”向“多触点、一平台”的多模态模型+Agent架构转型。

例如部署统一的大语言模型底座,支持客服问答、销售引导、内部助手等多种应用,随后通过多模态模型扩展至语音、图像、视频等业务场景,以及通过Agent串联各类业务逻辑。

通过构建统一运维、统一安全、统一评估体系,企业将实现AI Infra的规模化运营与持续演进。

企业在AI应用旅程中将逐步认识到,AI Infra不仅是其重要技术资产,更是实现业务跃升的核心战略资源,其将:

升级AI Agent模式支持业务从“人工驱动”向“智能驱动”演化;

提供按需扩容能力,适应市场变化与用户行为波动;

构建可衡量的技术投入产出比,使每一份架构投资都与业务结果挂钩。

这种范式转变的本质,是云计算从“技术支撑”向“业务赋能”的进化。

随着AI成为企业核心竞争力,云基础设施正从后台支撑系统进化为战略创新引擎。企业关注的不再仅是技术实现,而是通过云与AI的协同发展创造业务价值。

伴随企业AI应用从单点实验向全业务场景的深度融合,其对云基础架构的需求正发生量和质的双重飞跃。

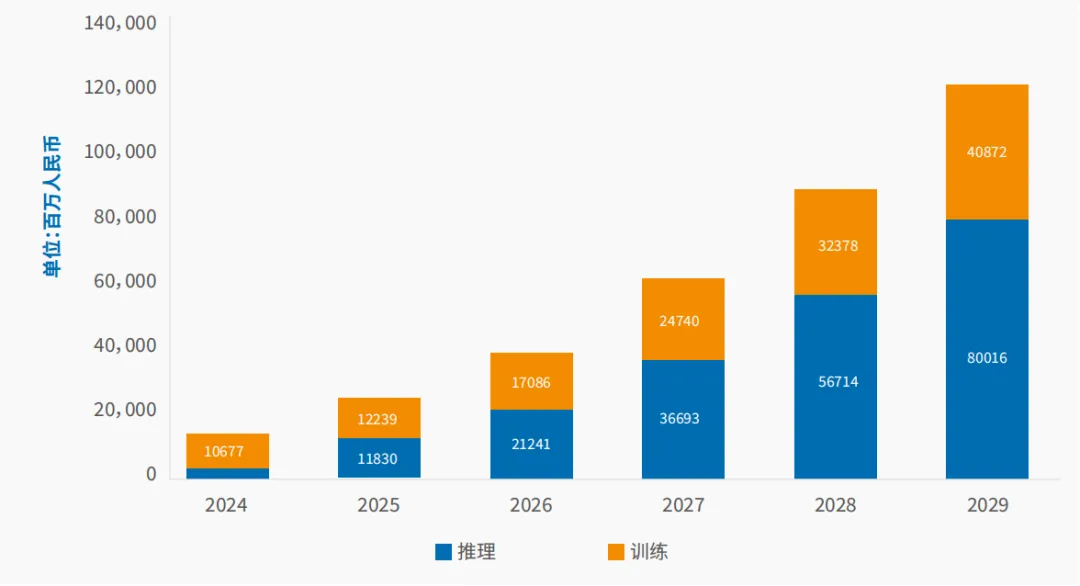

IDC数据显示,2024年中国GenAI IaaS市场同比增长165.2%,市场规模达87.4亿元人民币;随着开源模型的广泛应用以及智能体(Agent)在客服、运维等场景的落地,推理需求占比快速增至24%。

图1 中国GenAI IaaS服务市场(训练/推理)预测,2024-2029

AI应用正在进入规模化落地新阶段。

企业不再满足于单纯的算力供给,而是要求智算设施具备业务价值内生能力。伴随企业对性能优化、成本管控、运营效率、安全保障以及应用落地的全方位需求升级,传统云基础架构正面临挑战。

为满足AI时代企业规模化实现数智化转型的需求,云服务应推进向AI Infra架构的演进,以更好支撑企业大模型训练推理、数据智能、应用开发等核心场景。

卓越性能:获取高性能算力资源支持大模型训练; 面向推理场景提高云准备度,降低时延,应对高并发。

数据效能:让孤岛数据变成流动的知识,提高数据准备度,挖掘数据价值,构建面向AI的数据库和数据湖。

化繁为简:面对规模化的数据、复杂的基于分布式云架构的AI Infra,需要保障高效的资源和流程管理。

专用适配:企业基于场景化服务、弹性架构等服务,确保基础设施与解决方案匹配自身实际业务需求。

成本优化:面向企业AI模型开发的训推一体化,以及AI Agent应用逐步深入的大趋势,针对AI模型的分布式训练、加速微调、边缘推理,Agent开发和运维等场景的业务峰谷特征,提升算力的调度能力,实现成本优化。

增强安全:在进行AI模型所需训练/微调数据的采集,以及Agent调用模型过程中,涉及的数据安全以及AI模型安全问题已成为企业的核心关注点;对于AI模型相关数据的全链路敏感数据识别和处理,以及隐私计算、联邦学习等安全技术的引入是增强企业安全的重要环节。

应用支撑:针对生成式AI模型和Agent所构建应用设计、开发、交付、运维全流程的技术支撑能力,包括开发环境、中间件、技术框架等的迭代和发展;针对AI应用运行环境的智能运维能力,包括智算基础设施和智算技术平台的AI驱动运维工具。

AI Infra通过整合高性能计算、存储、网络、数据库、安全等全栈能力,提升企业AI项目的落地效率,促进“云智融合”战略价值的进一步深化。

基于智算基础设施(IaaS)和智算技术平台(PaaS)构建的AI Infra继承了云基础架构分布式、高可用的技术特性,同时基于云基础架构原生构建的模式,AI Infra能够帮助企业快速搭建支撑不同业务的AI应用平台,在生成式AI高速发展时期持续进行大模型的创新,充分挖掘企业云基础架构的价值。与此同时,MCP等标准技术栈的引入增强了智能体(Agent)的开发和调用效率,而对于异构模型的调度和管理则是智能体的关键能力。

为满足上述需求,IDC认为,AI Infra正加速向架构重构、行业垂直化、生产范式革新、可信智能体系、算力智能化和服务转型等六大方向演进,且智能体的崛起更将这一进程推向新高度。

AI Infra正在经历从“云+AI”的传统架构向“云原生+Agent协同”架构的深度转型,核心特征包括:

云原生架构:容器和Serverless支撑Agent运行时环境

Agent协同架构:支持多Agent协同工作内存优化设计:支持Agent长周期上下文保持

分布式训推一体化:分布在云边端的算力支持训推一体化架构

异构算力池化:满足GPU/TPU智能算力统一调度

实时推理网络:支撑μs级延迟满足Agent连续决策需求

AI Infra正从通用能力向场景化的行业解决方案演进,Agent成为落地载体。

核心特征包括: 行业Know-how与云原生技术的深度融合

开箱即用解决方案:支持场景化AI解决方案快速交付

领域知识库集成:Agent自动调用行业数据库

多模态交互:语音/视觉/文本多通道协同

算力管理进入智能化阶段,关键特征包括:

管理能力:异构算力的统一纳管

调度能力:智能化的资源调度与编排

扩展性:动态扩缩容能力

细粒度算力运营:算力标签体系、性能预测模型、智能调度算法

专属优化:动态资源分配、边缘Agent轻量化

AI Infra的安全能力正在经历从“基础云安全”到“可信立体的安全体系”的升级,核心特征包括:

隐私计算:数据存储/传输/计算全生命周期隐私保护

行为审计:区块链存证Agent决策链

数据安全:字段级加密、动态脱敏

联邦学习:数据隔离环境下Agent协同进化

对抗防御:防止Agent被诱导泄露敏感信息

模型安全:对抗训练、水印溯源

合规认证:等保2.0、GDPR适配

高可用性:灾备与业务连续性保障

伦理约束:代码化植入行业合规规则

AI研发过程中的开发运维模式正在发生根本性变革,核心特征包括:

AgentOps:Agent行为轨迹审计,多Agent协作效能评估,Agent策略博弈仿真,Agents风

险预测、Agent根因分析等

MLOps:机器学习全生命周期管理

模型训推:自动化模型训练与部署流水线

AIOps:持续集成/持续交付(CI/CD)的AI实践,云基础设施智能诊断分析,应用智能观测,预测性运维,运维智能体,运维服务化的实践模型管理:模型版本控制与监控体系

AI能力交付模式随着AI应用模式变化不断演进,将AI能力转化为模块化、标准化、易获取的服务,加速AI技术平权。

核心特征包括:

Agent服务化:API市场调用预置Agent能力、基于调用量计费的Agent订阅制、基于企业知识库训练专属Agent

标准化AI能力:模块化、原子化的AI能力交付

服务形态:Serverless化AI服务

API市场:API经济与AI能力开放

付费模式:按需付费的商业模式

应用开发:低代码/无代码AI开发平台

为有效支撑上述需求和趋势,AI Infra发展出完整的四层架构:基于分布式架构的AI Infra底座层、异构的AI Infra硬件层、高性能的AI Infra软件层,以及基于场景化服务能力形成的行业解决方案层。

图2 AI Infra架构全景图

基于分布式、混合云架构的AI Infra底座,使得智算基础设施能够基于公有云可用区、专有云平台和边缘计算环境,从能力上具备大规模、高性能、易扩展、易运维的特性,从而使AI Infra可以根据不同部署环境和应用场景进行灵活的功能裁剪和资源调配,更好地应对AI应用在云边端侧灵活部署的需求,同时使得AI Infra能够很好地适配智算基础设施基于混合云架构的统一管理模式。

由于AI应用的多样化特性,异构的计算、存储、网络等硬件组成了AI Infra的硬件基础。

在计算方面,AI Infra对于多种算力芯片的支持成为核心能力,包括CPU、GPU、TPU、XPU等高性能智能算力芯片;

在存储方面,AI Infra具备对于多种存储架构和接口硬件的统一管理能力,支撑多模态数据的高效存储;

在网络方面,AI Infra支持各类智能网络设备和网卡,具备构建高性能网络的。储加速、数据分层、Checkpoint缓存等技术能力,智算网络则提供InfiniBand和RDMA支持(低延迟通信)、网络卸载、跨云互联(专线或SD-WAN)。

算力调度作为AI Infra调度与管理的核心平台能力,从资源管理层面来看,具备了异构芯片算力的适配兼容能力。

其基于通用计算、智能计算、高性能计算任务所需的异构算力,可进行跨集群和智算中心的感知和聚合,并使用分布式路由技术自动化交付不同用户和业务应用。

智能算力作为目前需求量最高的算力类型,算力调度平台针对智能算力具备广泛的兼容能力,包括CPU、GPU、XPU等主流算力芯片类型,同时适配主流的国产化算力芯片。

对于行业用户而言,算力调度未来会成为AI Infra的核心能力,能够很好地屏蔽异构算力硬件的差异性,将这些硬件根据业务特性抽象为具备不同能力的算力资源,同时将大规模的算力资源通过智能路由技术联接、形成分布式的算力资源池,逐渐形成算力模型,针对不同业务储备算力,进行算力运营,从而提升整体算力的业务匹配度和利用率。

AI Agent服务平台针对目前智能体快速发展的趋势,提供对智能体开发和应用的支撑能力,从Agent运行时和开发、Agent可观测和安全方面提供沙箱运行容器、分布式代理、模型客户端和上下文、MCP Server等技术栈和工具链,为行业客户提供Agent全栈开发和运维技术平台,构建完善的Agent应用支撑体系。

AI训推平台提供模型开发流程中的分布式模型训练、高效模型微调、在线/离线推理的完整技术框架以及用于优化训练/微调/推理的技术特性,帮助行业客户充分利用智能基础设施加速模型开发全流程。

AI数据管理平台提供GenAI全链路的数据处理和分析能力,包括数据库(向量、时序)、湖仓一体、大数据分析、流式计算、数据预处理,帮助企业实现对模型开发全量数据的统一治理和高效集成,提升模型开发效率和准确率。另外针对云原生架构GenAI应用的云原生能力,提供云原生调度编排、微服务框架、高性能应用服务,帮助企业快速构建AI应用的开发、部署、运维全流程技术体系。

与此同时,智能运维和开发运维一体化也已经成为AI Infra调度与管理的重要平台能力。智能运维提供统一资源编排(Kubernetes+Serverless)、AIOps(运维工具链)、FinOps(成本优化)、运维Agent(运维智能体)。

开发运维一体化提供AI开发环境和工具、MLOps(开发运维一体化)、模型管理。针对智算基础设施,运维Agent开始在企业运维场景逐步应用。

运维Agent主要聚焦于故障排查和诊断场景,充分利用AI大模型的推理能力进行综合的故障根因推断,同时构建运维知识库,为运维人员提供问题咨询与信息检索能力。

安全合规包括AI Infra安全体系、模型安全能力、数据安全保护等核心安全能力的构建,采用模型开发全链路的敏感数据筛选和脱敏技术,引入模型防御机制如对抗训练、敏感性分析,应对模型窃取、投毒、推理攻击等新型安全威胁,建立模型注册、评估、监控与退役机制,形成标准化模型治理流程,并构建完整的行为日志系统以实时监测并记录访问与模型使用行为;针对AI在边缘或端侧,则部署环境嵌入硬件安全模块(TPM)、安全启动机制和设备行为监测策略。

基于上述技术能力和管理机制,帮助企业在进行深度GenAI实践过程中提升安全合规等级,保护GenAI的核心数字资产。

针对GenAI的场景化服务能力是当前企业级AI Infra应具备的技术支撑能力,主要面向智能体开发与应用、训推一体化、模型训练、模型微调、在线/离线推理、多模态模型融合、模型准确率优化和混合数据治理等主流技术场景。

智能体开发与应用:针对智能体的全流程开发平台和应用支撑平台,增强Agent一体化开发能力。采用统一的MCP协议,标准化Agent对各类AI模型的直接调用,支撑Agent在各类业务场景中的灵活应用。

训推一体化:针对训推一体化场景,提供基于分布式云的“中心云训练+边缘云微调+边缘/端侧推理”模式,同时提供算力调度、任务调度编排、强化学习(RLHF/DPO)、MLOps等技术能力,以及标准化算子库、全流程模型开发工具链。

模型训练:针对大规模分布式模型训练场景,提供智算基础设施和智算技术平台,同时提供算力切分、预训练加速、断点续训、低代码/可视化训练等技术能力。

模型微调:针对高效模型微调场景,提供智算基础设施和智算技术平台,同时提供模型微调策略(全参微调/部分参数微调/参数高效微调)、模型微调方法(SFT微调/指令微调)、微调加速(LoRA)、低代码/可视化微调等技术能力。

在线/离线推理:针对在线/离线推理场景,提供智算基础设施和智算技术平台,同时提供主流推理模型(DeepSeek/Llama/Qwen)、推理加速(算子融合/高性能加速库/模型量化/PD分离)、大语言模型和多模态模型开箱即用等技术能力。

多模态模型融合:针对多模态模型融合场景,提供大语言模型与识别模型结合构建VLA模型的能力,以及NLP、CV等小模型融合为大模型的能力。同时提供通用模型与垂类模型结合能力,实现统一的模型开发框架。

模型准确率优化:针对模型准确率的优化,采用标准化RAG技术框架减轻模型幻觉,同时结合业务数据进行模型强化训练和微调。

混合数据管理:针对智能体开发,提供标量和向量的多模数据处理分析能力;针对RAG流程,提供具备高检索性能和准确性的向量数据库。

刚刚突发!华为入局:AI Code 编程产品“码道”,人人会开发编程时代之深度洞察!2026