博通Q1 AI收入同比+116%,Q2预计+240%——这不是普通的增长数字,而是定制芯片时代全面到来的信号。六家超大规模客户正在把AI算力的主导权,从英伟达手里往回夺

六个核心判断

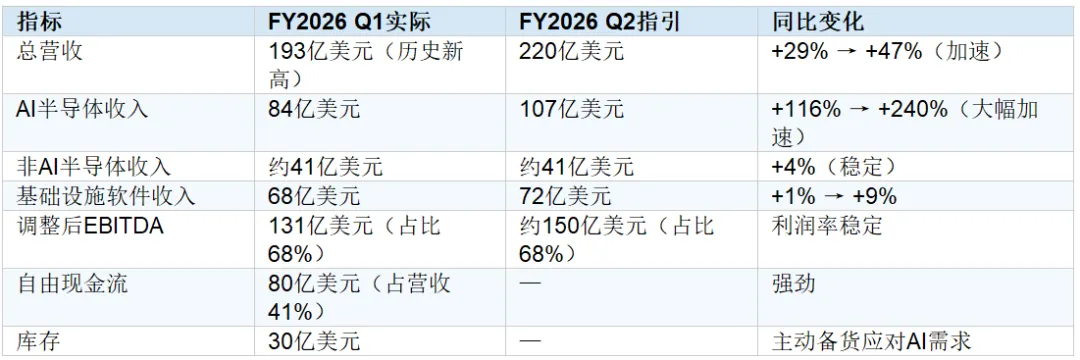

① 数字比任何分析都有说服力: Q1总营收193亿美元创历史新高,AI收入84亿美元同比+116%;Q2指引AI收入107亿美元同比+240%——增速还在加速

② 2027年是关键拐点: 博通明确表示2027年AI芯片总收入有望超1000亿美元,来自六个超大规模客户的定制芯片和网络芯片需求将出现「急剧拐点」

③ 六个客户撑起一切: 整个AI业务的收入体量,来自且仅来自六家超大规模客户——谷歌、Meta、微软、字节等。每一家都已有多代芯片的长期规划,不是短期机会,是战略级绑定

④ 定制芯片不是威胁英伟达,是另一个市场: CEO明确:做出能与英伟达竞争的芯片需要顶级硅片设计团队+先进封装+网络集群经验,三者缺一不可。自研芯片项目短期内撼动不了英伟达,但博通受益于两边

⑤ 网络是被低估的主线: AI网络收入预计占AI总收入33-40%,过去6-9个月增速高达200-300%。铜缆直连(DAC)+以太网组合是超大规模集群的主流选择,博通是最大受益方

⑥ 训练+推理双芯策略正在成为头部客户标配: 最成熟的超大规模客户正在同步开发训练芯片和推理芯片——「超级智能」时代,推理算力和训练算力缺一不可

一、财报数字:用数据说话

最值得关注的信号:AI收入增速从Q1的+116%跳升至Q2预期的+240%——这不是基数效应,是真实需求加速的体现。半导体整体营收Q2预计148亿美元,同比+76%,其中AI驱动的部分占绝对主导。

二、「六个客户」:理解博通AI业务的核心钥匙

博通的AI业务有一个极为特殊的结构:整个庞大的AI收入,来源于且仅来源于六家超大规模客户(Hyperscaler)。这些客户包括谷歌、Meta等科技巨头,他们正在大规模部署专属定制芯片(ASIC)替代或补充英伟达GPU。

为什么只有六个客户,却能创造百亿级收入?

因为这六家客户每一家的需求规模都是天文数字。他们不是在「试水」定制芯片,而是在做多代、多年的战略级部署:

每家客户都清楚地知道自己每一年要建设多大的算力容量

与博通的合作不是一次性交易,而是跨越多个芯片世代的长期绑定

部分供应已锁定至2028年及以后,供应链可见度极长

每家客户的定制芯片路线图都已明确,博通完全清楚下一代芯片的方向

CEO原话的含义:「我们不把任何一个客户当作备选项,每一个都是战略级的」——这意味着博通和这六家客户之间,是深度技术绑定,不是普通供应商关系。换一家供应商的切换成本,可以用「数年」来衡量。

三、定制芯片(ASIC)vs 英伟达GPU:不是替代,是共存

超大规模客户为什么要做自己的芯片?

通用GPU(英伟达)的问题在于「通用」二字本身——它为广泛适用性设计,但具体到某家公司的特定工作负载(比如谷歌的搜索推理、Meta的推荐系统),专用芯片可以做得更高效、更省电、更便宜。

随着AI工作负载日趋多样化和专业化,训练、推理、强化学习各有不同的算力需求模式,「一块GPU打天下」的方案开始出现效率瓶颈。

但自研芯片为什么很难超越英伟达?

博通CEO在电话会上对这个问题给出了清晰的判断:

需要顶级硅片设计团队——不是招几个工程师就能做到的

需要先进封装技术——台积电CoWoS等先进封装是卡脖子环节

需要网络集群专业知识——如何把几千块芯片联网协同工作,经验壁垒极高

英伟达每一代都在进步——即使某次追上,下一代又被拉开

核心逻辑:定制芯片和英伟达不是零和游戏。超大规模客户会同时部署两者——英伟达用于通用训练,自研ASIC用于大规模推理部署。博通是ASIC定制的最大受益方,英伟达的需求并不因此减少。

四、网络:被低估的主线

为什么说AI网络是主线而不是配角?

很多人关注博通时,焦点放在XPU(定制加速器芯片)上,但实际上AI网络部分的增速同样惊人,且往往被低估:

过去6-9个月,AI网络收入增速高达200-300%

预计AI网络收入将占AI总收入的33-40%

下一代GPU/XPU对带宽需求更高,网络芯片需求随每一代新产品换代加速增长

技术路线:铜缆直连+以太网的组合

在大规模AI集群的组网方案上,博通给出了清晰的技术立场:

集群内部(Scale-up):铜缆直连(DAC)是首选——延迟最低、功耗最省,支持从100G到200G乃至400G的速率演进

集群之间(Scale-out):以太网是行业共识——可扩展性强、生态完善,博通已与多家超大规模客户达成深度合作

以太网在AI数据中心的规模扩展中正在确立统治地位——这对博通是极大利好,因为博通的以太网交换芯片(Tomahawk/Trident系列)是市场上最主流的方案。

五、训练芯片+推理芯片:「双芯」策略正在成为标配

这是电话会上一个值得高度关注的趋势信号:最成熟的超大规模客户,正在同步开发两种芯片——一种专门用于训练,一种专门用于推理。

为什么?

训练和推理的计算特征完全不同:训练需要高带宽、大内存、高并行度;推理需要低延迟、高吞吐、低功耗

用同一块芯片做两件事,意味着两件事都不是最优的

当AI模型从「实验室工具」变成「生产服务」,推理算力的成本效率变得与训练同等重要

CEO的表述暗示:在迈向「超级智能」的路上,推理芯片的投资和训练芯片是同等优先级的——两者必须同步推进,缺一不可。

对行业的意义:这意味着超大规模客户的芯片采购需求将从「每年一颗」变成「每年两颗」,博通潜在的定制芯片市场空间直接翻倍。

六、2027年:一个被反复提及的时间节点

在整个电话会中,「2027年」被多次提及,值得单独拿出来理解:

AI芯片总收入预计2027年超过1000亿美元

超大规模客户已将供应锁定至2028年及以后,2027年的需求能见度已经很清晰

当前最成熟客户已在朝「超级智能」方向演进,2027年将看到明显的能力跃升

CEO形容2027年将出现「急剧拐点」(pretty sharp inflection)

市场经常忽视的一点:当一家公司的CEO在财报电话会上反复锚定某个年份,通常意味着他手里有清晰的订单和路线图在支撑——而不只是乐观预测。博通锁定的六个客户已经给出了到2028年的明确需求计划,这是罕见的长周期可见度。

七、风险提示

客户集中度风险:六个客户撑起全部AI收入,任何一家削减资本开支或转向其他供应商,都会造成业绩波动

英伟达竞争加剧:若英伟达加速推出针对推理场景的低成本方案,可能影响超大规模客户的定制芯片意愿

资本开支周期见顶:若全球AI基础设施投资进入调整期,2027年拐点可能延迟

台积电先进制程产能:博通XPU和网络芯片均依赖台积电3nm/2nm,产能争抢可能影响交付节奏

地缘政治风险:部分超大规模客户有中国背景,美国出口管制政策收紧可能影响相关客户的芯片采购

每日上传超300份调研纪要、研报、电话会议等机构内部资料,产业动态、公司变化实时发布、独家投研团队纪要解读、赠送量化代码。加入星球获取最新信息,比99%的人更具信息优势

免责声明

本文内容综合整理自公开机构调研电话会议,仅供参考交流,不构成任何投资建议。市场有风险,投资需谨慎。