深度解析Broadcom财报:千亿AI愿景经不起几个问号

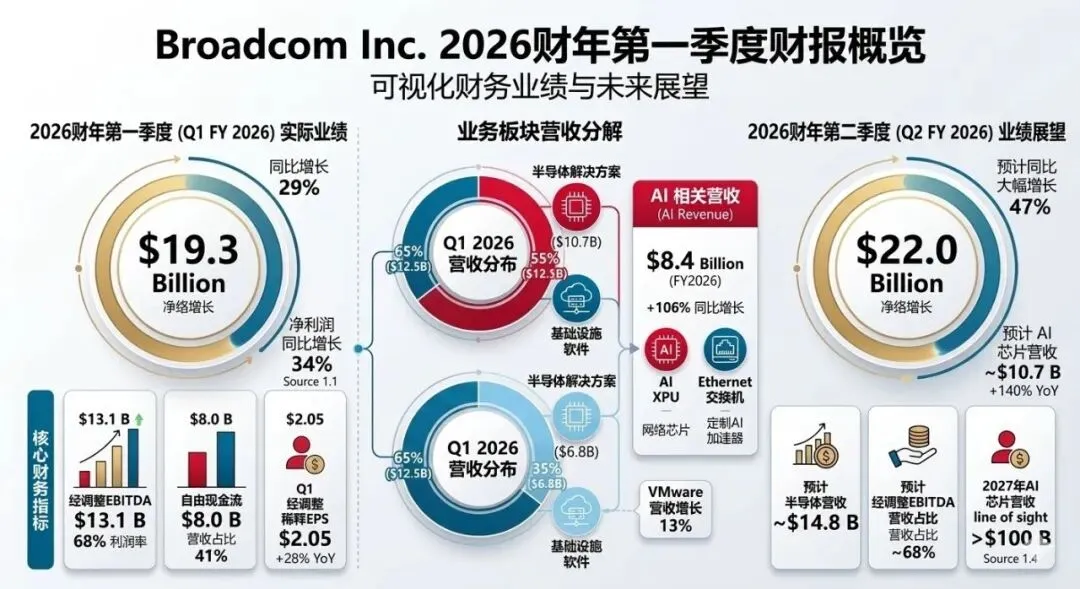

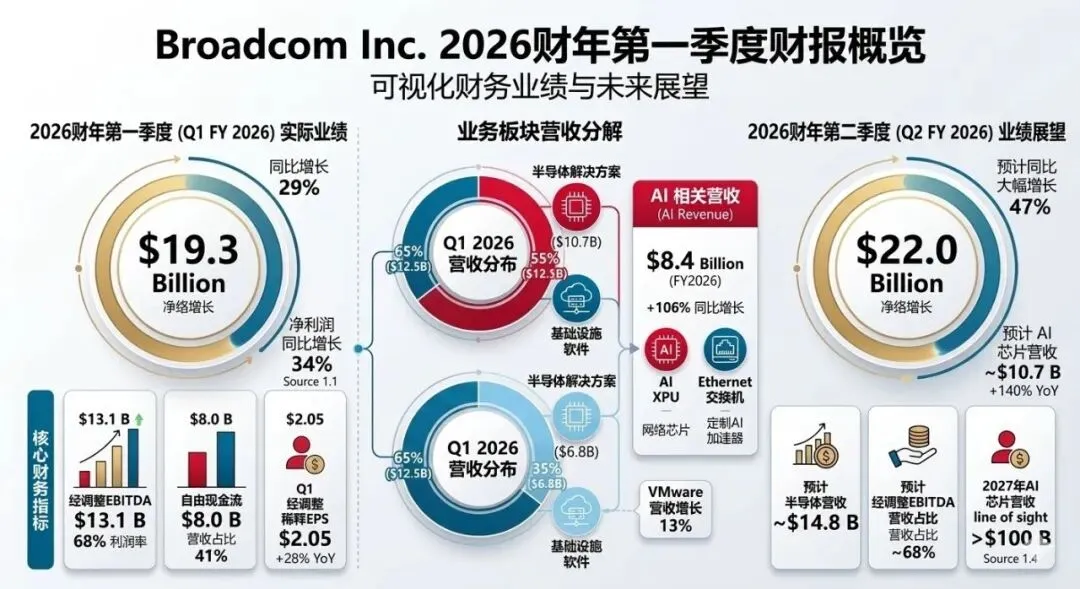

【免责声明:本文基于公开的财报电话会议记录进行分析,不构成任何投资建议。文中观点仅代表作者基于公开信息的独立判断。】3月4日,Broadcom交出了一份让华尔街屏息的成绩单:Q1总营收193亿美元,同比增长29%;调整后EBITDA达到创纪录的131亿美元,占营收比例高达68%。更令人瞩目的是CEO Hock Tan老师在电话会上抛出的一颗重磅炸弹——“我们已经有了清晰的路径,仅AI芯片业务在2027年就将实现超过1000亿美元的收入。”这个数字意味着什么?如果实现,仅Broadcom的AI芯片收入就将超过2024年整个NVIDIA的数据中心业务。对于一家长期被视为“收购整合型”半导体公司的企业而言,这是一个根本性的叙事转变。但在亮眼数据的背后,有几条技术和商业逻辑线值得产业界深入审视。前沿交换机的AI战场:Tomahawk的“唯一性”还能维持多久?

Broadcom在AI网络领域的表现堪称本季最被低估的亮点。Q1 AI网络营收同比增长60%,占AI总营收的三分之一,Q2预计将进一步攀升至40%。驱动这一增长的核心产品是Tomahawk 6——业界唯一的100Tbps以太网交换芯片,以及配套的200G SerDes接口。Tan老师在电话会上毫不掩饰对这种唯一性的自豪。他指出,无论客户使用的是XPU还是GPU,只要搭建大规模AI集群,就需要Broadcom的交换芯片。这一表态并非虚言:在AI数据中心的scale-out场景中,以太网已经取代InfiniBand成为业界共识,而Broadcom在以太网交换芯片市场的份额长期维持在70%以上。但问题在于,这种产品代际领先能否持续?Broadcom已经预告了Tomahawk 7(200Tbps)将在2027年推出,性能翻倍,“大概率仍是第一个出货”。然而,Marvell、Cisco以及一些初创公司并没有放弃追赶。更值得关注的是,部分超大规模客户正在探索自研交换芯片的可能性,正如它们在AI加速器领域所做的那样。Broadcom在交换芯片领域的“唯一性”,本质上是一个时间窗口问题,而非结构性护城河。另一个被市场忽视的信号是Tan老师对scale-up网络的判断。他明确表示,在机架内部的XPU互联中,直连铜缆Direct Attached Copper仍然是首选方案,并且Broadcom有能力将铜缆互联从200G推进到400G SerDes。这等于公开表示:被行业热捧的CPO技术在短期内不会取代铜缆。考虑到Broadcom本身也是CPO的领先开发者之一,这番表态颇具深意——他们宁可延缓自己的光学产品线,也要为客户守住铜缆路线的成本和功耗优势。SerDes拚向物理极限:速度竞赛的终点在哪里?

如果说交换芯片是AI网络的“大脑”,那么SerDes就是“神经末梢”。Broadcom目前在200G SerDes上拥有量产领先地位,并已开始布局400G。这听起来是一条清晰的技术路线,但深入来看,信号完整性、功耗和物理距离正在逼近铜缆互联的物理极限。在200G SerDes下,数据以每秒200Gb的速度在铜缆上传输。要维持信号质量,对PCB走线、连接器设计、均衡算法的要求已经极为苛刻。到400G时代,电气信号在铜缆上的有效传输距离将进一步缩短,这意味着机架设计必须更加紧凑,散热挑战将进一步加剧。Tan在电话会上表示“我们的SerDes已经能在400G下驱动机架内铜缆距离传输”。但他没有给出具体的传输距离数据。业界普遍认为,400G PAM4信号在标准铜缆上的有效覆盖范围可能仅限于同一机柜内的极短距离。这对AI集群的物理拓扑设计提出了全新的约束条件。这里隐含着一个产业级别的技术赌注:如果400G铜缆的物理极限无法满足下一代AI集群的scale-up需求,那么光学互联(包括CPO)将不得不提前上场。而Broadcom今天所强调的铜缆路线优势,届时可能反而成为路径依赖的包袱。当然,Broadcom同时也在开发CPO技术,这种两头下注的策略本身就是应对不确定性的典型做法。当Anthropic和OpenAI成为你的命脉

本次财报中最引人注目的信息之一,是Broadcom史无前例地公开点名其AI芯片客户:Google、Anthropic、Meta,以及新加入的OpenAI,外加两个未公开身份的客户。这种透明度本身就说明管理层对客户关系的信心,但也暴露了一个结构性问题——极度集中的客户依赖。具体来看,Anthropic在2026年部署1GW的TPU算力,2027年预计激增到超过3GW;OpenAI则预计2027年部署超过1GW,而根据公开信息其与Broadcom的协议规模为2029年前累计10GW。Stacy Rasgon在问答环节通过"算力瓦数"方法推算,Broadcom 2027年的总部署量接近10GW,按每GW约200亿美元的芯片价值计算,得出了与管理层口径一致的千亿级别收入规模。但这种增长模式存在几个值得警惕的风险。第一,客户自研威胁并未消失。虽然Tan强调COT(Customer Owned Tooling)模式短期内难以对Broadcom构成挑战,并自信表示“我们在COT竞争方面几年内都看不到威胁”,但历史告诉我们,当客户的采购规模达到数百亿美元量级时,自研的经济动机会变得极为强烈。Google的TPU项目本身就是最好的例证——它从最初依赖外部设计,逐步建立了内部芯片团队的完整能力。第二,AI行业的技术路线变迁速度极快。一年前还没有人预料到推理需求会如此爆发性增长,Tan自己也承认这一点。如果下一个技术范式(比如更高效的稀疏架构或全新的计算模式)导致对当前XPU设计的需求发生结构性变化,Broadcom为六个客户定制的芯片路线图可能面临大规模调整。第三,也是最微妙的一点:Anthropic和OpenAI目前仍处于大规模烧钱阶段,它们的算力采购最终取决于各自的融资能力和商业化进展。如果AI领域出现寒冬式调整,这些客户的采购承诺能否兑现将成为Broadcom面临的最大不确定性。VMware收购:即将面临AI的侵蚀?

在AI芯片的光环下,Broadcom的基础设施软件业务——主要是以690亿美元收购VMware而来——显得相对低调。Q1软件营收68亿美元,同比仅增长1%,但VMware本身的表现不俗:营收增长13%,年经常性收入增长19%,Q1合同总价值(TCV)预订额达到92亿美元。这些数字表明Broadcom对VMware的整合正在按计划推进。收购后的核心策略——将VMware从许可证模式转向订阅制——正在产生效果,ARR的持续增长证明了客户黏性。Q2软件业务指引为72亿美元,同比增长9%,加速趋势明显。但Tan在电话会上为VMware做出的一番辩护引发了更深层的思考。他特别强调VMware Cloud Foundation(VCF)是数据中心中不可被替代的抽象层,是“AI软件和物理硅之间的永久中间层”,并断言“生成式和代理式AI的增长将创造对VMware更多而非更少的需求”。这种防御性表态本身就暗示市场存在一种担忧:AI对传统企业软件的吞噬效应是否会波及VMware?逻辑是这样的——如果AI工作负载越来越多地运行在专用的GPU/XPU集群上,而这些集群往往使用Kubernetes和自研编排系统而非VMware,那么企业IT的增量支出是否会绕过VMware的生态系统?Tan的回应是将VCF定位为“私有云和混合云的操作系统”,强调企业在部署AI时仍然需要一个统一的基础设施管理平台。这个论点在短期内是成立的——大多数企业并不是从零开始构建AI基础设施,而是在已有的VMware环境中叠加AI能力。但如果我们把目光放长到五年以上,当云原生和AI原生的工作负载占比持续上升,VMware的“抽象层”价值是否会被更轻量、更专用的方案逐步替代,这是一个Broadcom投资者需要持续追踪的问题。从财务角度看,93%的软件毛利率是Broadcom整体盈利能力的重要支撑。如果软件业务增速持续被AI半导体业务远远甩开,它在公司营收中的占比将从目前的35%逐步下降。这并非坏事——毕竟AI半导体业务正在爆发式增长——但它确实改变了当初收购VMware时的投资逻辑:Broadcom看中的是一个稳定的现金流引擎来平衡半导体业务的周期性,而如今半导体业务本身的增速和可见度已经远超软件。Broadcom模式的终极考验:定制芯片帝国的扩展极限

Broadcom在AI领域的商业模式,本质上是一种“深度定制、少量客户、巨额订单”的精品模式。它不像NV那样面向广泛市场销售标准产品,而是为少数几个客户量身打造专用芯片,然后通过多年供应协议锁定收入。这种模式的优势在Q1财报中展露无遗:140%的定制加速器业务增长、管理层对2027年千亿收入的高信心判断、以及客户锁定带来的确定性。但它也存在固有的扩展瓶颈。首先是工程资源约束。为每个客户设计一颗甚至两颗定制XPU,加上配套的网络芯片,需要大量的顶级半导体设计人才。Broadcom目前服务六个客户,每个客户的芯片架构、工艺节点、封装方案都不同。随着客户数量的增加和每代芯片复杂度的提升,工程团队的扩展速度能否跟上订单的增长速度,是一个值得关注的瓶颈。其次是供应链风险。Tan老师反复强调已经锁定了2026-2028年的关键零部件产能,包括先进制程晶圆、HBM和关键基板特别是T-glass。这种前瞻性供应链管理无疑是Broadcom的竞争优势。但反过来看,这也意味着Broadcom必须提前数年做出巨额的产能承诺。如果AI需求出现阶段性调整,这些预付的产能费用将成为沉没成本。最后,也是最根本的问题:在AI加速器市场中,定制芯片和通用GPU并非零和博弈。Tan老师自己也承认,NV正在不断推出更强的新一代产品。如果NV的下一代GPU在能效和灵活性上取得突破性进展,部分客户可能会重新评估定制XPU与通用GPU的配比。Broadcom的客户今天选择定制路线,是因为在特定工作负载上XPU的性价比优势足够大。但这种优势并非恒定不变。Broadcom Q1 2026的财报,展示了一家公司如何在AI基础设施建设的浪潮中占据枢纽位置。从定制芯片到前沿交换机,从高速SerDes到铜缆互联方案,Broadcom的技术版图几乎覆盖了AI集群从计算到网络的完整链条。193亿美元的季度营收和对千亿级AI芯片收入的愿景,标志着这家公司正从“并购整合者”转型为“AI基础设施的核心供应商”。但高增长叙事的背后,产业界不应忽视几个结构性张力:六个客户的高度集中、铜缆互联路线的物理极限、客户自研芯片的长期威胁、以及VMware在AI时代的价值重估。这些并非近忧,而是中长期需要持续追踪的变量。Tan老师在电话会上反复使用了一个词:战略性。他强调Broadcom与客户的关系是战略性的、多年期的、不可替代的。在当前AI军备竞赛的狂热中,这种表述无疑具有说服力。但正如半导体行业数十年来一次又一次证明的那样,今天的战略必需品,明天就可能成为性价比的选项之一。Broadcom的千亿赌局,最终取决于AI产业的增长斜率是否足够陡峭、足够持久——而这恰恰是当下最难回答的问题。