随着人工智能(AI)技术在全球范围内的爆炸式应用,从医疗诊断、自动驾驶到刑事司法风险评估,人工智能系统已深度嵌入现代社会的运行骨架之中 1。然而,这种广泛的影响力伴随着严峻的安全与法律挑战。当人工智能系统出现决策失败、偏见歧视或被恶意利用(如深度伪造、自动化网络攻击)时,如何对其进行科学、规范的调查与归因,已成为网络安全、人工智能及法律界共同面对的核心课题 3。人工智能取证(AI Forensics)作为数字化取证(Digital Forensics)的一个新兴演进分支,其独特性在于它不仅要处理电子数据比特流的完整性,更要解码复杂模型在统计特征驱动下的语义逻辑与不可解释性 5。本报告将从网络安全专家、人工智能专家及法律专家的多维视角,对人工智能系统取证的前沿研究成果进行详尽分析,阐明其与传统取证的本质差异,并深度剖析训练数据质量及机器生成数据对模型评估的深远影响。

第一章 人工智能取证与传统数字化取证的范式鸿沟

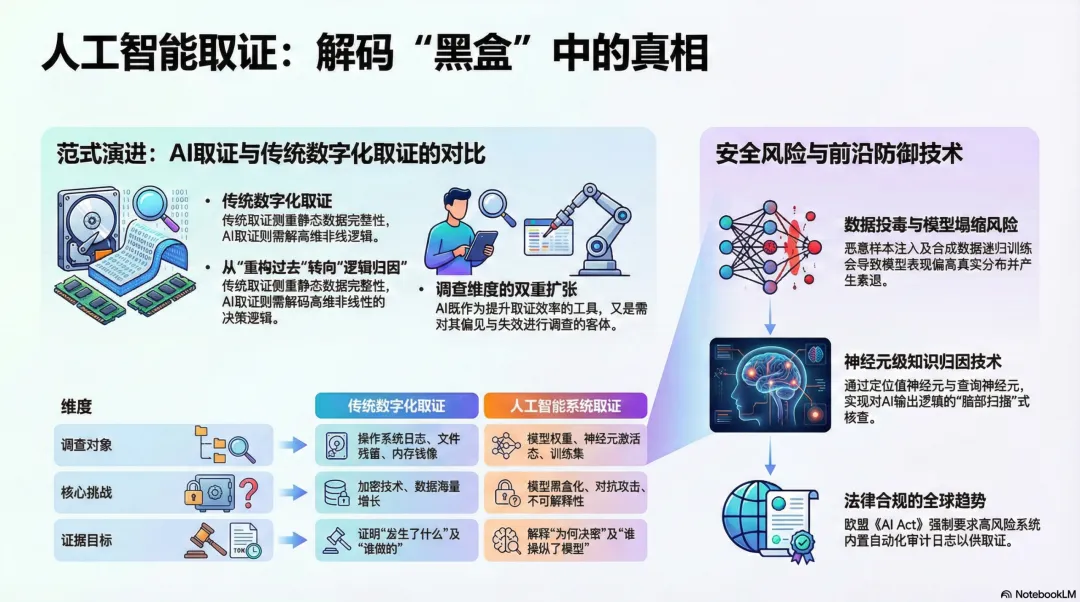

数字化取证传统上是一门关于“重构过去”的学科,其核心在于对存储媒介中静态数据残留的提取与分析 5。然而,人工智能取证的兴起标志着取证范式从“静态位分析”向“动态逻辑归因”的根本性转变 3。

1.1 证据本质的变迁:从比特完整性到逻辑可解释性

传统数字化取证主要关注的是证据的真实性和完整性,即确保数字证据在收集、保存和呈现过程中未被篡改 5。其分析对象通常是文件系统、日志文件或网络数据包,其因果关系往往遵循确定性的代码执行路径 9。

相比之下,人工智能系统的核心是基于机器学习的模型,这些模型并非通过显式的条件逻辑(If-Then)构建,而是通过在海量训练数据上学习统计特征而形成的权重与偏差集合 10。这种特性导致了人工智能证据的“非决定论”倾向。在取证过程中,调查人员不仅需要获取模型的参数文件,更需要理解为什么在特定的输入扰动下,模型会产生特定的概率输出 12。

| 调查对象 | ||

| 逻辑基础 | ||

| 核心挑战 | ||

| 证据目标 | ||

| 工具依赖 |

1.2 调查维度的扩张:AI赋能取证与AI作为取证对象

人工智能在取证领域的角色是双重的:一方面,人工智能驱动的工具(如利用CNN进行多媒体分析、利用NLP进行文本挖掘)极大地提升了处理海量数字化证据的效率 5;另一方面,人工智能系统本身成为受调查的客体,需要对其算法偏见、决策失效及潜在的恶意操纵进行取证分析 3。这种双重身份要求调查人员同时具备传统取证的严谨性与数据科学的深厚功底 14。

第二章 统计特征与语义逻辑:黑盒模型的取证困境

机器学习模型,尤其是深度神经网络,由于其高参数化和非线性结构,通常被视为“黑盒” 12。这种不透明性对法律证据的采信标准提出了严峻挑战,因为司法体系要求证据必须具备可测试性和可验证性 13。

2.1 统计关联对可解释性的消解

基于机器学习的AI系统主要识别数据中的相关性而非因果关系 10。在法证分析中,这种特性的直接后果是“聪明汉斯效应”(Clever Hans Effect)的泛滥——模型可能基于训练数据中存在的偶然性统计特征(如医疗影像中的标注符、图像背景中的特定纹理)做出预测,而非基于真实的病理或目标特征 12。

从人工智能专家的角度看,这种现象源于经验风险最小化(ERM)原则的副作用。当取证调查试图解释一个自动驾驶系统为何在光线充足的情况下仍发生碰撞时,传统的逻辑审计无法解释神经网络内部成千上万个神经元如何共同作用导致了感知错误 10。这种语义层面的断裂,使得从统计输出推导法律因果关系变得异常困难 13。

2.2 解释性人工智能(XAI)在取证中的应用与局限

为了打破黑盒,解释性人工智能(XAI)技术如Grad-CAM(梯度加权类激活映射)和SHAP(Shapley加法解释)被引入取证工作流 6。这些技术通过视觉化或权重分配,试图展示模型在做出决策时“关注”了哪些输入区域 18。

然而,XAI在取证中并非万能药。前沿研究指出,事后解释技术(Post-hoc Explanation)往往是对模型内部复杂逻辑的近似,而非真实过程的完全呈现 6。在司法实践中,如果一种解释方法本身缺乏鲁棒性,甚至可以被对抗性地操纵以掩盖模型的偏见,那么其作为证据的价值将大打折扣 11。

第三章 训练数据质量:人工智能取证的生命线

人工智能系统的行为是其训练数据的函数。因此,对数据质量的评估是AI系统取证中最关键也最困难的一环 20。

3.1 数据投毒与后门攻击的法证回溯

数据投毒(Data Poisoning)是一种隐蔽的对抗性攻击,攻击者通过在训练集中注入精心构造的恶意样本,来操纵模型的最终行为 20。

| 靶向投毒 | ||

| 非靶向投毒 | ||

| 标签翻转 | ||

| 干净标签攻击 |

从网络安全专家的视角看,防御这类攻击的取证方法必须包含对数据供应链的完整审计。实时监测模型性能的“行为漂移”并结合版本控制(如DVC或Git)进行回退测试,是目前识别投毒行为的核心手段 23。

3.2 偏见与代表性:证据力的消蚀

如果训练数据无法真实反映现实世界的概率分布,AI系统将不可避免地产生偏见 11。在刑事司法风险评估系统中,如果训练数据在种族或经济地位上存在不平衡,其生成的建议将具有系统性歧视 13。取证调查必须能够量化这种偏见,并评估其对个案判决的影响 11。这要求取证不仅是技术性的,还必须具备社会技术系统的洞察力。

第四章 机器生成数据的介入:模型塌缩风险与评估难题

随着生成式人工智能(GenAI)的普及,互联网数据正被大量的合成内容充斥 25。这一现象引入了一个前沿的科研难题:模型塌缩(Model Collapse)及其对法证评估的毁灭性影响 27。

4.1 模型塌缩的数学本质与演化

模型塌缩是指学习模型在递归地使用前代模型生成的合成数据进行训练时,其生成的分布逐渐偏离真实人类数据分布,最终导致多样性丧失和功能性衰退的现象 28。

研究表明,模型塌缩主要由以下三类误差累积引起:

1. 统计近似误差(Statistical Approximation Error): 每次采样过程中的随机性导致信息丢失,特别是在样本量有限的情况下。 2. 函数表达误差(Functional Expressivity Error): 模型架构的容量限制使得某些复杂的长尾特征无法被准确拟合。 3. 函数近似误差(Functional Approximation Error): 训练算法(如SGD)的局部最优特性导致分布边缘的“消失”。

在这一过程中,分布的“长尾”区域(即极低概率但关键的事件)首先消失 27。对于取证专家而言,这意味着如果一个AI系统是基于受污染的合成数据训练的,其表现出的“理性”可能只是某种同质化、平庸化的伪统计特征,无法在极端或罕见场景下提供准确的预测或证据。

4.2 机器生成数据对取证评估的影响

当调查人员评估一个AI模型时,如果无法区分训练集中哪些是人类真实数据,哪些是机器生成的合成内容,那么对模型“鲁棒性”和“泛化能力”的任何评估都将是不可靠的 26。机器生成数据的介入产生了一种类似于“信息反馈循环”的效应,使得模型的错误在代际间被放大,这种误差的累积对法证审计提出了极高的要求——必须通过先进的水印技术或起源追踪来甄别数据来源 29。

第五章 前沿取证技术:神经元归因与模型溯源

为了应对黑盒模型的语义黑洞,前沿研究已经从外部行为观察深入到模型内部的微观分析 31。

5.1 神经元级知识归因(Neuron Attribution)

神经元归因技术旨在定位大型语言模型(LLM)中存储特定知识或触发特定决策的确切单元 31。通过分析内部激活模式,研究者发现:

• 值神经元(Value Neurons): 通常存在于模型深层,直接决定了最终输出的语义内容。 • 查询神经元(Query Neurons): 存在于中浅层,负责根据输入上下文激活相应的值神经元 31。

这种技术为取证提供了一种“脑部扫描”式的工具。当模型产生虚假信息或偏见言论时,取证人员可以通过干预(Intervention)实验——如将特定的300个关键神经元置零——来观察预测结果的变化,从而确证该输出背后的逻辑路径 31。

5.2 水印、指纹与起源标准

在数字作品权属纠纷中,识别内容是否由特定模型生成是核心诉求。目前的研究聚焦于:

• 统计水印(Statistical Watermarking): 在模型推理阶段,通过微调Token生成的Logit概率分布,嵌入隐形的统计偏差 29。 • MetaSeal 框架: 利用可逆神经网络将加密的元数据嵌入图像特征空间,既保证了生成质量,又提供了极高的防篡改性 30。 • C2PA 标准: 通过内容凭证(Content Credentials)记录内容的创作、编辑和分发全过程,建立端到端的证据链 30。

第六章 法律专家视角:AI证据的可采性与合规性

法律专家关注的是AI系统取证结果如何通过司法审判的考验。这不仅涉及技术准确性,还涉及法律的正当程序 3。

6.1 全球监管趋势:欧盟 AI Act 的示范效应

《欧盟人工智能法案》确立了基于风险的分类监管体系。其对高风险AI系统提出的“自动化审计日志”要求,实际上是强制性地在AI系统中内置了取证接口 2。

| 透明度要求(Art. 52) | ||

| 记录保留(Art. 12) | ||

| 人类监督(Art. 14) | ||

| 可解释性(Recital 38) |

6.2 美国的证据规则演进:拟议的 Rule 707

美国联邦证据规则咨询委员会提出的 Rule 707 试图将机器生成的证据与传统的专家证言对标 15。其核心观点是:如果一方当事人在没有专家作证的情况下提供机器生成的结果,且该结果如果由人类做出则属于专家意见,那么该机器结果必须满足 Rule 702 的科学可靠性标准 37。这意味着法院必须审查算法的训练数据是否充分、方法是否可靠、应用是否准确 36。

第七章 结语:构建信任的法证基石

对人工智能系统的取证已不仅仅是数字证据的收集,而是一场关于算法公正、数据完整性与人类可控性的多学科博弈 1。网络安全专家提供的防御性审计、人工智能专家开发的可解释性工具以及法律专家制定的准入标准,共同构成了AI时代法治的基石。

尽管机器学习的统计特性与机器生成数据的介入为评估带来了前所未有的复杂性,但通过神经元归因、数据起源追踪以及日益完善的全球法律框架,我们正在逐步建立起一套能够应对黑盒挑战的取证体系 13。未来的研究必须持续关注“模型塌缩”这一潜伏在数据深处的幽灵,确保在人工智能系统日益主宰决策的明天,真相与正义依然能够通过严谨的法证分析得以显现。

Works cited

1. AI Forensics e-bok av Joseph C. Sremack – EPUB | Rakuten Kobo Sverige, accessed February 23, 2026, https://www.kobo.com/se/sv/ebook/ai-forensics 2. EU Artificial Intelligence Act | Up-to-date developments and analyses of the EU AI Act, accessed February 23, 2026, https://artificialintelligenceact.eu/ 3. AI Forensics vs. Traditional Digital Forensics: Examining AI Systems in Litigation | myLawCLE, accessed February 23, 2026, https://mylawcle.com/products/ai-forensics-vs-traditional-digital-forensics-examining-ai-systems-in-litigation/ 4. The Role of Explainable AI (XAI) in Forensic Investigations | Scilit, accessed February 23, 2026, https://www.scilit.com/publications/bd3d158a012bc905b860d3f598c01187 5. Artificial Intelligence and the Transformation of Digital Forensic ..., accessed February 23, 2026, https://medium.com/@tedislava.vasileva/artificial-intelligence-and-the-transformation-of-digital-forensic-investigations-732ee28c7653 6. From Black Boxes to Glass Boxes: Explainable AI for Trustworthy Deepfake Forensics, accessed February 23, 2026, https://www.mdpi.com/2410-387X/9/4/61 7. WHAT IS AND WHAT IS NOT 1 DIGITAL FORENSICS, AI, AND CONCERNS - Paraben Corporation, accessed February 23, 2026, https://paraben.com/wp-content/uploads/2025/06/White-Paper_Digital-forensics-AI-and-Concerns-What-is-and-What-is-not.pdf 8. Essential Digital Evidence Management System Features, accessed February 23, 2026, https://digitalevidence.ai/blog/essential-digital-evidence-management-system-features 9. A Comparative Analysis of Traditional Computer Forensic Tools and Cloud Forensic Tools - TIJER.org, accessed February 23, 2026, https://tijer.org/tijer/papers/TIJER2301009.pdf 10. AI's mysterious 'black box' problem, explained | University of Michigan-Dearborn, accessed February 23, 2026, https://umdearborn.edu/news/ais-mysterious-black-box-problem-explained 11. Explainable AI in High- Stakes Forensic Decision- Making - IGI Global, accessed February 23, 2026, https://www.igi-global.com/viewtitle.aspx?TitleId=388843&isxn=9798337365367 12. What Is Black Box AI and How Does It Work? - IBM, accessed February 23, 2026, https://www.ibm.com/think/topics/black-box-ai 13. Interpretable algorithmic forensics | PNAS, accessed February 23, 2026, https://www.pnas.org/doi/10.1073/pnas.2301842120 14. The Benefits and Challenges of Artificial Intelligence in Digital Forensics for Cloud Environments - Old Dominion University WordPress, accessed February 23, 2026, https://sites.wp.odu.edu/jasmyn-wilhelm/wp-content/uploads/sites/33811/2024/08/Research-Paper.pdf 15. Proposed New Federal Rule Regarding AI-Generated Evidence - Meyers | Nave, accessed February 23, 2026, https://www.meyersnave.com/proposed-new-federal-rule-regarding-ai-generated-evidence/ 16. Generative AI as Courtroom Evidence: A Practical Guide - Mitchell Hamline Open Access, accessed February 23, 2026, https://open.mitchellhamline.edu/cgi/viewcontent.cgi?article=1380&context=mhlr 17. Explainable AI for Digital Forensics: Ensuring Transparency in Legal Evidence Analysis, accessed February 23, 2026, https://www.forensicscijournal.com/index.php/jfsr/article/view/jfsr-aid1089 18. Explainable AI for forensic speech authentication within cognitive and computational neuroscience - Frontiers, accessed February 23, 2026, https://www.frontiersin.org/journals/neuroscience/articles/10.3389/fnins.2025.1692122/full 19. Deepfakes in Court: How Judges Can Proactively Manage Alleged AI-Generated Material in National Security Cases, accessed February 23, 2026, https://legal-forum.uchicago.edu/print-archive/deepfakes-court-how-judges-can-proactively-manage-alleged-ai-generated-material 20. What is Data Poisoning? AI Impact, Examples and Best Defenses - Ncontracts, accessed February 23, 2026, https://www.ncontracts.com/nsight-blog/data-poisoning 21. What is Data Poisoning? Types & Best Practices - SentinelOne, accessed February 23, 2026, https://www.sentinelone.com/cybersecurity-101/cybersecurity/data-poisoning/ 22. What Is Data Poisoning? - IBM, accessed February 23, 2026, https://www.ibm.com/think/topics/data-poisoning 23. AI Data Poisoning: Attacks, Risks & Defense - WitnessAI, accessed February 23, 2026, https://witness.ai/blog/ai-data-poisoning/ 24. Data Poisoning: Current Trends and Recommended Defense Strategies - Wiz, accessed February 23, 2026, https://www.wiz.io/academy/ai-security/data-poisoning 25. AI Model Collapse: Causes and Prevention - WitnessAI, accessed February 23, 2026, https://witness.ai/blog/ai-model-collapse/ 26. Model Collapse and the Right to Uncontaminated Human ..., accessed February 23, 2026, https://jolt.law.harvard.edu/digest/model-collapse-and-the-right-to-uncontaminated-human-generated-data 27. What Is Model Collapse? - IBM, accessed February 23, 2026, https://www.ibm.com/think/topics/model-collapse 28. AI models collapse when trained on recursively generated data - PMC, accessed February 23, 2026, https://pmc.ncbi.nlm.nih.gov/articles/PMC11269175/ 29. Watermarking Fine-Tuning Datasets for Robust Provenance - MDPI, accessed February 23, 2026, https://www.mdpi.com/2076-3417/15/19/10457 30. AI Watermarking & Provenance Standards - Emergent Mind, accessed February 23, 2026, https://www.emergentmind.com/topics/ai-watermarking-and-provenance-standards 31. Neuron-Level Knowledge Attribution in Large ... - ACL Anthology, accessed February 23, 2026, https://aclanthology.org/2024.emnlp-main.191.pdf 32. Towards Neuron Attributions in Multi-Modal Large Language Models - OpenReview, accessed February 23, 2026, https://openreview.net/forum?id=jMJVFP4BH6&referrer=%5Bthe%20profile%20of%20Junfeng%20Fang%5D(%2Fprofile%3Fid%3D~Junfeng_Fang1) 33. Detecting AI fingerprints: A guide to watermarking and beyond - Brookings Institution, accessed February 23, 2026, https://www.brookings.edu/articles/detecting-ai-fingerprints-a-guide-to-watermarking-and-beyond/ 34. AI Act | Shaping Europe's digital future, accessed February 23, 2026, https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai 35. Audit Trail Requirements for High-Risk AI Systems - Scrut, accessed February 23, 2026, https://www.scrut.io/glossary/audit-trail-for-ai-systems 36. U.S. Judicial Conference considers new rule on AI-generated evidence – ICLR, accessed February 23, 2026, https://iclr.net/news/u-s-judicial-conference-considers-new-rule-on-ai-generated-evidence/ 37. Adapting the Rules of Evidence for the Age of AI, accessed February 23, 2026, https://www.quinnemanuel.com/the-firm/publications/adapting-the-rules-of-evidence-for-the-age-of-ai/