报告推荐 | 揭秘深度:深度神经网络学习的基本原理 | NeurIPS 2025

本篇报告是NeurIPS 2025的Invited Talk

标题:Demystifying depth: Principles of learning in deep neural networks原始链接:https://slideslive.com/39055728https://neurips.cc/virtual/2025/loc/san-diego/invited-talk/109602日期:20251202

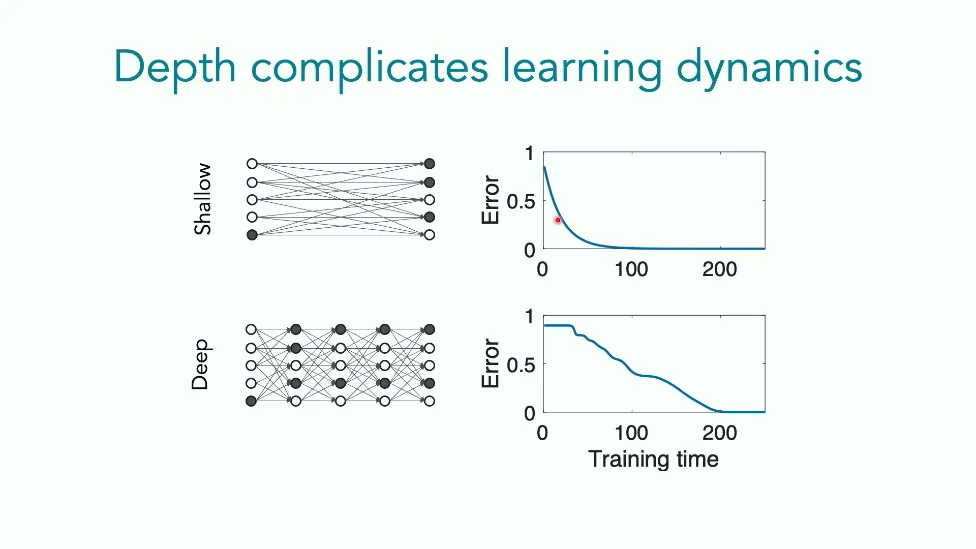

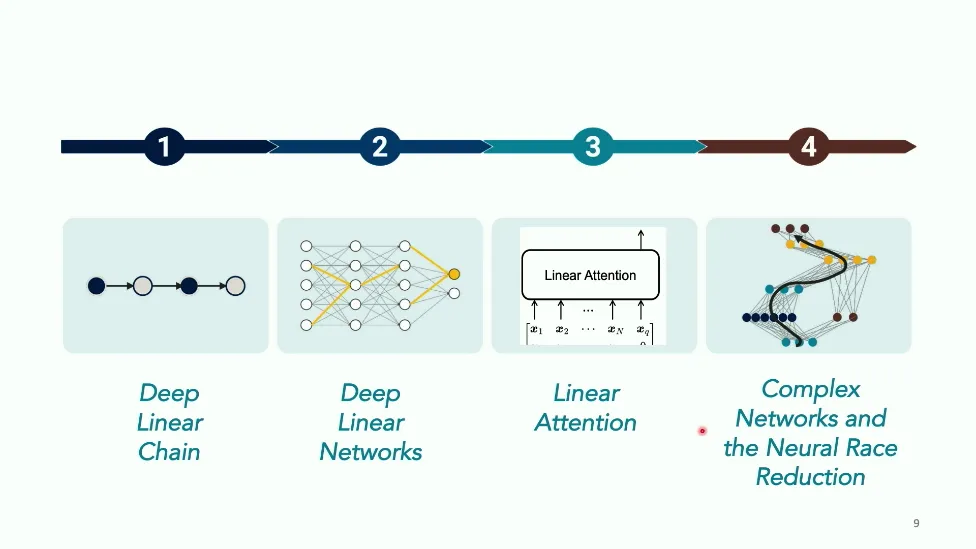

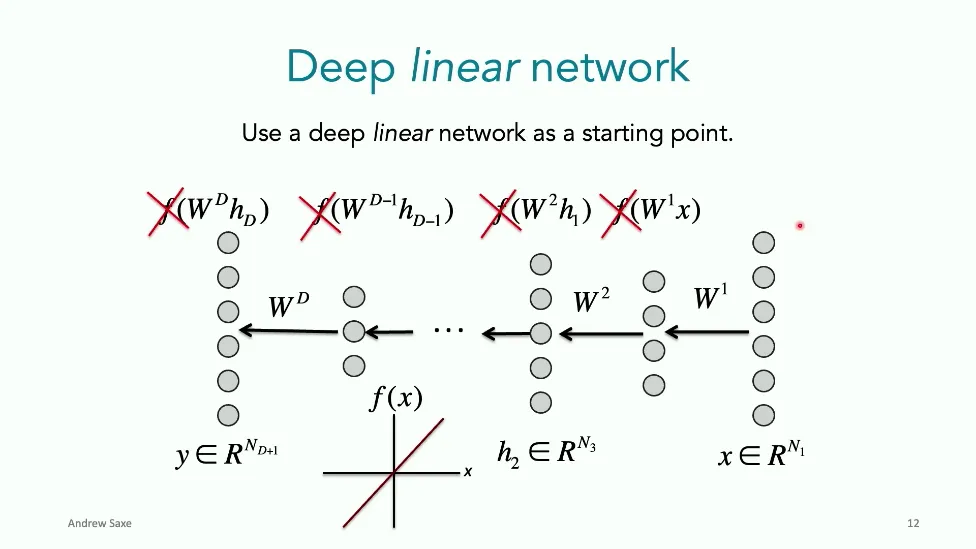

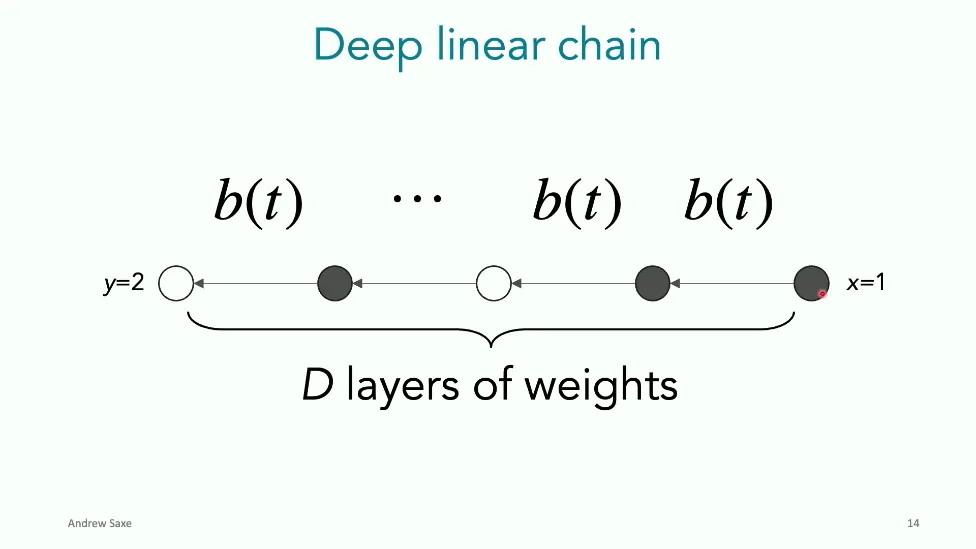

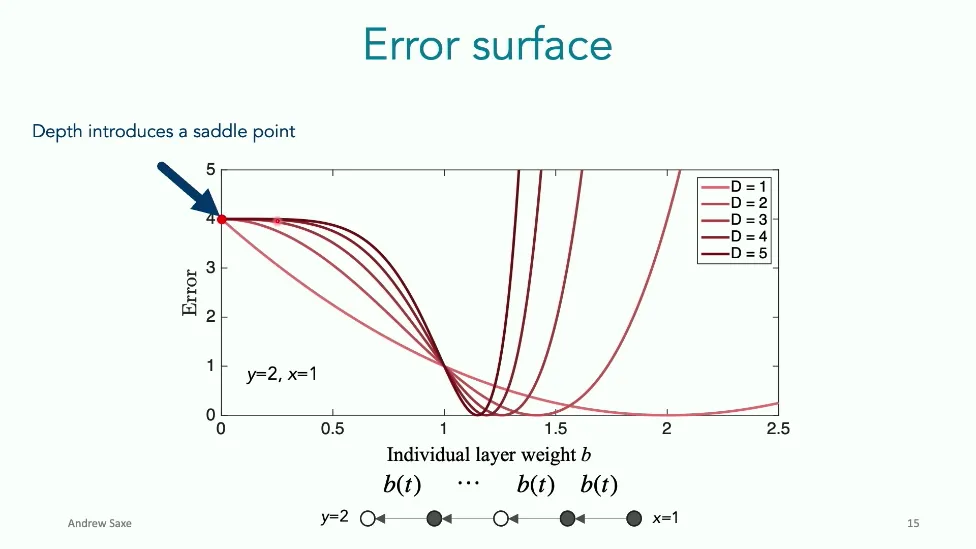

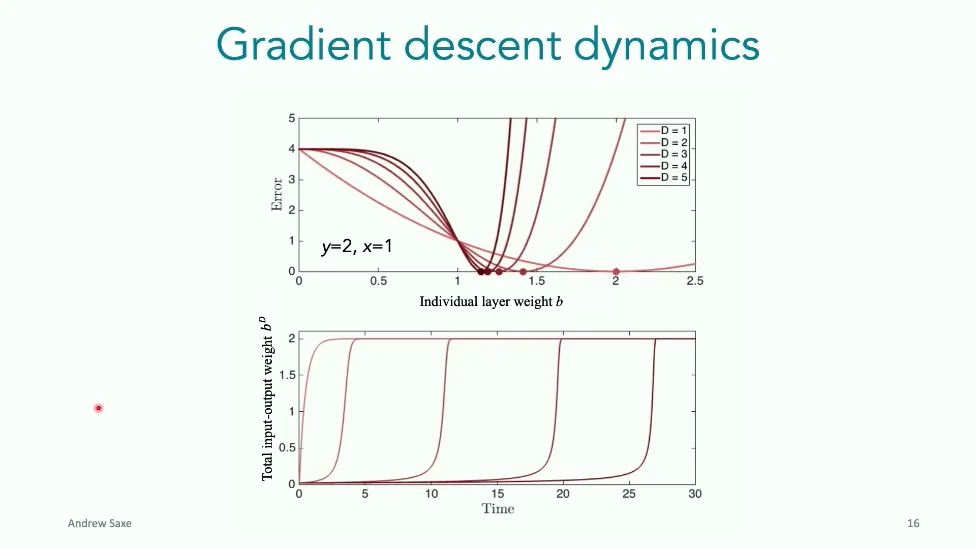

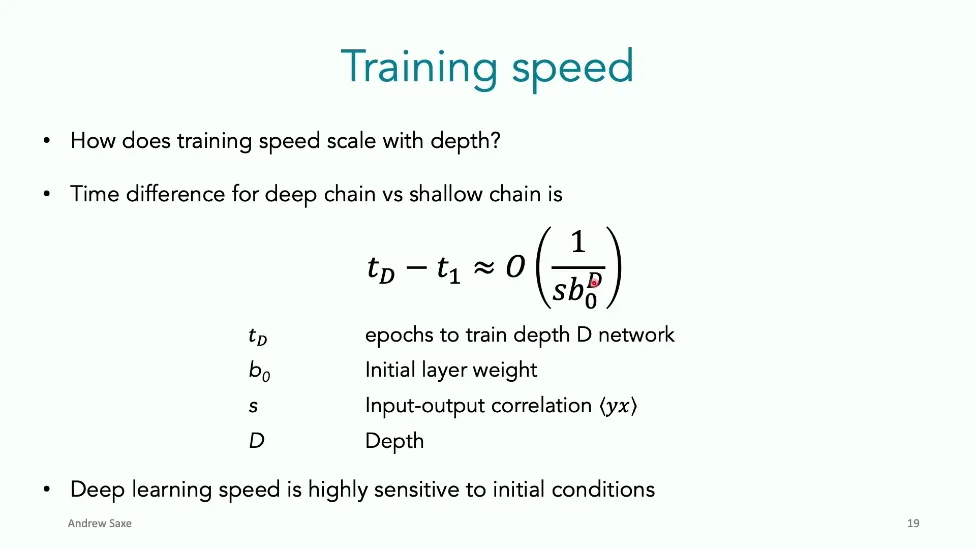

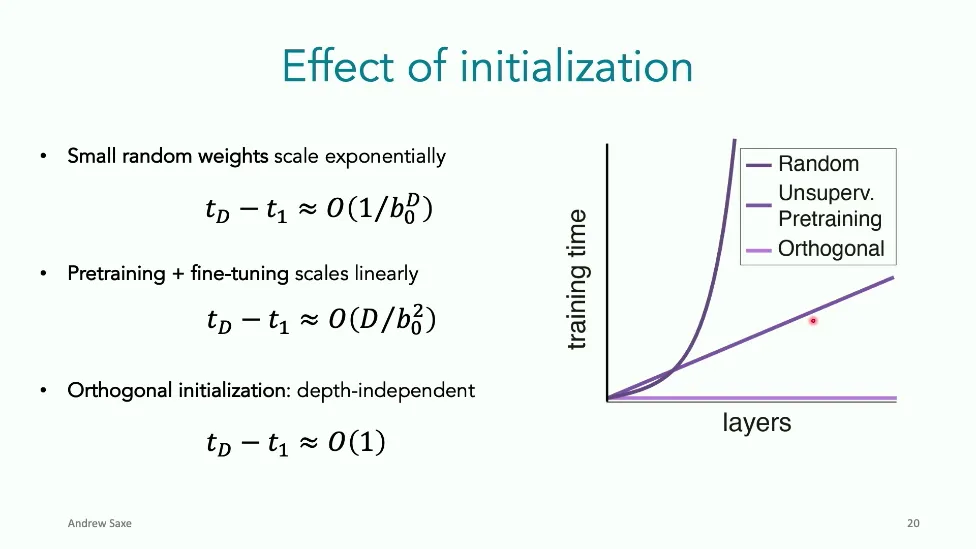

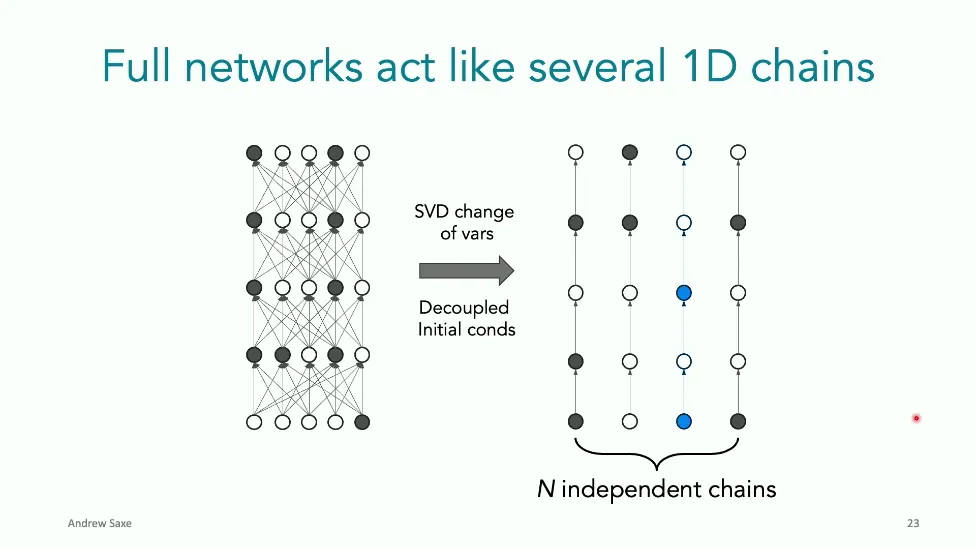

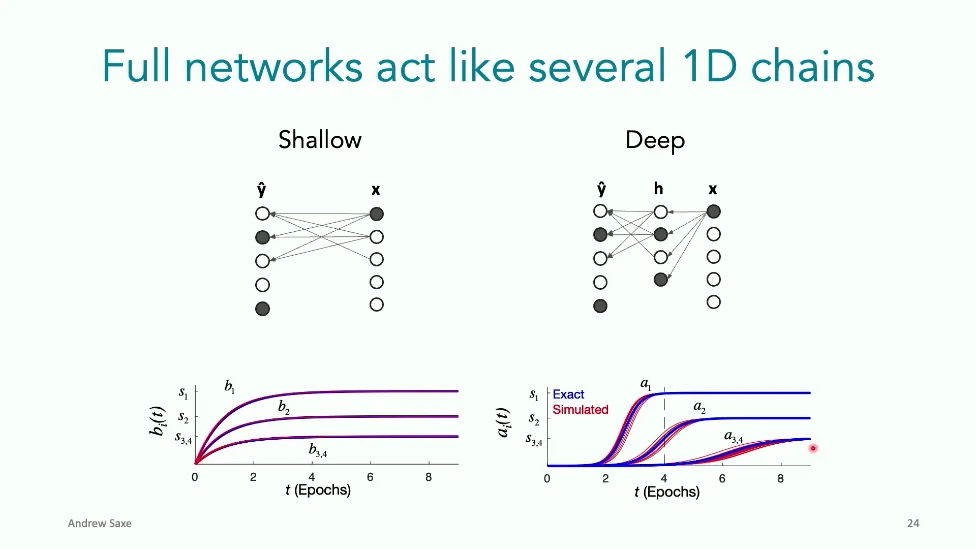

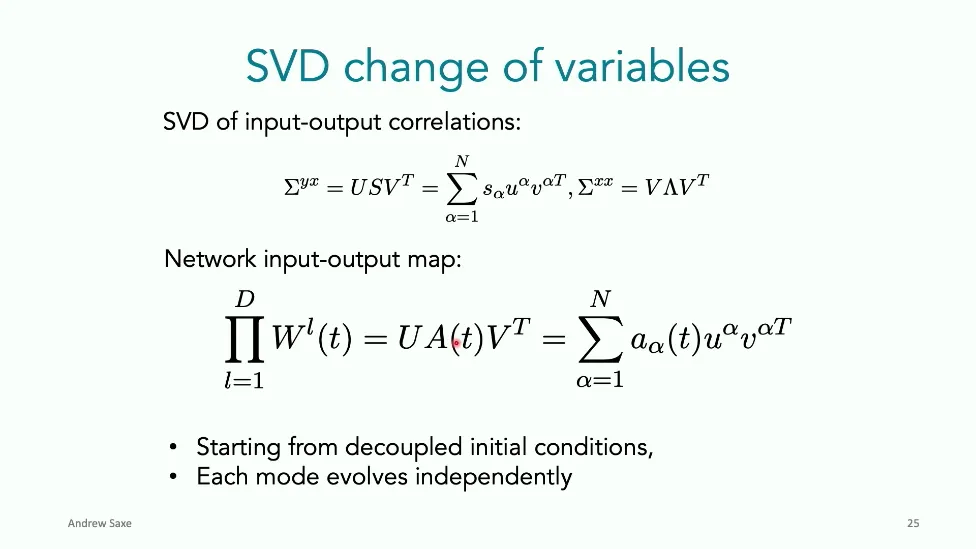

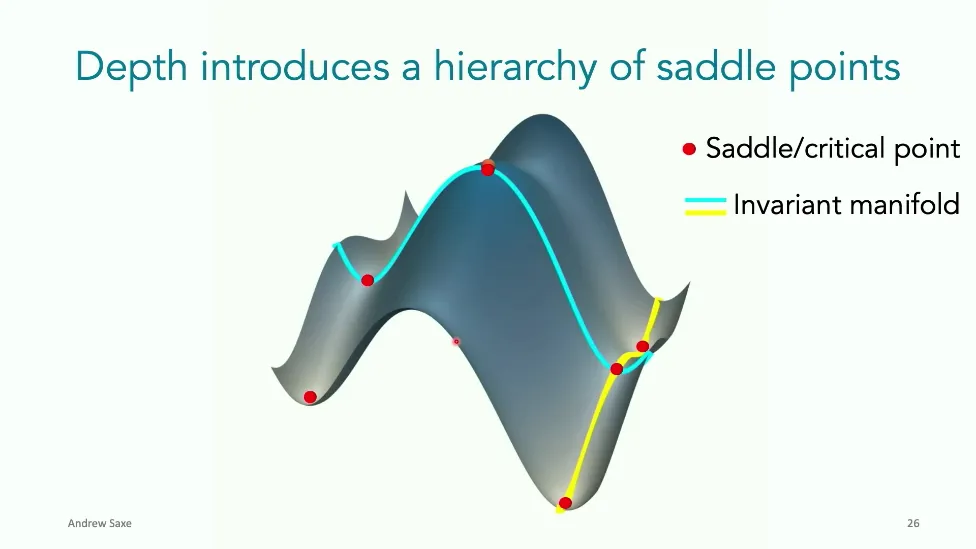

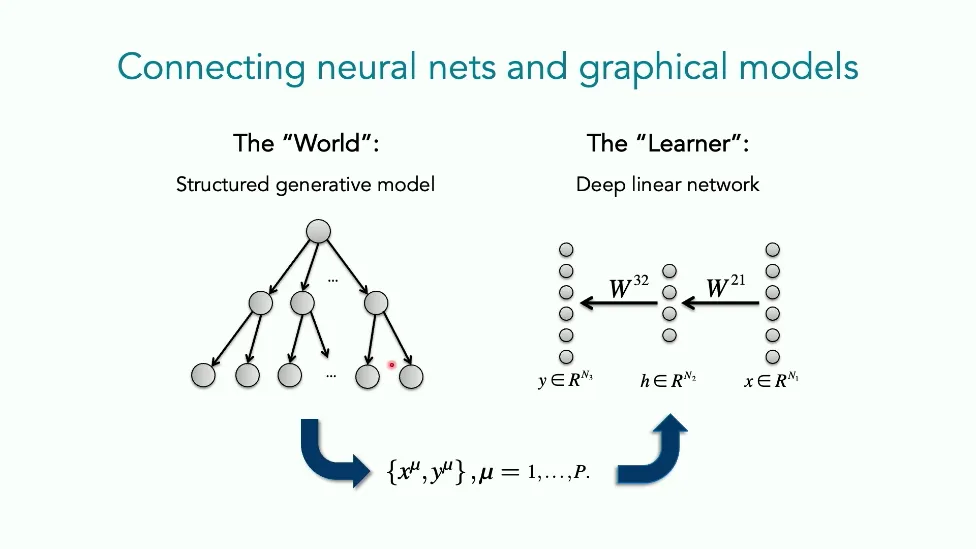

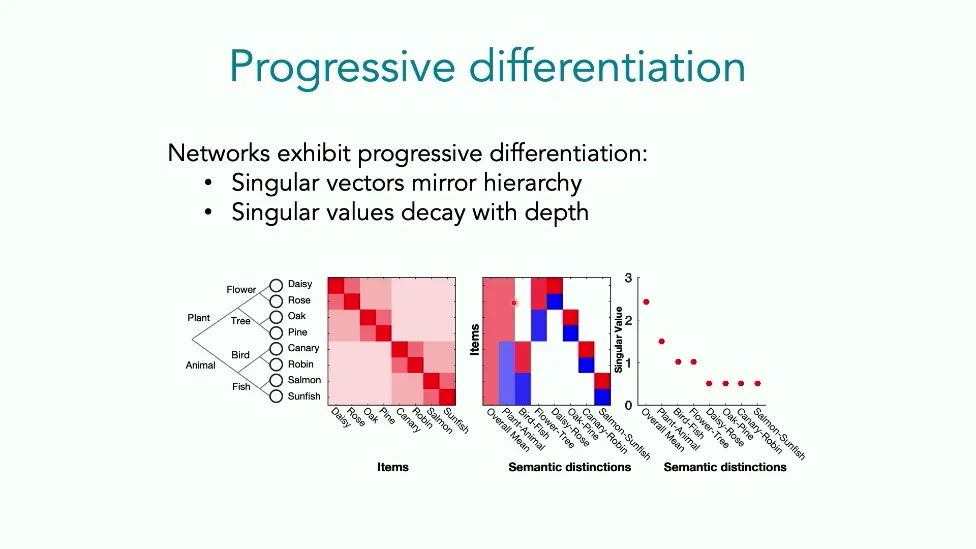

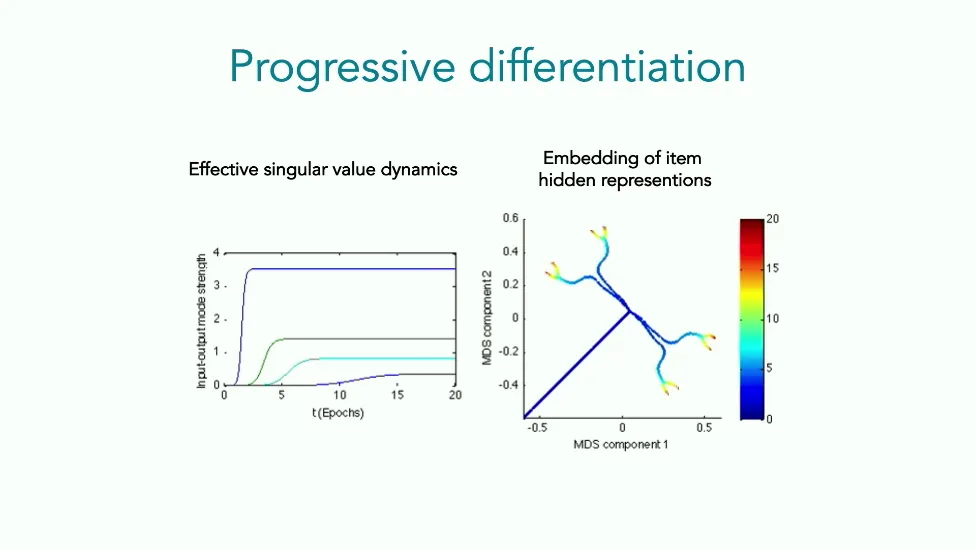

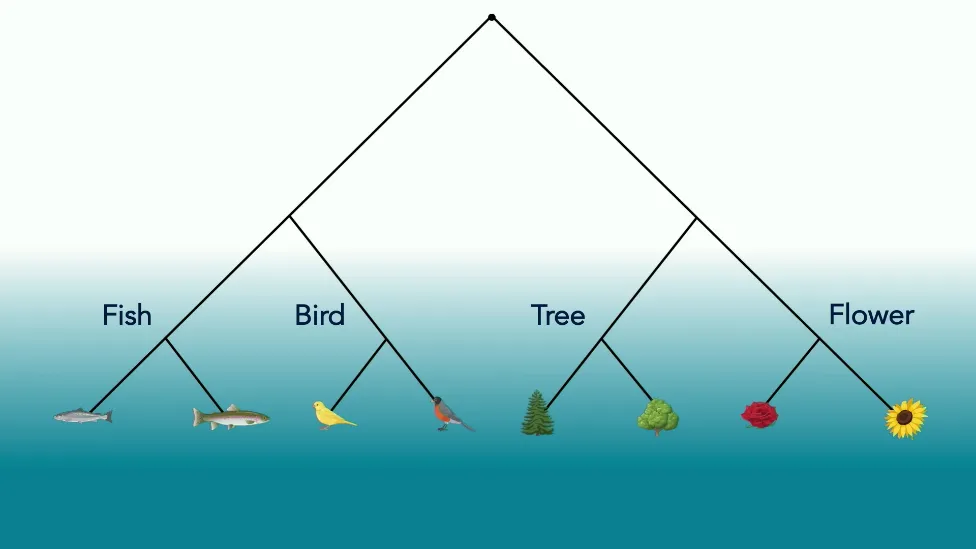

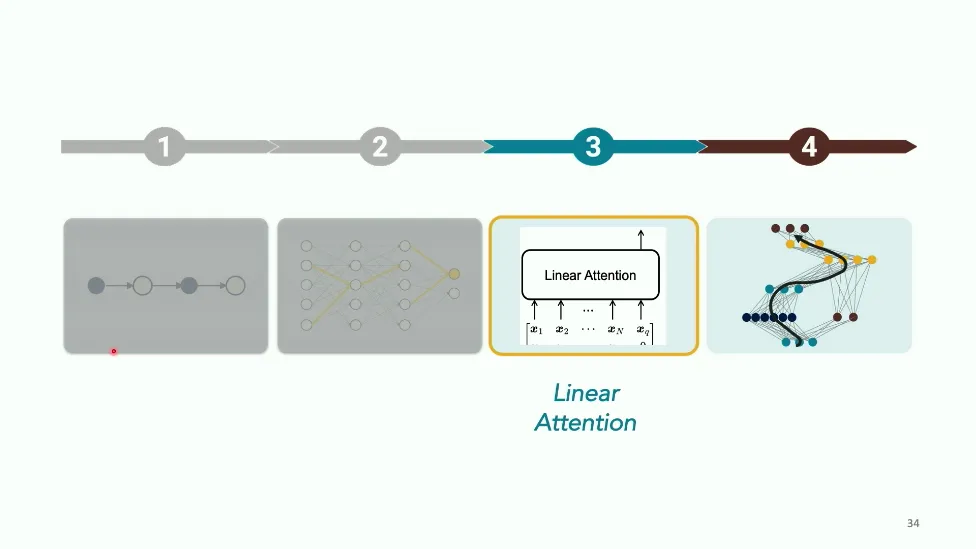

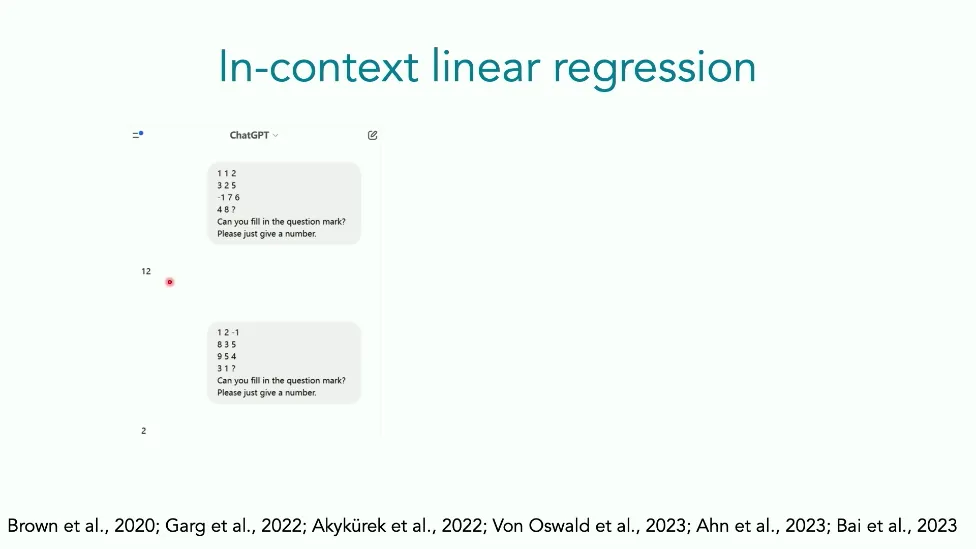

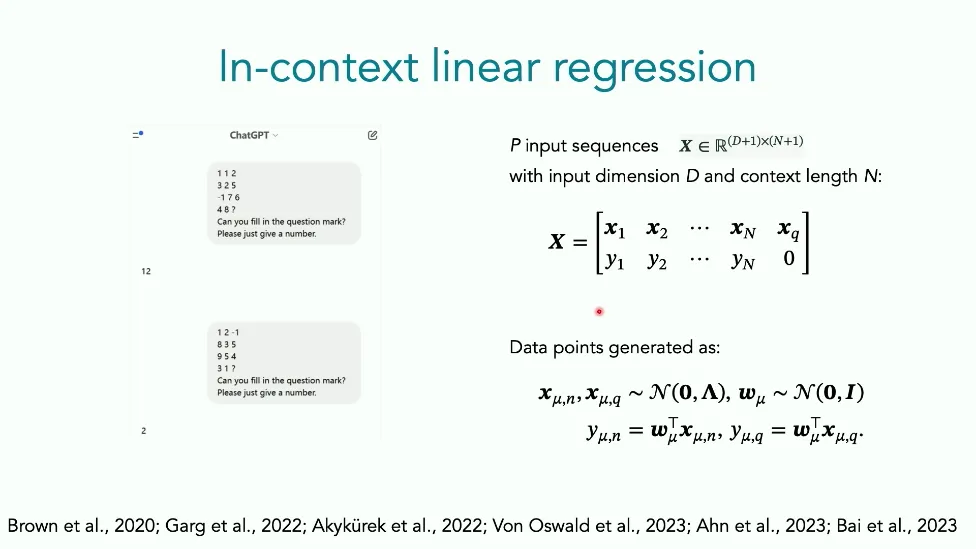

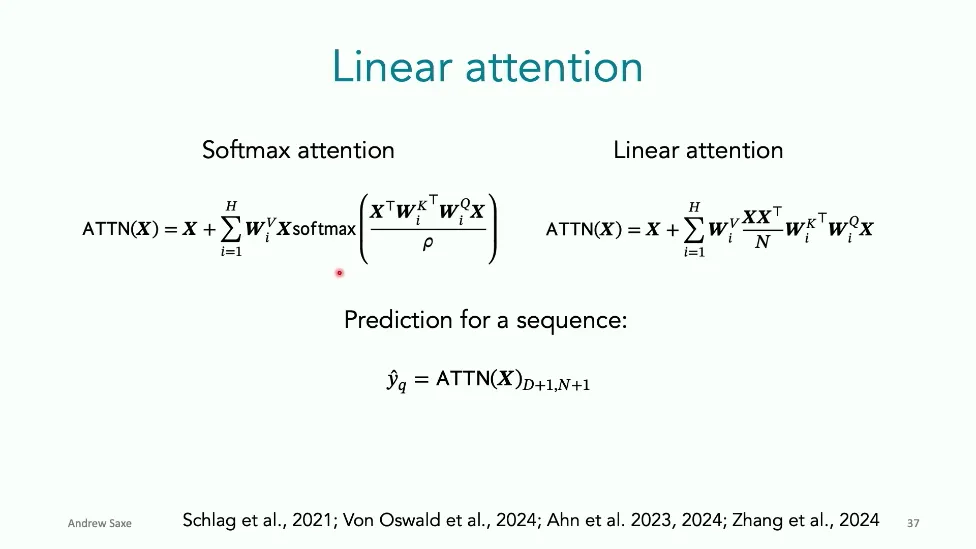

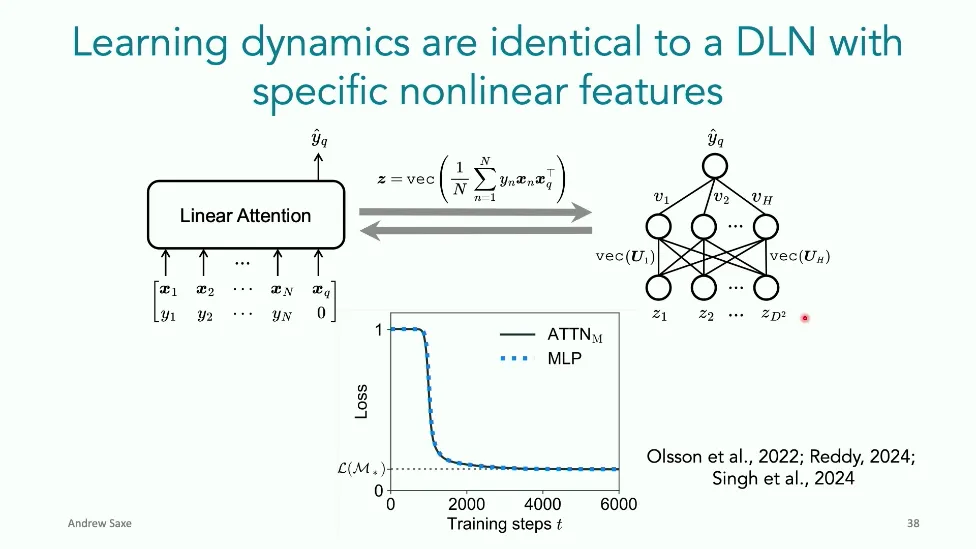

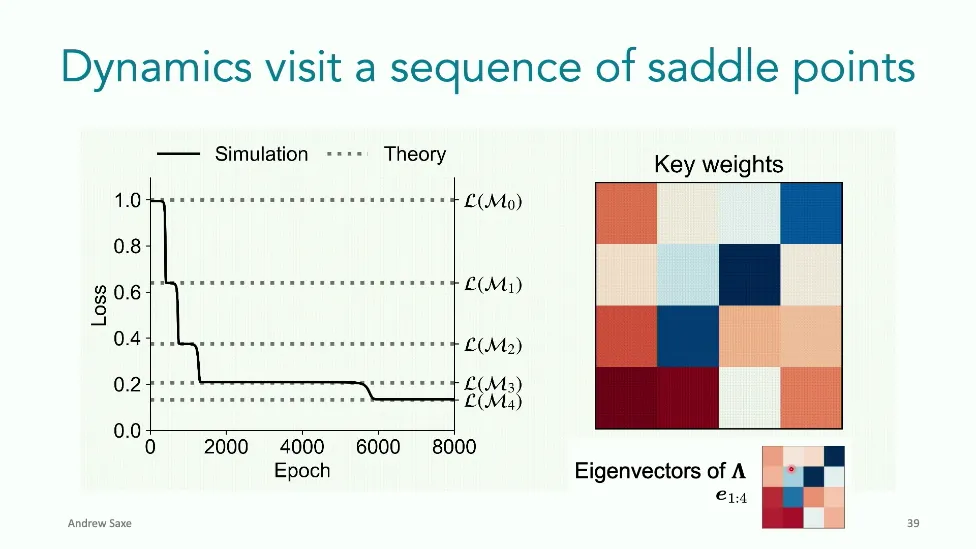

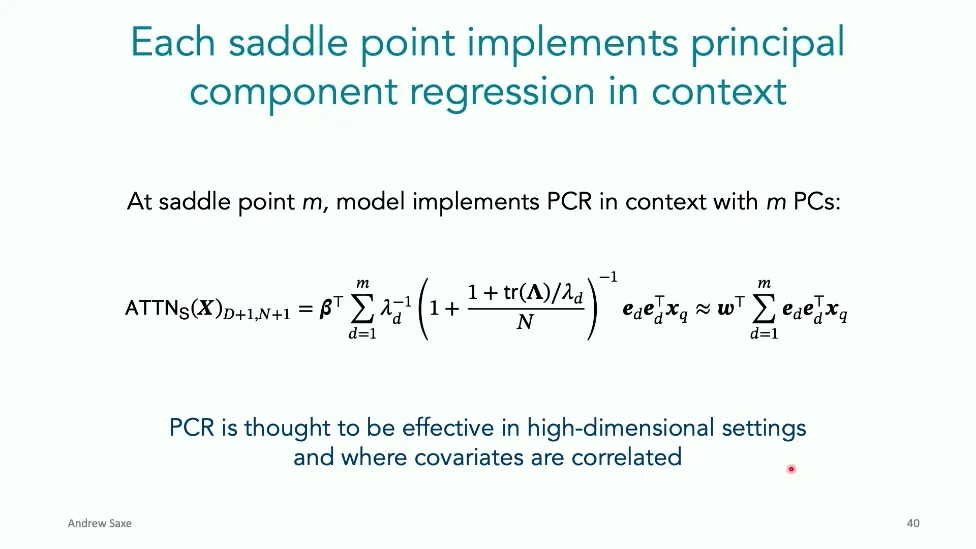

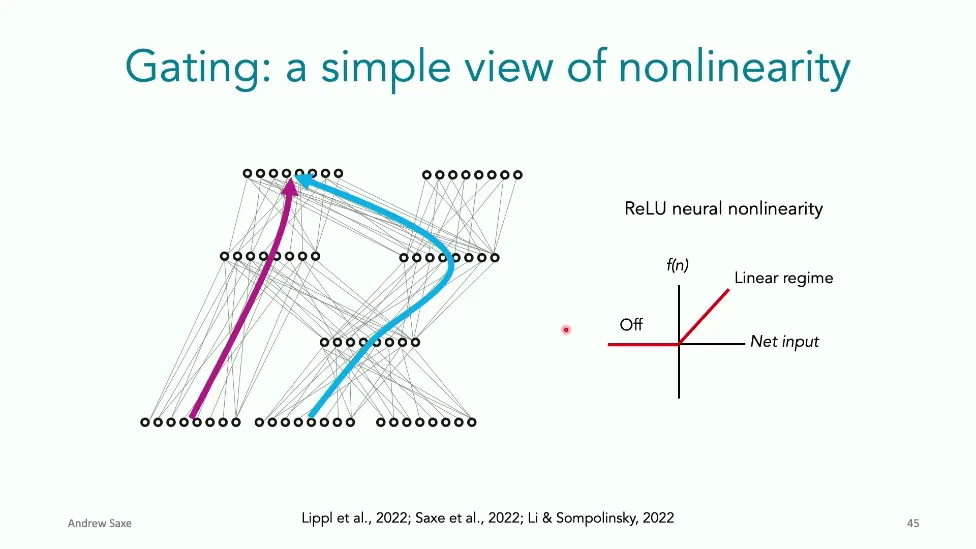

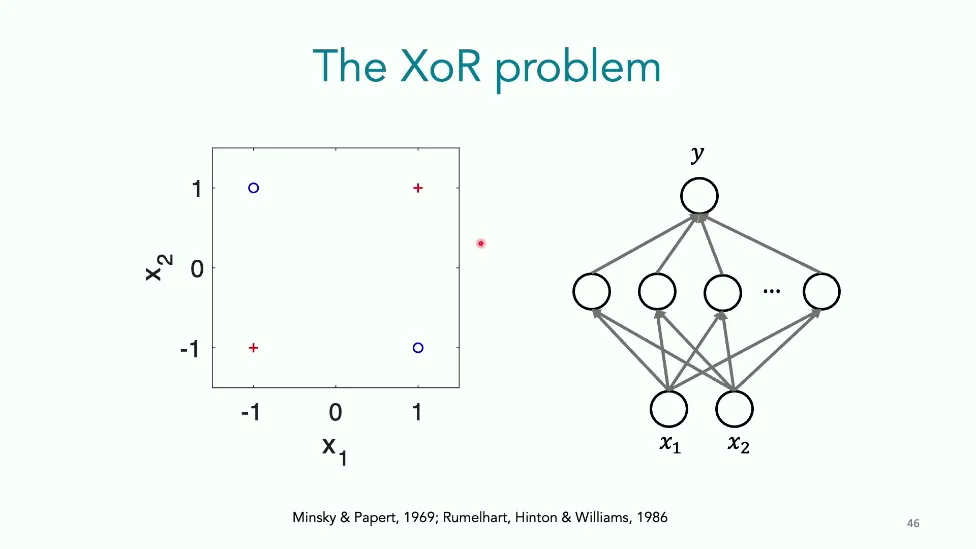

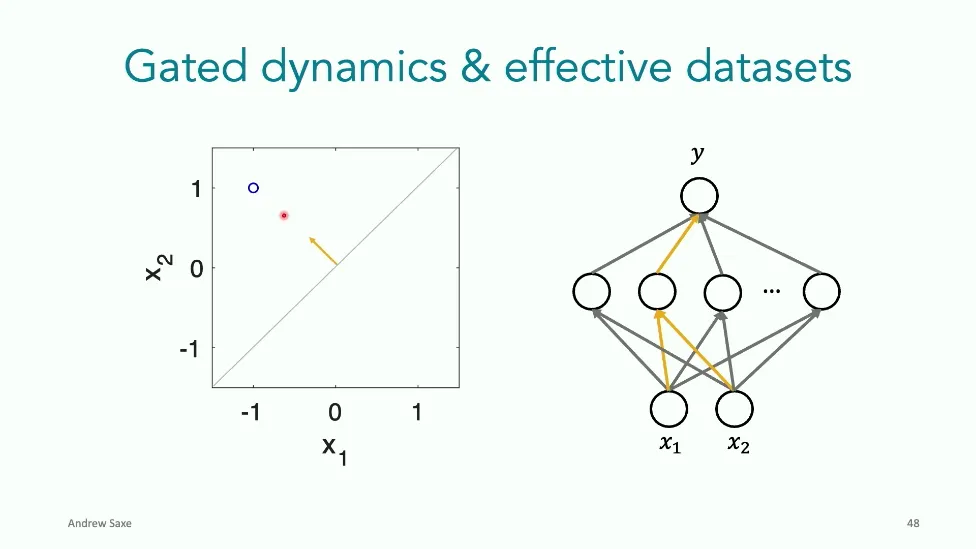

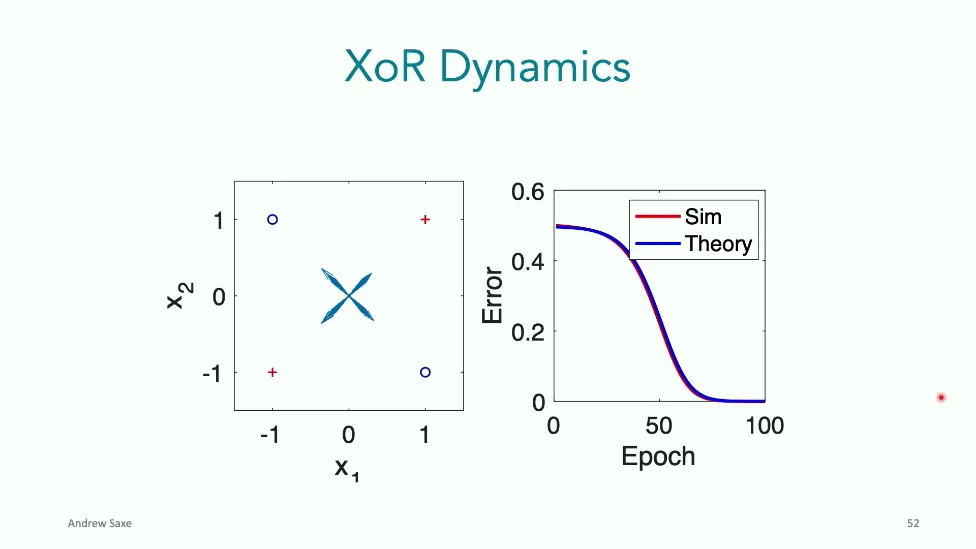

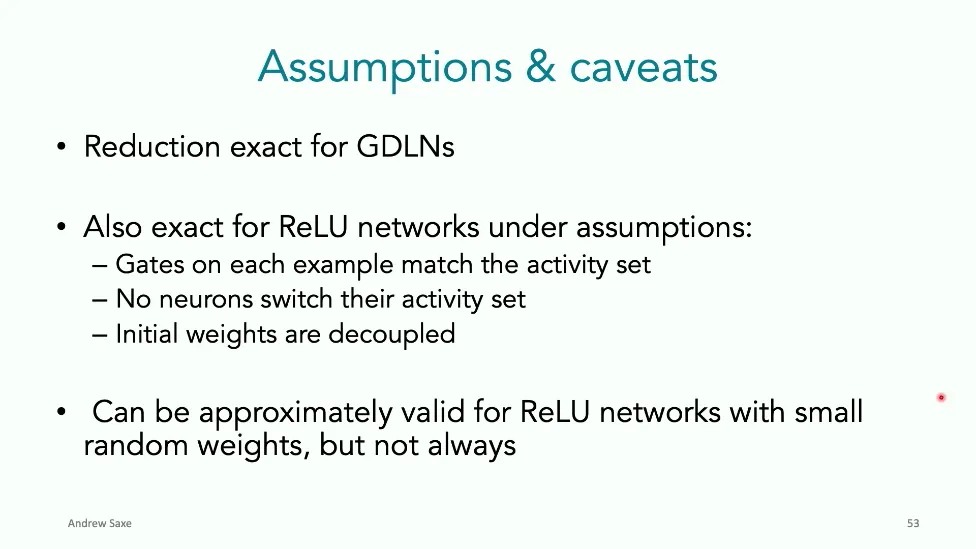

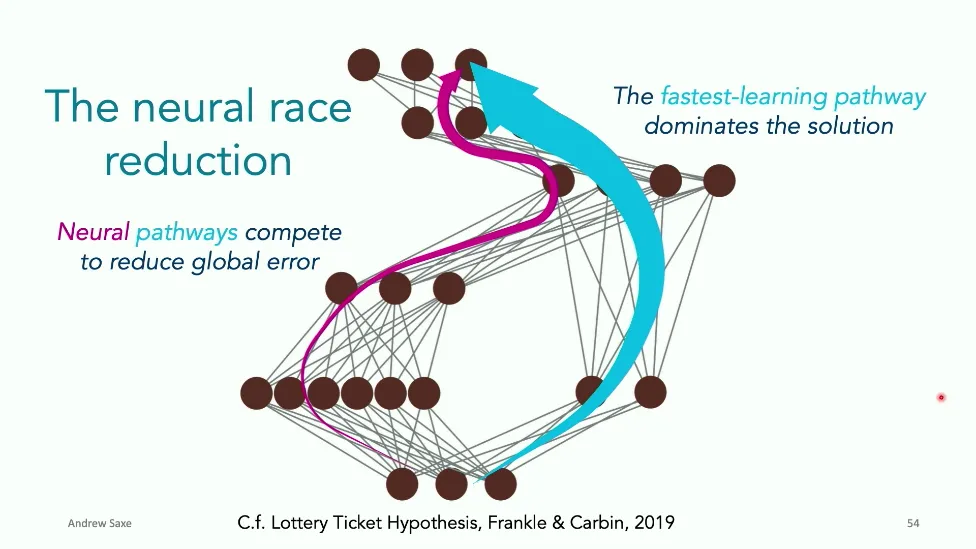

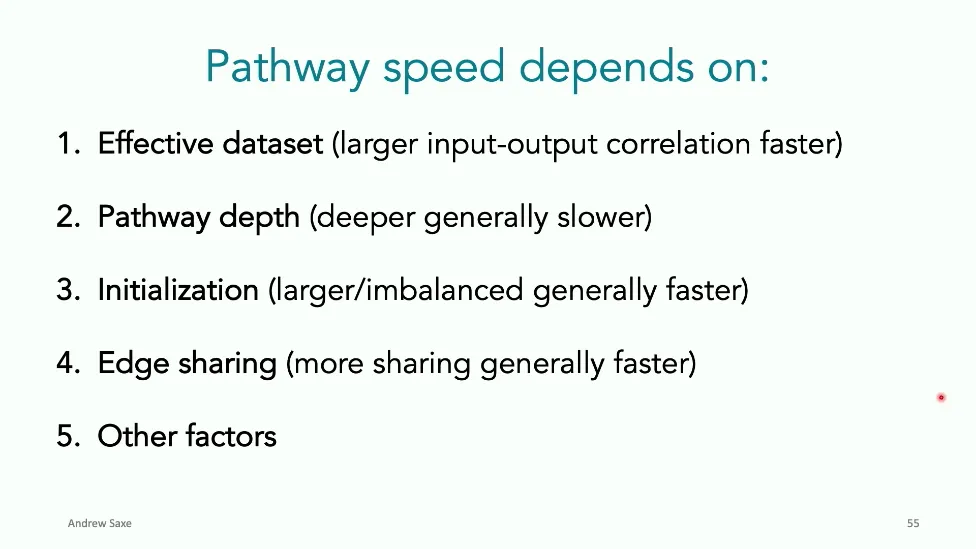

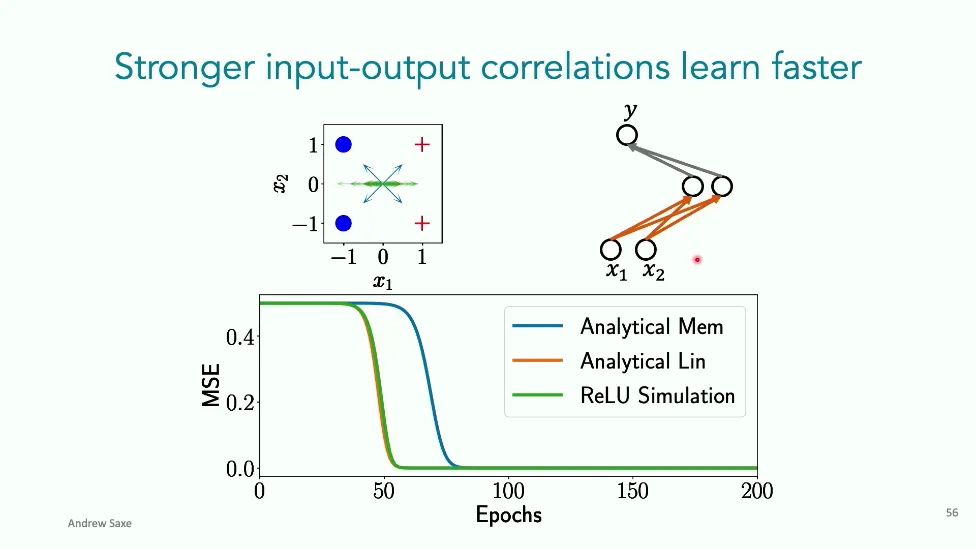

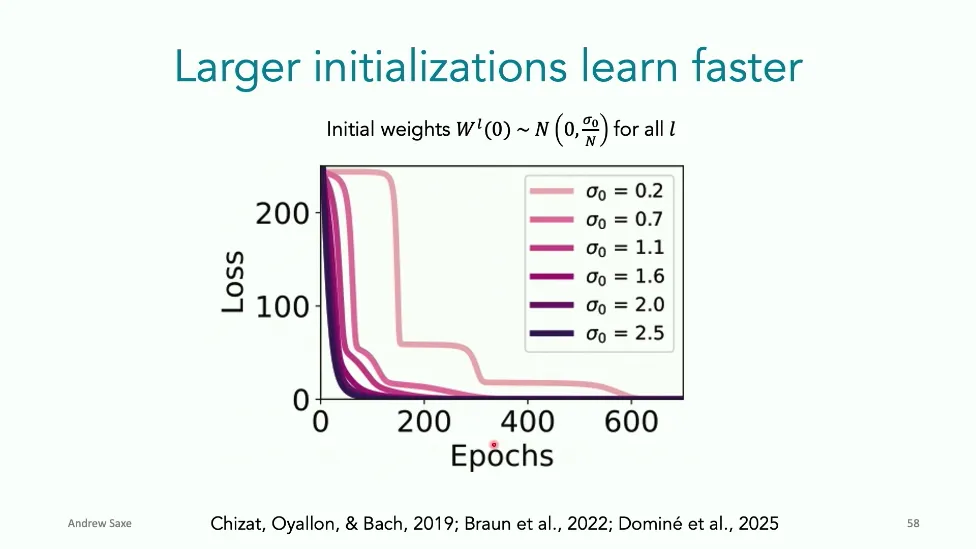

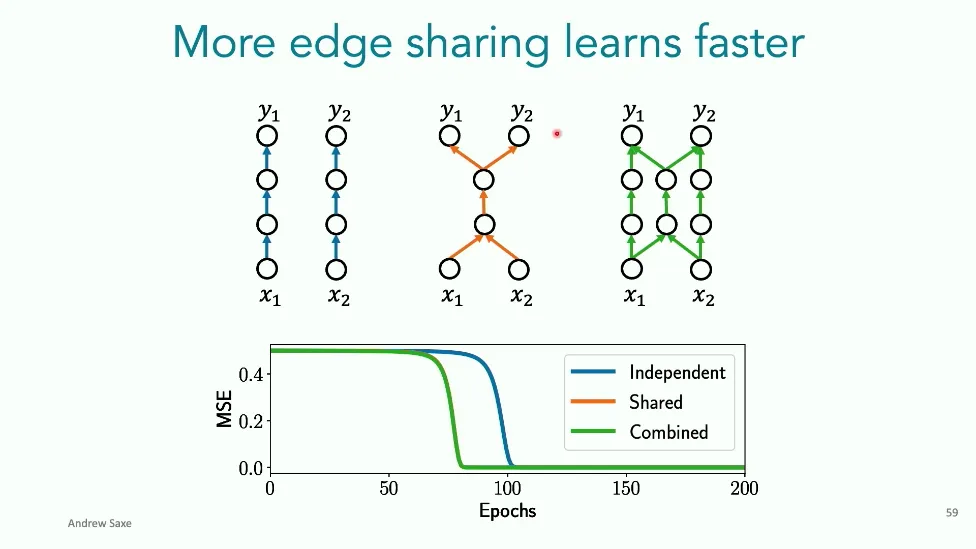

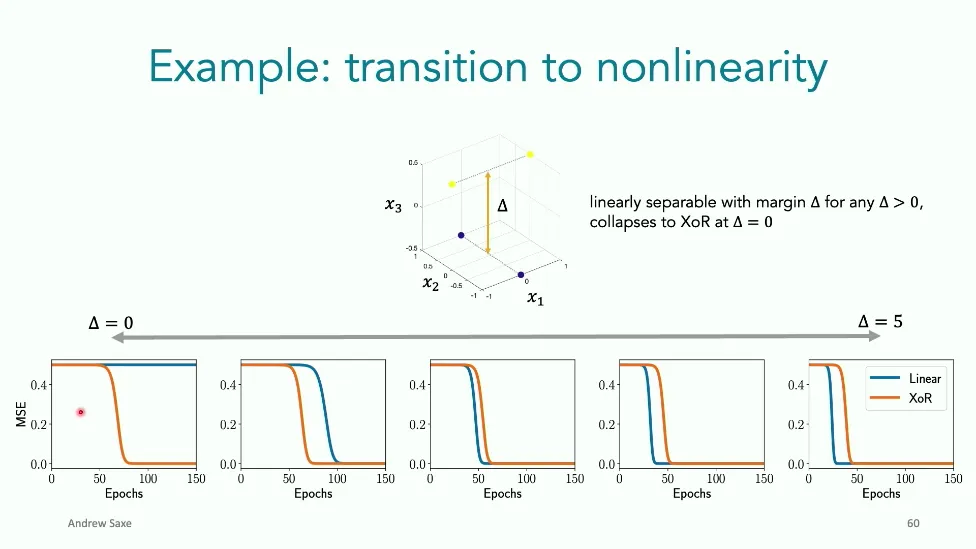

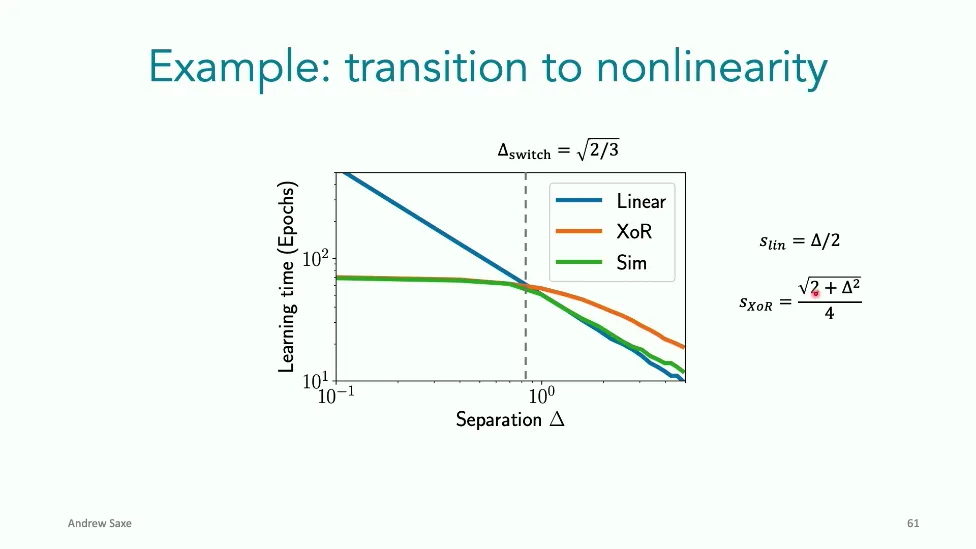

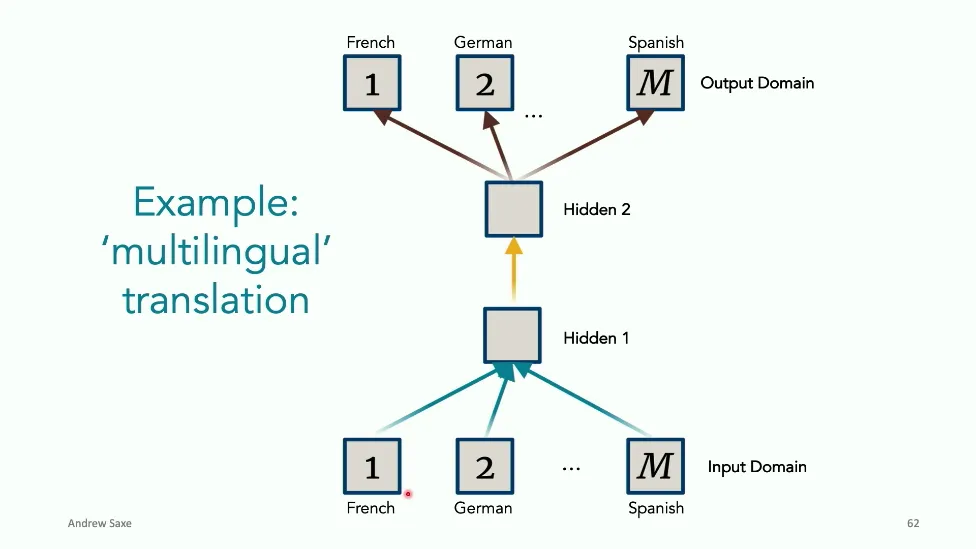

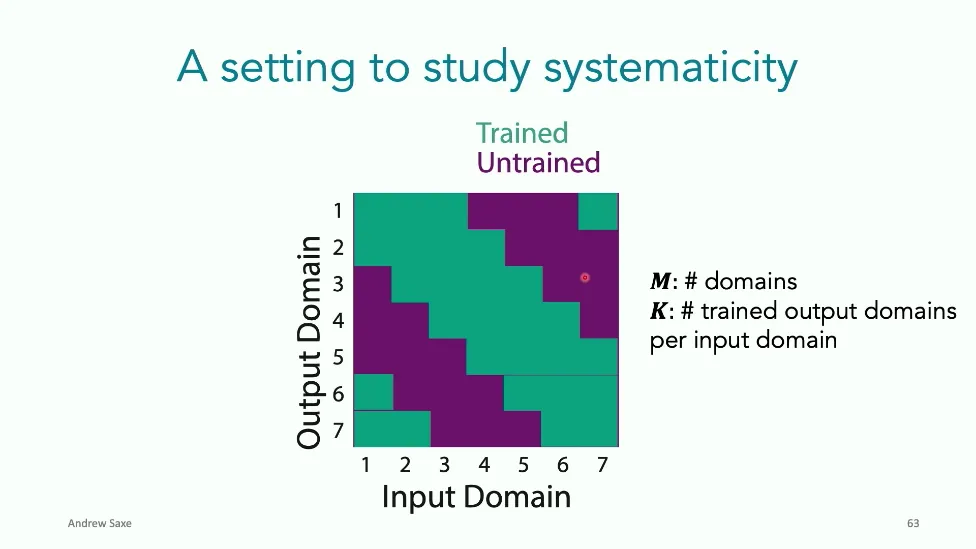

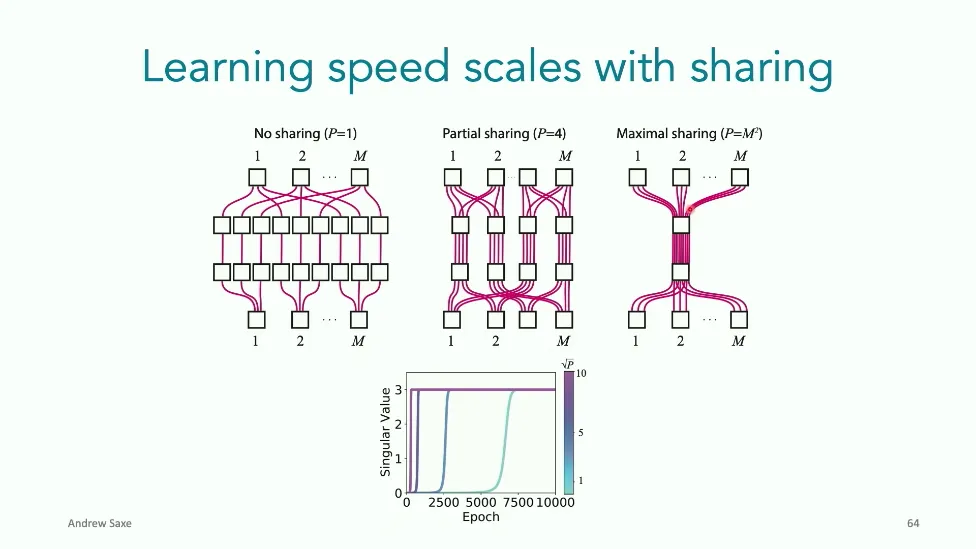

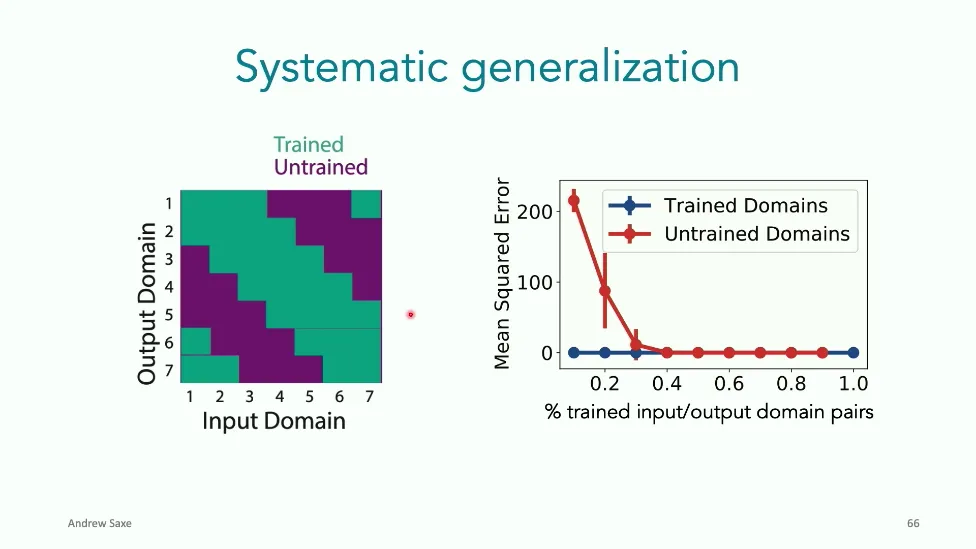

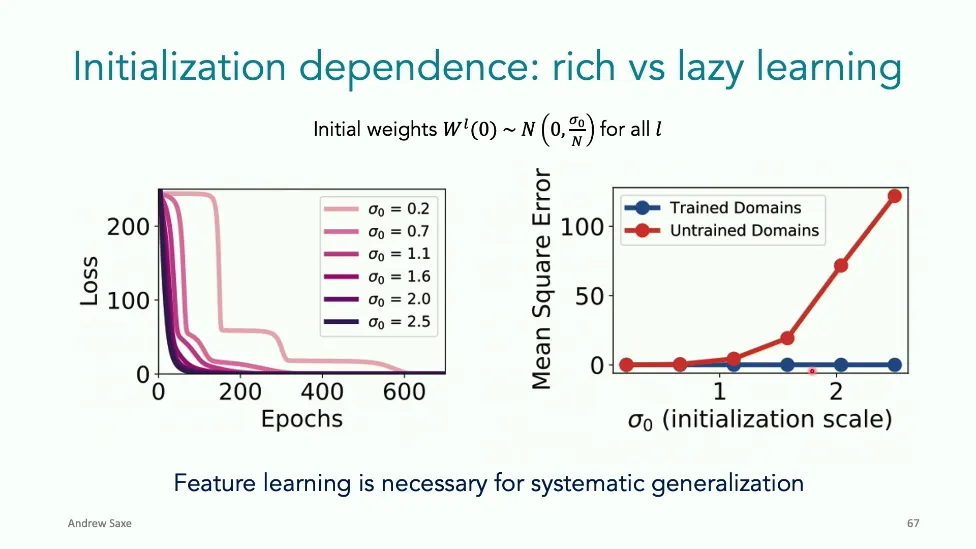

可能对于学术圈和模型层的研究员来说,本文内容并不新鲜,但对于本公众号的读者来说,这篇文章值得我搬运一下。内容中有一些Latex格式目前我还没有低成本的方式进行处理,以及图片也没有做翻译。非常荣幸能在这里进行 Breiman 讲座。如今,人工智能正以前所未有的速度发展。我们现在的系统已经能够识别自动驾驶汽车所需的物体,击败世界顶尖的围棋选手,甚至用自然语言与我们交谈并进行数学推理。尽管这些系统改变了世界,且表现出色,但它们在很大程度上仍是我们难以理解的“黑盒”。如果能理解它们的工作原理,将大有裨益。因此,本次讲座我将介绍我们实验室在探索支配这些系统学习原理方面的工作。为了展示深度网络中令人困惑的特性,这里有一个“深度使学习动力学复杂化”的例子。首先看一个浅层网络,没有隐藏层,只是神经元阵列间的投影。在训练时,你会看到误差沿着一条简单的指数曲线下降。但是,如果我加入一些中间处理层(即增加深度),其他设置保持不变。现在的训练轨迹变得更加错综复杂、非线性,甚至出现了几乎没有提升的“平台期”。这就是深度学习理论要解决的问题。通常当你设计深度网络时,你会选择数据集、架构和算法,然后用大量的算力去“摇动曲柄”(turn a crank),最终得到训练速度或基准性能等结果。而理论的任务——至少我的理解是——要在不进行计算机模拟的情况下,形式化地建立从设计端到结果端的连接。理论界主要有两条路线:一条来自数学和计算机科学,强调最坏情况下的性能保证;另一条来自物理学和理论神经科学,更关注平均情况下的性能和理想化模型。我主要关注后者。如果我们想像物理学那样理解深度网络,就必须转向简化的“替代模型”(surrogate models)。我们需要对这些系统的本质特征进行“漫画式”的概括,并希望保留完整问题的关键特征。这就像盒子里的气体粒子,实际情况极其复杂。但如果你观察施加在墙壁上的压力,这其实是大量气体分子行为的一个“统计摘要”(summary statistic)。我们可以用这种抽象层级来构建理论,这也正是我们理解深度网络所寻找的方法。今天,我将带大家通过一系列简单的理想化模型来探讨这个问题。我们将从极简的“深度线性链”(Deep Linear Chain)开始——这看起来可能简单得令人痛苦,但请稍安勿躁。我们将逐步将其扩展到深度线性网络,进而理解线性注意力机制(Linear Attention)和上下文学习(In-context learning)的某些方面,最后延伸到复杂的非线性网络和神经竞赛(Neural Race)理论。我们先来探讨“深度线性链”。为了引入这个代理模型,我们先看真实情况:这是一个非线性深度网络,包含多层处理单元和层间的加权连接。分析这种网络的主要难点在于神经元的非线性。因此,作为构建简单模型的第一步,我们可以采取一个非常激进的措施:直接剥离所有的非线性。这就是“深度线性神经网络”。对于这个网络,我们可以最小化均方误差损失。然而,一旦存在一个或多个隐藏层,这个最小化问题——也就是我们要解决的终极学习问题——就会变成非凸的(non-convex)。这是一个非凸优化的玩具模型。如果我们计算梯度流动力学,你会发现方程相当复杂,包含权重的三次交互项,且是非线性的。而且数据仅通过输入输出相关性和输入相关矩阵(即数据的二阶统计量)进入方程。我们的目标是理解学习的动力学,解出这些方程。为了简化起见,我们进一步退一步,研究“深度线性链”。如图所示,这个网络只是单神经元层层相连。例如,我们输入值 1,期望输出值 2。进一步假设每一层的初始权重相等(记为 $b$),并保持相等。这样我就可以展示它真实的误差曲面了。这不是示意图,而是真实的计算结果。图中横轴是层权重,纵轴是误差,不同颜色代表不同深度的网络。你可以看到,浅层网络只是一个简单的二次碗状结构;而深层网络形状复杂得多:原点处有一个鞍点(saddle point),紧邻鞍点的是一个平台期(plateau)。虽然没有局部极小值让你“卡住”,但如果从平台期开始,学习会非常缓慢。如果我们从损失曲面上启动一组网络进行训练,可以看到它们的动力学差异:浅层网络呈指数级迅速逼近目标;而深层网络需要更长时间逃离平台期,呈现出 S 形(Sigmoidal)的训练轨迹。这个模型虽然简单,但允许我们解析地求解整体输入-输出映射的动力学,从而回答一个关键问题:训练速度如何随深度变化?从方程中得出的结果是,深层网络与浅层网络的时间差,大致等于数据集输入输出相关性 $S$ 的倒数,乘以初始权重 $b_0$ 的 $D$ 次方。我非常喜欢这个表达式,因为它将关于数据集的属性(输入输出相关性)、关于初始化的属性($b_0$)以及关于网络架构的属性(深度 $D$),与一个涌现属性——学习速度——简洁地联系在了一起。这带来两个关键预测:第一,更强的输入输出相关性会被学得更快;第二,深度学习对初始化高度敏感。想象一下,如果 $b_0$ 很小(比如 0.1),$0.1$ 的 $D$ 次方会非常小,导致速度随深度呈指数级下降。反之,如果 $b_0$ 接近 1,深度网络只比浅层网络慢常数倍。这解释了初始化的效应:小的随机权重会导致随深度指数级变慢;而现代实践中的做法是正确缩放初始化使其足够大,从而获得几乎与深度无关的训练时间。总结来说,深度在损失景观中引入了鞍点,导致动力学在鞍点附近变慢,产生阶梯状的学习轨迹;而学习速度在数量级上取决于统计数据、深度和初始化,这一点我们可以通过该模型进行定量理解。好,我们接着讲深度线性网络。好消息是,当我们回到全连接网络时,它的行为就像是几条并行独立运作的一维链条。所以我刚才关于深度线性链条所讲的一切,都可以直接套用到深度线性网络的理解中。例如,如果我们在特定任务上训练它,可能会看到多条S形轨迹,它们分别来自这些独立的链条,在同一个网络中各自增长,互不干扰。这一事实并不显而易见。要看清这一点,需要基于奇异值分解(SVD)对全连接网络进行特定的变量变换。你取数据集的相关性矩阵,将其分解为三个矩阵的乘积(两个正交矩阵,一个对角矩阵)。本质上,网络正在执行一个随时间变化的奇异值分解,其动力学追踪着有效的奇异值。就像我之前提到的压强总结了大量粒子的集体活动一样,在这里,奇异值总结了许多权重的集体活动。由此产生的定性图景是:在深度线性网络中,深度引入了鞍点的层级结构。梯度下降的动力学过程如果从某个鞍点附近开始,会依次越过一系列鞍点。在每个鞍点,你学到了一定数量的一维链条,而剩下的还有待后续学习。我想举个简短的例子,通过连接神经网络和概率图模型来展示这种行为。网络如何学习外部的结构化世界?假设世界的结构是一个概率生成模型,比如这里可视化的层级结构。我可以从中抽取数据集传给深度线性网络。重要的是,因为我们有解析解,只要计算生成模型相关性的奇异值分解,就能确切知道网络的行为,而无需进行模拟。在这个层级数据集中,树状结构中相近的项目(如鸟类、植物等自然类别)更可能共享特征。因为这种相关性结构是超度量的(ultrametric),你会得到这种块中套块的结构特征。我们知道其SVD会涉及Haar小波,这完全镜像了树的结构。奇异值对于特定的树结构是层级的递减函数,而学习速度与奇异值成正比,这就告诉我们:网络会从最宽泛的区分开始学习,逐渐过渡到更精细的区分。通过观察训练过程中项目隐藏表示的二维嵌入,你可以看到随着训练进行,它确实是由粗到细地构建这棵树。这种鞍点层级结构的动力学意味着,网络首先会经过一个将所有动物和植物分开的鞍点。当然,这个分析需要许多假设和限制条件。解仅在解耦和平衡的初始化条件下是精确的。但在实践中,对于小的随机权重,这是一个非常好的近似。我们还需要数据集的相关性是可对角化的。总结一下深度线性网络:深度在损失景观中引入了鞍点层级,动力学在每个鞍点附近变慢,导致了分阶段的系统性进展。在层级任务上,这表现为先学习宽泛概念再学习精细概念的有趣动态。但如果我们要解决现实世界的问题,仅靠线性是不够的,因为所有现实世界的问题都需要非线性。我们现在转向现代大语言模型中一个非常重要的现象:上下文学习(In-context Learning)和注意力机制。这是我的学生 Yedi Zhang、Aditya Singh 和同事 Peter Latham 的项目。上下文学习指的是,你可以在不重新训练模型的情况下,通过上下文指令让大语言模型执行新任务。比如这里,我给它一些数字序列作为示例(Prompt),规则分别是相加或相减,模型在看过示例后能准确预测下一个数字。这是让 LLM 具备灵活性的核心能力。为了在理论层面研究这个问题,我们采用了“上下文线性回归”(In-context Linear Regression)的设定。我们构建一个预训练数据集,其中包含许多输入序列。每个位置都有高维输入向量 $x$ 和标签 $y$,其中 $y$ 是通过线性权重向量 $w$ 生成的。关键在于,对于每一个序列,我们都会重新抽取一个随机的回归向量 $w$。这意味着网络无法通过记忆权重来解决问题,它必须学会如何在上下文中推断出当前的 $w$ 并将其应用于查询输入。我们要解决的关键问题是:Transformer 在上下文中到底学会了应用什么算法?为了研究这一点,我们需要简化模型,关注“线性注意力”(Linear Attention)。虽然它去掉了 Softmax 操作,但它仍然通过输入的乘积计算非线性函数,保留了许多核心行为。这个设定有一个令人惊讶的事实:仅仅通过重新排列注意力操作,我们可以让它看起来像是一个在特征 $Z$(而非原始输入 $X$)上操作的“深度线性网络”(Deep Linear Network)。这里的 $Z$ 是一组非常有趣的统计量,它混合了查询、序列输入和标签之间的相关性。基于这种归约(reduction),我们发现其学习动力学表现出与深度线性网络相同的特征:涌现过程呈现出阶梯状(stage-like)的特性。学习动力学会流经一系列鞍点。每一个鞍点都会“细化”出 Key 矩阵的一行,而这一行将与输入协方差矩阵的一个特征向量成比例。这意味着网络是在按顺序一个接一个地学习输入相关性的方向。当我们解析这个解的含义时,得到了一个非常具有可解释性的答案:在每个鞍点处,网络实际上是在上下文中执行“主成分回归”(Principal Component Regression, PCR)。主成分回归是指将数据投影到 $m$ 个主成分上,然后从这些投影系数中学习回归。线性注意力正是这样做的:随着训练时间的增加,它使用的主成分数量也不断增加。这是一种有趣的归纳偏置,因为 PCR 通常被认为在协变量相关的高维设置中非常有效。当然,这个分析建立在许多假设之上。我们使用了理想化的架构(没有 MLP 或位置编码)、特定的初始化方式,以及理想化的线性回归任务。现实中肯定还存在许多其他形式的上下文学习。总结一下,在线性注意力中,上下文学习是分阶段发展的。这些阶段实现了一个可解释的算法——主成分回归。其中主成分是从预训练数据集中识别出来的,这意味着上下文回归实际上是将“预训练时期的统计数据”与“上下文中的统计数据”进行了融合。最后,让我们来探讨复杂网络,即非线性网络。这是我与 Shagun Sodhani, Sam Lewallen, Devon Jarvis 和 Jin Hwa Lee 合作的研究成果。我们将基于此构建“神经竞赛归约”(Neural Race Reduction)这一概念。首先,对于理论家来说,ReLU 神经元其实是个好消息。因为如果一个神经元处于激活状态,它基本上就是线性的;如果它处于关闭状态,它就直接从方程中消失了。利用这个想法,我们来考察通过复杂网络的所有路径。在某条路径上,如果每个神经元都处于激活状态,那么对于特定的训练样本,这条路径的行为就像是一个深度线性网络。相反,在其他路径上,如果有一个或多个神经元不活跃,这条通路在当前样本的计算中就会失效。这给了我们一个直觉:当处于激活状态时,每条通路都像是一个深度线性网络。通过解决这些独立的深度线性网络问题并将它们拼接起来,我们或许就能理解复杂架构的非线性网络在做什么。让我们以机器学习历史上著名的 XOR 问题为例,尝试用 ReLU 网络来解决它。在这个网络中,不同的神经元会针对输入空间的不同区域(即“有效数据集”)进行激活。在一个大型网络中,许多不同的通路将数据集分割成不同的子集。我们可以解决所有这些子问题,并在特定情况下重新组合出解决方案。这种方法效果如何?当我们训练一个标准的 ReLU 网络时,可以看到它的动力学过程(蓝色实线)。如果我们将四个深度线性网络问题的解叠加在上面(红色虚线),你会发现它很好地近似了 ReLU 网络的动力学。这表明,通过将问题分解为若干个针对不同样本开关的线性模型,我们可以理解非线性网络是如何解决任务的。这种归约在某些假设下是精确的,而在 ReLU 网络权重较小等情况下,它通常也是近似有效的。现在回到“神经竞赛”的想法。我们不再寻求精确解,而是接受近似解。在一个非常复杂的网络中,有许多通路,它们都通过试图降低的全局误差相互关联。如果某条通路学习得非常快,它可能会在其他通路还没来得及启动之前就消除了误差。这就对梯度下降动力学施加了一种“准赢家通吃”(quasi winner-take-all)的动态,最终的解将由这些“竞赛获胜者”主导。要利用这一点,我们需要理解是什么让一条通路学得快。我们在之前的讲座中已经看到了一些因素:4. 边共享(Edge Sharing):这是一个新出现的因素,稍后我会解释。让我们看看竞赛的实际表现。首先是输入输出相关性。如果网络中有两组神经元,一组只看到单个样本(蓝色),另一组能看到两个样本(橙色,相关性更强),后者单独存在时学习速度会更快。根据竞赛理论,当我们训练一个包含这两类通路的普通 ReLU 网络时,它的学习曲线会紧贴那条更快的曲线。因为更快的通路消除了误差,留给慢速通路的任务就没有了。这对理论家来说是个好消息,因为这种赢家通吃的动态意味着我们只需要关注那些获胜的稀疏通路。再看其他因素。较短的通路学得更快。如果我们将浅层通路和深层通路结合,浅层通路将主导学习过程,损失曲线会紧贴较快的那条。最后,我觉得最有趣的特征是“边共享”。在这个任务中,我们可以通过独立的通路连接输入和输出,也可以允许信息流过共享的链接。共享通路有两条路径从输入流向输出,其贡献会叠加,因此学得更快。如果我们训练一个同时拥有独立和共享选项的联合网络,它会可靠地偏向于更快的选项。这表明,仅仅源于梯度下降的动力学,就存在一种偏好共享结构的隐式偏差。首先,我们来看一个网络如何在非线性和线性表示之间进行选择的例子。在这个任务中,有三个特征 $x_1, x_2, x_3$。如果从顶部俯视,它看起来像是一个非线性不可分的 XOR(异或)任务;但如果从侧面看,这些点又是线性可分的,并且有一个间隔 $\Delta$。这个参数 $\Delta$ 控制了数据中线性维度的显著程度。我现在可以分别计算两种网络的学习速度:一种是像 XOR 解法那样,神经元指向单个样本;另一种是神经元沿着垂直轴排列,利用线性可分维度。通过绘制速度曲线可以看到,当没有线性可分性时,线性解法无法取得进展,XOR 解法更快。但在某一点上情况会发生逆转,线性解法变得比 XOR 配置更快。根据“神经竞赛”理论,我们预测:如果训练一个真实的 ReLU 网络,它的表现总是会紧贴着两条曲线中较快的那一条。实际上,网络确实是这样做的。我们可以通过让两者速度相等来计算交叉点,得到的定量预测是交叉点位于 $\sqrt{2/3}$ 处。我觉得这很有意思,因为这意味着非线性表示在它们成为“绝对必要”之前就已经出现了。你可能以为网络会等到线性不可分时才切换,但实际上,动力学特性导致它在此之前就已经切换到了非线性结构。接下来是一个试图将这些概念整合到更复杂场景中的例子:多语言翻译。想象一下,我们要翻译不同语言(如法语、德语、西班牙语)中的简单名词(如狗、猫)。在任何给定的输入样本中,你可能被要求从法语翻译到德语,或者从法语翻译到西班牙语。这是一个可以研究“系统性”的简单玩具设定。我们可以只在所有语言对的一个子集上进行训练。如图所示,我只训练绿色的部分,而将紫色的部分作为完全保留的领域对(held out domain pairs)。这意味着网络从未将日语翻译成西班牙语,但它见过日语到英语、日语到中文的翻译。问题是,网络何时能将其知识适当地扩展到这些未训练的领域?我们如何对此进行神经竞赛分析?网络有多种解决任务的方式:第一种是为每一对语言建立完全独立的通路。这种结构可以实现零训练误差,但因为独立的语言对之间没有共享,学习速度会很慢。第二种是通过一个共享链接传输所有信息。现在,所有 $M^2$ 个可能的语言对都流经这个共享链接。这里的策略本质上是拥有某种“抽象的狗神经元”——它不知道输入是什么语言,也不知道要输出什么语言,只知道输入了“狗”的概念。这种抽象足以传递信息。2. 这种抽象表示正是网络能够实现系统性泛化的关键。一旦有了这个抽象表示,我就可以通过开启或关闭通往新输入/输出域的通路,立即实现对未训练域的翻译。在这个设定中,共享解法具有速度优势,因此我们预期网络会学习到这种共享结构。那么网络实际做了什么?当我们增加训练的输入输出对数量时,我们发现一旦训练量达到约 40%,网络就能泛化到剩余的部分。虽然网络总是能达到零训练误差,但只有在训练了约 40% 的配对后,才会出现这种对未训练域的系统性泛化。这是一种系统性相变。你可以从竞赛的角度理解这一点:随着你向网络添加更多训练域对,共享解法的优势也在增长。当然,竞赛中还有其他因素,比如初始化。如果共享解法的优势不足以占据主导地位,你可能就找不到共享结构解。这就是在那些误差棒很大的区域发生的事情——网络有时能学到泛化解,但竞赛结果不够具有决定性。这里还有一个有趣的发现是关于初始化的依赖性。如果你仅仅增加初始化的方差,其他什么都不变,你实际上是在提高非共享通路相对于共享通路的速度,从而削弱了共享结构在竞赛中的优势。结果显示,随着初始化规模的增加,未训练域的性能实际上在恶化。这表明,这种理论框架可以让你理解影响系统是否能够系统性泛化的一些“旋钮”。在这个设定中,似乎奏效的机制是“小权重特征学习”,它最大程度地利用了这种共享倾向。最后,我想提一下假设和注意事项。神经竞赛的简化总是近似的,因为弱通路也会有轻微贡献。这种方法在赢家具有决定性优势时最有效,因为它具有“赢者通吃”的特性,可以简化解的结构。当然,这也继承了深度线性网络分析的所有假设。1. ReLU 网络可以表现得像是一个深度线性网络的集成,不同的子集在不同的样本上被激活。2. 即使是复杂网络的动力学也可以理解为一场“竞赛”。这场竞赛偏好更强的相关性、更浅的通路、更大的初始化以及**共享结构**。3. 这种对共享的偏好(Bias toward sharing)是一种非常自然的归纳偏置,它能够实现系统性的泛化。最后,我想用一些总结性的思考来结束今天的演讲。回顾我们关于“深度”的学习内容:首先,深度在Loss Landscape中引入了鞍点的层级结构。因此,如果从较小的权重开始初始化,你会看到学习过程呈现出系统的、阶段性的进展。其次,我们看到同样的现象也出现在非线性模型中,例如线性注意力机制。它同样表现出阶段性的涌现,这让我们能够对上下文学习中学到的算法获得可解释的洞察——本质上是主成分回归,我认为这解释了系统如何获得灵活性。最后,在非线性网络中,我们观察到不同的通路(Pathways)会为了解释数据集而展开“竞赛”,从而产生了对共享表示的偏好。我们想理解深度学习的方方面面,但正如本次会议所展示的,这个领域极其庞大。想象一下所有深度网络系统的空间:这里面有 Transformers,有牛顿法和奇异的优化方法,有过度参数化的前馈网络,还有 ResNets 等等。试图解开一个通用的“万物理论”将极具挑战性。物理学中还没有做到这一点,我也不认为深度学习领域很快会有。那么,我们如何取得理论上的进展?我认为物理学仍然是我的灵感来源。我们可以寻找“理想化模型”。这些模型并不照亮整个表面,它们只照亮我们感兴趣的现象的一个子集。只要你知道它们适用的范围,当你遇到问题时,你就可以拿起合适的模型来思考你所面临的问题。如果你对我讨论的工作感兴趣,这里列出了一些相关的参考文献。残差连接(Residual Connections)和层归一化(Layer Norm)会如何改变这个分析?这是一个很好的问题,也是我们急需研究的首要任务。至少,它会重新排序这场“神经竞赛”。关于 ResNets,我可以说它看起来很像使用正交权重进行初始化,这会加速训练过程。在某些情况下,它几乎就是这种初始化差异的精确架构实现。此外,如果我们考虑浅层与深层通路的例子,ResNets 开启了各种通路的选项。至于 Layer Norm,它肯定也会改变竞赛的动力学。这都是我们需要深入思考的问题。我有两个问题:第一,为什么你认为 Softmax 在实践中如此重要?第二,将目前在线性注意力机制上所做的分析,推广到标准 Softmax 注意力机制的主要障碍是什么?我们确实有一篇论文研究了线性注意力和 Softmax 的区别,你可以看到它们在归纳偏置(Inductive Bias)上的一些差异,这或许能解释为什么其中一种效果更好。关于如何分析 Softmax,我认为我们是有工具的。我正在考虑的一种近似方法是将其转化为 Hard Max。我们可以使用 ReLU,这就像一种门控机制;或者我们也可以尝试 Hard Max。我不确定这是否会带来深刻的洞察,但值得一试。在这些竞赛中,比如深度和参数共享之间,你是否观察到了某种优先次序?深度是否比共享更占主导地位?这二者是可以进行量化权衡的。你可以让其中一方变得更极端,最终压倒另一方。总体而言,来自参数共享的速度偏差可能是最温和的;而深度会造成巨大的差异,除非你非常小心地进行初始化。如果你初始化得当,深度的影响就会小得多。我们的理论框架可以对这些因素之间的量化交互提供理解。我代念一个来自 Slido 的问题:Dropout 对神经竞赛通路有什么影响?它会作为通路之间的均衡器吗?另外,这与正则化有什么联系?Dropout 是我非常想分析的另一个点,因为它应该非常自然地契合这个框架——我们可以容纳那些被“Drop”掉的通路。虽然我们还没具体做,但这绝对值得探索。关于正则化,我认为“竞赛”揭示了网络的隐式偏置(Implicit Biases)。如果你喜欢这些偏置,你可以通过适当的正则化来增强它们。例如添加权重衰减(Weight Decay),这是我们可以处理的情况。至于 Dropout 是否能增强这种偏置,目前我还不太清楚。Andrew,我想问一个关于“黑盒”的问题。通常神经科学家所说的“黑盒”是指学习产生的最终模型,这让很多人感到困扰。而你几乎完全专注于学习动力学。你认为我们要理解这些模型的“最终成品”是有希望的,还是说这已经是一个注定失败的方向?老实说,我非常乐观,但我们需要区分两种不同的“最终网络”。第一种是你用 ImageNet 或整个互联网数据训练出来的特定产物。如果你想理解这种单一的伪影(artifact),那就是“机械可解释性”的范畴,我看不到简单的路径。但我认为另一种是可能的:即对数据中核心结构进行更好的假设。例如,网络如何学习概率上下文无关文法(probabilistic context-free grammar)或层级结构?我们在这些理想化设置下已经取得了令人兴奋的进展。我认为在这些场景下,我们能对“终点”产生令人满意的理解。我还想了解强化学习的训练动力学。它们与监督学习有什么不同吗?这是个好问题。我认为目前理论界的一个巨大缺口是,我们缺乏包含 RL 在内的整个预训练-后训练流程的模型。我们绝对需要这个。我们在名为“RL 感知机”(RL perceptron)的研究上迈出了一小步。我们发现机制确实非常不同。直观地说,如果 RL 永远得不到正确答案,它就得不到信号,从而陷入停滞。这会导致一种双峰转变(bimodal transitions)。关于这些概念如何应用于 RL 设置,还有很多需要理解的地方。我很好奇学习路径的问题。通常模型是先记忆,再泛化,有时最后会出现“顿悟”(grokking)。你是否看到不同的路径与 grokking 现象之间有什么联系?如果你将网络置于正常训练无效的机制中,但加入非常轻微的 L2 正则化,你实际上会在这个模型中观察到 grokking。这背后的确切机制是:正则化将网络推向“共享结构解”(shared structure solution)。在早期,网络虽然达到了零训练误差,但并没有处于共享结构解中,最终它会进行重构(reconfigures)。这是在这个形式体系中获得 grokking 的一种方式。还有一个来自线上的问题:我很喜欢你的工作,但你是如何说服审稿人和读者,证明线性近似仍然具有现实意义的?这真是一个被问了无数次的问题。其实我没有什么特别的至理名言,除了这一点:我认为你必须验证这些洞察在非线性系统中是否依然成立。虽然这次演讲中没有展示,但在论文里我有提到,我讨论的所有现象在非线性系统中同样存在。建立这种联系是非常重要的。深度真正的威力在于泛化,而在训练动力学方面可能没那么明显。请问你在泛化方面做了多大程度的研究?我认为这两者是紧密相连的,甚至存在一种权衡。正如你所说,从动力学角度看,深层网络更难训练,这实际上是让事情变难了。但它在泛化方面带来的收益是惊人的。深度带来的关键优势在于“共享”。它允许你重用计算,就像“分而治之”的策略,你可以分解问题、重用子组件,这在泛化上具有压倒性的优势。理解这种倾向的来源是绝对基础的,而这个玩具模型正是试图展示其中的一个版本。交流与合作

如果希望和我交流讨论,或参与相关的讨论群,或者建立合作,请加微信,联系方式请点击 -> 专栏简介 及 联系方式 2024。

本文于2026.2.2 首发于微信公众号。