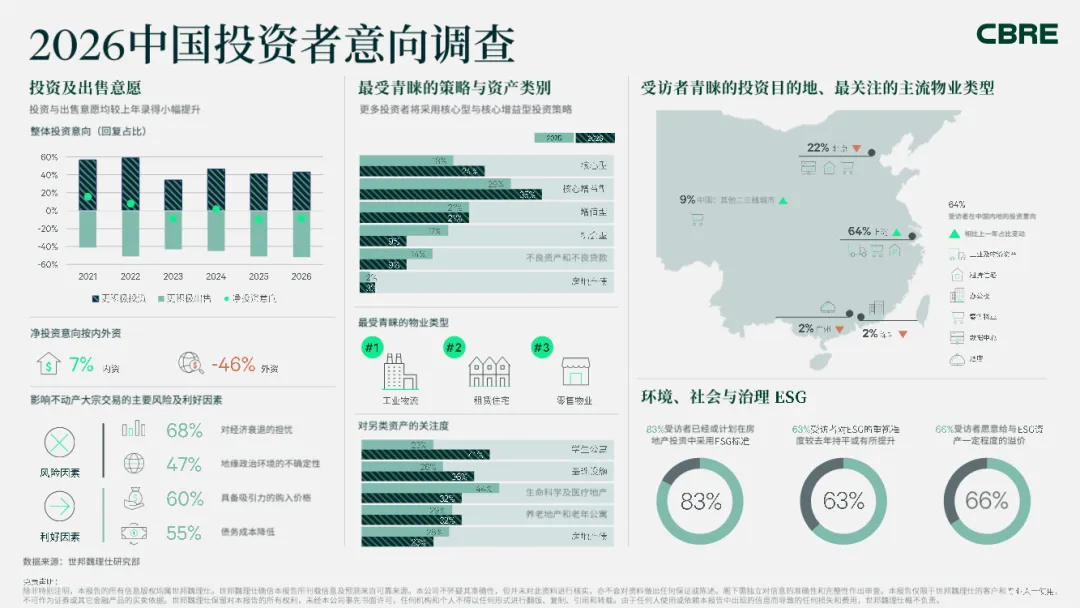

世邦魏理仕:2026年中国投资者意向调查报告解读(2页附下载)

这是一份来自腾讯研究院的2025年AI治理报告,题为"回归现实主义",系统梳理了当年全球人工智能治理的关键趋势与实践。报告核心观点是:AI治理正从早期理想化的宏大叙事转向务实、可操作的具体行动,各国和国际组织在应对数据瓶颈、开源治理、安全风险等现实挑战中形成多元路径。2025年2月巴黎AI行动峰会是全球治理的重要节点。与2023年布莱切利峰会相比,巴黎峰会从"是否应该监管"的争论转向"如何有效治理"的实践探讨,首次系统讨论AI的能源消耗、供应链韧性等现实问题。联合国秘书长安东尼奥·古特雷斯在峰会上提出,AI治理需要"具体承诺而非泛泛而谈",这标志着国际议程从原则宣示向行动导向的转变。联合国系统在AI治理中扮演关键协调角色。2025年,联合国教科文组织发布《通用人工智能伦理准则》,各国AI安全研究所组建国际网络开展联合测试。值得注意的是,联合国大会通过决议强调"AI治理应尊重文化多样性",承认单一治理模式无法适应不同发展阶段国家的需求,体现了现实主义转向。国际电信联盟推动AI标准国际化,其"AI向善"平台已吸引180多国参与。但报告指出,标准制定权争夺日趋激烈,美欧主推的"基于风险"框架与部分国家倡导的"发展优先"路径存在张力,国际协调需平衡创新激励与风险防范。美国采用"小切口、轻义务"模式。加州《前沿AI透明度法案》(SB53)仅要求算力超过10^26 FLOPs的"前沿模型"开发者提交透明度报告,避免给产业过重负担。特朗普政府2025年撤销拜登时代AI行政令,强调"不能让国际条约束缚美国AI领导地位",显示其将AI治理地缘政治化。联邦层面则通过版权法、商业秘密等现有法律应对AI挑战,体现普通法系实用主义传统。欧盟推行"精密钟表式"监管但面临困境。《AI法案》原定于2025年8月生效的通用AI模型义务,因合规成本高昂引发业界反弹。欧盟委员会11月发布"数字综合提案",试图简化规则, acknowledging 过度复杂可能扼杀创新。这种自我修正体现现实主义调整——从"理想化完美监管"转向"可行有效规则"。中国采取"应用导向、自下而上"策略。《生成式AI服务管理暂行办法》从应用服务切入,通过算法备案、安全评估等穿透式监管向上延伸至模型层。2025年7月,中国人工智能产业发展联盟组织22家企业签署《人工智能安全承诺》,企业主动披露模型风险,形成政府引导、行业自律的协同治理。这种模式更符合技术快速迭代的现实。日韩等亚洲国家加速立法。日本《AI基本法》强调"非欣赏性利用"的版权豁免,为AI训练开绿灯;韩国《AI框架法》则设立创新沙盒,允许监管豁免期内测试新技术。巴西参议院通过AI监管法案,中东多国将AI作为国家战略重点,全球治理呈现多中心格局。数据瓶颈成为关键制约。Epoch AI研究指出,高质量训练数据可能在2026-2030年间耗尽。产业界探索三条路径:一是"用好存量",通过数据治理提升质量;二是"自给自足",发展合成数据技术;三是"用好富矿",释放公共数据价值。但合成数据存在"模型崩溃"风险,公共数据涉及隐私与版权,数据治理陷入"安全"与"可用"的权衡困境。欧盟文本与数据挖掘(TDM)模式要求"合法获取+权利人未退出",日本"非欣赏性利用"模式则更注重创新灵活,美国依赖合理使用原则,数据治理呈现地域特色。开源治理引发激烈争论。报告区分"开放权重""开放代码""开放数据"七个层级,Meta的Llama系列处于"有限开放"层级,DeepSeek-R1则接近完全开放。支持方认为开源促进创新、防止垄断,Meta与迪士尼达成200多个角色的授权合作,显示商业模型可行性。反对方警告开源模型可能被恶意利用,Anthropic等机构强调"前沿模型需谨慎开放"。加州AB 730和SB 942法案试图在开放与安全间找平衡,但开源治理缺乏全球共识。AI意识与福利成前瞻性议题。2025年出现"AI福利"概念,讨论AI系统是否可能具备主观体验。Anthropic等机构成立专门研究团队,探讨模型"痛苦"或"愉悦"状态。虽然当前AI尚无意识,但报告提醒需前瞻性考虑:若未来出现有意识AI,其权利与义务如何界定?这超越了传统治理框架,触及技术哲学深层问题。安全风险从数字空间向物理世界延伸。2025年,AI agent(智能体)自主执行复杂任务,带来"代理风险"。OWASP发布大语言应用十大风险,数据投毒、提示注入等攻击手段升级。报告称,单个被污染的文档可能通过ChatGPT泄露机密数据,供应链攻击威胁模型训练全链路。具身智能加剧物理风险。特斯拉Optimus等人形机器人展示新能力,自动驾驶系统事故责任认定复杂化。AI从"软件"走向"硬件",风险从虚拟走向现实,传统产品责任法面临挑战。欧盟《产品责任指令》修订试图纳入AI产品,但因果链条追溯困难。治理框架需场景化适配。报告提出AI风险分层:数据系统层关注隐私安全,内容与交互层应对虚假信息、情感依赖,物理与现实层防范人身伤害。不同场景需差异化治理——医疗AI需严格审批,娱乐AI可适度宽松。巴黎峰会强调"不能一刀切",中国《人工智能安全治理框架2.0》也明确分类分级原则。2025年的AI治理呈现三个务实转向:一是从原则到实践,各国减少空谈伦理,聚焦算法备案、风险披露等可操作措施;二是从压制到协同,监管不再是单一命令控制,而是政府、企业、行业组织多方协商;三是从统一到多元,承认不同国家发展阶段与文化差异,尊重治理路径多样性。报告隐含判断:AI治理没有"万灵药",需在创新激励与风险防控间动态平衡。美国侧重于保持技术领先,欧盟致力于规则输出,中国强调发展与安全并重,这种多元竞争反而促进全球治理体系演进。未来关键在于建立互操作性机制,让不同监管体系能对话协作,而非强求一致。现实主义不等于放任自流,而是承认技术发展的不可预测性,采用敏捷治理——快速迭代规则、持续评估效果、及时调整方向。正如巴黎峰会主题"AI行动",2025年的治理实践表明,只有脚踏实地解决数据、开源、安全等真问题,才能为AI健康发展提供可持续的制度保障。部分内容预览

—

—

—

扫描识别下方二维码可自助开通会员

—

本篇资料已更新至情报猿资料分享平台

咨询会员服务、了解完整版资料获取方式

请加微信号“qbyuan888”

—

免责声明:以上报告均系本平台合作用户通过公开、合法渠道获得,报告版权归原撰写/发布机构所有, 如 涉 侵 权 , 请 联 系 删 除 ;资料为推荐阅读,仅供参考学习,如对内容存疑,请与原撰写/发布机构联系。

—

—

—

—