锋行链盟推荐阅读

来源:云计算开源产业联盟与云原生产业联盟联合编制

【锋行链盟】

聚焦于人工智能、低空经济、数字经济、银发经济、文旅、通信、储能等领域,为政府、企业、科研院所、金融机构提供产业研究、产业咨询、政策汇编解读、产业招商、投融资等服务。客服微信:fengxingkonggu

以下是内容详情

引言

本报告由云计算开源产业联盟与云原生产业联盟联合编制,系统分析了大模型推理优化与部署的技术体系、市场格局与实践路径。报告于2025年8月启动编制,12月正式发布,汇聚了信通院、券商、云服务商等多方专家智慧。在当前人工智能从"模型创新"向"规模落地"转型的关键期,报告具有重要的产业参考价值。

一、大模型推理趋势深度洞察

1.1 结构性转型:从训练驱动到推理主导

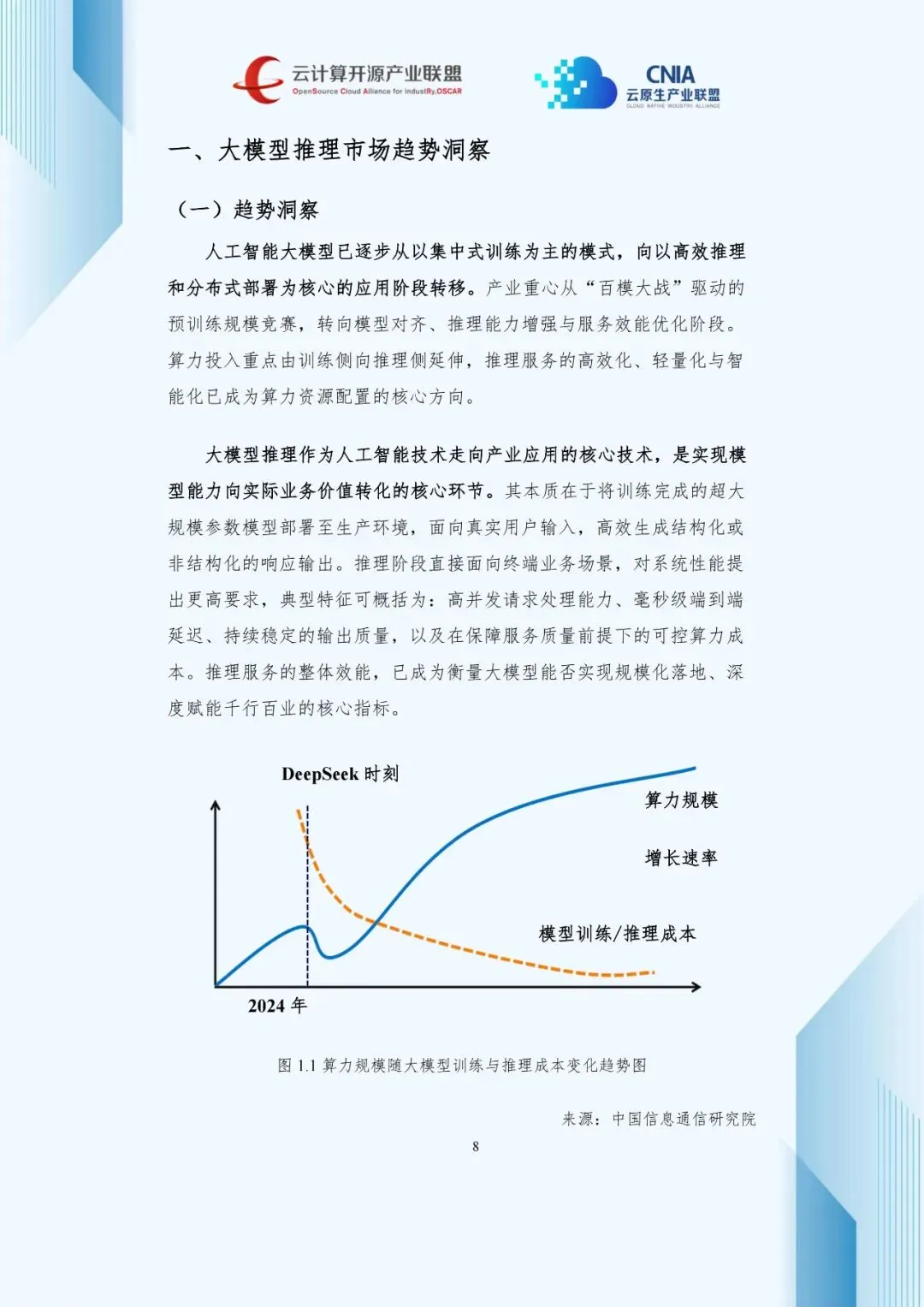

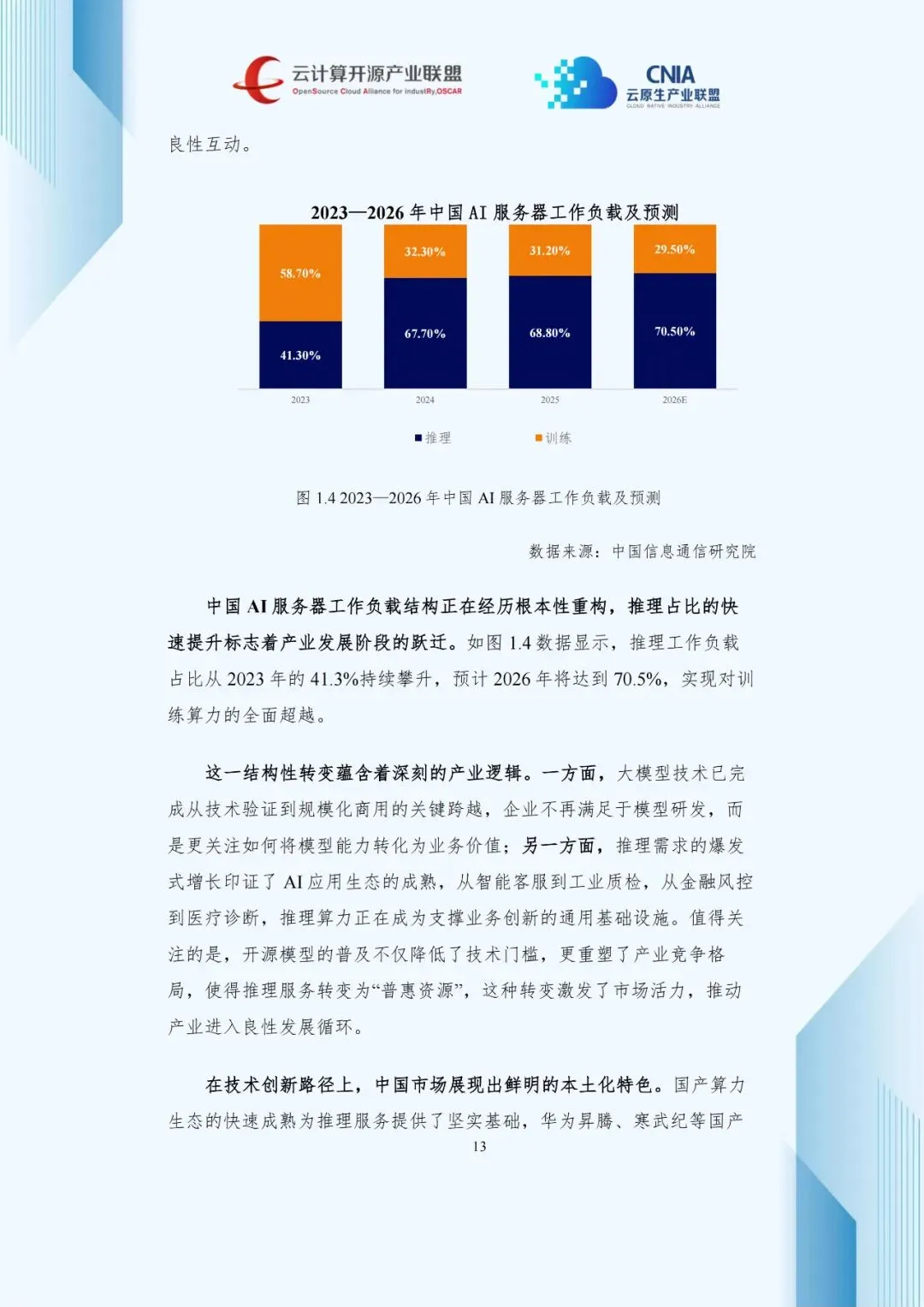

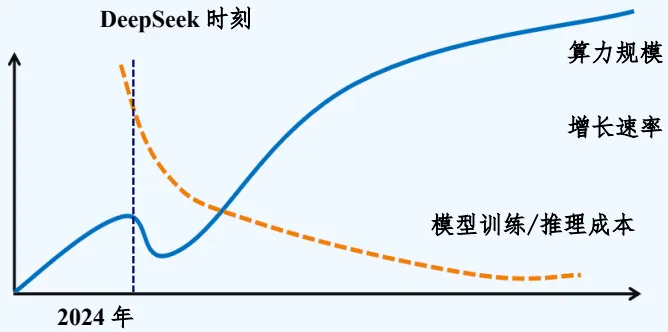

报告揭示了大模型产业正在经历根本性范式变革。如图1.1所示,自2025年2月DeepSeek系列开源模型获得市场关注以来,呈现"成本下行、算力上行"的发展态势。这一现象反映了产业高质量发展新逻辑:高性能开源模型大幅降低部署门槛,同时推理成本优化释放了市场需求弹性,推动企业从"验证"迈向"规模化部署"。

技术演进呈现鲜明特征:从追求模型规模转向提升推理效率,通过模型压缩、动态推理等技术实现计算资源精准配置;服务模式从通用解决方案转向定制化场景适配,形成差异化部署方案。

1.2 全球市场格局重构

全球AI推理算力市场经历深刻转变,2021至2024年间规模实现近十倍增长,从14.04亿美元扩张至139.58亿美元。2024年起,市场增长率回升至31.5%,标志全球AI算力市场正式进入推理驱动新周期。

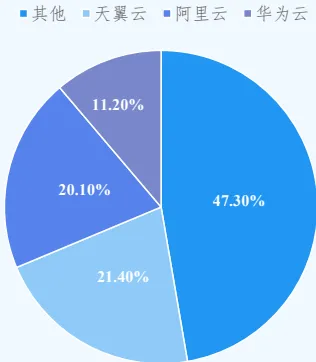

图1.5显示,2025年上半年中国推理算力市场形成多元化格局:天翼云(21.4%)、阿里云(20.1%)、华为云(11.2%)三强主导,其他厂商占47.3%。电信运营商的领先地位凸显"网络+算力"融合服务价值。

1.3 中国市场特色发展路径

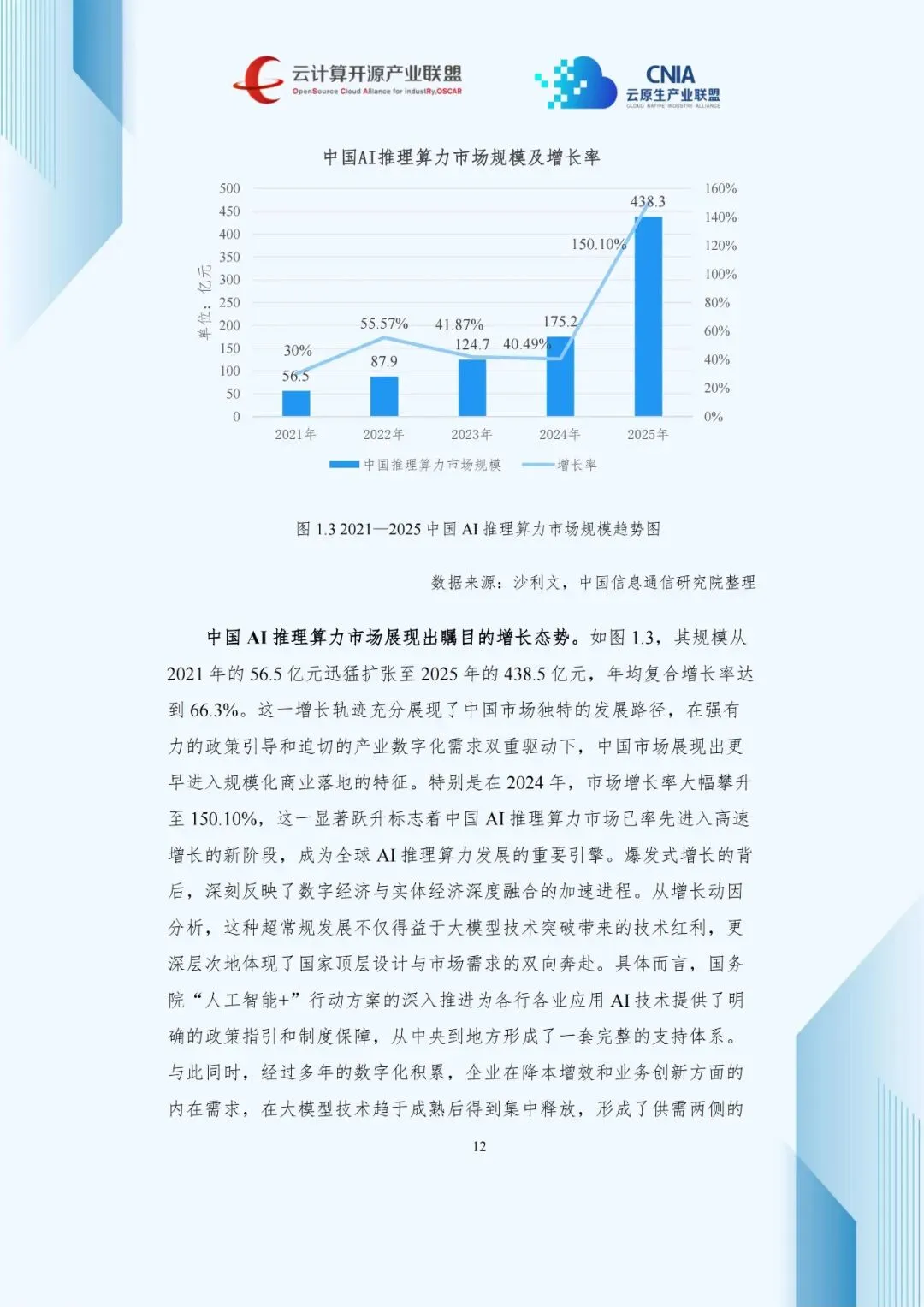

中国市场展现独特发展轨迹,规模从2021年56.5亿元迅猛扩张至2025年438.5亿元,年均复合增长率达66.3%。2024年增长率大幅攀升至150.10%,标志中国率先进入高速增长新阶段。

二、大模型推理部署方式创新分析

2.1 四元部署格局形成

报告识别出四种主流部署形态,构成完整的解决方案谱系:

模型即服务(MaaS):基于Token计费的弹性模式成为主流。2023至2025年,企业在基础模型API上的支出从50万美元爆发式增长至1330万美元,年均复合增长率超400%。这种模式显著降低了中小企业使用门槛。

大模型推理一体机:成为央国企数字化转型首选。2025年预计出货量超10万台,市场空间超千亿元。截至2025年5月,45%的央企已完成DeepSeek模型部署,未来三年市场空间预计超五千亿元。

私有化部署平台:81%的企业选择通过云原生形式进行私有化部署,体现了云原生技术的主导地位。在2025年2月到3月期间,超过160家厂商接入DeepSeek模型服务,形成多元化市场生态。

云一边一端协同推理:在物联网和实时交互场景中建立独特优势,推动大模型推理从集中式向分布式架构迁移。

2.2 部署偏好结构性变化

图2.1显示,2023至2027年间部署结构将发生显著变化:公有云部署从49%增至58%,私有云从16%上升至26%,而本地一体机部署从19%降至8%。这一趋势揭示了混合架构正成为主流选择。

三、推理优化技术体系深度解析

3.1 全栈协同优化理念

报告提出了"芯片-框架-模型"三位一体的协同优化理念,强调需要打破各技术层级间的壁垒,实现跨层次深度适配。

硬件适配层:形成GPU、NPU、ASIC三种架构并行发展态势。GPU凭借强大并行计算能力和成熟生态保持优势;NPU在能效比方面表现突出;ASIC通过全定制设计实现极致性能功耗比。

推理引擎层:vLLM、SGLang等框架通过架构创新实现突破。PagedAttention技术将显存利用率从50%-60%提升到80%以上;连续批处理技术将GPU利用率提升至60%-80%区间。

模型优化层:量化技术使显存占用降低60%-70%,推理速度提升2-3倍;知识蒸馏技术使7B学生模型可达70B教师模型约90%表现;MoE架构通过稀疏激活机制平衡模型容量与计算效率。

3.2 并行计算技术突破

并行计算成为支撑超大规模模型部署的关键支柱:

张量并行:实现计算压力横向分散

流水线并行:采用阶段划分策略

数据并行:提升系统吞吐量

P/D分离架构:通过解耦Prefill和Decode阶段优化资源调度

四、性能测试方法论与实践价值

4.1 标准化测试体系

报告建立了科学统一的性能评估框架,涵盖处理能力、服务质量、资源效率等多维度指标。关键指标包括QPS、TPM、TTFT(首Token延迟)、TPOT(生成Token延迟)等,形成对系统性能的立体化认知。

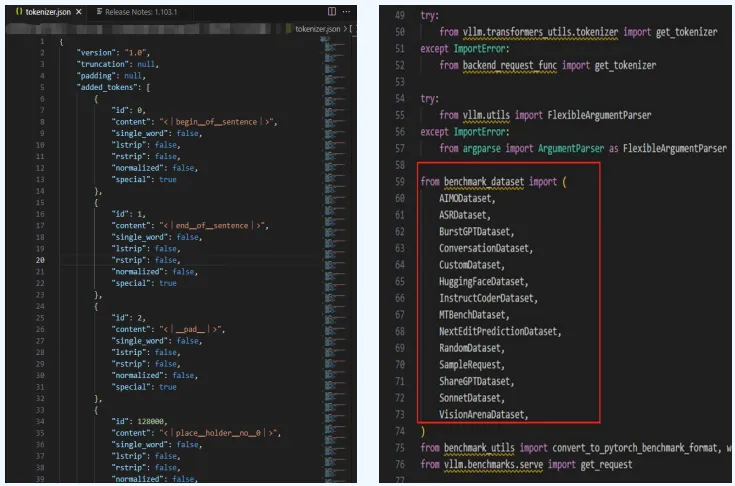

图4.1展示了测试中使用的开源数据集与Tokenizer处理流程,体现了测试的严谨性和可重复性。

4.2 P/D分离架构性能验证

通过DeepSeek R1模型的压测实验,系统验证了P/D分离架构的性能优势:

增加解码器数量提升并行生成能力,1P3D配置相比1P1D吞吐量提升30%-50%

增加预处理器数量显著改善初始响应速度,3P1D配置相比1P1D在TTFT指标上下降40%-60%

不同输入输出配置下性能差异最高达2.3倍,凸显配置优化重要性

五、行业案例实践启示

5.1 多元化应用场景验证

四个行业案例从不同维度展示了大模型推理技术的产业化成果:

哈佛大学案例:验证高性能算力集群与vLLM推理框架的协同效应,实现推理速度提升近3倍,GPU利用率从不足40%提升至75%以上。

开普云案例:展示国产算力全栈协同优化路径,通过FP8/FP4混合精度推理引擎等创新,在128K长上下文任务中吞吐量提升1.5倍。

中信证券案例:智能推理引擎驱动业务智能化转型,处理Token总量达数千亿规模,成功部署19个数字员工应用。

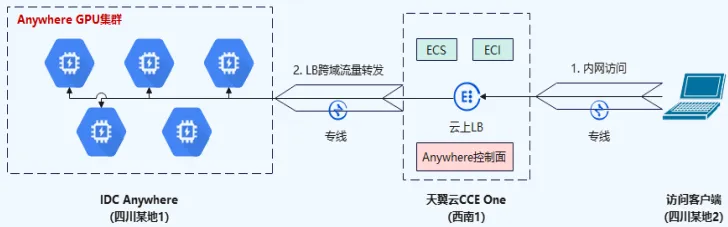

机器人企业案例:图5.1所示的云原生分布式架构,实现私有化部署周期从30天缩短至6天,响应时间从800ms优化至520ms。

六、发展趋势与战略建议

6.1 技术趋势展望

未来技术发展呈现系统级优化特征:

专用推理芯片针对Transformer架构硬件级优化

推理框架向跨设备、跨地域分布式演进

云边端协同成为重要方向,2027年设备端与边缘服务器推理负载占比达84%

MoE架构等创新继续推动效率提升

6.2 产业发展挑战

报告识别出系统性挑战:

成本压力:千亿参数模型单次推理成本是传统AI模型数十倍

标准化缺失:接口协议、性能指标差异导致选型成本高昂

人才短缺:复合型人才供需比达1:8

生态碎片化:软硬件适配复杂度高

6.3 战略建议体系

提出"五位一体"发展体系:

技术标准:建立性能测试基准与评估规范

创新机制:构建产学研用协同创新平台

人才体系:培育复合型人才

政策环境:加大基础软硬件研发支持

商业模式:推动成本优化和创新模式

结论与价值评估

本报告系统构建了大模型推理优化与部署的完整知识体系,具有重要产业价值:

首次全面梳理推理市场格局和技术路径

创新提出全栈协同优化理念

建立标准化性能评估框架

通过真实案例验证技术可行性

报告为产业界提供了从技术选型到部署实践的完整参考,将推动大模型推理技术从"可用"向"高效可用"转变,为人工智能规模化应用奠定坚实基础。随着各技术环节的深度融合,大模型推理将成为赋能产业智能化的核心基础设施,助力新质生产力发展。