接下来所有人都会用openclaw去做行业调研,

因为这个提效的推背感太强了!

实际体验下,会用openclaw做行业调研的人,现在完全是降维打击了:

能让你几天内快速对一个行业做调研,对行业的理解,能超过干了几年但是没做过系统梳理的老炮。

而且不管你是做行业研究、选创业赛道、做IP方向定位;还是做营销策划、选择职业方向等等几乎所有跟商业活动相关的事儿,都能用得上。

一共就三个步骤来做配置,下面我详细说下。

先问大家一个问题。

想进入一个新行业,最痛苦的事是什么?

不是找不到资料。恰恰相反,今天这个时代,资料太多了。

麦肯锡的报告、36氪的分析、行业老兵的博客、竞品的产品页……

好现在你找到这些报告、下载到电脑上、正襟危坐你读了20份报告,结果你发现每一份给你画的图都不太一样。

哪些数据是真的,哪些趋势是噪音,谁才是这个赛道上真正的玩家——

你得靠人脑去慢慢比对、消化,三个月后你可能才拼出一张粗略的认知地图。

我们以前做PE投资,费了很大功夫在行业研究上,去消化这些东西形成一套全局认识,可以说是耗时耗力。

但在今天这个节奏下,三个月是一个奢侈品。

利用openclaw这种工具,完全可以把整个时间压缩到几天。

目前我自己已经用它来监控hackernews、anthropic、openai、cursor等官网的文章或者帖子,一有更新马上处理;它起的比我还早,几个定时任务每天准时推送到我手机上。

另外也监控了AI技术、产品和创投方向的十多个播客,一旦有更新就会触发后续的一系列任务。

每天一睁眼就是顶级播客最热乎的精选信息。

我这几天还翻了下海外的社区,目前前沿的玩家大都把它用成了行业调研机器。

而且用到的恰恰是OpenClaw跟ChatGPT、Claude最不一样的那几个能力——不是"聊得好",是"能动手、能定时、能记住"。

一、用Firecrawl批量抓网页,让它自己去读一个行业

大多数人做行业调研,还是一篇一篇手动读。

你读到第三份报告的时候,第一份的关键数据大概率已经模糊了。

而第三份和第一份在同一个问题上说的话可能完全矛盾——一个说市场规模500亿,一个说1200亿。

我们做过行业的都清楚,倒不是他两在乱说,一般都是统计口径不一样。

这些细节,你不对着看,根本发现不了。

OpenClaw跟普通聊天AI的最大区别之一是:它能真正访问复杂网页和你的本地文件。

具体来说,OpenClaw内置了Firecrawl作为web_fetch的Fallback。

他不仅把任何网页抓下来,而且非常关键的是可以去掉广告、脚本、导航栏这些噪音,只留干净的正文,转成Markdown格式。

这有啥好处呢?

明显,省掉了大量无关的上下文,省了token;另外把网页html转成Markdown更适合AI去读,我以前视频里讲过哪些语法格式是AI更喜欢的。

而且它不仅仅是一页一页慢慢爬的,最大处理速度可以到1000页/分钟。

具体操作是这样的:

你告诉OpenClaw"帮我把XX行业的这些20来个网站的核心页面抓下来",它通过Firecrawl批量抓取,转成干净的Markdown文本,存到你本地硬盘上。

然后它可以直接读这些文件——因为OpenClaw有完整的本地文件读写权限——同时比对多份报告的数据,哪些是共识、哪些是分歧、哪些是彼此矛盾的。

当然这只是最简化的情况,因为实际操作时页面的结构可能差别很大,有的需要特殊处理。

如果你需要更深入,它还能写一段Python脚本来跑结构化分析——提取每份报告里的公司名、融资金额、市场规模预测,然后自动生成对比表格。

因为OpenClaw可以执行代码,这些事它自己就能做。

有做投资研究的用户在博客里写了他的做法:

把几十份券商研报喂给OpenClaw,程序化提取评级变动、目标价、核心逻辑、风险因素,然后自动交叉比较多家券商的观点。

还有做旅游SaaS的创业者做得更极致——

让Agent自动抓取了7200多条竞品的用户评论做交叉分析。

这东西手动做,你不得找三个实习生干两周啊。

ChatGPT只能基于它训练数据里的旧信息给你一个概述。

OpenClaw是真的跑出去、抓回来、存本地、跑代码、做分析。

而且所有数据都在你自己的硬盘上——研究敏感行业、竞品情报什么的,除了请求大模型这一环,数据根本不过云端。

这个用法可以迁移到任何行业。

想搞懂新能源,给它十几个行业网站让它去抓。

想搞懂机器人赛道,让它把CB Insights、Crunchbase、几个头条号全过一遍。

做行业研究的一个窍门是找出矛盾点,因此那些不同报告之间矛盾的地方,往往就是这个行业真正值得深挖的地方。

二、一行Cron命令,搭一个你自己的行业情报日报

前面说的是一次性的集中研究。但摸透一个行业不是一锤子买卖——你需要持续跟踪。

传统方式大家都试过:

订一堆newsletter、关一堆公众号、每天手动刷行业网站。

问题是信噪比太低。

你订了20个信息源,每天推200条信息,真正有价值的可能就5条。

你花一个小时筛选,其实90%的时间都浪费在点击、切换这些无效工作上。

在这个场景上,OpenClaw有一个ChatGPT和Claude完全不具备的能力——Cron定时任务。

OpenClaw的Gateway里内置了一个持久化的调度器。

你可以给它设定一个定时任务,比如每天早上8点自动执行一段指令,然后把结果推送到你的Telegram或飞书。

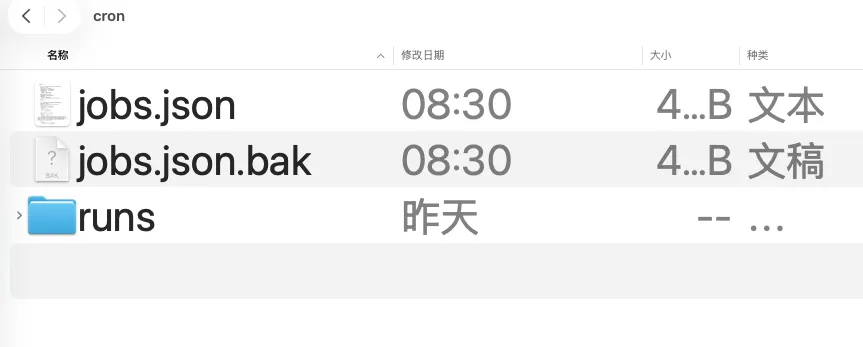

任务配置会集中存在本地的jobs.json这个文件里。

设置的门槛低到只需要这一行命令:

openclaw cron add "搜索[XX行业]过去24小时的重要新闻、融资事件、政策变化和技术突破,去重后整理成一份简报,按重要性排序,每条附上来源链接" --schedule "0 8 * * *" --deliver telegram就这一行,每天早上8点,OpenClaw会自动醒来,用Exa(/ˈɛksə/)做语义搜索,用Firecrawl抓取相关网页提取正文,然后去重、评分、生成摘要,最后推送到你的Telegram。

定时任务是跑在一个隔离的session里,不会打断你正在进行的其他对话。

有具体案例是搭一个Tech News Digest,一次性接入100多个信息源,按标题相似度自动去重,对每条信息做质量打分,只推送高分内容。

整个搭建时间也就1个多小时。

一般来说搭完之后你的早晨会变成这样:

起床,打开Telegram,一份定制化的行业简报已经在那了——谁融资了、什么政策变了、哪个技术突破了、谁说了什么值得注意的话。

所以大家能明显看到区别:ChatGPT和Claude是被动的——你不问它就不动。OpenClaw有主动出击的能力,你睡着了它还在帮你盯着行业动态。

这是架构层面的差异,不是prompt写得好不好的问题。

这个玩法迁移空间很大。

做教育的改成教育行业情报日报,做医疗的跟踪各地政策更新,做跨境电商的监控海外市场动向。

以前得雇个人专门盯,现在一行Cron命令搞定。

接下来,每个行业都可以做一个cron。

而且后面你完全可以用来做下游动作,比如吸引同行。这个想象空间大家应该都能get到。

三、Markdown记忆 + 多渠道追问,长出你自己的行业认知

前两个用法解决的是"获取信息"。但调研行业还有另一层——你需要建认知框架。

什么意思?

就是你听到一条行业新闻,能在几秒钟内判断这事重不重要、会影响谁、跟你有什么关系。

这种判断力,通常要在行业里泡好几年才长得出来。

这里就要说到OpenClaw最关键的一个设计——它的双层记忆存在你硬盘上的Markdown文件里。

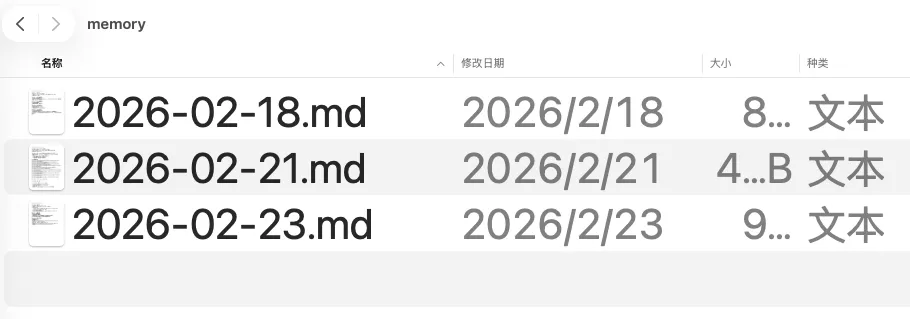

路径在~/.openclaw//workspace,里面有一个MEMORY.md存长期记忆,在小写的这个memory文件夹下还有按日期命名的日志文件记录每天重要对话。

这些就是普通的.md文件,你用记事本就能打开看。

这具体有啥好处呢?

你今天在网页端跟OpenClaw聊了新能源行业的整体格局,它自动识别重点记在了本地文件里。

明天你在地铁上用飞书接着问某个细分领域的技术路线——同一份记忆,跨设备、跨平台、无缝衔接。

后天你回到电脑前追问两个竞品的差异,它全记得。不用每次重新交代背景。

这跟ChatGPT的记忆完全是两码事。

ChatGPT的记忆在云端、不透明、一般来说你控制不了它记了什么忘了什么。

OpenClaw的记忆就是你硬盘上的文本文件——你甚至可以手动编辑它。

觉得它记错了?直接打开改。

想给它补充一些你从线下交流得来的行业洞察?直接写进去。

想用Git做版本管理、追踪你的认知是怎么一步步建立起来的?完全可以。

更狠的是还有一个Heartbeat机制——OpenClaw每30分钟左右会主动检查一次你的HEARTBEAT.md文件。

你可以在里面写上行业调研的待办事项,比如"跟踪XX公司的新产品发布""关注XX领域的政策动向"。

它会主动检查这些条目,有进展了会主动通知你,不需要你每次去问。

像这样经过一两周的持续追问和积累,你的memory目录里会长出一个属于你自己的行业知识库。

它记住了你问过的每个问题、搜过的每条信息、做过的每次分析。

这个积累是GPT给不了的,因为GPT、deepseek这类聊天AI每次开新对话,相当于失忆重来。

一两周追问下来,你对这个行业的认知密度,能超过很多在行业里待了半年但却从没系统梳理过的人。

好,想要发挥最大威力,需要三步串起来用:

先用Firecrawl批量抓取行业资料做交叉比对,几小时建立基线认知。

然后用一行Cron命令搭情报日报,每天自动更新推送到Telegram/飞书,不遗漏重要变化。

最后通过持续追问积累Markdown记忆,对感兴趣的方向不断深挖,让你的行业认知像滚雪球一样越来越厚。

以前需要三个月才能达到的行业熟悉度,现在几天就能有个七八成。

最后这个提示词你可以现在就丢给OpenClaw试:

我正在调研[XX行业],目标是一周内建立系统认知。请帮我:

用Firecrawl抓取以下行业网站的核心内容:[列出5-10个网站URL] 对抓取的内容做交叉比对,找出各信息源之间的共识和矛盾点 搜索这个行业最近6个月最重要的10件事 识别前5名玩家,分析各自的核心优势和软肋 整理成一份结构化的行业入门简报,保存到本地文件 完成后我会针对具体方向继续追问,请记住我们所有的研究上下文。

然后再加一行Cron:

openclaw cron add "搜索[XX行业]过去24小时的重要动态,整理成简报推送给我" --schedule "0 8 * * *" --deliver telegram两条命令,一个是集中火力调研,一个是每天帮你盯着。

你会发现摸透一个陌生行业这件事,跟以前完全不是同一个速度了。

更多精彩文章·激波之影

ClaudeCode 创始人YC访谈:人们只会做他们已经在做的事情。你不能让人做新的事情;编程问题已解决,下个投入方向在这里(附访谈完整版)

Claude Code 黑客松获奖名单,藏着AI创业真正的机会

高手使用Openclaw的四个必装skill技能,激发10倍潜力

加入AI智能体课程及AI学习社区: