华清普智:大模型 API 服务行业分析报告 (2025)

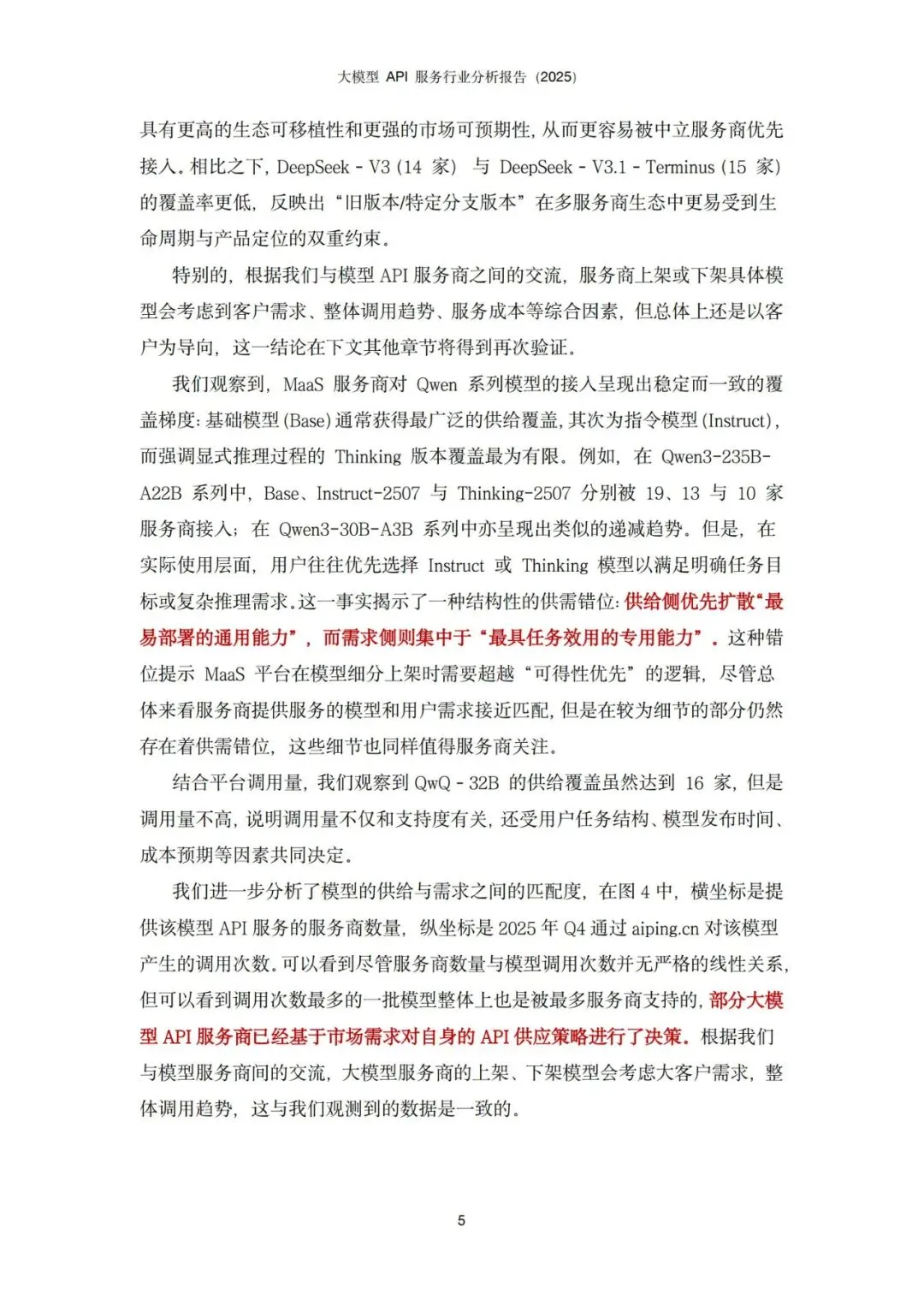

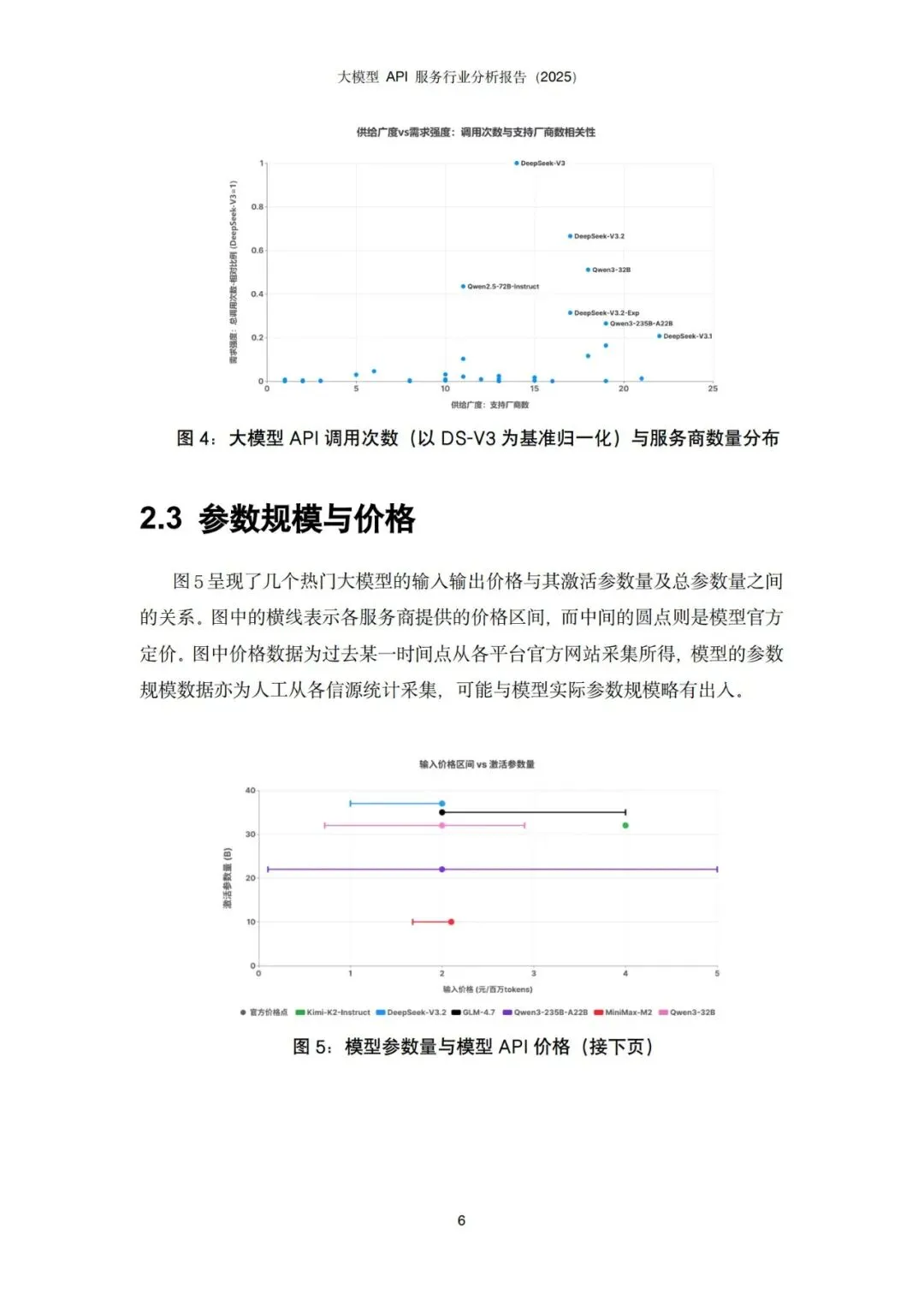

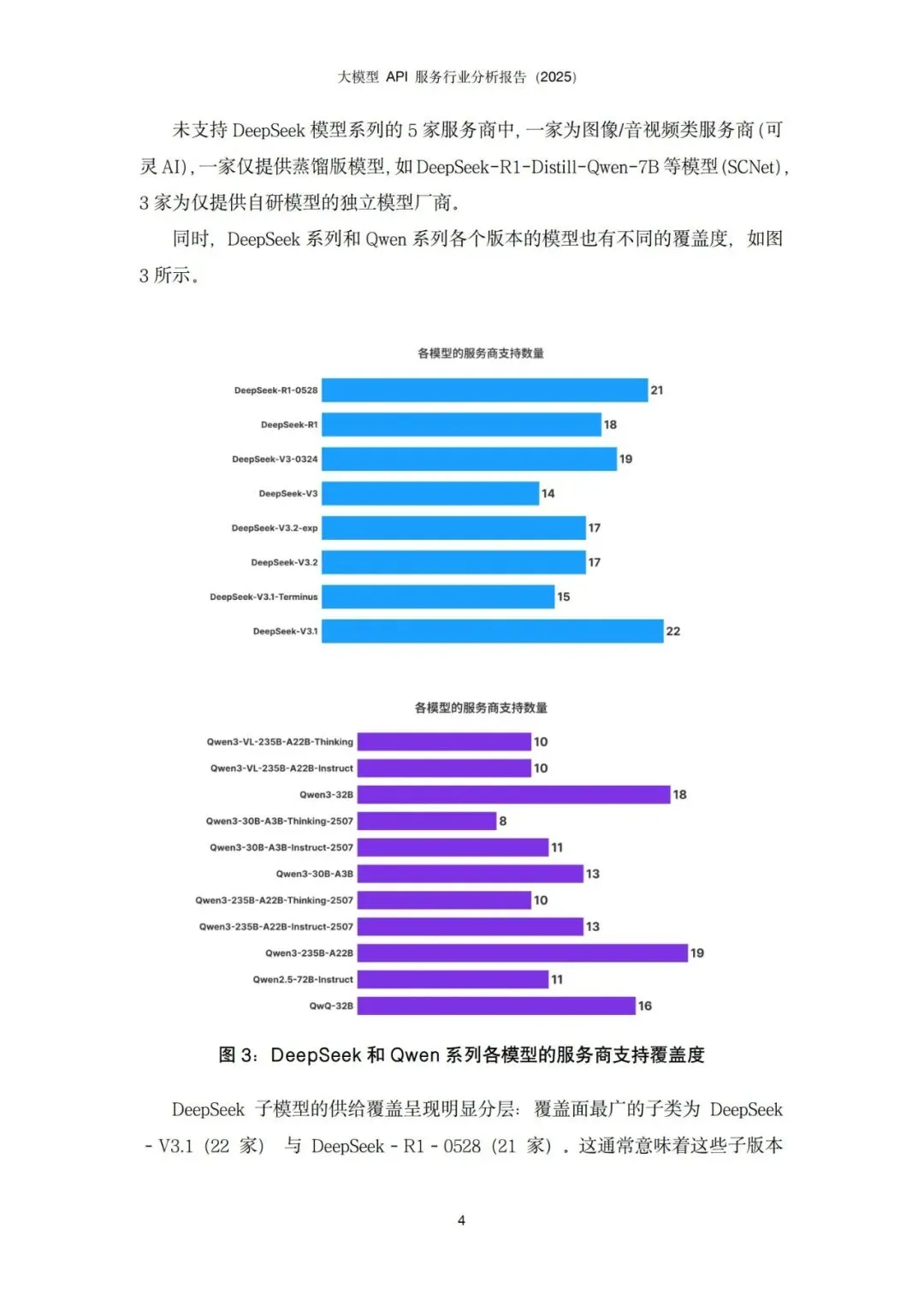

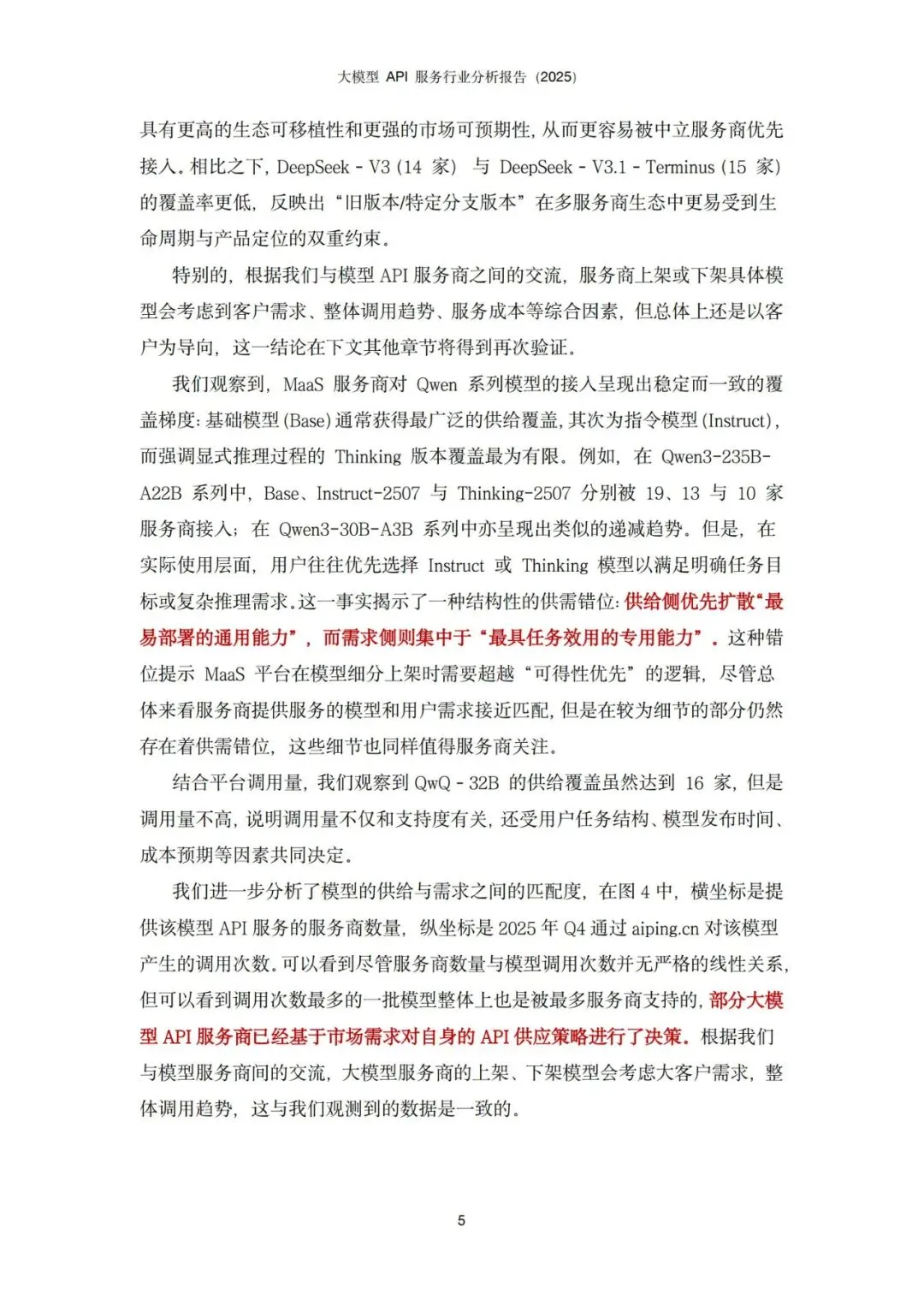

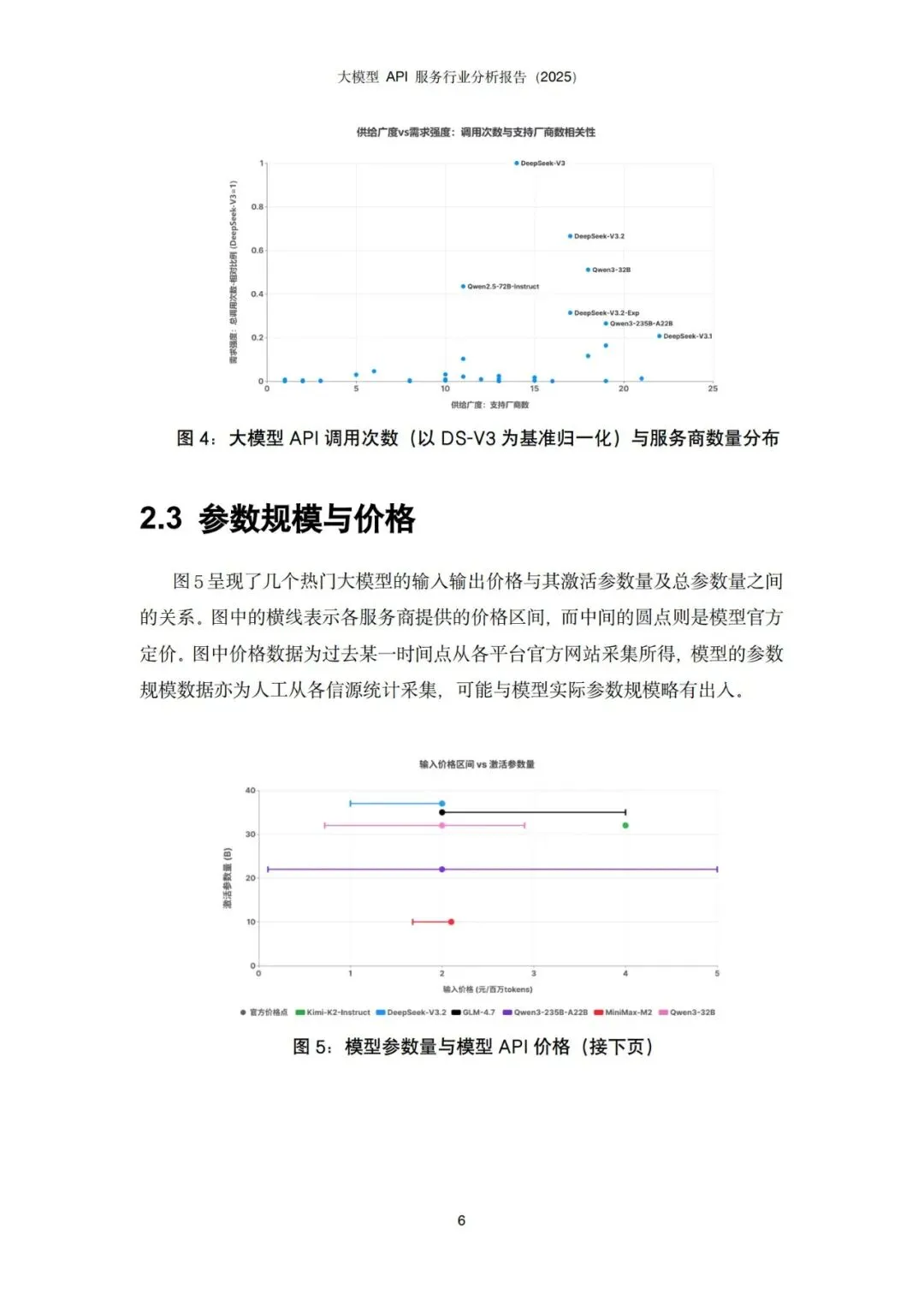

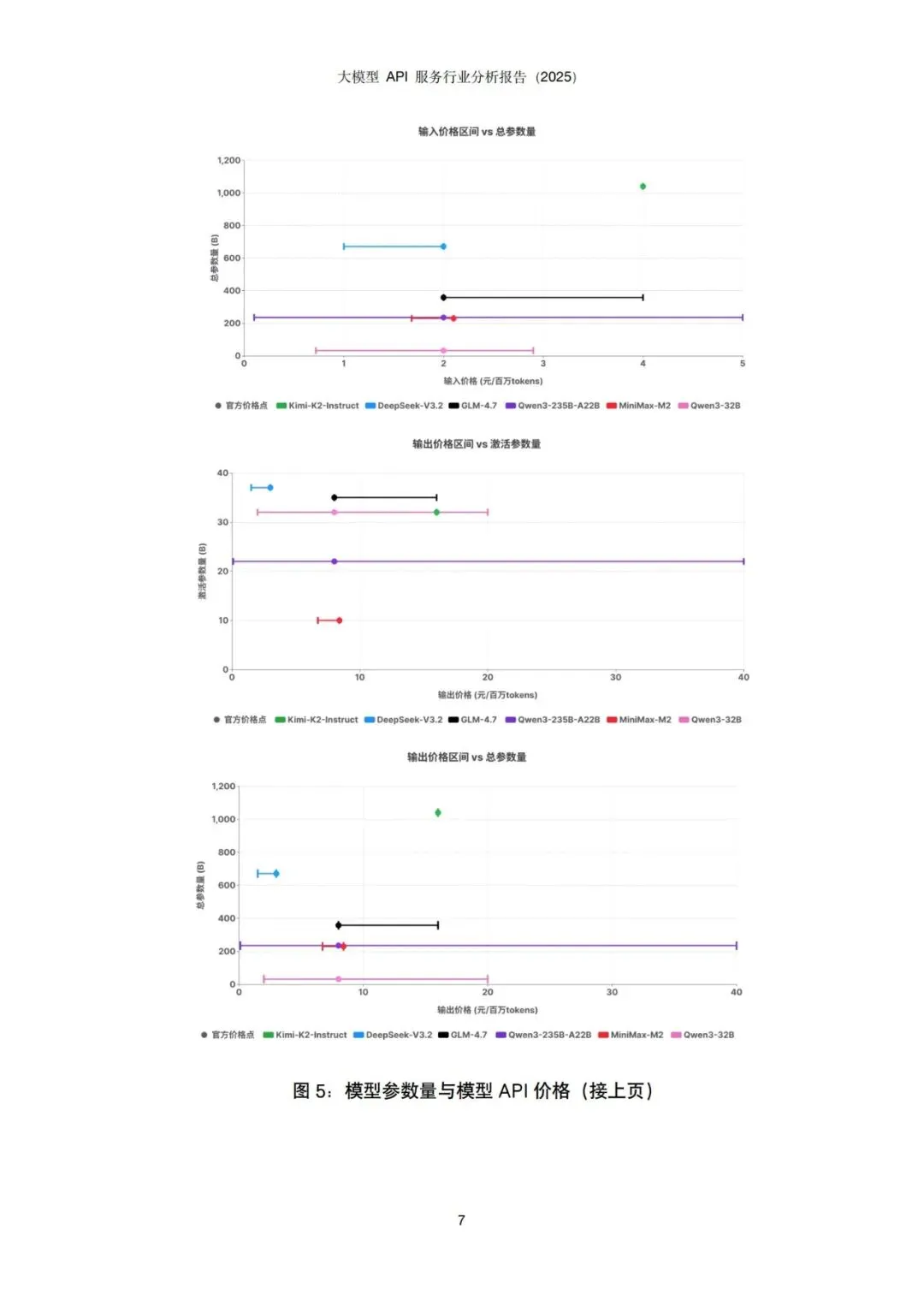

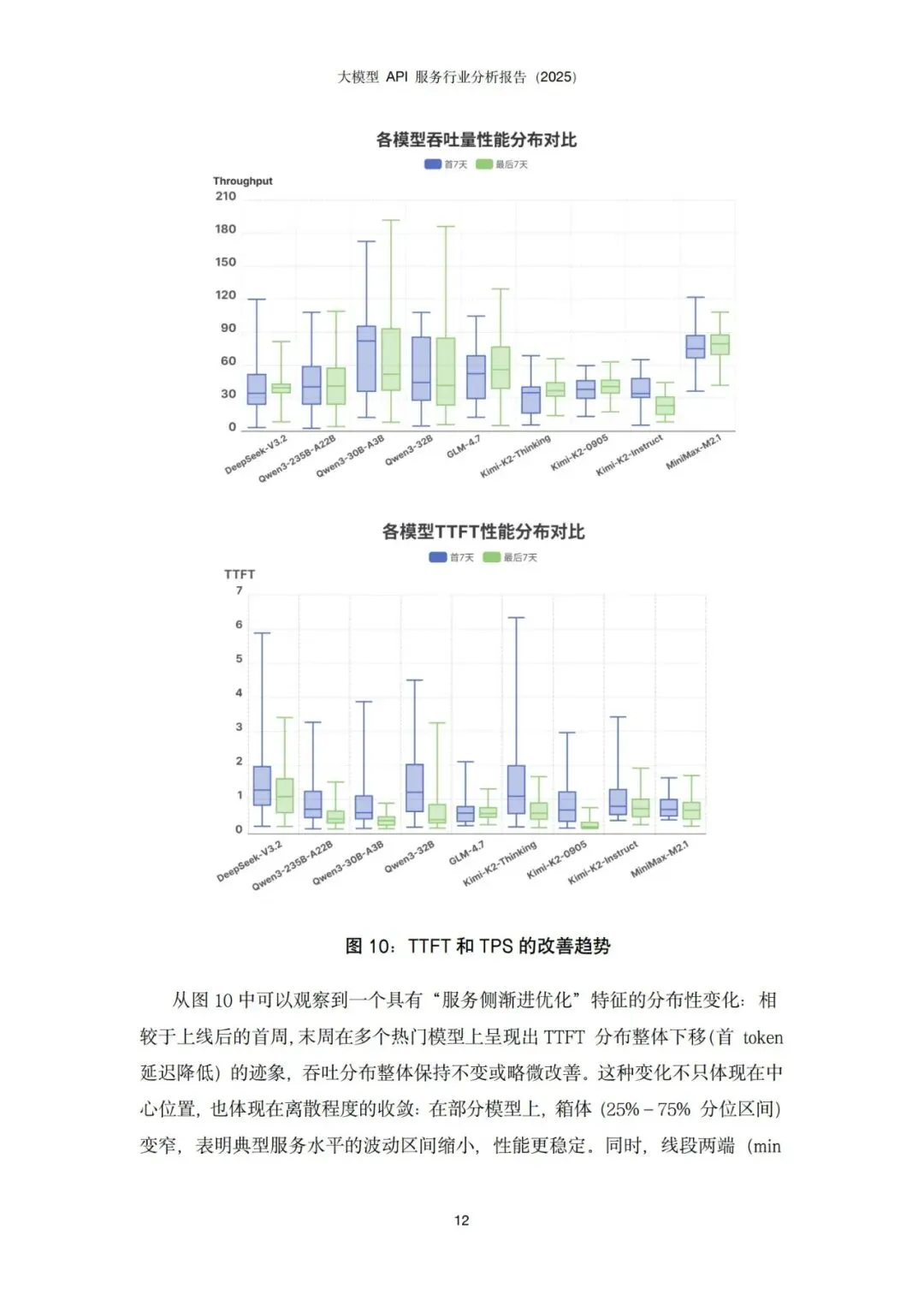

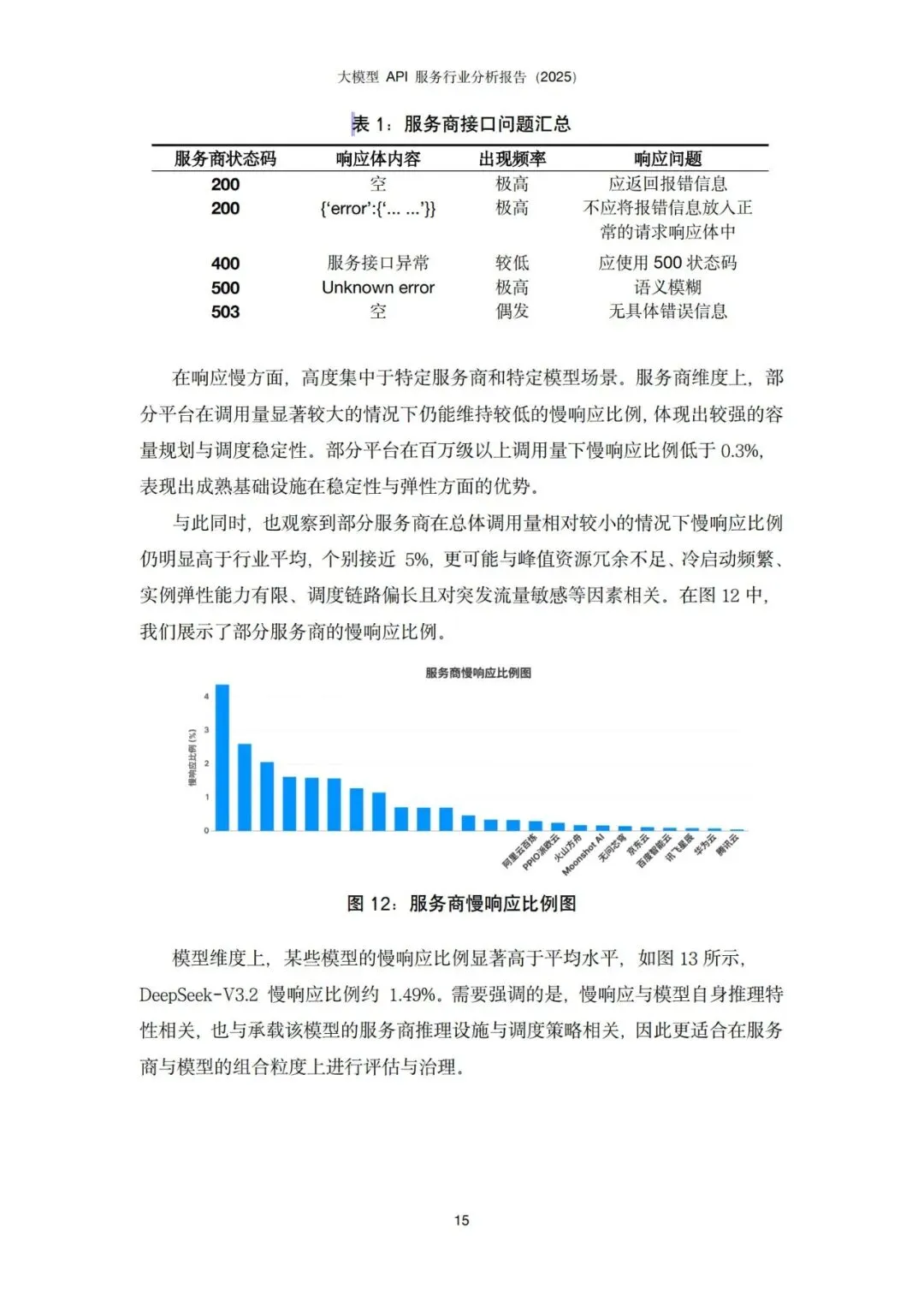

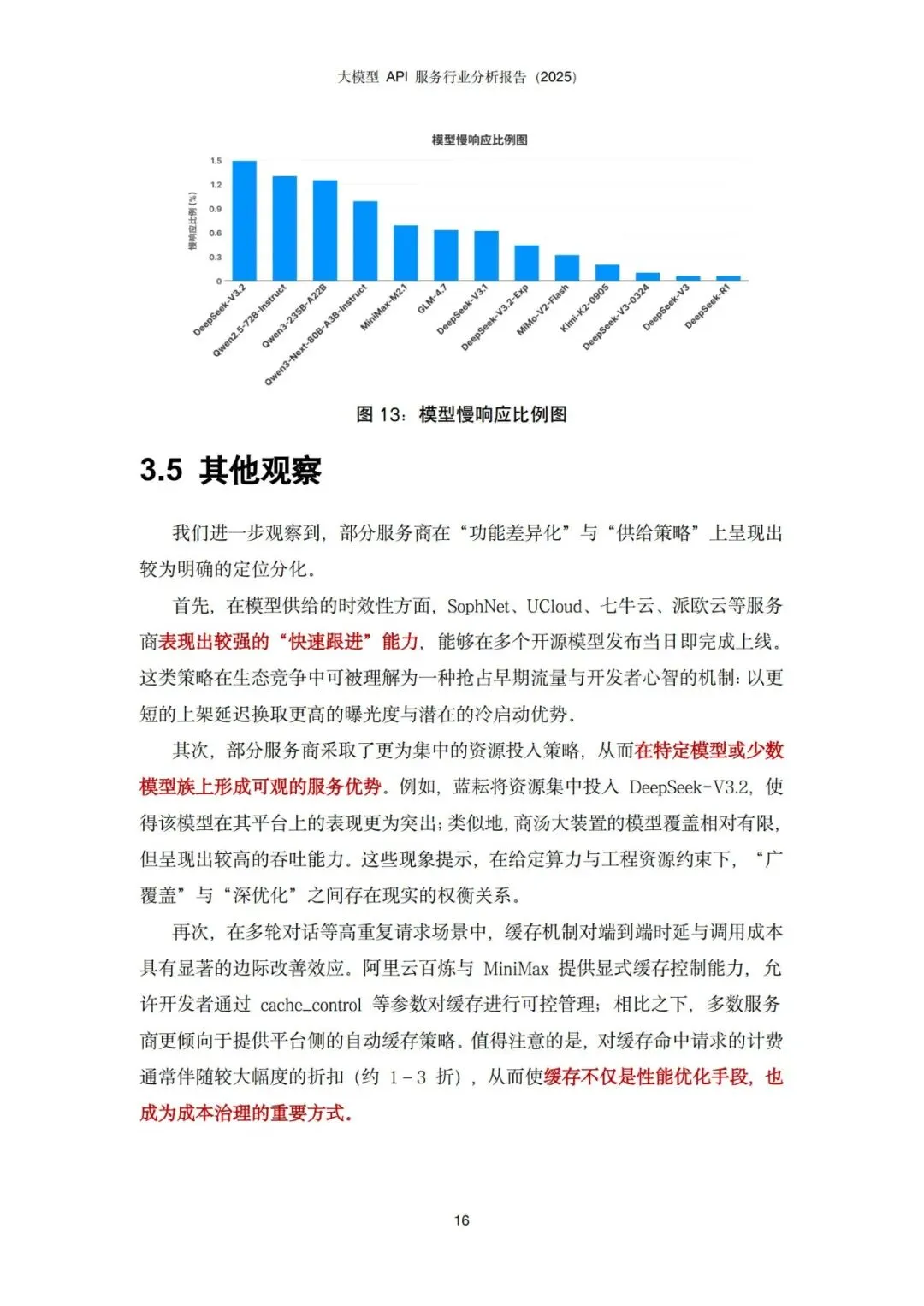

近年来,大语言模型(LLM)在内容生成、代码辅助、知识检索与复杂推理 等场景中快速渗透,促使“模型能力”从单点算法指标走向可规模化交付的在线 服务形态。 大模型 API 服务,是指将模型推理能力以标准化接口对外提供,使开发者 能够在不自建训练与推理基础设施的前提下,按需调用并在业务系统中快速集成。 进一步地,Model-as-a-Service(MaaS,模型即服务)强调以云端资源与工程化 运维为支撑,提供可计量、可观测、可弹性伸缩的模型供给体系,将模型推理的 成本、时延与稳定性纳入统一的服务质量(SLA)框架,从而显著降低企业应用 门槛并加速规模化落地。 AI Ping 作为一站式 AI 评测与 API 服务智能路由平台,整合了中国境内的数 十家算力提供商的数百个大模型 API 服务,并基于 7×24 小时的持续性能监测, 为用户提供统一的 API 接入与智能路由能力。在模型供给快速扩张、服务商异 质性显著、价格与性能竞争加剧的背景下,AI Ping 的价值在于通过专业评测、 统一接口、弹性调度与数据驱动的性能治理,缓解“多模型、多服务商、多场景” 带来的接入复杂度与运维不确定性,为应用侧提供更稳定的质量—成本最优解。 本文基于 AI Ping 2025 年第四季度的抽样数据,对开源大模型 API 服务市 场的发展态势进行了系统分析。本文的三个关键结论如下:1. DeepSeek 与 Qwen 系列模型占据开源模型的 API 调用的主导地位; 2. API 吞吐速率是用户选择服务商的重要因素,各服务商性能差距较大,全 行业性能水平正在持续提升; 3. 应用侧场景分化与模型偏好明显,通过智能路由可以有效提速降本。下文将从模型、服务商与应用三个维度展开具体分析。我们观察到,根据各开源模型请求数据,以总请求量排序,DeepSeek-V3/R1 位居首位、其后为 DeepSeek-V3.2,随后进入高调用梯队的是千问(Qwen)家族 的多款模型,包括 Qwen3-32B、Qwen2.5-72B 与 Qwen3-235B-A22B 等。整体 而言,头部模型呈现出“少数强势型号占据大盘、同一模型家族内多版本并存” 的结构特征。我们同时观察到,Qwen2.5-72B 的调用量维持在较高水平,这一现象在“新 模型加速迭代”的叙事下具有一定反直觉性。一个合理解释是,近期新发布模型 在 70B 量级的稠密(dense)架构供给相对稀缺,而部分存量 AI 应用在工程实 现、效果调优与线上回归体系上,曾围绕 Qwen2.5-72B 与 Llama3-70B 等稠密 模型完成了较为充分的验证与沉淀。在此背景下,终端用户更倾向于继续采用已被业务场景验证的“稳定基线”,而非立即迁移至理论能力更强但尚未完成工程 化与业务闭环验证的新模型。换言之,模型选择不仅由模型能力上限决定,也受 到迁移成本、线上风险与可验证性约束的共同塑造。类似的“版本并存”现象亦体现在同一模型家族内部:尽管 Qwen3-32B 与 QwQ-32B 同属千问系列模型,参数规模接近且 Qwen3-32B 发布时间更晚,但 从调用结构看,Qwen3-32B 尚未完全替代早期的 QwQ-32B。同样地,DeepSeek -V3.1 与 DeepSeek-V3.2 的推出并未完全挤出 DeepSeek-V3 的存量份额。这表 明,模型迭代并不必然带来“单调替换”,而更常呈现为多版本在不同任务偏好、 推理成本与既有集成依赖下的分层共存。