主要内容:

1. 引言:AI时代下的网络基础设施重构 1.1. 从云计算到人工智能工厂的范式转变 1.2. 800G技术驱动力与发展路线图 2. 技术标准与物理层架构 2.1. 双轨并行:IEEE 802.3df与802.3dj标准 2.2. SerDes演进:从112G到224G 2.3. 调制格式与前向纠错技术FEC 3. 核心芯片格局:51.2T芯片的竞争 3.1. 博通:Tomahawk 5与Jericho3-AI的双重驱动 3.2. NVIDIA: Spectrum-4的垂直整合逻辑 3.3. 迈凌Marvell:Teralynx 10的可编程性与超低时延特性 3.4. 思科:Silicon One G100的统一架构 3.5. 芯片参数对比 4. 系统厂商产品与解决方案 4.1. Arista Networks:AI网络领域的领跑者 4.2. 思科系统:Nexus系列演进路径 4.3. 华为:面向智算网络的全面布局 4.4. 新华三:在共封装CPO与线性可插拔LPO技术领域的双重布局 4.5. 锐捷网络与中兴通讯 4.6. Juniper Networks QFX5240系列 5. 光互联革命:可插拔、线性驱动、线性接收与共封装技术的竞逐 5.1. 传统可插拔光模块(重定时/收发一体) 5.2. 线性可插拔光模块LPO(线性驱动方案) 5.3. 线性接收光模块LRO(半重定时方案) 5.4. 共封装光学技术CPO 5.5. 经济性分析:800G的总体拥有成本优势 6. 热管理与结构工程挑战 6.1. 风冷方案的局限性 6.2. 液冷技术的引入 7. 市场经济性与未来展望 7.1. 市场规模与预测 7.2. 厂商市场份额分析:全球竞争格局 7.3. 通往1.6T的演进之路 8. 写在最后

1. 引言:AI时代下的网络基础设施重构

1.1. 从云计算到人工智能工厂的范式转变

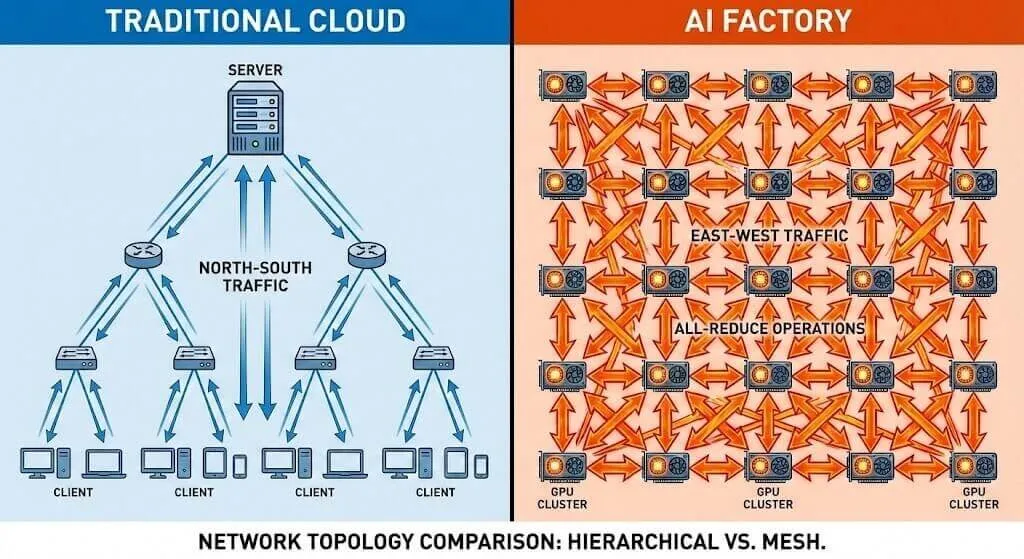

全球数据中心网络正在经历过去十年来最深刻的变革。此前,网络架构主要围绕云计算和互联网应用流量模式设计,以"南北向"客户端-服务器模型为主导。然而,随着生成式人工智能(以GPT-4为代表)和大语言模型的爆发,数据中心内部流量特征发生了根本性逆转。在AI训练集群中,成千上万甚至数十万张GPU执行全归约操作,产生海量"东西向"流量。这种流量具有高突发性、极高带宽需求以及对延迟极端敏感的特点。网络不再仅仅是连接计算单元的管道——它已成为决定整体计算效率的关键组件。在百万GPU规模的集群中,即使是微小的网络性能抖动,也可能导致昂贵的GPU计算资源处于闲置状态。

为应对这一挑战,数据中心网络必须从传统的400G架构加速迈向800G,并最终向1.6T演进。800G以太网不仅是带宽的翻倍,更是对网络拓扑结构、拥塞控制机制和物理层信号完整性的全面重新设计。分析表明,人工智能与机器学习工作负载正推动800G端口出货量在2025年创下历史新高,这一趋势将在未来五年重塑整个以太网交换机市场。

1.2. 800G技术驱动力与发展路线图

从技术演进视角来看,800G的商用部署比预期来得更早——这主要受AI算力需求的强力驱动。在摩尔定律趋缓的背景下,通过并行化扩展算力已成为唯一可行的路径,而并行效率从根本上受限于互联带宽。

带宽需求:AI模型参数量呈指数级增长,导致通信带宽需求每两年翻数倍增长,已远超摩尔定律的演进速度。800G端口可实现更高密度的互联,使单层交换机架构能够支撑更大规模的GPU集群,从而降低跳数与时延。

成本与能效:虽然单端口绝对成本上升,但800G在每比特成本与每比特功耗上相比400G具有显著优势。研究表明,800G方案通过减少光纤使用数量、提升频谱效率,能有效降低总体拥有成本。

本报告将深入解析800G交换机的技术标准、核心光电芯片格局、系统厂商解决方案,以及光互联技术(LPO/CPO)的革命性变革,并对向1.6T的演进路径作出展望。

2. 技术标准与物理层架构

2.1. 双轨并行:IEEE 802.3df与802.3dj标准

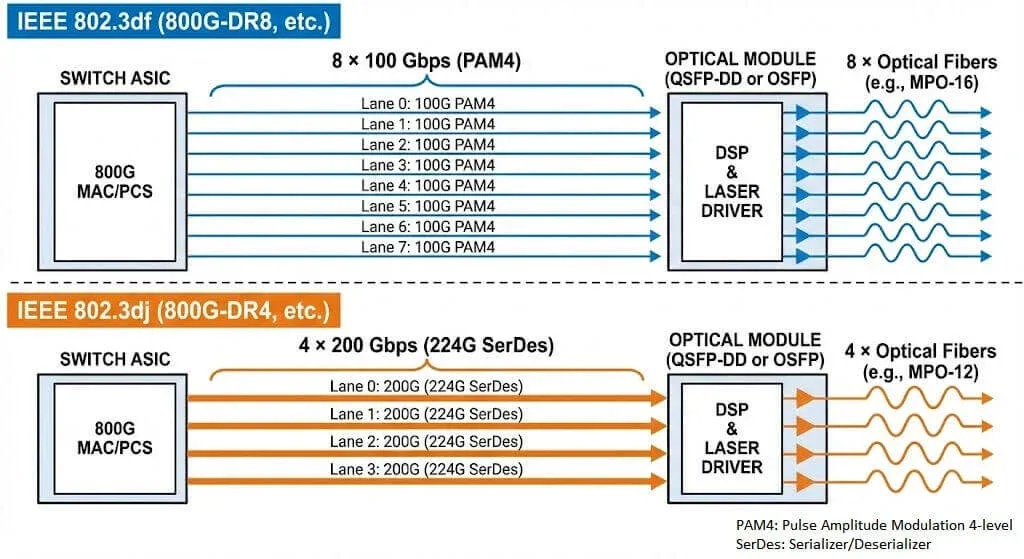

IEEE 802.3工作组在制定下一代以太网标准时采取了务实的分阶段策略。原P802.3df项目计划同时覆盖800G与1.6T速率,但由于单通道技术成熟度存在差异,该项目于2022年11月拆分为两个独立项目:IEEE 802.3df与IEEE 802.3dj。

IEEE 802.3df是当前800G部署的基石标准,其采用8条并行通道设计,每条通道以100 Gbps速率运行(实际使用PAM4调制时为106.25 Gbps或112 Gbps),从而聚合实现800G带宽。该标准通过利用成熟的100G/通道光电器件,推动了800G产品的快速商业化。例如,符合该标准的800G OSFP SR8光模块是典型产品,支持分路为两个400G链路或八个100G链路。

IEEE 802.3df是当前800G部署的基石标准,其采用8条并行通道设计,每条通道以100 Gbps速率运行(实际使用PAM4调制时为106.25 Gbps或112 Gbps),从而聚合实现800G带宽。该标准通过利用成熟的100G/通道光电器件,推动了800G产品的快速商业化。例如,符合该标准的800G OSFP SR8光模块是典型产品,支持分路为两个400G链路或八个100G链路。

IEEE 802.3dj则面向未来。随着交换芯片容量向102.4 Tbps迈进,单通道200G(224G SerDes)将成为关键。该标准不仅覆盖1.6T速率,还包括基于4条200G通道的“第二代800G”方案。这一演进将显著降低光纤布线复杂度与功耗,同时也带来了严峻的信号完整性挑战。

2.2. SerDes演进:从112G到224G

SerDes(串行器/解串器)是交换芯片与外部连接的关键接口。当前主流的51.2T交换芯片(如博通Tomahawk 5、英伟达Spectrum-4)均采用112G PAM4 SerDes。

112G技术挑战:在PCB走线上以112 Gbps速率传输信号会产生严重的介质损耗与串扰,这迫使系统设计采用超低损耗材料(如Megtron 7/8)或飞越电缆技术——通过从芯片直接连接至前面板接口来规避PCB损耗。

224G技术展望:下一代102.4T芯片将采用224G SerDes。在这一速率下,传统铜缆互连(DAC)的有效传输距离将大幅缩减,这将强力推动有源电缆(AEC)、线性驱动可插拔光模块(LPO)以及最终共封装光模块(CPO)方案的普及。

2.3. 调制格式与前向纠错技术FEC

为在有限带宽内传输更多数据,800G普遍采用PAM4(四级脉冲幅度调制)。相比传统NRZ编码,PAM4在每个符号周期传输2比特数据,频谱效率提升一倍,但信噪比损失约9.5 dB。

为补偿信噪比损失,必须采用强健的前向纠错机制。IEEE标准将RS(544,514)里德-所罗门码定义为基准方案。然而,前向纠错必然引入时延。针对需要超低时延的AI网络,部分厂商(如NVIDIA与迈凌Marvell)已在芯片设计中深度优化前向纠错方案FEC,并针对特定短距链路探索低时延前向纠错模式,以最小化端到端传输延迟。

3. 核心芯片格局:51.2T芯片的竞争

3.1. 博通:Tomahawk 5与Jericho3-AI的双重驱动

博通持续通过差异化产品线覆盖不同市场需求,以“全域主导”战略布局超大规模云与AI智算网络。

1)Tomahawk 5(StrataXGS系列):

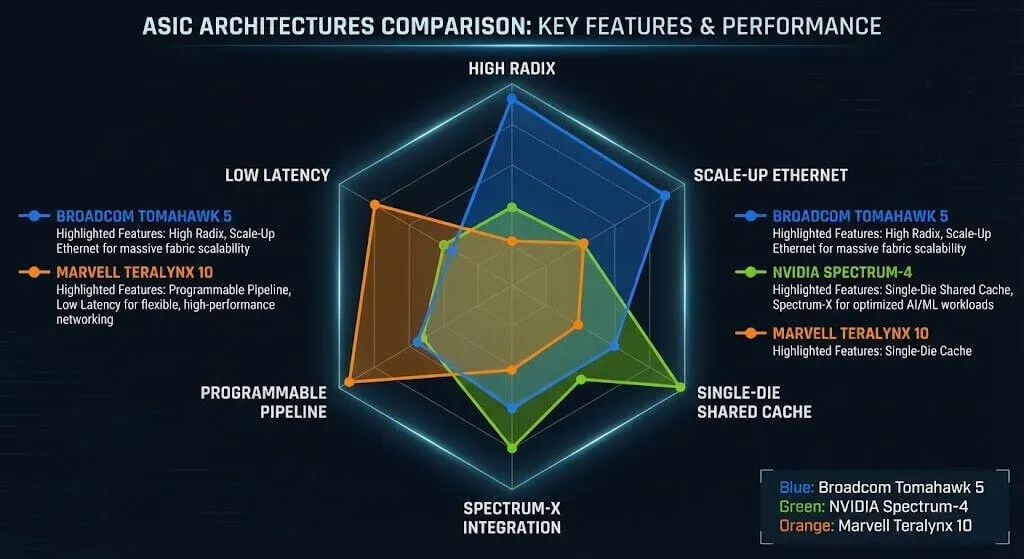

定位:面向超大规模数据中心Spine/Leaf层的高吞吐量芯片 规格:单芯片51.2 Tbps,支持64个800G端口或256个200G端口 架构亮点:采用5nm制程,集成512个100G PAM4 SerDes。除带宽外,Tomahawk 5引入了"纵向扩展以太网"特性,包括认知路由、动态负载均衡与全局拥塞控制功能。这些特性解决了AI流量中的哈希冲突问题,显著降低了尾部延迟。 时延表现:实现约250纳秒的超低转发时延——这对基于以太网构建高性能AI集群至关重要。

2)Jericho3-AI (DNX系列):

定位:针对需要深度缓存和复杂流量调度的AI后端网络核心层交换机 差异化特征:与Tomahawk采用的片上共享缓存架构不同,Jericho架构基于模块化VoQ(虚拟输出队列)和外置高带宽内存,可提供毫秒级缓存能力,以应对极端突发流量冲击,确保数万GPU集群中的零丢包传输。

3.2. NVIDIA: Spectrum-4的垂直整合逻辑

1)NVIDIA 不仅是销售芯片,更是提供完整的“AI工厂”互联架构。Spectrum-4是其以太网战略的核心,旨在通过Spectrum-X平台挑战InfiniBand在AI领域的主导地位。

2)Spectrum-4专用集成电路芯片:

规格:采用定制4N制程(优化的5nm),集成1000亿晶体管,提供51.2 Tbps带宽。 核心优势:单芯片共享缓存架构。与竞品可能采用的多片缓存架构不同,Spectrum-4采用完全共享的单芯片数据包缓存,使所有端口可动态共享整个缓存池,极大提升微突发流量的吸纳能力,确保跨端口的公平性与确定性低时延。 RoCE优化:作为Spectrum-X平台的核心组件,Spectrum-4与NVIDIA BlueField-3数据处理单元深度协同,实现端到端拥塞控制与遥测功能。这种软硬件集成方案使AI工作负载下的有效带宽利用率提升1.6倍。

3.3. 迈凌Marvell:Teralynx 10的可编程性与超低时延特性

1)通过收购Innovium,迈凌Marvell的Teralynx产品线已成为博通最强劲的竞争对手,尤其在云服务提供商市场表现突出。

2)Teralynx 10芯片:

规格:51.2 Tbps带宽,支持512条112G SerDes通道,可配置为64个800G端口。 低时延特性:宣称实现业界领先的低至500纳秒转发时延,并在不同数据包尺寸下保持确定性性能。 高端口密度:支持最多512个逻辑端口,可实现更扁平的网络拓扑(例如支持数万节点的两层架构),从而减少跳数、降低端到端时延与功耗。 可编程能力:搭载可编程转发流水线,允许客户在不更换硬件的情况下支持新路由协议或遥测标准,提供更强的投资保护能力。

3.4. 思科:Silicon One G100的统一架构

思科的Silicon One G100芯片虽主要应用于25.6T设备(如Nexus 9232E),但其体现了覆盖路由与交换市场的“统一架构”理念。G100采用7nm制程,支持32个800G端口,并突出高能效与统一P4可编程能力。

3.5. 芯片参数对比

| Parameter | Broadcom Tomahawk 5 | NVIDIA Spectrum-4 | Marvell Teralynx 10 | Cisco Silicon One G100 / G200 |

|---|---|---|---|---|

4. 系统厂商产品与解决方案

基于成熟的51.2T芯片,各大网络设备制造商已推出各自的800G交换机产品。这些产品不仅是芯片的简单封装,更在散热设计、电源管理、网络操作系统以及光互联兼容性等方面展现出工程实力。

4.1. Arista Networks:AI网络领域的领跑者

1)Arista凭借其EOS操作系统优势,在AI网络领域占据强势地位。

2)7060X6系列:基于博通Tomahawk 5芯片的旗舰800G产品线。

7060X6-64PE:2U固定配置交换机,配备64个800G OSFP端口,专为AI后端网络优化,搭载165 MB系统缓存以有效处理拥塞。 7060X6-32PE:1U设备提供32个800G OSFP端口,总容量25.6 Tbps,适用于较小规模集群或Leaf-Spine架构中的叶节点。 LPO技术支持:Arista是线性可插拔光模块技术的坚定推动者。7060X6系列明确支持LPO模块,通过去除模块内数字信号处理器,显著降低功耗与时延——这对大规模AI集群效率至关重要。

4.2. 思科系统:Nexus系列演进路径

1)思科通过Nexus系列持续巩固其在企业级与云市场地位,同时积极拥抱800G技术。

2)Nexus 9232E:思科首款1RU 800G交换机。

配置:32个QSFP-DD800端口,总容量25.6 Tbps,基于自研Silicon One G100芯片。 能效表现:思科宣称相比同等级模块化方案降低77%功耗并节省83%空间。支持2×400G、8×100G等分路模式,是理想的高密度核心交换机。

3)Cisco 8100/8800系列:面向服务提供商与超大规模数据中心,同样基于Silicon One架构并支持800G扩展。

4.3. 华为:面向智算网络的全面布局

考虑到以往涉及到国产算力、服务器、芯片、供应链的文章有相当比例由于种种原因被投诉删除的风险,本部分内容可参见同日发表的《800G交换机分析报告:中国厂商部分》进行收费阅读(不推荐,10微信号=1元)。

4.4. 新华三:在共封装CPO与线性可插拔LPO技术领域的双重布局

如上。

4.5. 锐捷网络与中兴通讯

如上。

4.6. Juniper Networks QFX5240系列

1)基于博通Tomahawk 5芯片。

2)规格:2U设备,支持64个800G端口(OSFP或QSFP-DD接口)。

3)管理特性:结合Apstra软件实现基于意图的网络管理,大幅简化AI Fabric的部署与运维流程。

5. 光互联革命:可插拔、线性驱动、线性接收与共封装技术的竞逐

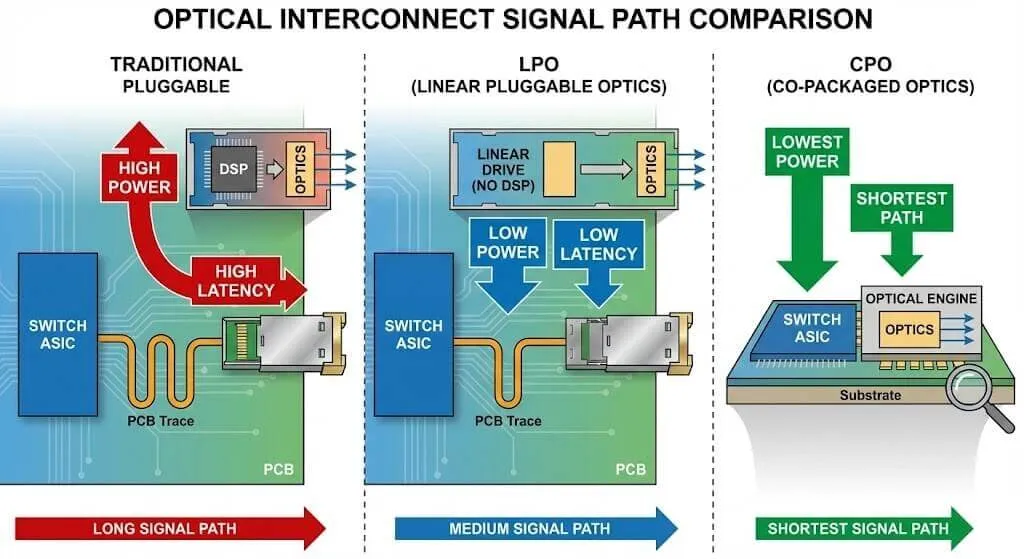

800G时代最大的技术变量不在电层而在光层。随着速率提升,光模块中DSP芯片功耗急剧攀升,成为系统能效瓶颈,由此引发了关于光互联形态的激烈争论。

5.1. 传统可插拔光模块(重定时/收发一体)

当前主流方案(QSFP-DD800/OSFP)。模块内集成数字信号处理器芯片DSP,用于信号重定时与均衡处理。

优势:生态系统成熟,互操作性良好,易于故障隔离与替换。 劣势:功耗较高(单个800G模块功耗16–20 W,其中约50%来自DSP)。在满载64端口的交换机中,仅模块功耗即可超过1000 W,带来巨大散热压力。

5.2. 线性可插拔光模块LPO(线性驱动方案)

线性可插拔光模LPO块被视为突破"功耗墙"最有效的短期方案,尤其在AI集群内部应用中表现突出。

技术原理:去除数字信号处理器DSP,仅保留跨阻放大器TIA与驱动芯片;均衡/重定时功能交由交换芯片的SerDes处理。 核心优势:模块功耗降低约50%(单模块节省约7 W),实现纳秒级时延缩减,并降低物料清单BOM成本。 技术挑战:对主机侧信号完整性要求极高,传输距离受限(约500米以内)。由于缺少数字信号处理器DSP的隔离功能,互操作性需依赖系统厂商与模块厂商深度耦合(如Arista的合作伙伴生态)。

5.3. 线性接收光模块LRO(半重定时方案)

作为线性可插拔方案与全重定时模块之间的折中方案。

技术原理:仅在接收(Rx)路径去除数字信号处理器DSP,发射(Tx)路径保留DSP以确保信号质量。 核心优势:相比纯线性方案具备更好的信号一致性与互操作性(发射Tx信号质量由模块DSP保障),同时仍比全DSP模块降低功耗/成本(但节省幅度约为线性LPO方案的一半)。 应用定位:适合希望降低功耗但对纯线性LPO方案风险存有顾虑的客户群体。

5.4. 共封装光学技术CPO

被视为摩尔定律下光互联的终极形态。

技术原理:将光引擎直接与交换芯片共封装在同一基板上,消除前面板可插拔接口。 核心优势:最大化缩短电信号路径 → 实现最低功耗与最高端口密度。 发展挑战:可维护性差(故障可能需整机更换),颠覆传统解耦式供应链生态。 当前进展:某国内厂商与博通已发布原型产品,但大规模商用仍局限于特定超大规模场景或未来储备。

5.5. 经济性分析:800G的总体拥有成本优势

虽然单端口价格高于400G,但在系统级总体拥有成本层面具备显著吸引力。

成本拐点:市场数据显示,到2025年单个800G端口成本已低于两个400G端口成本之和——"每比特成本cost-per-bit"拐点已经实现。 运营节省:基于线性可插拔LPO方案的800G解决方案可为大型数据中心每年节省数百万美元的电力与冷却成本。

6. 热管理与结构工程挑战

随着单芯片功耗逼近1000瓦(Tomahawk 5满负荷状态)与光模块密度持续提升,传统风冷方案正逼近物理极限。

6.1. 风冷方案的局限性

在2U机箱内散逸51.2T交换机的热负载(通常超过2000-3000瓦),将风冷系统推向极限。根据风机相似定律,风机功耗与转速的立方成正比。为维持可接受的温度,风机转速必须急剧提升,导致风机功耗本身占据系统总功耗的显著比例(通常>20%)——这种状况已不可持续。

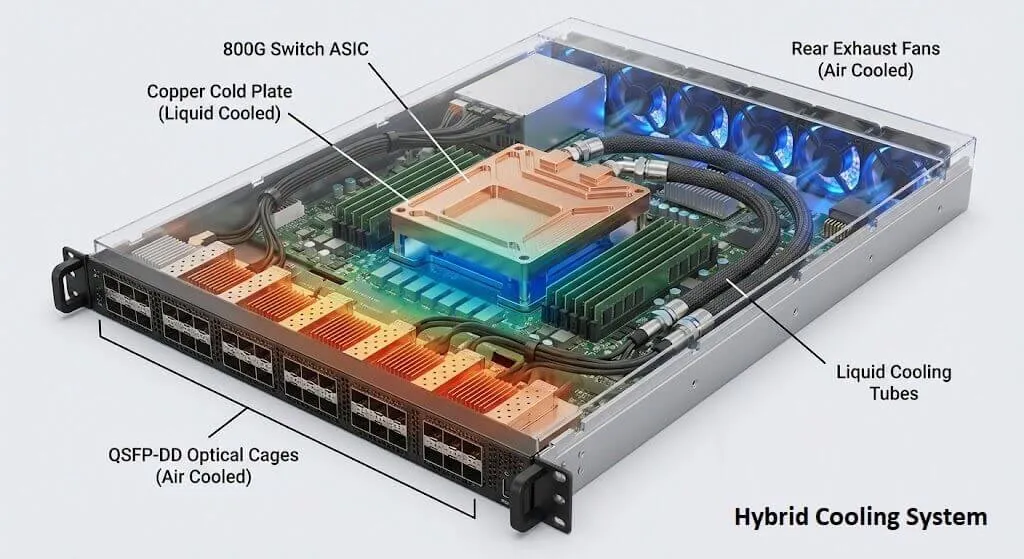

6.2. 液冷技术的引入

800G交换机正成为数据中心液冷技术应用的前沿阵地。

冷板式液冷:主要针对大功率专用集成电路芯片进行直接液冷散热,光模块仍采用风冷方案。这是当前最实用且应用最广的集成方式。 浸没式液冷:整机系统浸没在绝缘冷却液中。这要求光模块完全密封且与冷却液相兼容,目前已有厂商开发出适用于浸没环境的800G光模块。

系统设计创新:国内部分厂商产品均强调先进的热工程设计——采用正交架构优化气流路径,提供风液混合散热选项,并推动整体电能使用效率的降低。

系统设计创新:国内部分厂商产品均强调先进的热工程设计——采用正交架构优化气流路径,提供风液混合散热选项,并推动整体电能使用效率的降低。

7. 市场经济性与未来展望

7.1. 市场规模与预测

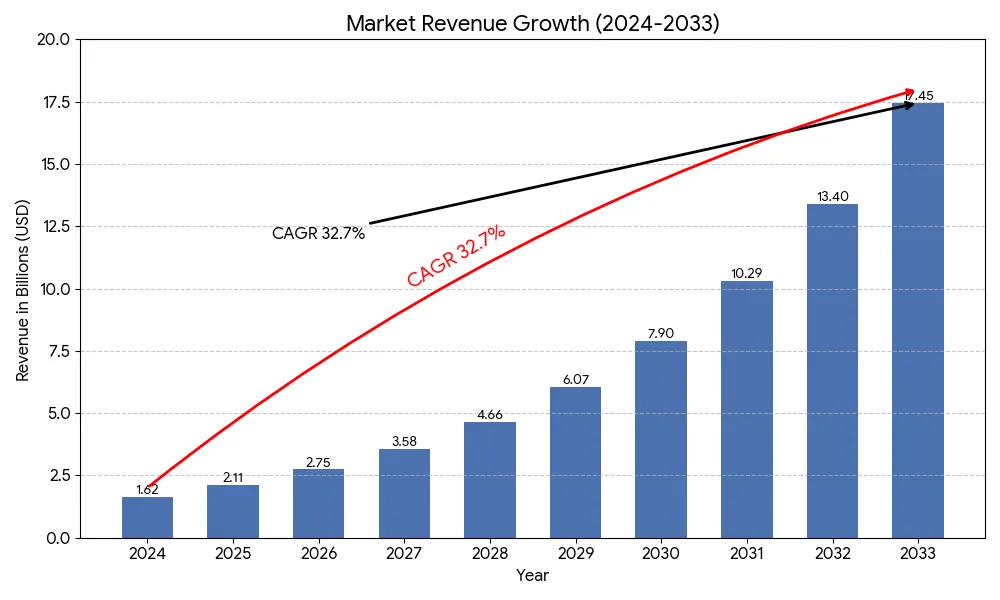

800G交换机市场正处于爆发式增长的初期阶段。

根据Dell'Oro与Dataintelo报告,2024年全球800G交换机市场规模约达16.2亿美元,预计到2033年将增长至174.5亿美元,年复合增长率达32.7%。 2025年被普遍视为"800G商用元年",端口出货量预计创历史新高——尤其在AI后端网络中,800G端口正快速替代400G与200G方案。

7.2. 厂商市场份额分析:全球竞争格局

全球市场格局(不含中国):Arista、NVIDIA与思科占据主导地位。Arista在超大规模云服务商中份额极高;NVIDIA在交钥匙式AI网络解决方案领域形成实质垄断。

中国市场格局:国内两某厂商构成双寡头态势。一家凭借自研芯片与庞大装机量占据优势;另一家则在采用共封装光学CPO等下一代技术方面更为激进。还有一家厂商作为活跃的挑战者,尤其在与大型互联网企业的白牌/原始设计制造商合作中表现突出。

7.3. 通往1.6T的演进之路

1)业界已将目光投向1.6T以太网技术。

2)芯片进展:博通Tomahawk 6(102.4T)与迈凌Marvell下一代芯片已列入路线图,预计2025–2026年提供样片。

3)技术挑战:1.6T将全面采用224G SerDes技术,这标志着实用铜缆互连(DAC/AEC)时代终结,推动线性可插拔LPO方案(极短距离)特别是共封装光学CPO技术走向主流。

4)时间线:随着IEEE 802.3dj标准预计2026年完成,早期1.6T部署将在2026–2027年启动,主要支撑下一代万亿参数模型的训练需求。

8. 写在最后

800G交换机远不仅是带宽升级——它们构成了AI时代数据中心的基础设施。物理层的极限挑战、光互联形态的剧烈变革(从传统可插拔→线性可插拔LPO→共封装光学CPO),以及专用AI网络特性的崛起(Spectrum-X、Tomahawk 5 AI增强、iLossless等),共同定义了这一技术周期。

对于企业与数据中心运营商而言,选择800G解决方案已不仅是比较端口价格。决策必须综合权衡端到端时延(直接影响AI训练效率)、散热与电力构成的总体拥有成本TCO(影响长期运营开支),以及长期供应链安全性。随着2025年价格拐点到来,大规模800G部署已成必然趋势。在这场竞赛中,最能有效解决"功耗墙"与"时延墙"双重挑战的厂商,将成为最大赢家。

关于于400G / 800G交换机与SuperNIC技术与市场情况更多的内容,可以参考: