本篇行业报告可以通过扫下方知识星球下载。39元就可以下载星球所有报告。免费提供报告查找服务。

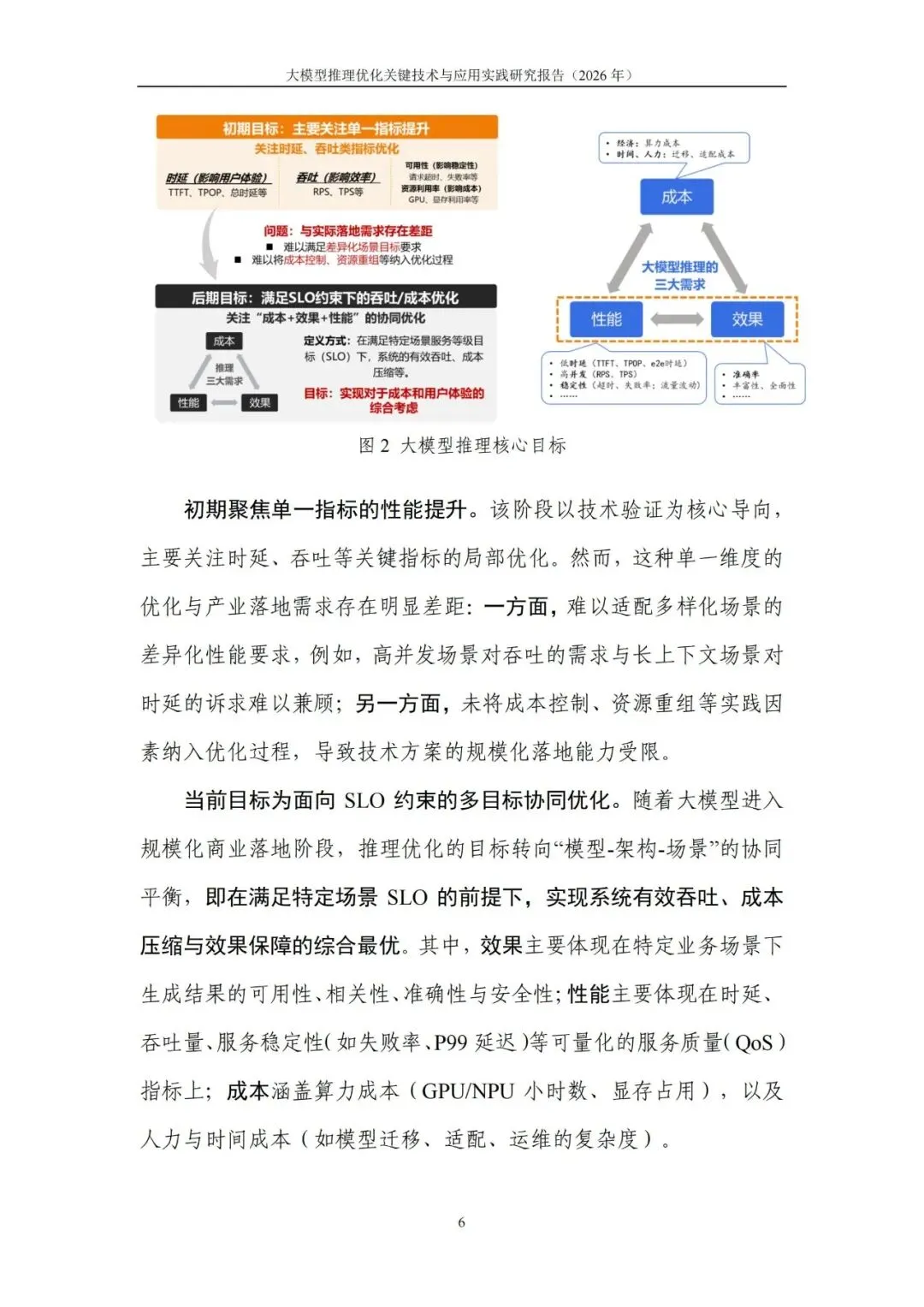

当前大模型产业已从训练转向推理,推理算力需求与成本快速攀升,长上下文、高并发、低时延等场景差异显著,传统单点优化难以兼顾效果、性能与成本,亟需全链路、系统性的推理优化体系。

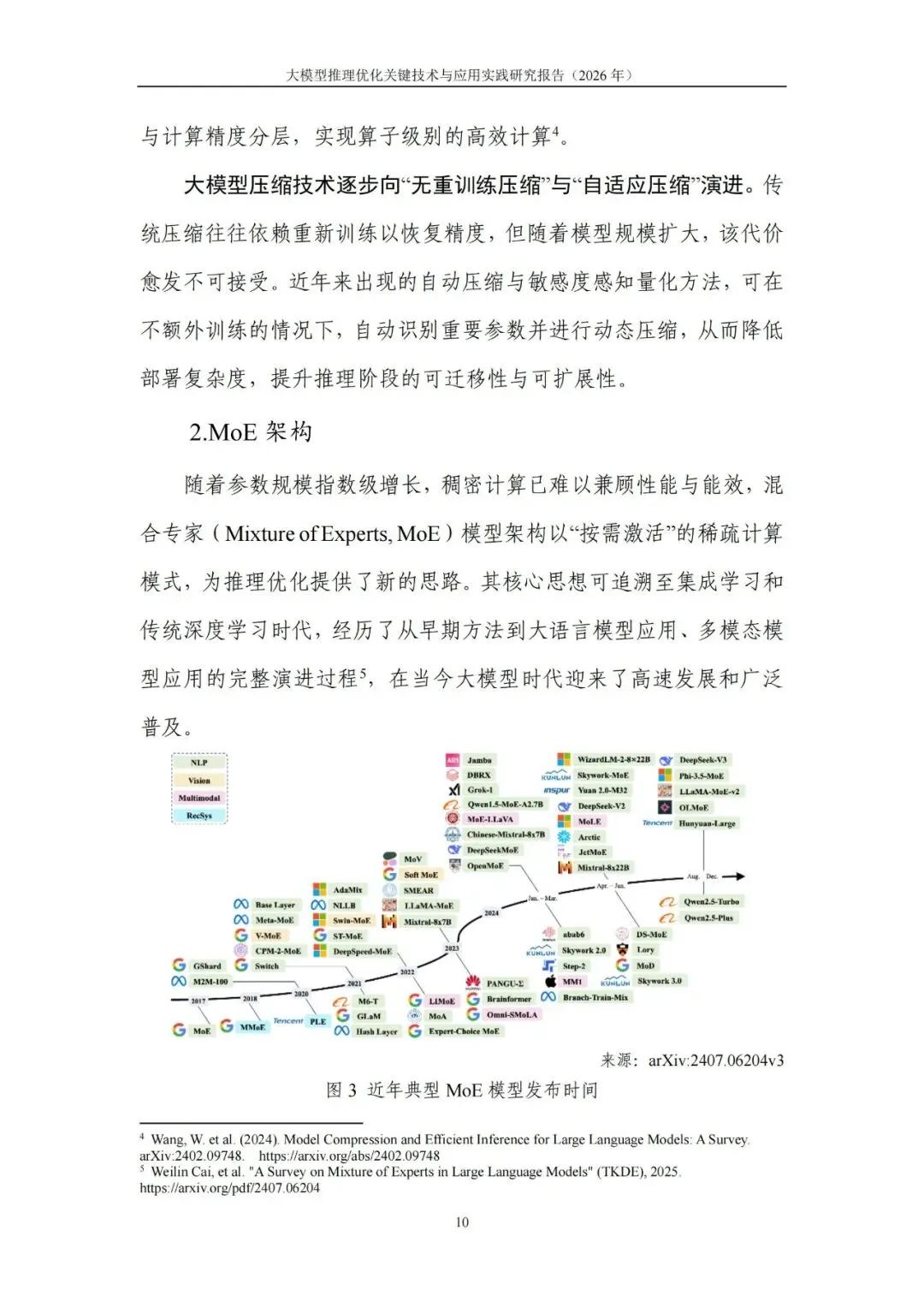

推理优化覆盖模型、引擎、系统三层,从源头到执行再到全局调度形成完整技术路径。模型层面以压缩、MoE 稀疏架构与算法创新为主,通过量化、剪枝、蒸馏减小计算开销,MoE 按需激活专家降低单次推理负载,MQA、GQA、MLA 等注意力改进与投机采样、多 Token 预测进一步提升生成效率。

引擎层面聚焦显存、计算、并行与调度优化,PagedAttention、前缀缓存、KV Cache 多级卸载缓解显存压力,FlashAttention、算子融合与硬件定制内核提升计算效率,数据、张量、专家、序列等混合并行策略适配超大模型,动态批处理、分块预填充提升请求处理效率。

系统层面以 PD 分离、AF 分离为核心架构,将预填充与解码、注意力与前馈模块解耦,匹配计算与访存特性,结合缓存亲和、负载感知调度与 HBM-DRAM-SSD 多级存储,实现资源高效利用与成本下降。

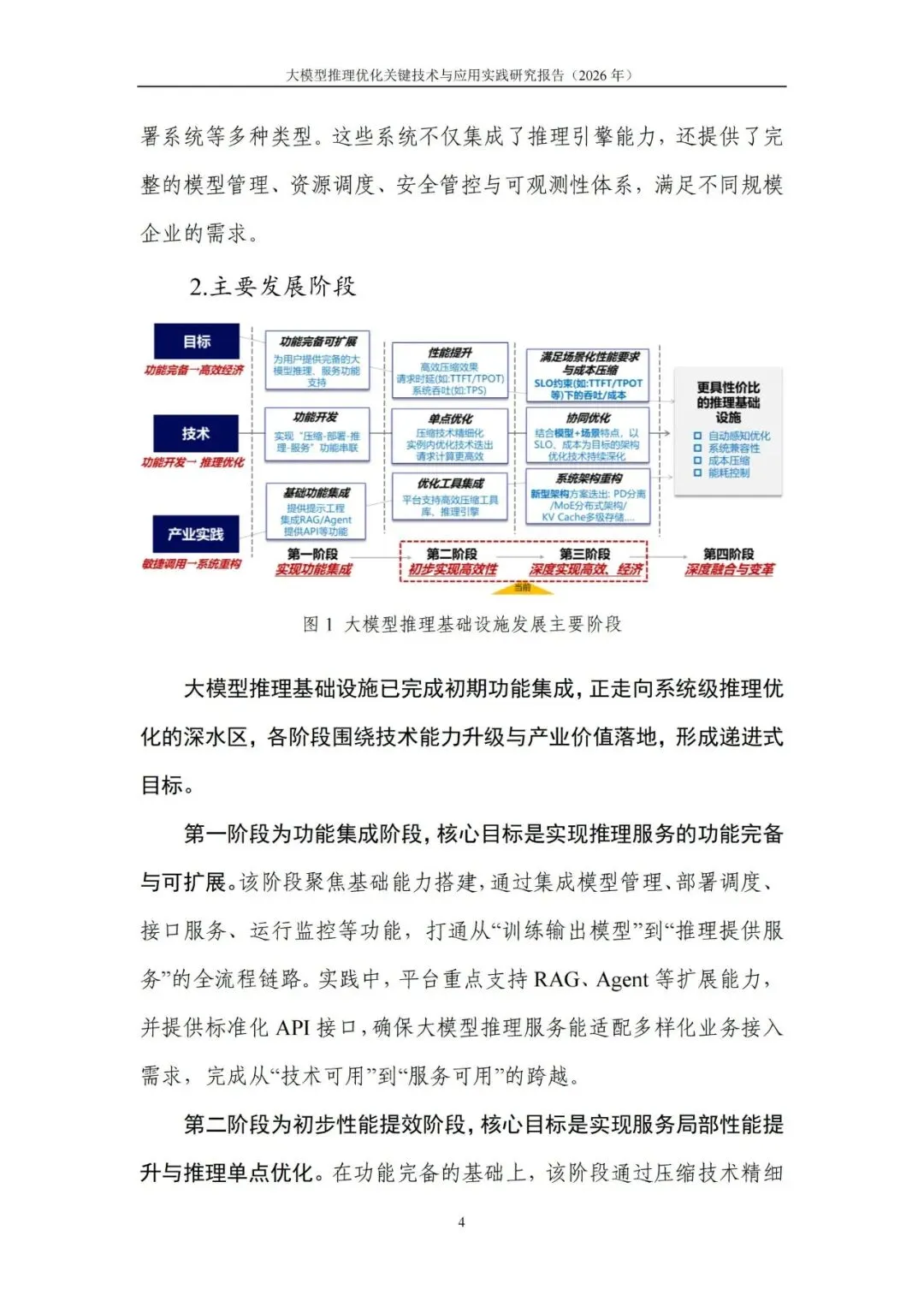

产业实践从平台功能完备逐步走向系统协同优化,早期以模型压缩与推理引擎单点提效为主,vLLM、SGLang、TensorRT-LLM 等引擎成为主流;后期 PD 分离、KV Cache 中心化管理、MoE 适配架构成为方向,Mooncake、Dynamo、UCM、DeepSeek、MegaScale-Infer 等方案实现规模化落地,有效提升吞吐、降低时延与成本。

在金融、运营商、电力、司法、农畜等行业,推理优化技术解决了长上下文处理慢、并发能力不足、成本过高的痛点。

金融领域借助 KV Cache 持久化与稀疏技术,将长文本推理时延大幅压缩;运营商通过训推一体与 PD 分离提升资源利用率;电力采用 MoE 轻量化与多级存储适配检修业务;司法以存算协同实现文书高效生成;农畜通过 PD 分离提升监控实时性与精度。

未来推理优化将向模型 - 架构 - 场景协同、异构算力精细化适配、自适应调度、多模态与长序列突破方向发展,持续降低成本、提升性能,推动大模型从可用走向好用、省用,成为行业数字化转型的核心支撑。

报告内容节选:

免费报告查找,请添加微信:

免责声明:以上分享报告为公开合法渠道获得,内容大部分来源于网络,版权归原作者所有,如有侵权,请及时与我们联系,我们将第一时间保障您的权益。推荐内容仅供参考学习,不构成投资建议。