报告 | 清华大学《AI幻觉深度研究报告》(免费下载PDF版本)

2026-04-27 11:20

报告 | 清华大学《AI幻觉深度研究报告》(免费下载PDF版本)

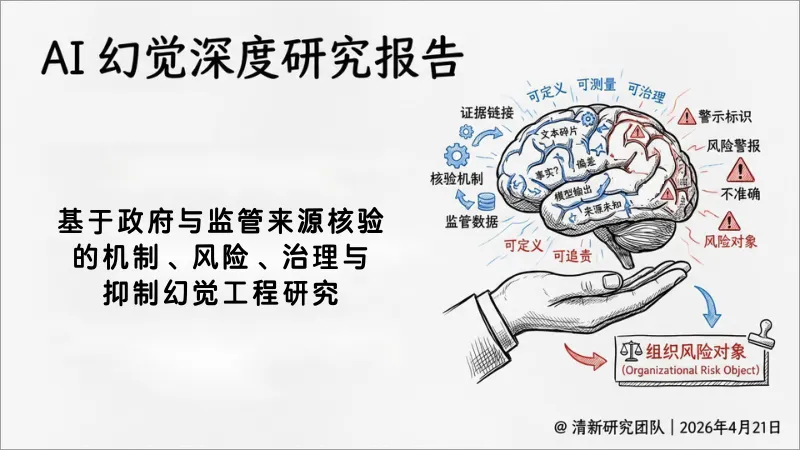

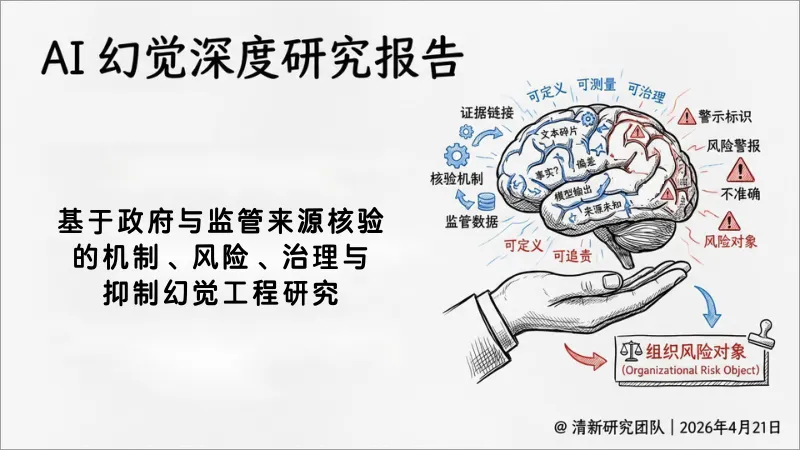

《AI幻觉深度研究报告》由清新研究团队于2026年4月21日发布。报告的核心论点在于,鉴于生成式AI的快速普及,必须重新审视并系统化地治理“幻觉”问题。报告基于美国国家标准与技术研究院(NIST)、英国政府、美国食品药品监督管理局(FDA)、美国审计署(GAO)及中国国家网信办等多个官方与监管机构的资料,对AI幻觉进行了深度分析。报告提出了三个总判断:幻觉不可被彻底消灭、高可信品牌会放大幻觉风险、抑制幻觉会带来新的权衡(如遗漏风险)。全文旨在将幻觉从一个模糊的技术热词,转化为可描述、可识别、可治理的风险单元,并为组织提供从认知到治理的完整行动路线图。PDF版本下载方式见文末。

本部分旨在厘清幻觉的定义、类型与根因,为后续治理奠定基础。报告采纳了NIST的定义,将幻觉(Confabulation)界定为模型自信地呈现错误或虚假内容,其范畴不仅包括事实性错误,还包括逻辑错误、引用错误和上下文错误。这一定义揭示了幻觉的核心风险在于其以可信的口吻误导用户。报告随后系统性地阐述了六类典型幻觉:事实性幻觉(编造事实)、引用性幻觉(伪造来源)、语境性幻觉(断章取义)、逻辑性幻觉(推理混乱)、行动性幻觉(错误执行指令)以及遗漏性幻觉(关键信息缺失)。报告强调,对组织而言,后五类幻觉在实际业务中可能比单纯的事实错误更具危害性。关于幻觉的根因,报告指出了五个关键机制。首先是统计生成机制本身,模型的本职是生成概率最高的文本而非连接外部真值。其次是知识边界与专业断层,模型在训练数据未覆盖的领域更易出错。第三是提示不充分与指令冲突,若系统未设计明确的“拒答”逻辑,模型会倾向于补全而非承认未知。第四是组织对速度与完整感的偏好,可能无意中鼓励了模型“硬着头皮回答”。第五是检索-生成错配(RAG的局限性),即即使检索到相关知识,生成环节仍可能产生偏差或编造。这些根因共同表明,幻觉是生成式AI固有的、持续存在的特性。本部分通过多个真实世界案例,揭示了实验室评估与真实应用的差距,并深入分析了不同高风险场景下面临的独特挑战。报告首先指出,离线基准测试无法完全模拟真实世界中提示模糊、信息更新、长链任务和用户多样性带来的风险,因此NIST建议采用持续的风险测量机制,包括红队测试和外部独立评估。随后,报告剖析了多个官方案例:英国GOV.UK Chat实验显示,高可信度的政府品牌会使用户降低警惕,反而放大了误信幻觉的风险,这警示公共服务、医疗、金融等权威界面需要更强的显性护栏。美国GAO的报告显示,联邦机构的生成式AI用例在一年内增长了约9倍,但治理能力(如合规、预算、政策)并未同步跟上,这使得幻觉从试验风险迅速转变为运营风险。英国药品和健康产品管理局(MHRA)的临床问答对比实验则揭示了一个关键权衡:使用RAG和严格护栏能显著压低重大幻觉,但也会提高系统的遗漏率和拒答率。这表明,单纯追求压低幻觉率并不等同于提升系统整体有效性,组织必须在“遗漏风险”和“幻觉风险”之间寻求平衡。此外,报告还讨论了教育、法律、研究和网络安全场景下的特殊风险,例如在教育中削弱学生的批判性思维,在法律研究中伪造引用链,以及在智能体(Agent)场景中,通过提示注入将文本幻觉升级为系统边界安全事件。本部分转向治理框架与工程实践,梳理了官方共识并提出了组织落地的具体路径。报告归纳了官方治理框架的三个共同点:第一,承认幻觉无法被一劳永逸地消灭,治理目标是持续测试、监测和优化;第二,在高影响场景(如法律、医疗)必须设置具备实际否决权的“人类在环”监督机制;第三,要求生成内容可标识、可追溯、并可反馈,中国监管要求的生成内容标识与备案制度即是这方面的体现,截至2025年底累计已有748款生成式AI服务完成备案。基于此,报告为组织提出了系统性的治理步骤。第一步是绘制任务风险地图,根据任务后果(高、中、低风险)和角色(草拟、问答、建议、自动执行等)配置不同的护栏强度。第二步是为高风险场景明确设置“禁用”或“降格使用”规则,例如禁止模型在健康、安全、法律等领域形成最终输出。第三步是确保人工复核“有意义”,即复核人需具备明确的职责、标准、权限和日志记录,而非形式化流程。随后,报告提出了“抑幻觉六层工程栈”:任务分级、知识锚定(如使用RAG)、生成约束(明确拒答逻辑)、验证校正、上线监控与日志、以及最终的责任治理制度。报告特别强调,在智能体场景中,抑幻觉工程必须与安全工程合并,实施最小权限、关键动作确认等安全措施,以防“说错”转化为“做错”。本部分提炼了五个原创概念,用于精准描述和治理组织实践中常见的幻觉风险误判。“概率真相陷阱”指用户将模型的流畅表达误判为事实准确性。“引用幻影链”指模型伪造引用来源,使错误信息在组织内以“已核验”的假象传播。“低置信高伤害区”指模型在自身依据不足时,却被用于处理高后果任务,形成危险地带。“遗漏-幻觉跷跷板”指治理中抑制幻觉与减少遗漏之间存在此消彼长的权衡关系,需按场景配置阈值。“责任折返门”指形式上设置了人工复核环节,但因流程不可证明、不可追责而无法实际落实责任,沦为“责任表演”。这些概念共同支撑了报告原创的“幻觉治理成熟度模型”,帮助组织评估自身处于“无意识”、“有意识”、“可管控”还是“内化”的哪个阶段。报告最后将前述分析压缩为一个为期90天的可执行行动路线图。在30天内,组织应识别并分类最危险的任务,建立初步风险矩阵。在60天内,应为核心高风险任务补上知识锚定(如部署RAG)和明确的拒答机制。在90天内,需将有意义的人工复核、全面的日志记录和持续监控机制制度化。报告的最终结论指出,未来组织的竞争力分水岭,不在于是否使用大模型,而在于能否驾驭它,即在模型不确定时令其停止,在高风险时让其退后,并将证据、流程、审计与责任同时嵌入系统,从而真正从“会用大模型”迈向“驾驭生成式AI”。关注本公众号后并台回复:

清华大学

即可领取完整版资料。

你可能还想看这些内容: