执行摘要:三个根本性判断

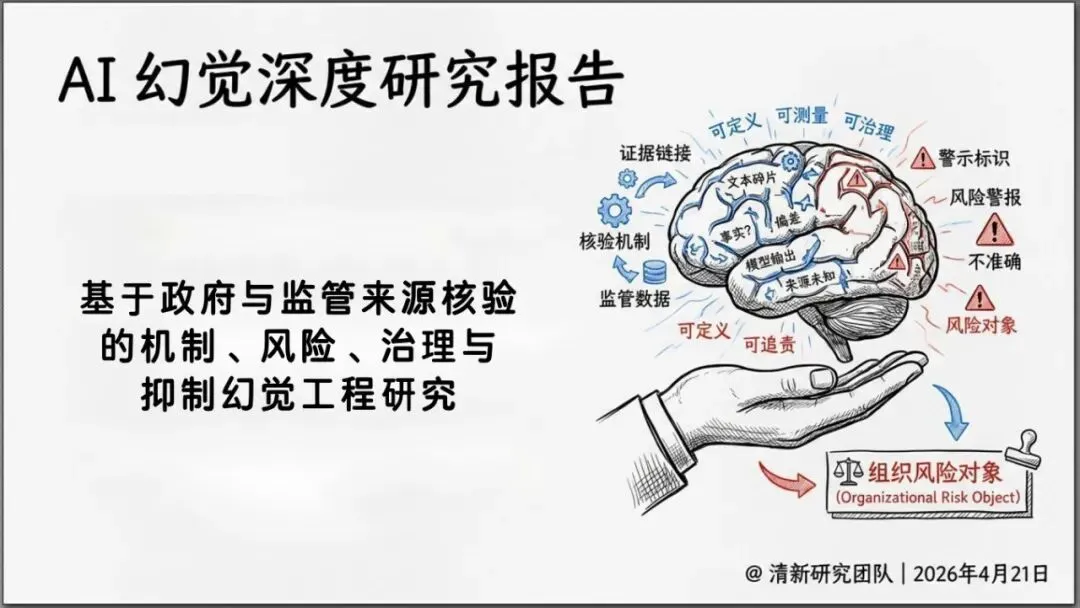

清华大学·清新研究团队最近发布了一份技术报告《AI幻觉深度研究报告》。

报告认为,生成式AI正从对话界面深入公共服务、医疗、金融、教育及自动化智能体(Agent)等核心领域,其输出错误(幻觉)的后果已从屏幕上的信息偏差,演变为可造成实质性损害的系统性风险。基于对全球主要政府与监管机构(如NIST、英国政府、FDA、中国网信办等)框架及实践案例的核验,本报告提出三个总领性判断:

- 判断一:幻觉是“生成-采信-执行”链条上的系统性风险,而非单点模型准确率问题。

风险核心在于用户(尤其是高可信品牌下的用户)对流畅输出的过度信任,以及错误信息穿透界面、进入业务流程并触发行动的可能性。 - 判断二:基准测试分数无法替代场景化风险评估。

幻觉的危害性必须置于后果严重度、错误可发现性、具体业务语境三维度中综合衡量。实验室的高分与真实世界的可靠性存在显著“测量缺口”。 - 判断三:有效的治理方案是“复合治理栈”。

不存在一劳永逸的“零幻觉”技术方案。真正稳健的治理依赖于检索增强生成(RAG)、结构化拒答机制、有意义的人类复核、全链路日志监测与清晰的责任制度等多层防御措施的协同。

报告旨在将“幻觉”从模糊的热词解构为可描述、可测量、可治理的风险单元,推动治理焦点从“追求更聪明的模型”转向“构建更可信、更可控的系统”。

第一部分:解构幻觉——定义、类型与内生性根源

1.1 重新定义:从“幻觉”到“虚构”(Confabulation)

美国国家标准与技术研究院(NIST)采用 “Confabulation” 一词,精准描述了生成式AI的核心缺陷:模型基于其训练数据的统计规律,自信地生成看似合理但不符合事实或特定上下文的内容。这一定义涵盖:

- 事实性错误:

编造事件、数据、实体。 - 逻辑性错误:

构建无效的因果或推理链条。 - 引用性错误:

伪造、错配不存在的来源、法规或引文。 - 语境性错误:

生成脱离具体场景(如国家、时间、专业领域)的通用但无效答案。

对组织而言,真正的危险在于这些错误常以高度流畅、结构完整、语气笃定的形式呈现,诱使用户将“表达质量”误判为“事实质量”,我们称之为 “概率真相陷阱”。

1.2 六类典型幻觉及其风险特征

| 事实性幻觉 | ||

| 引用性幻觉 | 法律、学术、政策研究、合规 | |

| 语境性幻觉 | ||

| 逻辑性幻觉 | ||

| 行动性幻觉 | 自动化工作流、机器人流程自动化(RPA)、API调用。导致直接的业务操作事故或安全边界失守。 | |

| 遗漏性幻觉 |

1.3 幻觉的五大内生性根源

- 统计生成机制的本质:

大语言模型(LLM)的核心任务是生成“概率上最可能的下一个词元”,而非追求“外部世界的真实”。其能力本质是“流畅补全”,这构成了幻觉的结构性起点。 - 知识边界与专业断层:

通用模型在实时信息、小众专业知识、组织内部数据方面存在固有盲区。NIST指出,在需要深度上下文和专业知识的开放式长回答中,失真风险最高。 - 提示工程与系统设计的缺陷:

若系统未明确指令模型“在不确定时如何拒答”,模型会默认以“完成回答”为首要目标,用生成填补知识空白。 - 组织文化与激励错配:

对“回答速度”和“答案完整性”的片面追求,会激励系统表现出更强的“生成姿态”,从而抬高用户误信的风险。 - 检索-生成错配(RAG的局限性):

即使采用RAG,也可能因检索质量差、文档过时、信息碎片化或生成模型“忽视”检索到的证据,导致生成内容与锚定知识源偏离。

第二部分:风险量化——从基准分数到真实世界影响

2.1 打破“基准分数迷信”

NIST等机构明确指出,实验室的静态基准测试与动态、复杂的真实世界应用之间存在巨大差距。离线测试无法充分评估:

- 提示的模糊性与多样性

- 信息的实时性要求

- 多轮对话与长链条任务

- 不同用户群体的使用模式差异

因此,评估幻觉必须引入三维度视角:

- 发生概率:

错误出现的频率。 - 严重程度与可发现性:

错误的危害等级,以及用户或系统自身能否轻易识别该错误。 - 下游影响:

错误被采信后,在特定业务场景中可能引发的连锁后果。

2.2 关键场景案例揭示的深层风险

公共服务(GOV.UK Chat实验):

- 发现:

尽管用户满意度不低,但实验中仍观察到幻觉案例。 - 核心洞察:

高可信品牌(政府、医院、高校)会放大幻觉风险。用户因信任品牌而降低对系统错误的警惕性,形成“品牌信任放大器”效应。这要求权威界面必须部署更显性、更严格的护栏。 医疗健康(英国MHRA模拟测试):

- 发现:

采用RAG和严格护栏的“SmartGuideline”系统,能显著降低重大幻觉,但同时也提高了遗漏率(拒答)。 - 核心洞察:

揭示了 “遗漏-幻觉跷跷板” 效应。治理目标不是单纯追求最低幻觉率,而是根据场景在 “错误回答” 和 “不回答” 之间寻求最优平衡。高风险医疗场景的基本原则是:“可信不在于总能回答,而在于知道何时不该回答。” 必须配备引用、不确定性提示和人工复核通道。 规模化应用与治理滞后(美国GAO报告):

- 发现:

联邦机构生成式AI用例一年内增长约9倍,但治理能力(合规、预算、政策)未同步跟上。 - 核心洞察:

AI正从试验性工具快速渗透至“写作、阅读、总结、跟踪”等核心办公流程。采用速度越快,对前置幻觉治理框架的需求越迫切,否则将积累巨大的运营风险。 网络安全(英国NCSC警告):

- 发现:

LLM易受提示注入、数据投毒攻击,且难以稳健区分“指令”与“数据”。 - 核心洞察:

在智能体(Agent)场景中,文本幻觉会升级为系统边界安全问题。恶意指令可能通过外部文本注入,导致模型执行未授权操作。因此,抑幻觉工程必须与安全工程(最小权限、操作确认、熔断机制)深度融合。

第三部分:治理框架——全球监管共识与组织实践

3.1 官方治理框架的共同原则

- 承认幻觉的不可根除性:

英美框架均明确指出,不存在永不产生虚构输出的模型。治理目标应从“追求零幻觉”转向 “建设持续的控制体系” ,聚焦于测试、监测、反馈和人类控制。 - 强调人类在环(Human-in-the-loop):

对高影响场景(法律、医疗、重大决策),必须保留有意义的、具备否决权的人类复核环节,避免流于形式的“责任表演”。 - 要求可追溯与可审计:

中国《生成式AI服务管理暂行办法》及《标识办法》强制要求对AI生成内容进行标识,并建立投诉反馈机制。这为责任界定和事后审计提供了制度基础,标志着治理进入规模化、制度化阶段。

3.2 组织级抑幻觉工程六层栈

有效的治理需要一套从战略到执行、从技术到制度的复合工程栈:

| L1: 任务分级与风险测绘 | 禁用清单(如最终医疗诊断)、辅助清单(如草拟报告)、启用清单(如创意脑暴)。 | |

| L2: 知识锚定 | ||

| L3: 生成约束 | 强制引用、结构化输出、核心能力:允许并优化拒答逻辑(“我不知道”)。 | |

| L4: 验证校正 | 事实核查、引用回溯、规则匹配、异常检测。 | |

| L5: 上线监控与日志 | 可观测性平台、幻觉案例埋点与收集、关键指标仪表盘(如幻觉率、拒答率)。 | |

| L6: 责任治理 |

智能体(Agent)场景特别警示: 当模型具备行动能力时,必须将L3-L5层的抑幻觉措施与网络安全领域的最小权限原则、操作确认机制、沙箱环境、熔断设计紧密结合,防止幻觉导致越权操作。

第四部分:原创概念与成熟度模型

基于前述分析,我们提炼出五个原创概念,以精炼地概括核心风险模式:

- 概率真相陷阱:

将语言流畅度误判为事实准确度的认知偏差。 - 引用幻影链:

模型伪造引用,使错误信息在组织内获得虚假权威并持续传播的污染过程。 - 低置信高伤害区:

模型自身依据薄弱,但组织却将其应用于高后果任务的危险地带。 - 遗漏-幻觉跷跷板:

治理措施在降低幻觉率与提高遗漏/拒答率之间存在的固有权衡。 - 责任折返门:

设置了形式化但无效的人类复核环节,导致风险既未被控制,责任也无人承担的治理漏洞。

为评估组织治理水平,我们提出“幻觉治理成熟度模型(H3M)”:

- L1 临时反应级:

视幻觉为偶发bug,事后修补。 - L2 初步规范级:

有基本使用指南和提示词规范。 - L3 系统控制级:

实施了工程栈(如RAG、拒答)和关键场景复核。 - L4 量化管理级:

建立了风险度量体系、持续监控和反馈闭环。 - L5 韧性融合级:

治理完全融入企业风控与合规体系,能动态适应新风险。

成熟度越高,组织越能将幻觉从“技术事故”转化为“可度量、可管理的运营风险”。

第五部分:行动路线图——从认知到驾驭

90天速赢行动计划

- 第1-30天:风险摸底与急刹

行动:全面盘点组织内所有生成式AI应用,依据风险矩阵识别出 “低置信高伤害区”。 产出:立即对最高风险任务实施 “禁用” 或 “降格为纯辅助工具” 策略。 - 第31-60天:基建加固与设防

行动:为中等风险任务部署 知识锚定(RAG) 和 结构化拒答机制。 产出:建立关键知识源清单,并在系统中明确植入“不确定性告知”与“信息不足”的响应模板。 - 第61-90天:制度构建与闭环

行动:为必须使用AI的高价值场景,建立 “有意义的人类复核” 流程与 全链路日志系统。 产出:明确的复核职责手册、可审计的日志规范、以及一个收集与分析幻觉案例的反馈闭环流程。

长期核心:构建驾驭能力

生成式AI竞争力的分水岭,不在于是否拥有最先进的模型,而在于能否系统性地驾驭其不确定性。未来领先的组织,将是那些能让AI在“知道时”提供精准助力,在“不知道时”坦诚停止,并在整个“生成-采信-执行”链条上嵌入证据、流程与责任的组织。

只有当治理深度融入技术架构与组织制度,我们才能真正释放生成式AI的潜力,同时筑牢其风险防线。

有任何疑惑的点,评论区,咱们继续聊~ ?

https://pan.baidu.com/s/169quzp4PrWjKRm6_EZBuSw?pwd=2sgd

提醒一句:以上资料请仅用于个人学习和研究之用,勿用于任何商业目的,切记!!!