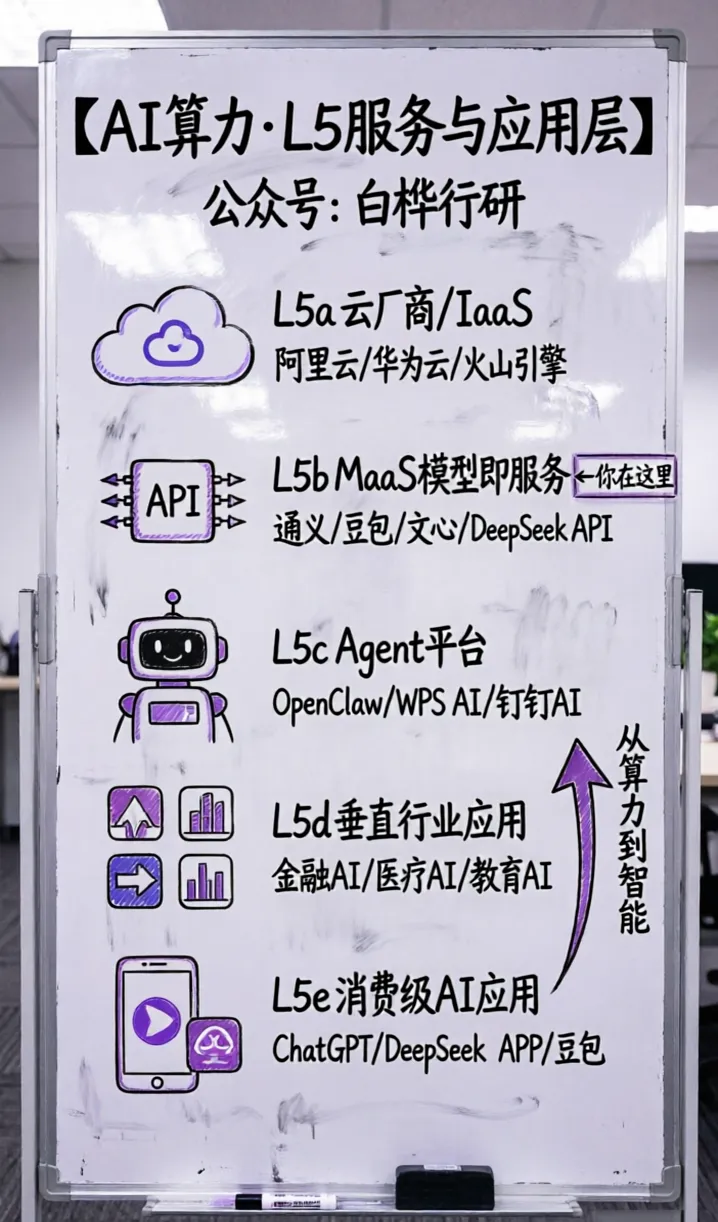

本文是AI算力产业链专题L5服务应用层第二篇。

上一篇:L5a 云厂商/IaaS。下一篇:L5c Agent平台

【AI算力·L5服务与应用层】

【L5b MaaS 三层架构与竞争格局】

2026年4月,中国AI行业发生了一件意味深长的事:大模型集体涨价。

腾讯云混元模型输入价格暴涨463%;智谱AI年内三次提价,旗舰模型API价格接近翻倍;阿里云停售低价套餐,算力卡涨价5%-34%;百度智能云跟进上调5%-30%。连海外的AWS、Azure都同步涨价。

就在几个月前,这些厂商还在拼命降价——2024年5月,字节跳动率先开枪,豆包Pro定价较行业均价低99.3%;随后通义千问降价97%,文心大模型直接免费,混元降价87.5%。百万Token从几百元被打到不足一元。

一边是日均Token调用量从2024年初的1000亿飙升至2026年3月的140万亿,两年增长1000倍;另一边是API价格先暴跌再暴涨,一年内完成从"免费送"到"开始收"的180度转弯。

问题来了:MaaS这场仗,到底是"烧钱换生态"的经典互联网剧本,还是一门根本跑不通的亏本生意?价格战结束之后,谁在收割,谁在裸泳?

01

MaaS到底在卖什么?

MaaS(Model as a Service),模型即服务。卖的不是模型本身,而是模型的调用能力——按Token(词元)计费,用多少付多少。

你不需要自己训练模型、不需要买GPU集群、不需要部署推理服务——调一个API接口,传一段文字,模型把结果返回给你。就这么简单。

但这个"简单"背后,藏着三个层次:

基座模型层:参数动辄千亿万亿,训练一次成本上亿(GPT-4训练成本约1亿美元)。这是"炼油厂",少数巨头才玩得起

推理服务层:把训练好的模型部署到GPU集群上,实时响应用户请求。这是"加油站",核心成本是算力和带宽

开发者生态层:SDK、文档、工具链、社区。这是"会员体系",谁生态强谁锁得住人

所以MaaS的本质不是"卖模型",而是"卖Token"——把模型能力变成可计量的标准化商品,像水电煤一样按量计费。 用的人越多,边际成本越低;生态越粘,切换成本越高。

这跟云计算的故事一模一样:先免费送你用,等你离不开我了,再慢慢收钱。

02

Token经济:你以为按字收费,其实按"切法"收费

同一个prompt(提示词),换个模型,Token数能差10倍——你付的不是"字数",是别人定的"切法"。

Token不是字,是模型把文字切成的碎片。就像超市切西瓜——有人对半切,有人切成八块,还有人切丁。切法不同,块数天差地别,但你按块数付钱。英文在大多数模型里一个词≈1个Token,中文就没这么好运了——早期GPT-3切中文,一个汉字能切成2-3个Token,同样一段话,中文比英文贵2-3倍。后来Claude、通义千问优化了中文切词,把比例压到了1.3-1.5:1,这才没那么离谱。更关键的是,不同模型的切词器(Tokenizer)互不兼容——你在豆包上跑的prompt,搬到文心上一跑,Token数完全不一样。同一个需求,这家用2000Token搞定,那家可能要5000。所以API价格表面上是"每百万Token多少钱",实际上你根本没法直接比价——得看你的实际场景,用各家API跑一遍,才算得清楚到底谁便宜。

说白了,Token计费看起来像水电煤按表走字,实际上"水表"是各家自己造的,刻度都不一样。比价之前,先搞清楚你家的表怎么转。

Token经济直接决定了MaaS的商业模式。我们来算一笔账:

一个Token推理成本多少?

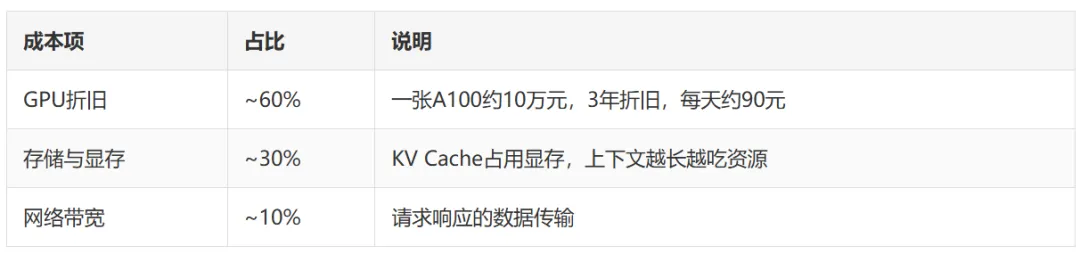

拆开来看,推理成本的大头是三块:

一台H100服务器(8卡),每天折旧+电费+运维大约6000-8000元。如果GPU利用率能做到80%,一天能处理约5000亿Token,折合每百万Token成本约1.2-1.6元。但现实是——很多MaaS厂商的GPU利用率不足40%,剩下60%在空转,折旧照算,成本翻倍。

就像开酒店,房间毛利70%,空置一半照样亏。谁把利用率打上去,谁活着。

03

市场有多大?MaaS正处于"量先于价"的爆发期

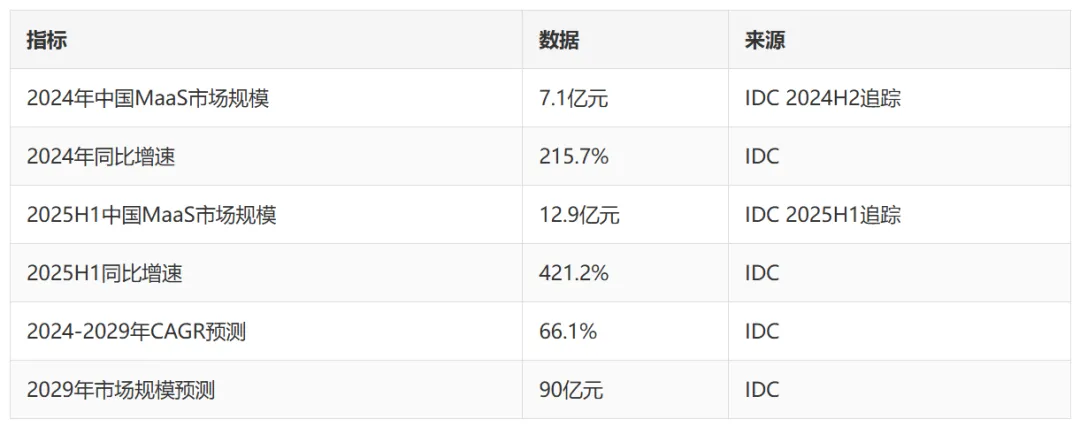

先说结论:MaaS市场目前不大,但增速恐怖。

12.9亿是什么概念?2024年中国公有云IaaS市场规模约2000亿,MaaS连零头的零头都算不上。

但Token调用量告诉我们另一个故事:

2024年5月,火山引擎日均Token 1200亿

2025年5月,16.4万亿

2025年12月,63万亿

2026年3月,120万亿

不到两年,1000倍增长。国家数据局局长刘烈宏在2026年3月公布:中国日均Token调用量已超140万亿。

核心判断:MaaS正处于"收入规模小、但调用量爆发"的阶段——典型的"量先于价"增长模式。 就像当年的云计算,先是用量暴涨(所有人都来试试),然后才是收入兑现(从免费转付费)。

04

谁在打?火山引擎的"量价悖论"

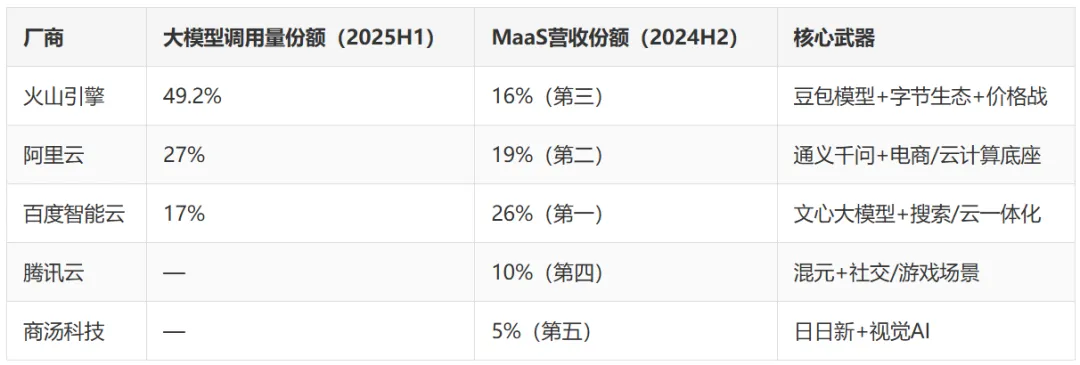

中国市场格局

调用量占了一半,营收只拿16%——火山引擎到底是赢了还是亏了?

把火山引擎拆开看,它走的是一条"用补贴换Token"的路——豆包Pro定价较行业均价低99.3%,近乎白送。效果确实炸裂:日均Token从2024年5月的1200亿飙到2026年3月的120万亿,两年1000倍。调用量市场份额49.2%,碾压式领先。但营收份额只有16%,说明一半的Token是免费或近乎免费送出去的。这像什么?像滴滴当年打车1元、美团外卖首单0元——用亏损换规模,赌的是用户习惯养成后跑不掉。

火山引擎确实在锁生态:累计Token超万亿的企业从100家涨到140家,工具链开发效率号称提升300%。但问题是——MaaS不是打车,开发者换API的成本比换打车软件低得多。接口地址一改、SDK一换,就能跑路。所以"量能不能转化为价",不是时间问题,是粘性问题。

说白了,火山引擎赢的是声量,还没赢到账上。低价拉来的用户,能不能在涨价后留下来,才是真正的生死考。

全球市场:三巨头格局初现

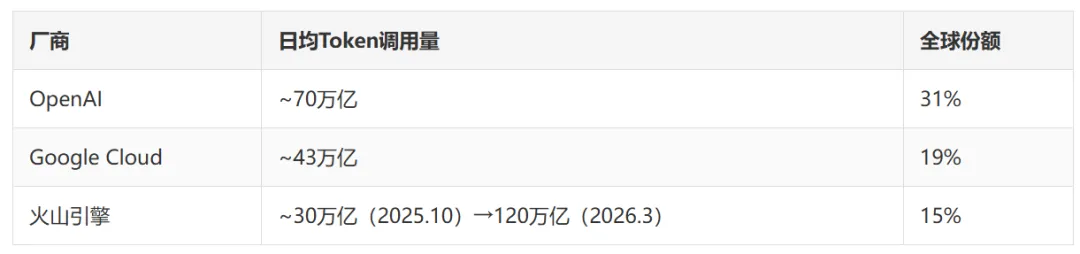

Omdia 2025年10月数据显示,全球MaaS市场已形成三强格局:

三巨头合计65%的份额,格局比IaaS(三大云62%)集中度更高。

为什么MaaS格局形成得比云计算快这么多? 因为模型能力的网络效应比基础设施更强——模型越好,用户越多;用户越多,数据越多;数据越多,模型越好。正向飞轮一旦转起来,后来者几乎不可能追上。

05

价格战→涨价潮:囚徒困境是怎么崩的?

去年API降了99%,今年又涨了463%——这帮人到底在搞什么?

2024年5月,豆包Pro一枪打响价格战,百万Token定价0.0008元,比行业均价低99.3%。通义千问跟进降97%,文心直接免费,混元降87.5%——三个月内,百万Token从几百元打到不足一元。这不是理性定价,这是囚徒困境:谁先停战谁吃亏,谁最后活着谁收割。但为什么2026年突然集体涨价了?

根因是"AI Agent爆火"——当AI开始"机器为机器打工",一个用户请求背后可能触发5次、10次、甚至100次子调用,Token消耗指数级裂变。火山引擎日均Token从16万亿飙到120万亿,就是Agent潮水带来的。GPU和HBM产能追不上这个速度,HBM 2026年Q1价格翻倍,高端GPU一卡难求,H100租金从1.70美元/小时涨到2.35美元/小时,涨40%。成本端顶上来了,再送不起。更硬的证据来自潞晨科技:他们算过一笔账,跑DeepSeek-R1满血版,月收入450万,月机器成本4.5亿——月亏4个亿。价格战不可持续的底牌,就这么被翻出来了。

说白了,价格战是大家一起赔钱赌未来,Agent爆发让赔钱速度远超预期,没人赔得起了,囚徒困境自然崩盘。涨价不是贪婪,是活命。

2024-2025年:烧钱抢生态

2026年:集体涨价

06

政策让不让干?

MaaS的政策环境,比IaaS多了一层"算法监管"的紧箍咒。

整体态度:✅鼓励发展 + ⚖️合规收紧

关键判断:政策对MaaS是"鼓励+规范"——鼓励大模型发展,但通过备案和安全评估抬高门槛。结果是头部集中加速,中小厂商无力承担合规成本,只能选择调用大厂API而不是自研模型。

07

怎么赚钱?MaaS的盈利公式

收入与成本

收入 = Token调用量 × 单价

成本 = GPU采购/租赁 + 电力 + 带宽 + 研发 + 合规

问题在于:

成本端刚性上涨:HBM存储2026年Q1价格翻倍,高端GPU一卡难求

单价端先跌后涨:降价抢份额时,推理算力毛利率为负数;涨价后才能覆盖成本

调用量不是收入:大量Token来自免费额度,付费转化率才是关键

MaaS毛利结构:规模效应后,MaaS毛利率50%-70%,远高于IaaS的15%-25%。但当前大部分厂商还在亏损——因为价格战期间,毛利是负的。

推理优化的技术壁垒

价格战拼的不只是谁敢亏钱,还有谁更会省——推理优化是MaaS的隐藏技术壁垒。

KV Cache(键值缓存)量化:能省40%-60%显存,同等GPU多服务一倍用户

批处理调度:把零散请求打包处理,GPU利用率从40%提到70%+

模型蒸馏/量化:把大模型压缩成小模型,推理成本降一个数量级

曦望S3方案号称能把Token成本再降90%。这意味着——同样一个Token,技术强的厂商成本可能只有对手的1/10。 价格战打到最后一地鸡毛,活下来的不是最有钱的,是最会省的。

08

开源威胁:模型免费了,MaaS还卖什么?

DeepSeek R1开源,意味着有技术能力的团队可以自己部署,跳过MaaS厂商。但"能用"和"好用"是两码事——

自部署DeepSeek-R1满血版:需要8张A100(约80万元硬件投入),每小时电费+运维300+元,一个月十几万。这还没算运维人力和弹性扩缩容。

对比之下,调MaaS API,按量付费,零门槛。中小开发者90%以上会选API,不会自建。

但开源确实在挤压MaaS的定价空间——当一个模型开源了,任何人都能跑,你就很难对它收高价。MaaS的利润只能来自两类:独占模型能力(GPT-5/Claude这类不开源的)和推理服务效率(同样的模型,我跑得比你便宜10倍)。

09

在产业链里的位置

MaaS处于L5(我们自己定义的文章框架:L5是服务与应用层)的中上层,是"算力"到"智能"的转化枢纽:

- 对上游(L5a云厂商/L4基础设施):依赖GPU算力,上游涨价直接吞噬利润。MaaS厂商对英伟达/华为几乎没有议价权

- 对下游(L5c-L5e应用):提供AI能力接口,是所有AI应用的"供水站"。一旦生态形成粘性,切换成本极高

- 自身:MaaS毛利50%-70%(规模效应后),远高于IaaS的15%-25%。但当前大部分厂商还在亏损——因为价格战期间,毛利是负的

MaaS是整个AI产业链的"利润转化器":把上游的算力成本(硬件)转化为下游的智能能力(API),中间的差价就是MaaS的价值。差价越大,MaaS越赚钱;差价越小,MaaS越苦逼。

结论:一个"上游被卡、下游可粘、竞争惨烈"的夹心生意

供应商议价力:强。 GPU和HBM是绝对卖方市场,英伟达毛利率70%+,MaaS厂商对上游几乎没有议价权。2026年HBM价格翻倍,成本端刚性上涨。

购买者议价力:中偏强。 开发者切换API的成本不高(换个接口地址的事),但生态粘性(工具链/社区/历史数据)提供了一定锁定效应。大客户(BAT/字节)自研能力强,议价权在他们手里。

新进入者威胁:低。 训练一个千亿参数模型成本上亿,加上算法备案和安全评估的合规门槛,小玩家几乎不可能入场。开源模型降低了部分门槛,但推理服务的规模效应仍然是大厂的护城河。

替代品威胁:中等。 开源自部署是最现实的替代方案,但运维成本和弹性能力远不如云服务,中小开发者还是会选择MaaS。

现有竞争者对抗:极其激烈。 价格战打到毛利率为负,三个月内API价格暴跌99%又暴涨463%。这是典型的"囚徒困境"——谁先停战谁吃亏,谁最后活着谁收割。

综合判断:MaaS正处于从"烧钱抢份额"到"涨价收割"的临界转折点。

三种情景推演:

最可能的结局是第三种:基座模型(GPT-5/Claude/豆包/文心)被少数巨头垄断,高价收费;开源模型(DeepSeek/千问)在成本敏感场景分走份额;MaaS厂商的利润取决于"垄断基座+开源长尾"之间的平衡点。

投资视角:看MaaS厂商,盯三个指标——日均Token调用量增速(看需求是否持续爆发)、付费开发者数量(看生态锁定深度)、涨价后的留存率(看用户是不是真离不开你)。2026年的涨价潮,就是第一块试金石。

上一篇:L5a 云厂商/IaaS——万亿赛道的旧王与新赌下一篇:L5c Agent平台

免责声明:本文仅供参考,不构成任何投资建议。股市有风险,投资需谨慎。文中数据来源于公开资料,如有出入以官方发布为准。