NEWS

焱融参编信通院推理优化研究报告

近日,中国信息通信研究院(简称“中国信通院”)人工智能研究所联合中国人工智能产业发展联盟(简称 AIIA)正式发布《大模型推理优化关键技术及应用实践研究报告(2026年)》,系统梳理了大模型推理产业挑战、核心优化技术、落地成效与发展趋势,助力实现精准、高效、经济、绿色的推理规模化应用,加速大模型产业从技术创新迈向高质量普惠发展新阶段。

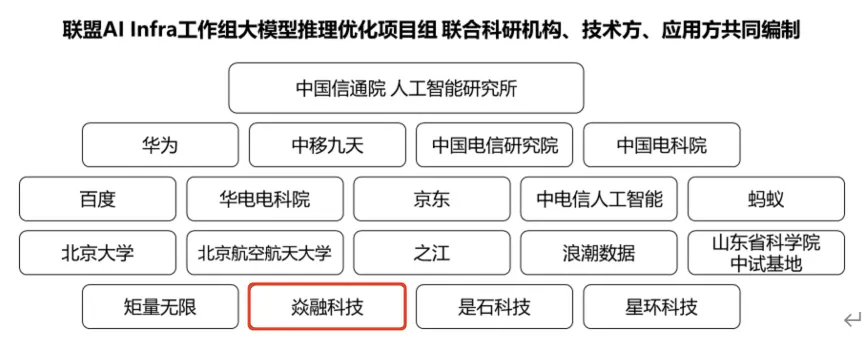

作为中国 AI 存储领导者,焱融科技基于自身在推理存储及 KVCache 优化等方向率先取得的技术突破与产业实践,深度参与了本次报告编制,为报告提供了积极的技术、实践经验贡献与产业洞察,与产业各方共同推动大模型推理优化技术的规模化落地与持续演进。

推理时代 存储成 AI 规模化落地关键推动力

当前,大模型产业已全面迈入推理时代。多模态普及、长上下文激增、Agentic AI 爆发,驱动推理需求呈指数级增长。2026 年初,我国日均 Token 调用量突破 140 万亿,两年增长超 1400 倍,推理计算量两年间增长达 1 万倍,服务平均序列长度两年增至 2.7 倍。同时,成本与性能的平衡成为产业核心命题,单纯依赖硬件升级已难以满足高效、经济、稳定、绿色的规模化应用需求。

《大模型推理优化关键技术及应用实践研究报告(2026年)》指出,AI 存储成为大模型推理系统优化的重要驱动力。当前,通过 KVCache 数据卸载、外置存储、分层缓存等技术手段突破 GPU 显存瓶颈,已成为降时延、提吞吐、优成本的有效路径。

在这一方向上,焱融科技的技术突破,正是存储驱动推理优化路径的典型实践范本。

焱融 YRCache:以存储突破

推理“显存墙”,推理性能与成本双优

作为高性能 AI 存储领域的领先者,焱融科技早在 2025 年初推理需求兴起之初,便率先布局“推理存储”方向,发布焱融 YRCache 推理存储系统,围绕 AI 推理场景进行系统级产品建设,构建多级 KVCache 缓存架构,显著扩展缓存空间,实现多项关键技术突破:

面向推理的数据访问优化

针对 KV Cache、热数据访问特征,优化数据路径与缓存机制,支持高并发、小 IO、低时延的数据访问模式,显著提升推理响应效率。

存储与计算协同设计

提升数据到 GPU 的数据流效率 ,降低数据搬运开销,提升整体推理吞吐,有效降低单位 Token 计算成本。

面向 Agentic AI 的“记忆能力”支撑

支持长上下文、多轮交互推理的数据管理,构建面向 AI Agent 的大规模持久化记忆基础设施,释放复杂智能应用潜力。

推理成本优化

通过缓存复用与数据调度优化,减少算力资源浪费,提升 GPU 利用率,实现整体投资回报率(ROI)的显著提升。

今年 3 月,开放数据中心委员会(ODCC)发布首批 KV Cache 评测结果,再一次印证了 YRCache 在推理性能与成本优化上的领先能力:TTFT 和 TPOT 可降低 97%,系统 Token 吞吐量提升 22 倍,带动 Token 收益实现千万级增长。更具战略价值的是,YRCache 让中低配置 RTX 6000D GPU 跑出了接近高端 H20 GPU 的推理性能,投资回报率(ROI)提升高达 14 倍,从根本上重构企业AI推理的成本结构。(测试结果深度解析)

AI 正加速迈入“智能原生时代”,算力、数据与系统的深度协同将成为产业发展的关键驱动力。在这一进程中,推理基础设施的重要性持续上升,而存储,已成为决定 AI 系统性能与成本结构的核心变量之一。未来,焱融科技将持续深化 AI 存储技术创新,以更高效的数据基础设施,支撑 AI 更好更快走向规模化落地应用。

点击文章下方“阅读原文”查看完整报告。

MORE

更多您感兴趣的内容推荐

增速第一 排名跃升|焱融全栈AI存储加速市场突破 IDC报告

焱融存储与沐曦股份完成产品兼容性认证,共推国产AI基础设施自主可控

推理存储新标杆丨焱融首批通过ODCC KVCache测试认证

中低端GPU也能跑出高端性能|焱融AI存储降低Token成本关键路径

焱融科技完成近亿元 C 轮融资,持续加速构建 AI 数据基础设施