报告 | 《大模型推理优化关键技术及应用实践研究报告(2026年)》(附下载)

2026-04-22 08:58

报告 | 《大模型推理优化关键技术及应用实践研究报告(2026年)》(附下载)

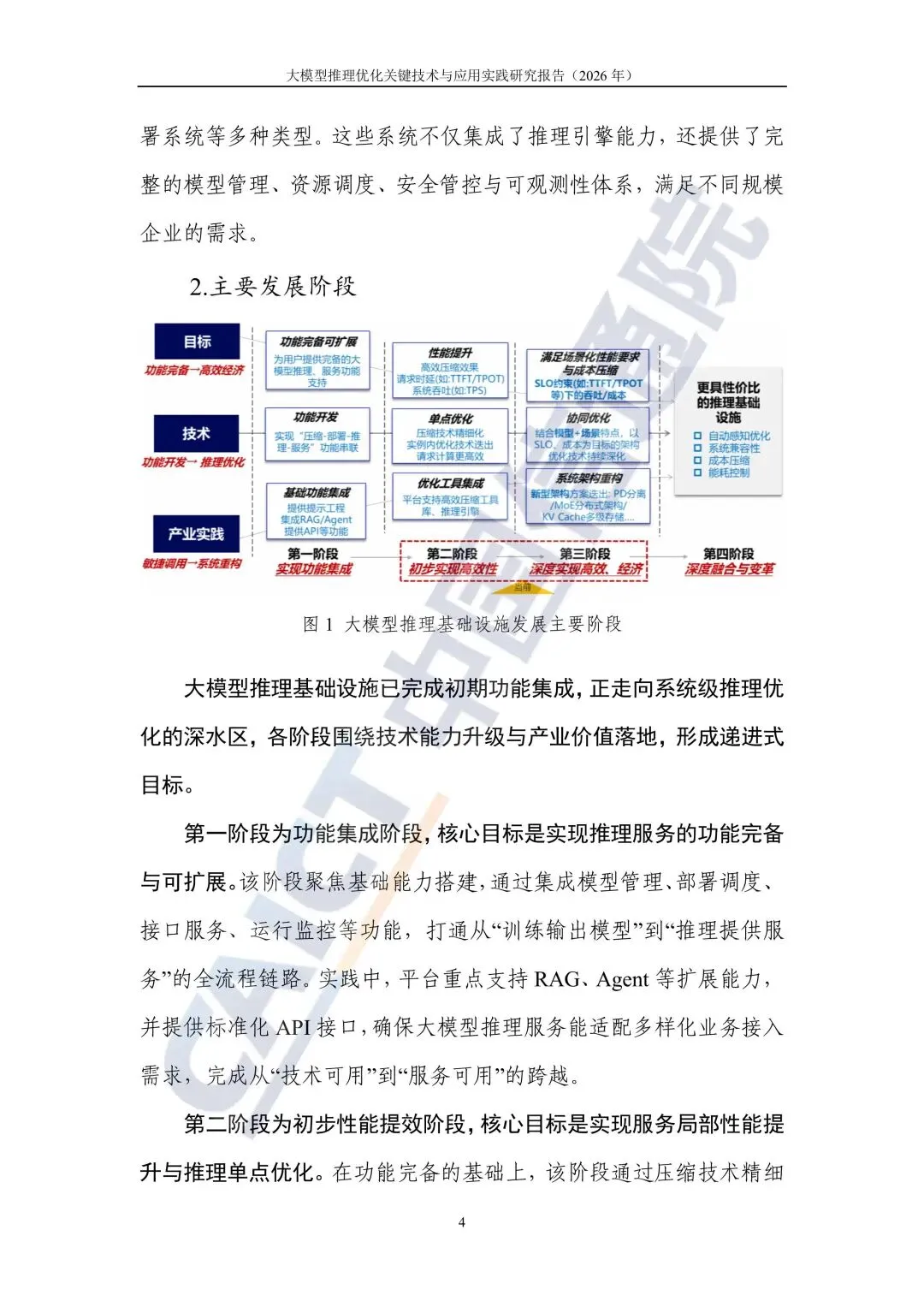

报告由中国信通院发布,聚焦大模型推理优化全链路技术与产业落地,明确推理是 AI 从实验室走向规模化应用的核心环节,当前推理计算量、成本与场景复杂度激增,传统单点优化已无法适配需求,需构建模型 - 引擎 - 系统三级协同优化体系,推动技术与行业深度融合。

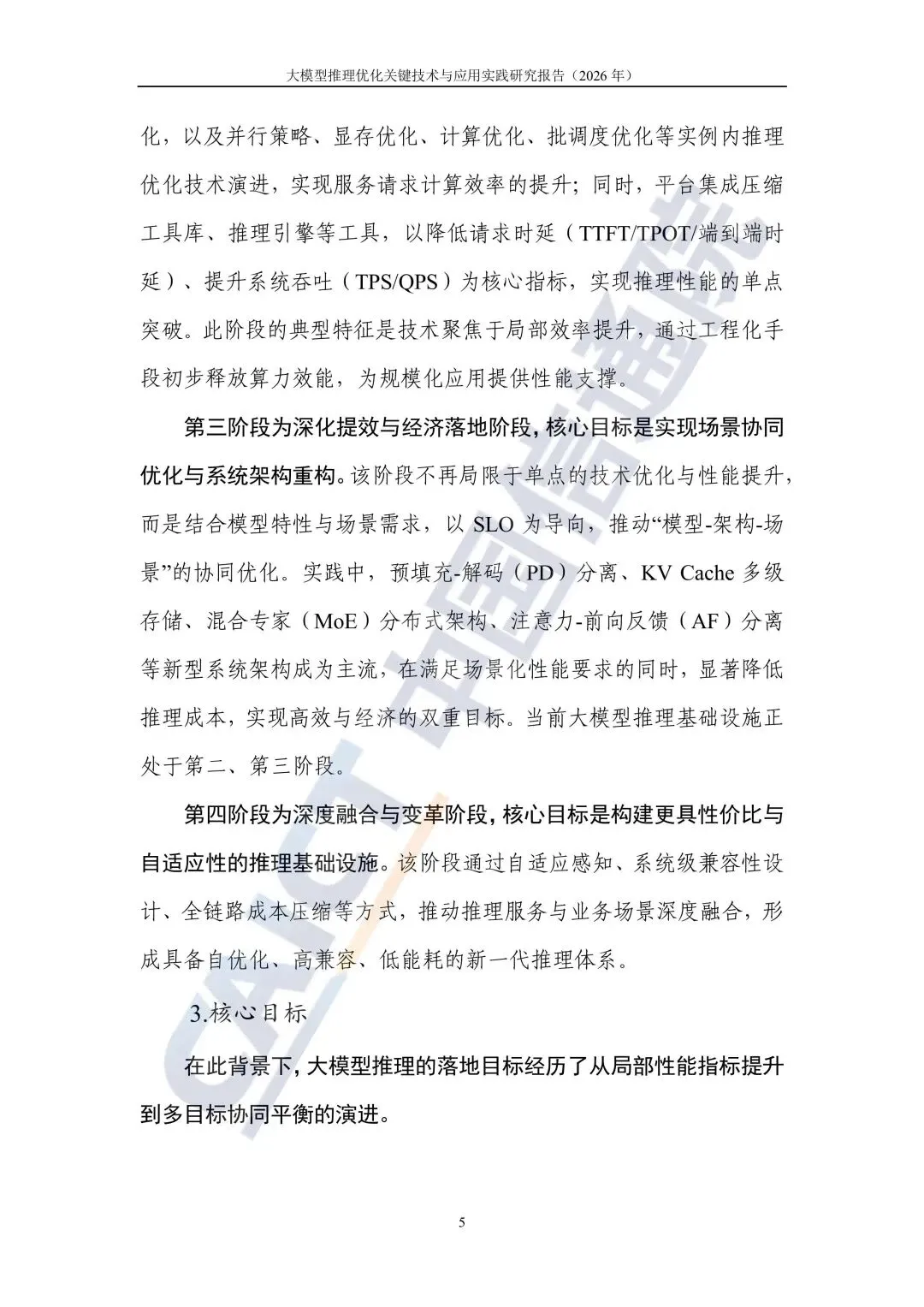

大模型推理已成为产业落地焦点,需求侧推理 Token 消耗、计算量呈百倍级增长,上下文长度两年扩张 32 倍;供给侧推理算力占比持续提升,2026 年中国推理算力市场规模将达 876.5 亿元,推理成本成为企业规模化落地的核心瓶颈。其优化核心目标从单一性能提升,转向效果 - 性能 - 成本多目标协同平衡,在满足服务等级目标(SLO)下实现低时延、高吞吐与低成本。当前推理面临三大核心挑战:一是低时延、高并发、长上下文、流量波动等多样化场景适配难度大;二是高质量算力需求与成本控制难以平衡,存量算力复用与异构调度存在障碍;三是模型向 MoE、多模态、长序列快速迭代,推理基础设施需持续适配升级。报告梳理了三级关键优化技术:模型层通过量化、剪枝、蒸馏实现压缩,依托 MoE 稀疏架构降低计算负载,以 MLA、投机采样等算法优化提升效率;引擎层聚焦显存管理(PagedAttention、KV 缓存复用)、计算优化(算子融合、FlashAttention)、并行加速与动态批处理,提升单实例执行效率;系统层以 PD 分离、AF 分离架构解耦计算与存储任务,结合智能调度与 HBM-DRAM-SSD 多级存储,实现跨节点资源高效协同。产业实践已从单点优化迈向系统协同,早期以模型压缩、推理引擎单点提效为主,当前 PD 分离、KV 缓存中心化架构成为主流,MoE 模型适配的 AF 分离架构逐步落地。报告覆盖金融、运营商、电力、司法、农畜五大行业案例:金融领域通过 KV 缓存预热实现长文本推理时延大幅下降;运营商依托训推一体与 PD 分离提升算力利用率;电力用 MoE 架构与长上下文优化支撑配网检修;司法以存算协同降低文书生成时延;农畜通过 PD 分离提升监控识别实时性。未来,大模型推理优化将向协同化、智能化、场景化演进,异构算力与解耦架构深度协同,自适应调度与多模态、长序列技术持续突破,性能评估标准化加速推进,最终推动 AI 服务从 “能用” 迈向 “好用、省用”,成为千行百业数字化转型的核心支撑。温馨提示:文末附完整PDF下载链接

免责声明:以上报告来源于中国信通院,系本公众号通过公开、合法渠道获得,如涉侵权,请联系删除。

关注公众号,发送关键词“大模型推理优化关键技术及应用实践研究报告2026”即可下载全文。(30天有效期)