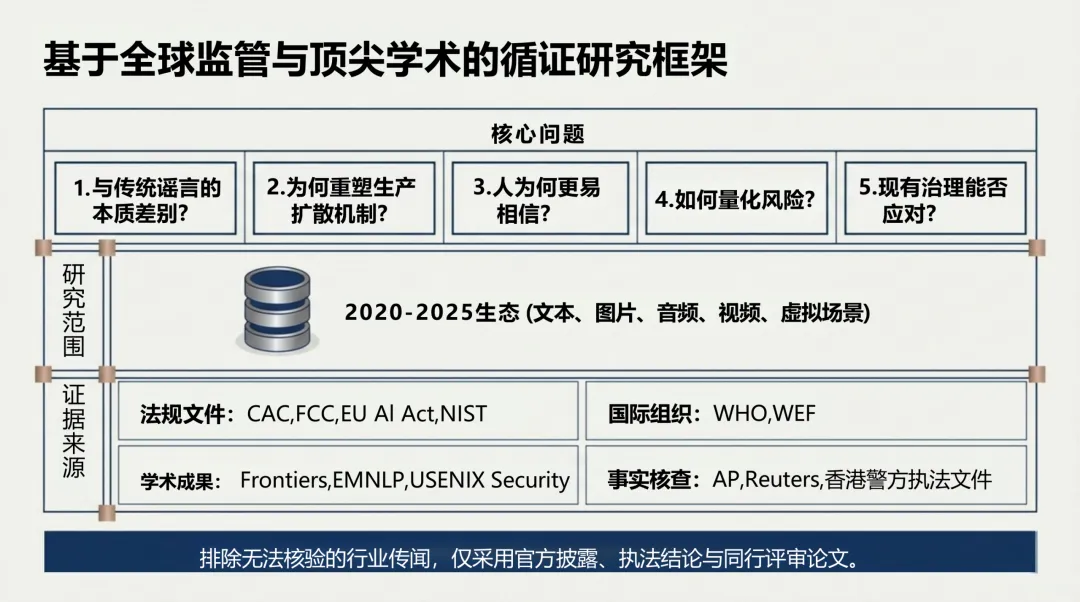

AI谣言深度研究报告(2026):生成式AI重构虚假信息威胁,系统性治理刻不容缓。本报告由清华大学发布,聚焦2020-2026年AI生成、深度伪造与算法放大驱动的虚假信息乱象,揭示AI谣言“更易信、更易放大、更难纠正”的核心特征,提出全链路治理解决方案。

核心要点(文末附完整报告下载方式)

01 核心现状

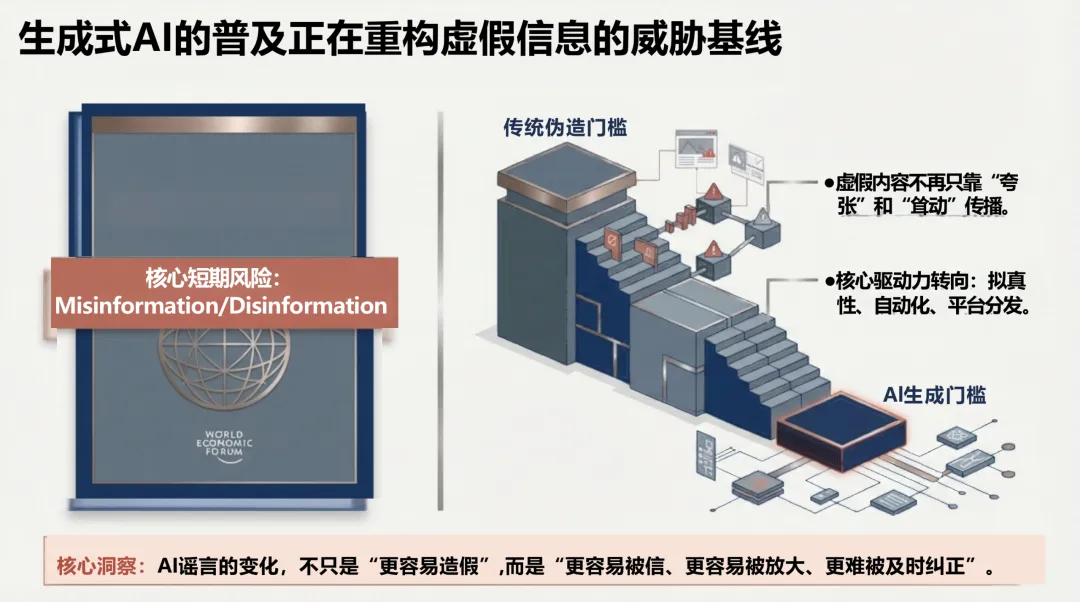

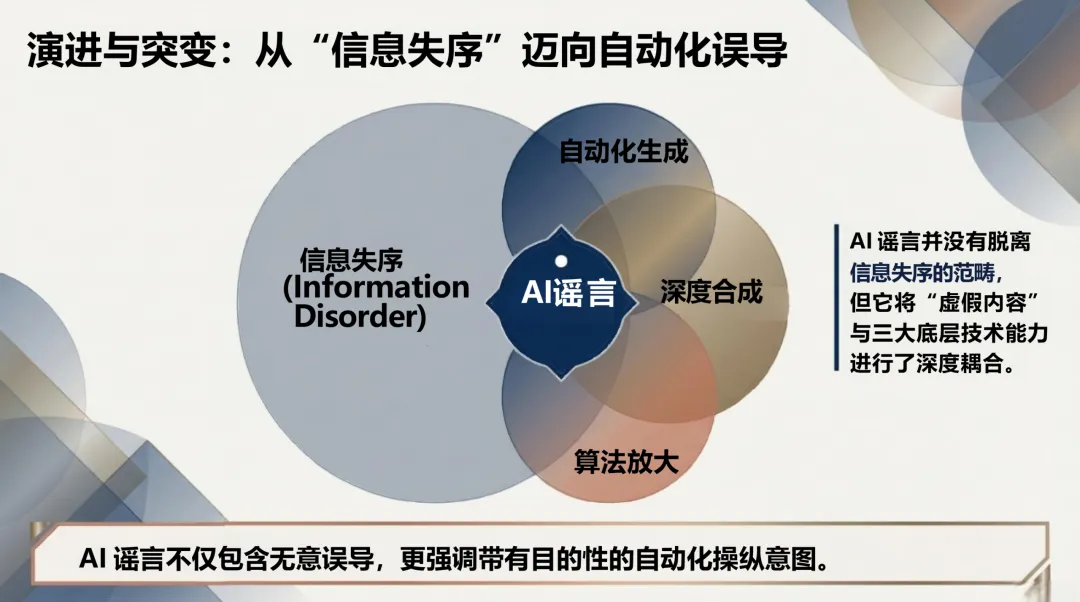

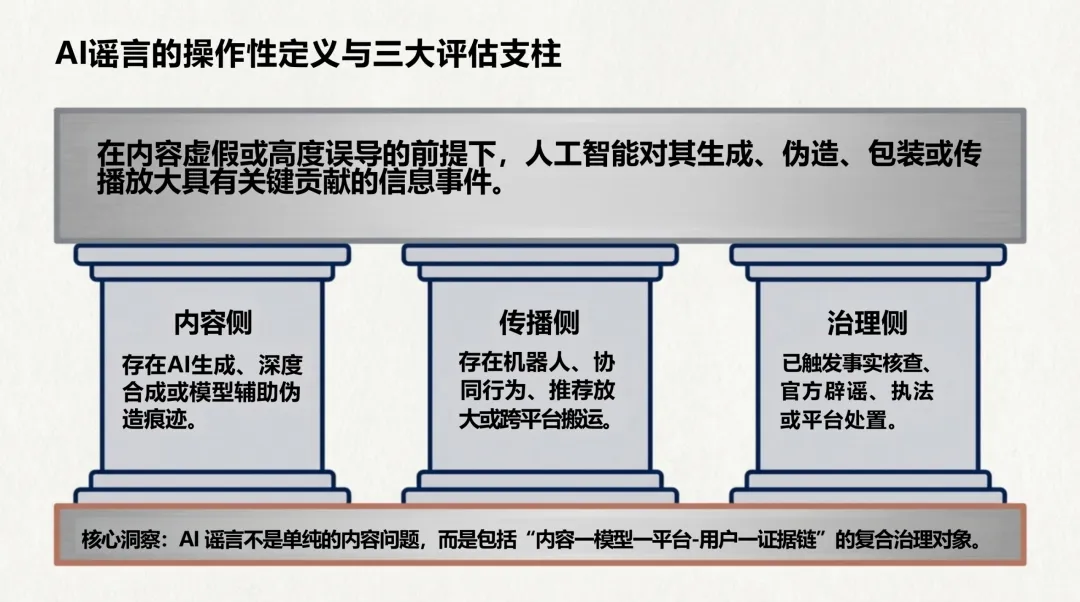

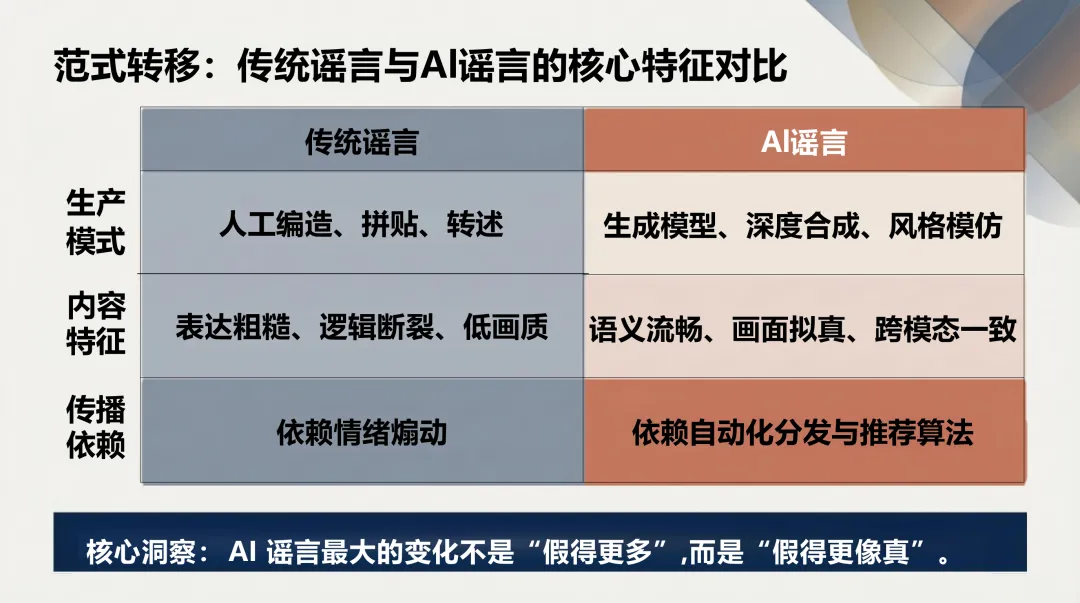

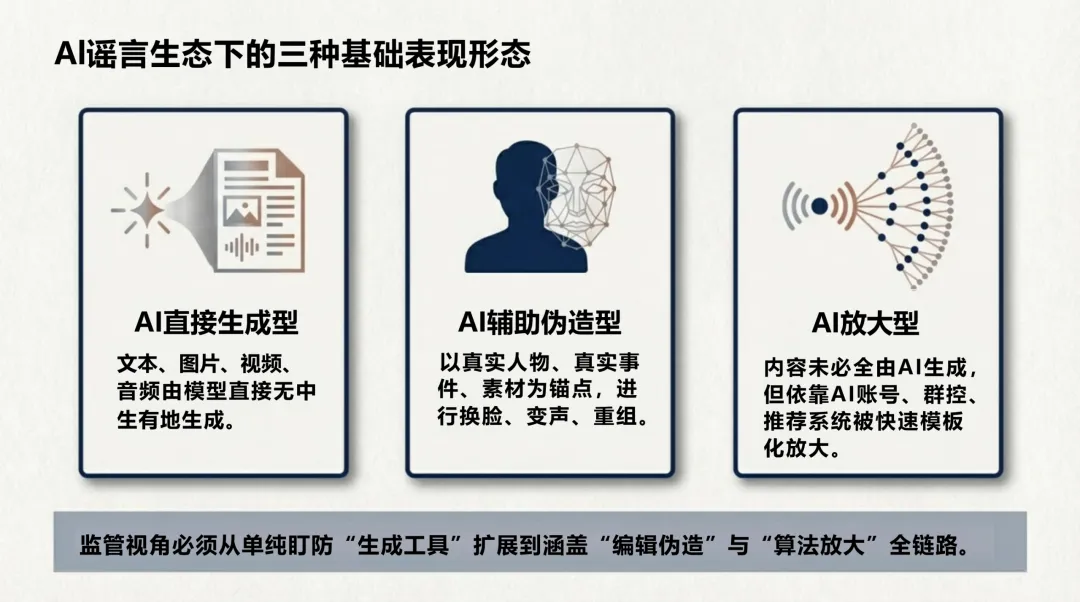

威胁范式突变:生成式AI普及重构虚假信息威胁基线,AI谣言实现分钟级生成,较传统谣言传播速度提升10-50倍,形成“生成-放大-迁移”的自动化杀伤链。 形态全面升级:分为AI直接生成、辅助伪造、算法放大三类,内容语义流畅、拟真度极高,彻底打破“人工编造、表达粗糙”的传统谣言特征。 危害持续扩散:已从舆论误导延伸至金融波动、选举干预、企业诈骗,2024年深度伪造诈骗涉案金额超亿级,短时即可造成不可逆现实损失。

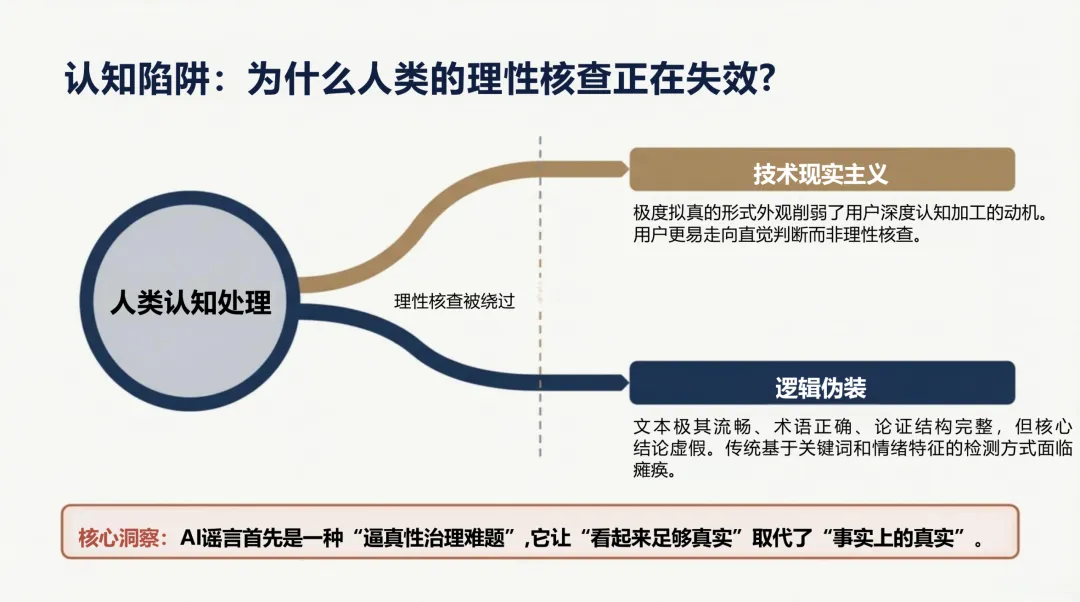

认知劫持效应:AI内容以“技术现实主义”降低人类深度思考动机,摧毁“眼见为实”信任基础,产生“说谎者红利”,真实证据反被质疑。 传播机制革新:依托平台算法推荐与社交机器人矩阵放大,跨平台迁移后切断溯源链,次生变异导致原始辟谣完全失效。 治理结构性失衡:存在治理时差、规制对象错位,传统末端删帖辟谣无法应对分钟级生成的系统性风险,需向前端识别拦截转移。

风险量化评估:构建内容、主体、传播三维风险架构,推出RiskScore评分体系,实施低分提示、中分限流、高分联动的阶梯式响应。 技术防御升级:采用CIB三层检测架构与RumorCone双曲几何模型,防范预训练投毒与RAG知识库污染,突破浅层特征检测局限。 全链路合规治理:落实AI生成内容显式/隐式标识,强化硬件溯源与元数据保护,构建“技术+法律+伦理+社会”四维协同防御体系。

报告免

费领取

关注公众号,在公众号聊天界面回复

【获取资料】(建议直接复制标蓝字),获取报告全文PDF