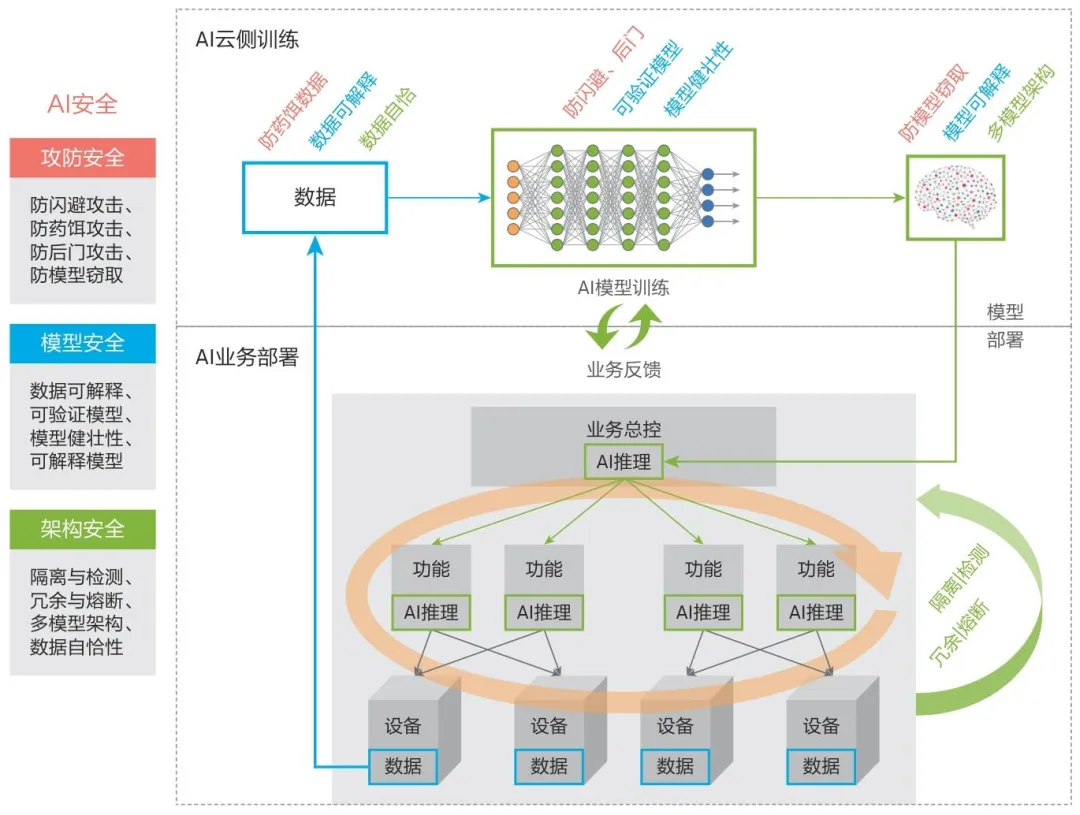

近年来,在海量数据积累、计算能力发展、机器学习创新的驱动下,AI 技术(如图像识别、语音识别)广泛应用,华为预测 2025 年全球将实现 1000 亿联接、85% 企业应用上云,智能社会加速到来;但 AI 系统存在显著安全风险,根本原因是AI 算法设计初未考虑安全威胁且机器学习系统缺乏可解释性,导致闪避攻击、药饵攻击、后门攻击、模型窃取攻击等典型攻击频发(如 8% 恶意数据可影响 50% 患者用药建议);为此华为提出攻防安全、模型安全、架构安全三层防御手段,通过对抗训练、可解释模型、业务隔离等技术保障 AI 安全,最终致力于联合全球伙伴,推动 AI 在技术(增强可解释性)与业务(落地产品线案例)层面安全发展,应对法规伦理挑战(如 GDPR 要求)。

一、迈向智能社会:AI 发展的背景与愿景

1、AI 技术爆发的核心驱动因素

加州大学伯克利分校学者指出,AI 近二十年快速崛起源于三点:

(1)海量数据:互联网催生语音、视频、文字等多形式数据,为机器学习提供 “养分”;(2)高扩展计算与软件:CPU 集群、GPU/TPU 专用硬件及配套软件平台,支撑深度学习落地;(3)资源可获得性:开源软件降低开发成本,云服务提供随时获取的计算 / 存储资源。2、2025 年智能社会关键预测(华为全球产业愿景)

预测领域 | 具体指标 |

全球联接数 | 1000 亿,覆盖 77% 人口 |

企业应用部署 | 85% 的企业应用部署至云端 |

智能家庭市场 | 12% 家庭引入智能机器人,形成千亿美元市场 |

3、AI 发展里程碑

1956 年:麦卡锡、明斯基等学者首次提出 “人工智能” 概念;二、AI 安全五大挑战:风险的核心来源

AI 安全风险的本质是算法设计初未考虑安全威胁,且判断易被恶意干扰,在工业、医疗、交通等关键领域可能引发财产损失或人身安全问题,具体挑战如下:

- 软硬件安全:软件(应用 / 平台)、硬件(芯片)及 AI 模型均可能存在漏洞或后门,且 AI 模型因 “不可解释性”,后门难以被检测;

- 数据完整性:攻击者可在训练阶段掺恶意数据影响AI模型推理能力,或在推理阶段加微小噪音篡改判断结果;

- 模型保密性:服务提供者仅愿开放查询接口,但攻击者可通过多次查询构建相似模型,泄露原模型参数(核心知识产权);

- 模型鲁棒性:训练样本覆盖范围不足,导致模型面对恶意样本时无法正确判断;

- 数据隐私:用户提供的训练数据可能通过反复查询被窃取,泄露个人隐私信息。

三、AI 安全典型攻击方式:四类核心攻击的机制与案例

攻击类型 | 核心原理 | 关键研究 / 案例 | 危害领域 |

闪避攻击 | 对输入加人类难察觉的微小扰动,生成 “对抗样本”,欺骗 AI 模型 | 1. Szegedy(2013)首次提出对抗样本; 2. CW 攻击:扰动极小且 100% 成功率; 3. 物理攻击:涂改 “禁止通行” 路标为 “限速 45” | 图像识别、自动驾驶(路标识别)、语音控制 |

药饵攻击 | 注入精心设计的 “药饵样本”,污染训练数据,破坏 AI 系统功能 | 1. Jagielski(2018)提出 3 种攻击方法(最优坡度 / 全局最优 / 统计优化);2. 案例:8% 恶意数据致 50% 患者用药建议偏差超 75% | 医疗(用药分析)、金融(贷款 / 房价判断) |

后门攻击 | 在模型中植入隐蔽后门(仅攻击者知道触发条件),控制特定输入的判断结果 | Gu 等人(2017):输入含特定图案触发后门,无源代码可解读,隐蔽性极高 | 模型生成 / 传输阶段、关键业务 AI(如安防识别) |

模型窃取攻击 | 通过多次调用 AIaaS(AI 即服务)接口,分析输入输出推测模型参数及训练数据 | Tramèr(2016):窃取模型后可进一步构建对抗样本,辅助黑盒攻击 | AI 服务提供商(知识产权泄露)、金融 AI(策略泄露) |

四、AI 安全防御手段:三层防御框架的具体实践

华为提出 “攻防安全 - 模型安全 - 架构安全” 三层防御体系,覆盖 AI 系统全生命周期:

1. 第一层:攻防安全(针对已知攻击的针对性防御)

针对四类典型攻击,在数据收集、模型训练、模型使用三个阶段部署防御技术,具体如下表:

攻击类型 | 数据收集阶段防御 | 模型训练阶段防御 | 模型使用阶段防御 |

闪避攻击 | 对抗样本生成(提前模拟) | 网络蒸馏、对抗训练、DNN 模型验证 | 对抗样本检测、输入重构 |

药饵攻击 | 回归分析(检测异常值) 训练数据过滤 | 集成分析 | - |

后门攻击 | - | 模型剪枝(细粒度剪枝去除后门神经元) | 输入预处理(过滤触发后门的输入) |

模型窃取攻击 | 差分隐私(数据加噪)、模型水印 | 隐私聚合教师模型(PATE) | - |

2. 第二层:模型安全(提升 AI 模型自身健壮性)

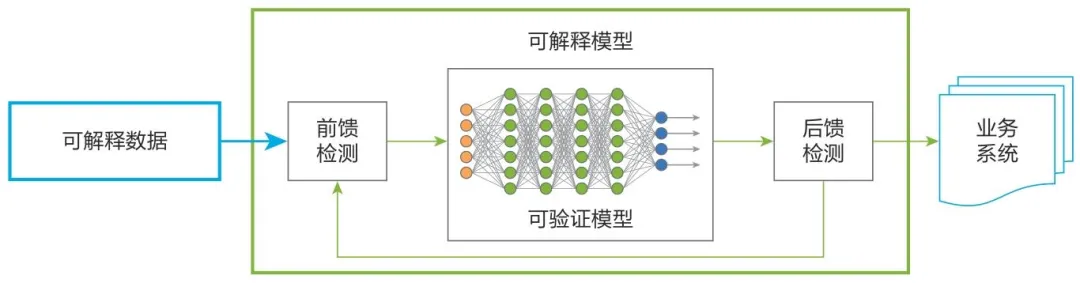

核心通过 “可检测、可验证、可解释” 三大特性增强模型安全:

- 模型可检测性:通过黑盒测试、白盒测试,或在数据输入前加 “前馈检测模块”、模型输出后加 “后馈检测模块”,过滤恶意样本;

- 模型可验证性:类似软件验证,用求解器约束 AI 模型的 “输入空间 - 输出空间” 对应关系(如验证特定扰动内无对抗样本),但需优化效率(DNN 验证为 NP 完全问题);

- 模型可解释性:解决 “黑盒” 问题,分三阶段推进:

- 建模前 “数据可解释”:分析训练数据特征,筛选有意义的特征构建模型;

- 构建 “可解释模型”:结合传统机器学习(基于统计学,可解释性强),平衡效果与可解释性;

- 模型解释分析:用 LIME 等通用方法,或针对模型结构的专用方法,分析输入 - 输出 - 中间信息的依赖关系。关键意义:满足 GDPR 反算法歧视要求(如排除种族、性别等敏感数据影响),消除数据偏见(如 HR 招聘数据偏见导致的性别失衡)。

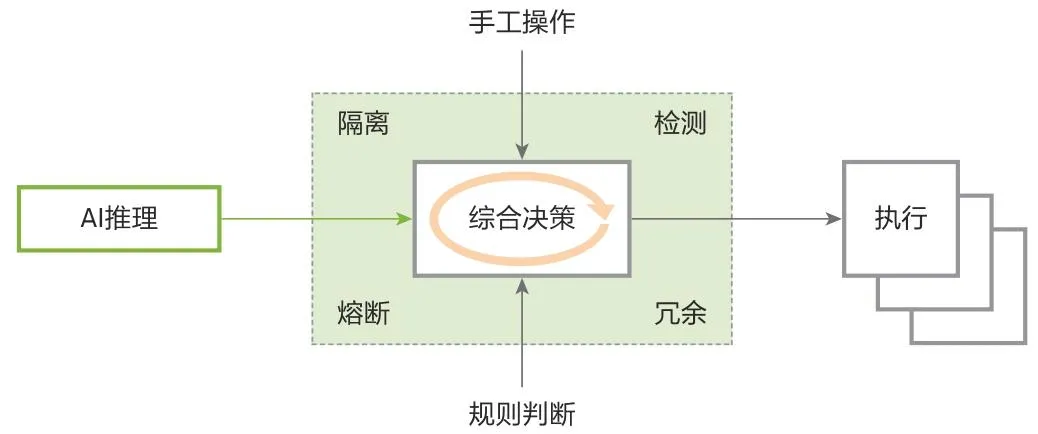

3. 第三层:架构安全(结合业务场景的安全设计)

针对 AI 部署的业务特性,通过隔离、检测、熔断和冗余四类机制设计AI安全架构与部署方案,核心案例为自动驾驶和医疗 AI:

- 隔离:对 AI 推理模块、综合决策模块进行功能隔离,设置访问控制,减少攻击面;

- 检测:部署持续监控与攻击检测模型,实时分析威胁风险,高风险时交回人工控制;

- 熔断:关键操作(如自动驾驶刹车、医疗用药建议)设置 “确定性阈值”,低于阈值时回落至规则判断或人工处理;

- 冗余:搭建 “多模型架构”,单个模型错误不影响最终决策,降低单一攻击的全面危害。